1 天前

1 天前

当你输入“法国的首都是”,大语言模型瞬间给出“巴黎”。你或许以为它像查字典一样调取了某个存储单元,但真相完全不同——没有任何一个参数单独“记住”巴黎是法国首都。1.24亿个浮点数组成的矩阵,像一条看不见的流水线,把“法国”“首都”这几个词的向量,一步步推向“巴黎”所在的方向。这不是简单的信息检索,而是一场由矩阵乘法和非线性变换主导的数值舞蹈。今天我们就沿着这条流水线,追踪一个Token从输入到输出的完整旅程。

你输入的每一个句子,首先会被拆分成模型能理解的最小单位——Token。“The”是一个Token,“unbelievable”会被切成“un”“believ”“able”三个Token,甚至空格也会被编码成Token的一部分,用来区分词首和词中。这一步就像把一篇文章拆成无数个乐高积木,每个积木都有唯一的编号,但这个编号本身毫无语义——就像乐高零件的编号不能告诉你它要拼成什么。

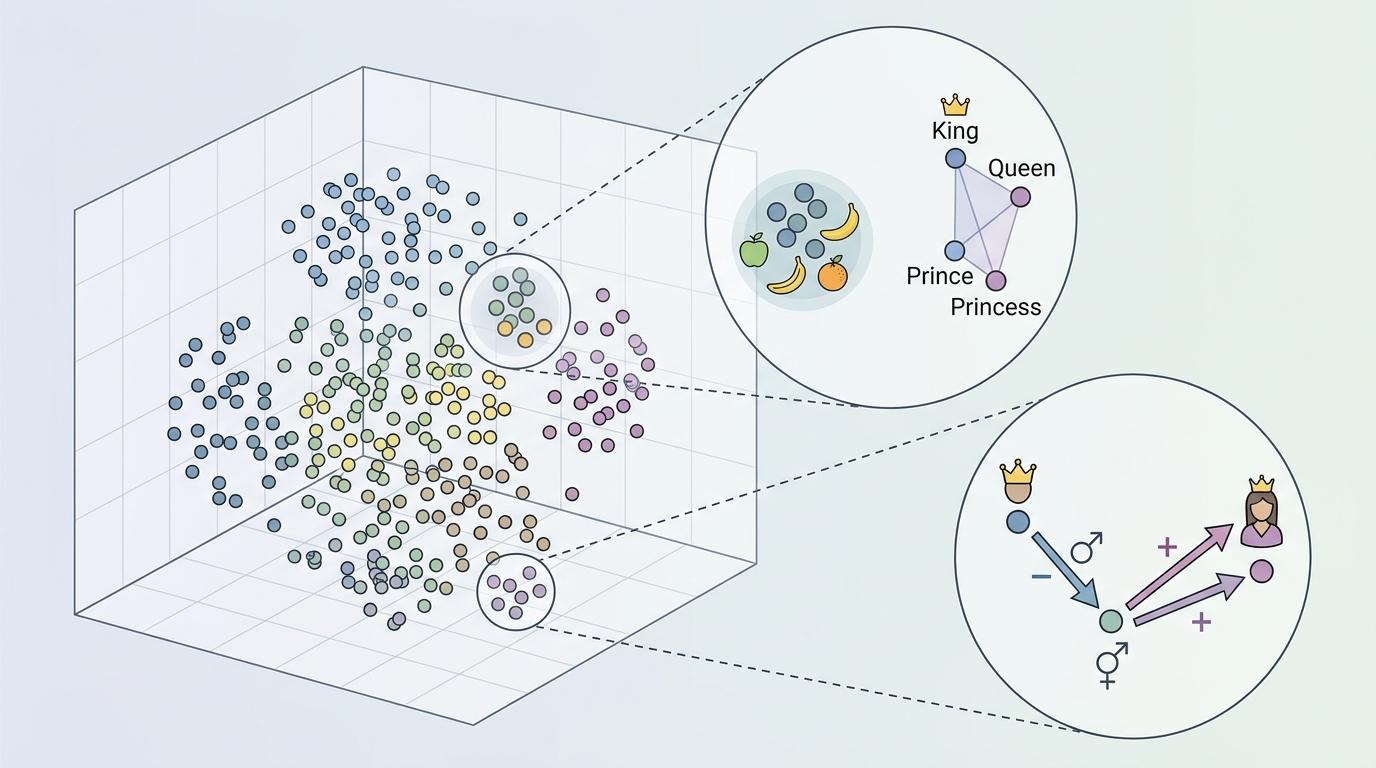

接下来,这些编号会被映射到高维向量空间。GPT-2 Small用768维向量表示每个Token,你可以把它想象成一个768维的乐高零件盒,每个Token对应盒子里的一个位置。这个位置不是随便放的:语义相近的Token会被放在相近的位置,“国王”减去“男人”加上“女人”,得到的向量会非常接近“女王”。向量之间的方向和距离,悄悄编码了语言的所有秘密。

但模型还需要知道Token的顺序——毕竟“法国的首都”和“首都的法国”完全是两回事。位置编码会给每个Token的向量加上一个“位置标签”,就像给乐高积木贴上“第一层”“第二层”的贴纸,让模型能区分它们在序列中的位置。

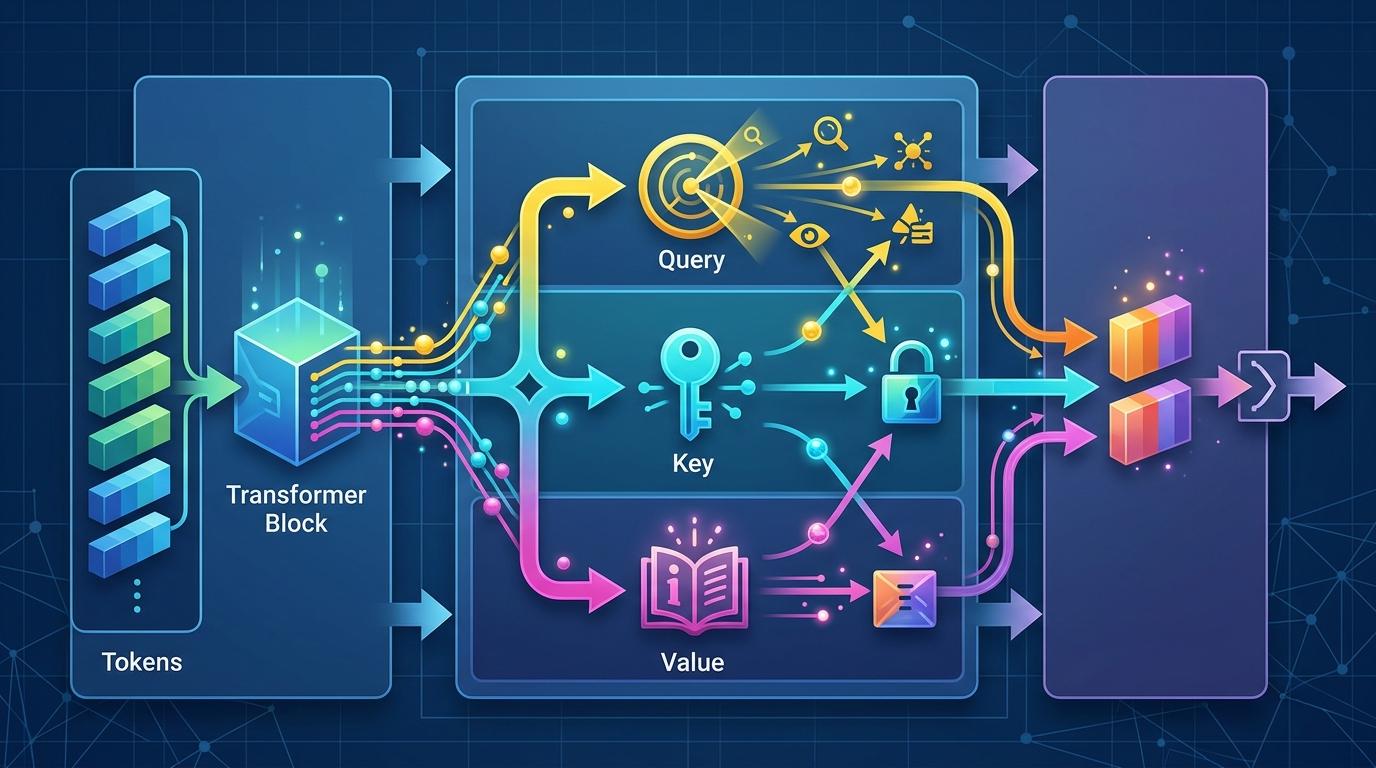

当Token向量进入Transformer Block,真正的魔法开始了。这里的核心是自注意力机制——你可以把它想象成一个智能的信息路由器。每个Token会生成三个向量:Query(我需要什么信息)、Key(我能提供什么信息)、Value(我实际的内容是什么)。

还是以“法国的首都是”为例,最后一个Token“是”会发出一个Query:“我需要找到主语是什么,以及它的首都属性”。然后它会和前面所有Token的Key做“点积”——就像用自己的需求去匹配每个Token能提供的信息。匹配度越高,注意力权重就越大。计算结果显示,“法国”和“首都”的权重加起来超过70%,这意味着模型把大部分注意力都放在了这两个Token上。

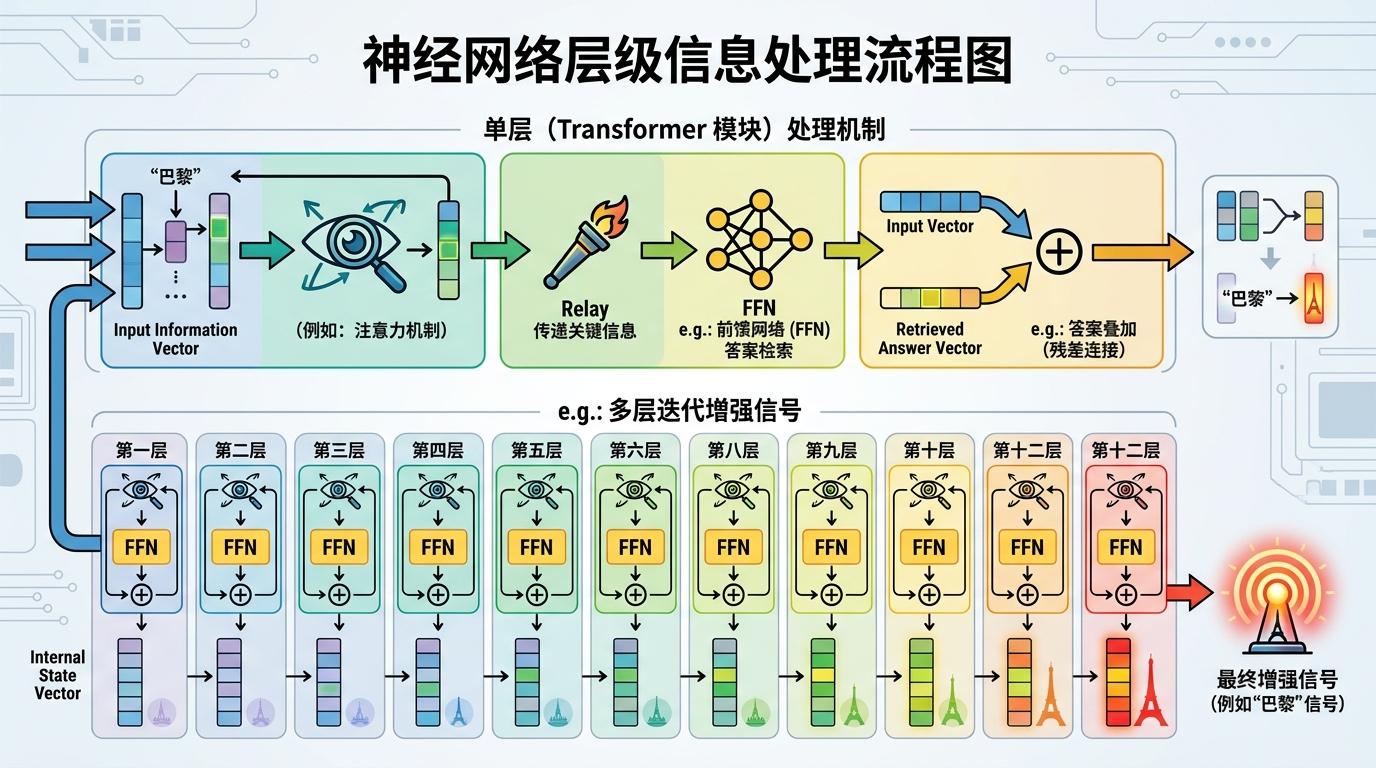

但注意力只是搬运信息,真正生成答案的是前馈网络(FFN)。它就像一个写死在权重里的知识查找表,里面存着3072个“模式-知识”对——比如“X的首都是Y”就是其中一个模式。当“是”的向量带着“法国”和“首都”的信号流入FFN,对应的模式就会被激活,“巴黎”的知识片段就会被注入到输出中。

整个过程就像一场接力赛:注意力把关键信息传递过来,FFN根据这些信息检索出答案,然后通过残差连接把答案叠加到原来的向量上。每一层Transformer Block都只做这一件事,12层之后,“巴黎”的信号就变得足够强烈了。

当Token向量走完12层Transformer Block,最后一步就是把它映射回词表中的Token。模型会把最后一个位置的向量——只有它看到了完整的上下文——通过LM Head矩阵转换成50257个未归一化的分数,然后用softmax函数把这些分数转换成概率分布。

在“法国的首都是”这个例子中,“巴黎”对应的概率高达74.67%,断崖式领先其他Token。这意味着模型经过12层的计算,最终把“法国”和“首都”的向量,精准地推向了“巴黎”所在的方向。

但生成答案的过程还没完。模型会根据概率分布选择下一个Token——你可以用贪婪搜索直接选概率最高的,也可以用温度采样、Top-K采样等方法增加多样性。选好的Token会被追加到输入序列中,然后整个过程重新开始,直到生成你需要的文本。

为了提高生成效率,模型会用KV Cache缓存之前计算过的Key和Value向量,避免重复计算。这就像你在写作文时,会把之前想到的素材记在草稿纸上,不用每次都重新想一遍。但KV Cache也会占用大量显存,尤其是在生成长文本时,这也是大模型推理成本高昂的原因之一。

当你看到模型输出“巴黎”时,你看到的是一个简单的答案,但背后是1.24亿个浮点数经过12层矩阵变换的结果。没有任何一个参数单独“记住”巴黎是法国首都,答案是整个数值路径的终点——就像无数条小溪汇聚成河流,最终流向大海。

这就是大语言模型的本质:它不是在“记忆”知识,而是在“计算”知识。每一次矩阵变换都是一次平凡的计算,但当这些计算叠加在一起,就涌现出了超越直觉的智能。知识不在参数里,而在数值路径中。

未来,我们或许能更深入地理解这些数值路径,甚至能直接修改它们来纠正模型的错误。但现在,我们已经能透过Token的旅程,看到智能的另一种可能——它不是来自某个神秘的黑箱,而是来自无数平凡计算的累积。

点击充电,成为大圆镜下一个视频选题!