25 天前

25 天前

你有没有试过把一幅山水画撕成细纸条,再一根根捋平了看?过去两年里,火遍语言领域的Mamba模型,在处理图像时就一直在做这件蠢事。为了适配它擅长的一维序列计算,研究者不得不把二维图像按固定方向扫描成长条——要么从左到右,要么从上到下,甚至用螺旋线、希尔伯特曲线。结果就是图像的空间结构被扯得稀碎,同一区域反复计算造成冗余,相邻像素在序列里隔得老远。直到2026年3月,南达科他大学的团队抛出了MFil-Mamba:别撕画了,换个方式看。

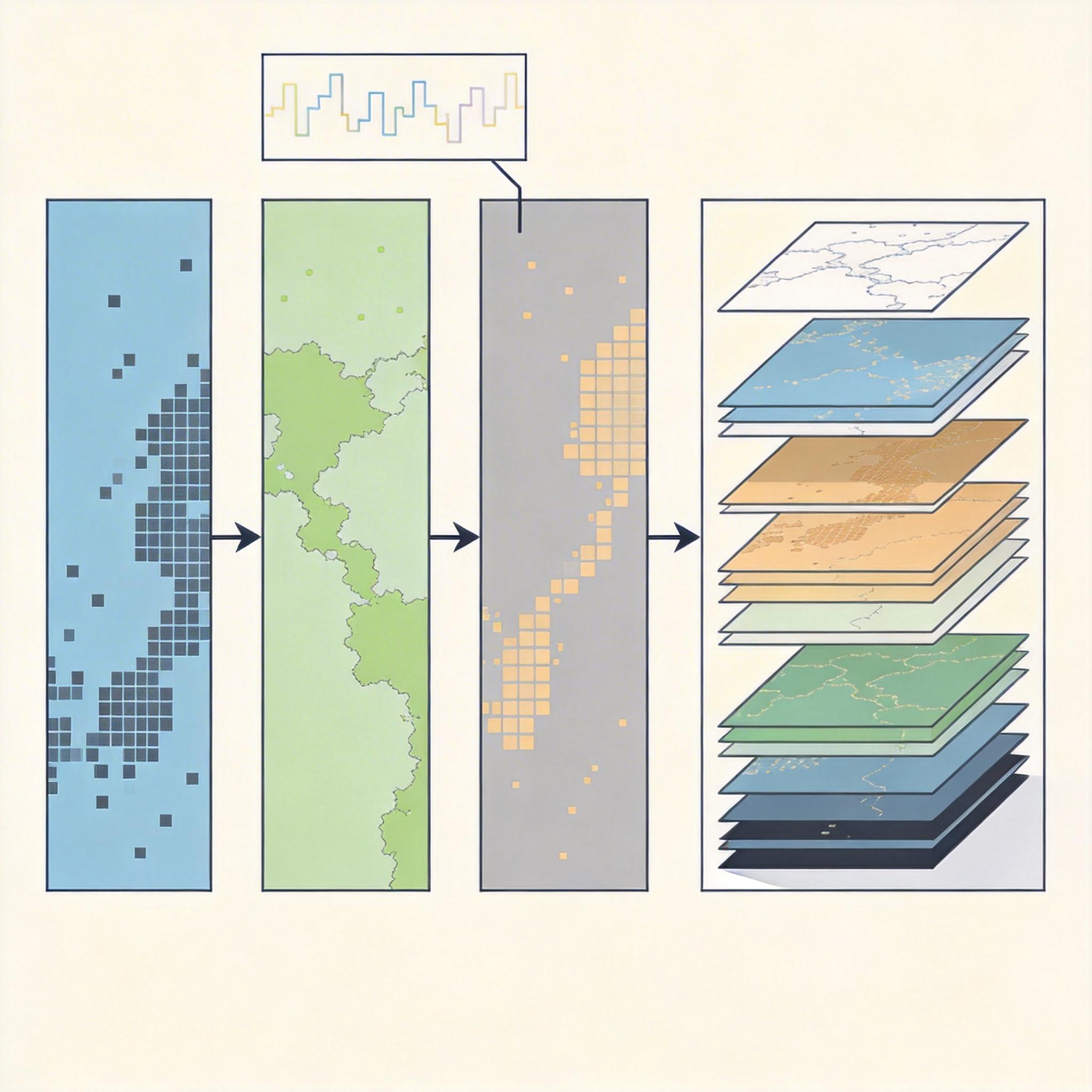

你可以把MFil-Mamba的核心思路,理解为给模型配了四个分工明确的“图像观察员”。第一个观察员原封不动看整张图,负责记录原始的颜色和纹理;第二个专盯垂直边缘,比如建筑的立柱、人脸的侧面轮廓;第三个专找水平边界,比如地平线、桌面的边缘;第四个最聪明,会在训练中自己学会关注当前任务最需要的特征——可能是医学影像里的病灶,也可能是遥感图里的农田。

这四个观察员同时开工,各自生成一份特征图,再把这些图堆叠成一份“多视角报告”喂给Mamba。不同于之前被扯成纸条的一维序列,这份报告完整保留了图像的二维空间结构,相邻像素依然紧紧挨在一起。论文用协方差矩阵证明,这种多视角扫描能捕捉到单向扫描永远拿不到的二阶空间依赖关系——简单说就是,模型终于能看懂“眼睛在鼻子上方”这种基础的空间逻辑了。

想法再好,也要用数据说话。MFil-Mamba在三大核心视觉任务上,把传统视觉Mamba、CNN和Transformer都甩在了身后。

在ImageNet-1K分类任务中,参数量仅33.5M的Tiny版本,Top-1准确率达到83.2%,比同规模的Swin-T高出1.9个百分点,比DeiT-S更是高出3.4个百分点;50.5M的Small版本准确率83.8%,直接超越了ConvNeXt-S。在COCO目标检测任务中,MFil-Mamba-T的框检测AP达到47.3%,掩码AP42.7%,全面领先同规模的ConvNeXt-T、Swin-T和VMamba-T。ADE20K语义分割任务里,它的Tiny变体单尺度mIoU冲到48.5%,比VMamba-T高了1.7个百分点。

消融实验更能说明问题:只用原始特征图时准确率82.4%,加上水平/垂直梯度图后涨到82.9%,再加入动态学习滤波器直接跳到83.2%;如果换成传统的四向十字扫描,准确率立刻掉到82.6%——多滤波器扫描的优势,被数据钉得死死的。

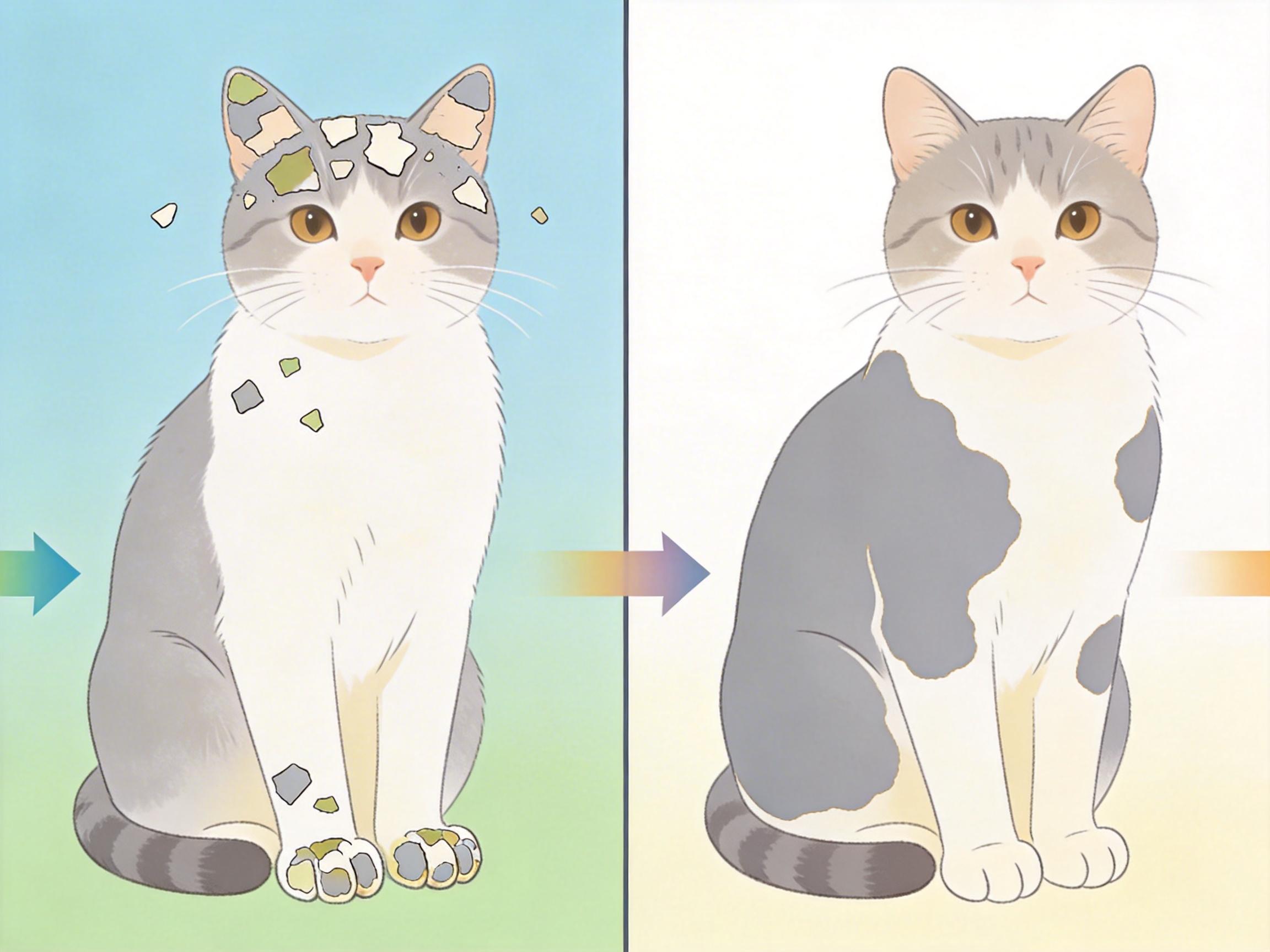

数据之外,我们能直接“看见”MFil-Mamba的厉害。有效感受野(ERF)可视化显示,它的感受野比ConvNeXt、VMamba和Swin都更大、更均匀,完全贴合物体的自然形状——比如识别猫的时候,它的感受野会精准覆盖整只猫,而不是像有些模型那样,只盯着猫的脑袋或者爪子。

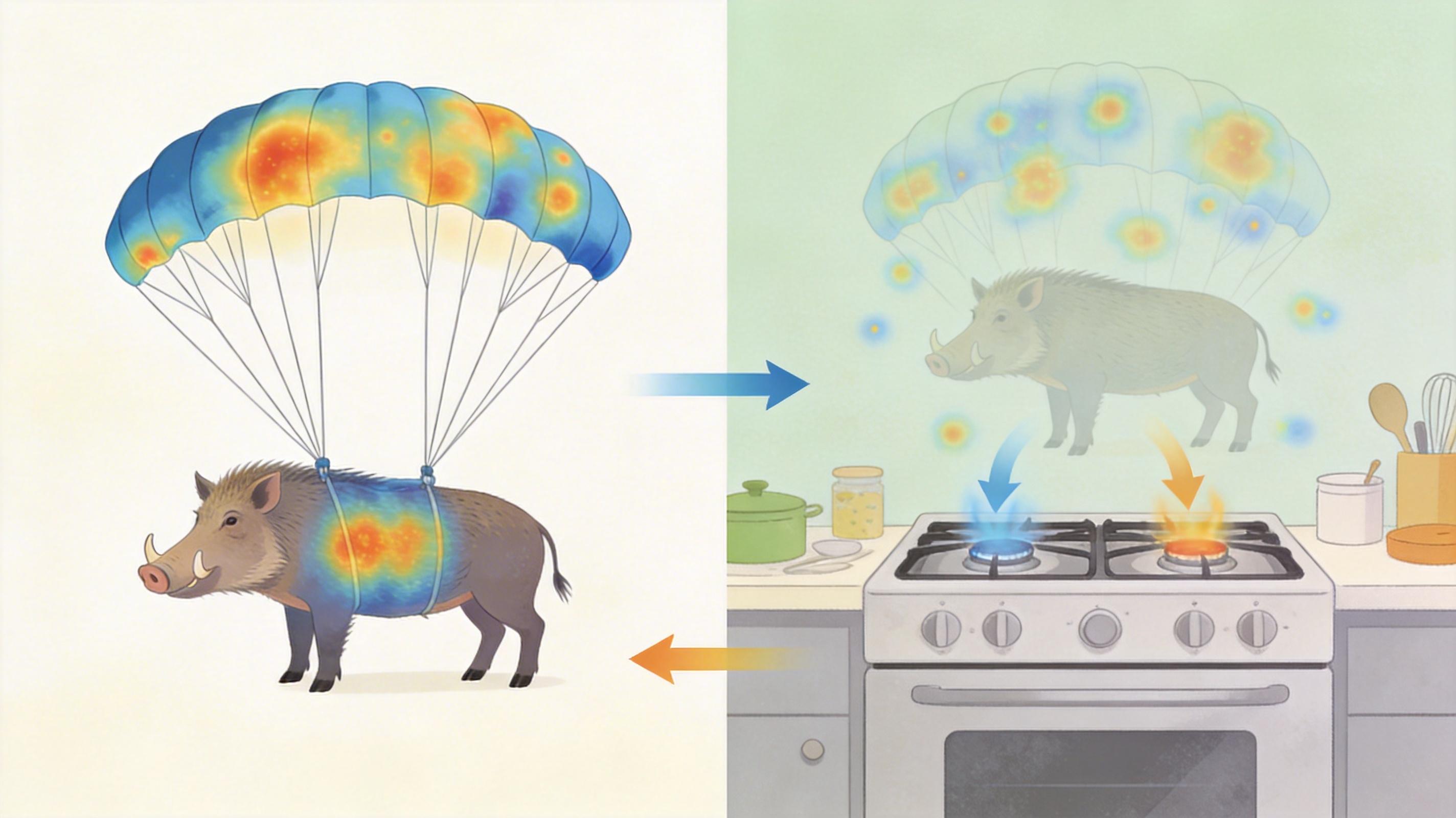

Grad-CAM注意力图更直观:识别降落伞时,它的注意力完全集中在伞体上;识别疣猪时,精准锁定猪的头部和身体;识别煤气灶时,不会被旁边的锅碗瓢盆干扰。相比之下,有些基线模型的注意力会分散到背景里,甚至抓错重点。这种精准的注意力,正是它能在分割、检测任务中表现突出的核心原因。

MFil-Mamba的出现,本质上是给视觉Mamba松了绑——不用再为了适配一维计算,硬生生扭曲二维图像的空间结构。它没有在扫描路径上继续内卷,而是换了个思路:既然Mamba擅长处理序列,那我就给它喂一份保留空间结构的“多视角序列”。

当然,它也不是完美的。多滤波器带来了额外的计算开销,在移动端部署还需要进一步优化;动态滤波器的学习逻辑,也需要更深入的理论解释。但不可否认的是,它为视觉状态空间模型开辟了一条全新的路。

好的模型,应该学会适应数据,而不是反过来。 从撕画到多视角观察,MFil-Mamba迈出的这一步,可能会让AI看世界的方式,变得更像人类。

点击充电,成为大圆镜下一个视频选题!