对抗知识焦虑,从看懂这条开始

App 下载

从卖算力到卖Token,云计算换了赛道

云服务商业模式|AI模型调用量|Token计量|公有云市场|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

云服务商业模式|AI模型调用量|Token计量|公有云市场|AI产业应用|人工智能

2025年中国公有云的AI模型调用量飙到了1944万亿Token——这个数字比2024年涨了16倍。如果把每个Token比作AI生产的一个“零件”,意味着企业用AI干活的规模,一年翻了16番。更有意思的是,当所有人都以为传统云厂商会靠存量优势守住市场时,一家后来者却靠着纯外部客户的调用量,拿下了近半的市场份额。这不是某家厂商的胜利,而是云计算的底层逻辑正在被彻底改写:企业不再买服务器,而是买AI的“生产力”。

2022年ChatGPT爆火时,AI还只是处理文本,单次任务消耗几千到几万Token;2025年推理模型成熟后,一道题要“想”十几分钟,单次Token消耗直接翻了一个量级;如今长程Agent出现,AI能自主跑几小时甚至几天的复杂任务,一晚上烧掉的Token,抵得上过去聊一个月天。

多模态的加入更是让Token需求彻底爆发。生成一张图、一段视频,单次任务就要吃掉几千万Token。IDC的数据显示,这些增长全来自企业端——不是个人用户买会员聊天,是真金白银把AI塞进作业批改、智能巡检、视频检索这些业务里。K12教育因为视觉模型成熟,Token消耗几个月就翻了12倍;智能巡检这类过去不存在的场景,几个月就跑到了日均百亿Token的规模。

Token不再是技术术语,它成了AI生产力的计量单位,就像工业时代的“件”“吨”“度”。

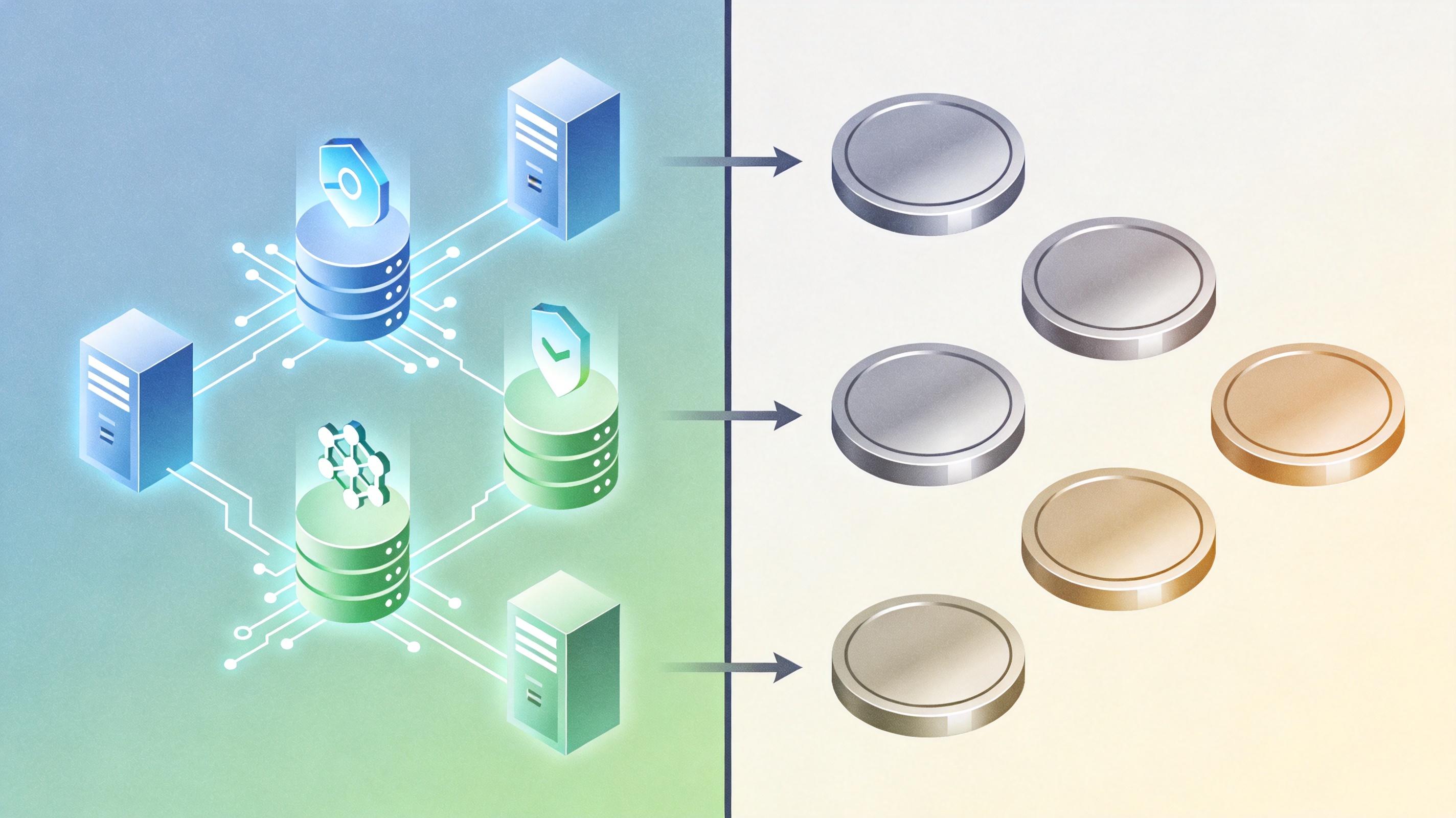

过去的云计算,卖的是算力、存储、网络这些“数字基建”,企业买的是“水电煤”;但AI时代,企业买的是“成品零件”——Token。这是两门完全不同的生意。

老牌云厂商的困境在于,多年的业务体系都是围绕“卖资源”搭建的:销售算的是服务器一年几万块的营收,组织习惯是维护存量客户,甚至连客户的预期都是“稳定的IT后台”。AI对他们来说,是加在旧摊子上的新业务,很难立刻调转船头。

而后来者的优势恰恰是“没有包袱”。他们从一开始就把AI当核心,云只是为AI服务的工具。比如力推MaaS(模型即服务),把销售的考核重心从服务器转向Token——哪怕CDN卖得再好,Token上不去绩效就不合格。这种战略差异直接体现在市场上:当传统厂商还在把AI当附加服务时,新玩家已经靠Token的规模效应,把单位成本压到了更低,反过来吸引更多企业接入,形成“调用量越大→成本越低→调用量更大”的正循环。

Token的竞争表面是份额,本质是效率的比拼——谁能用更少的算力产出更多Token,谁就能赢。

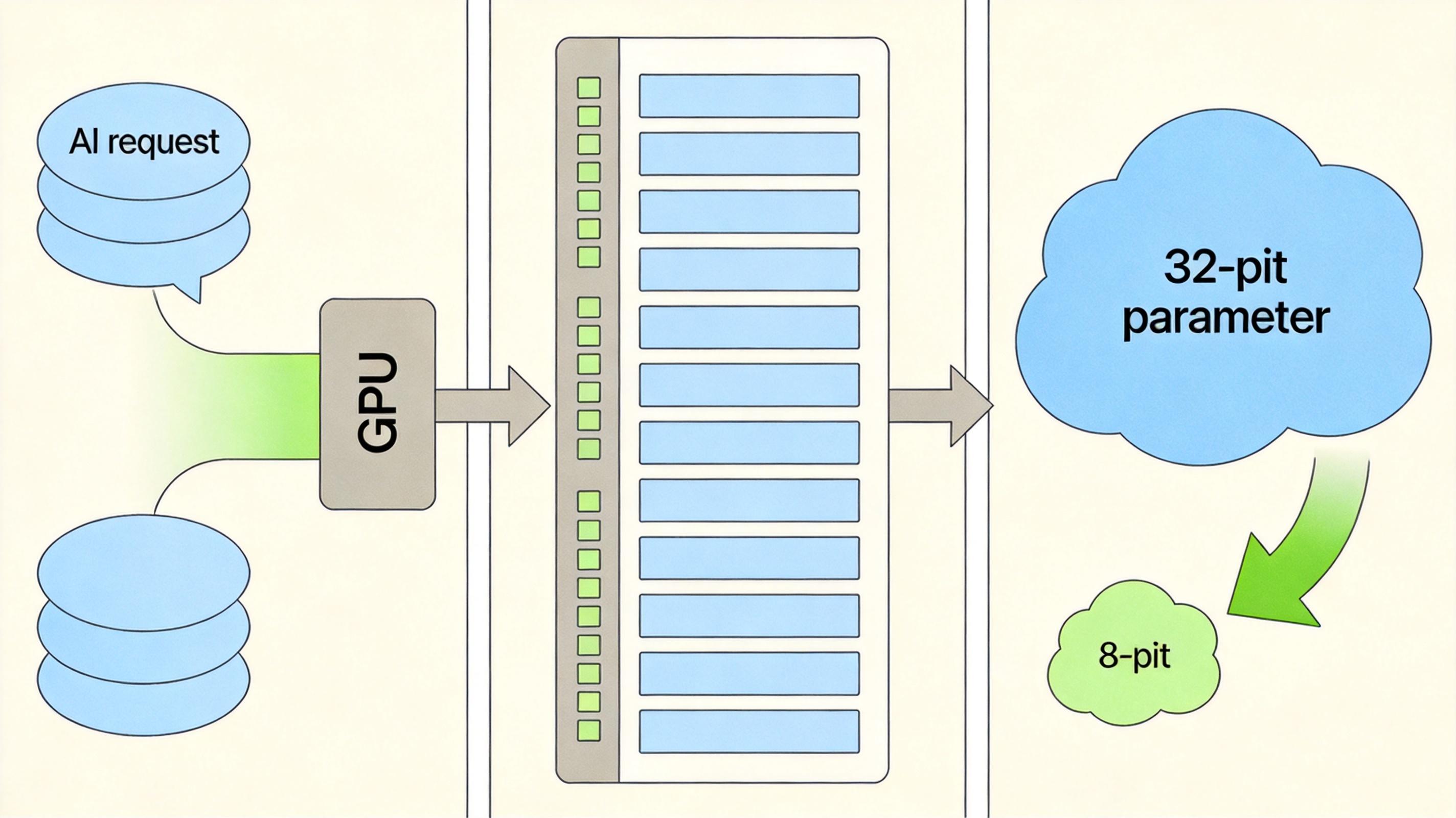

这里的效率藏在每一个技术细节里:比如用连续批处理把多个AI请求合并,减少GPU的空闲时间;用PagedAttention优化内存缓存,让一块GPU能同时处理更多长文本请求;用模型量化把32位的参数压缩成8位,在不损失太多精度的前提下,让推理速度提升数倍。这些技术的叠加,能让单块GPU的Token产出效率相差好几倍。

但效率的瓶颈也越来越明显:多模态和长程Agent的爆发,让GPU的显存和带宽越来越紧张;企业对实时性的要求,又让延迟成了新的难题。甚至连Token本身的“浪费”都成了问题——冗余的上下文、过长的输出、无效的函数调用,都会让企业的成本凭空增加30%以上。

更重要的是,安全合规正在成为新的门槛。企业把业务数据交给AI,就要求云厂商能守住数据隐私、内容合规的底线,这比单纯的技术优化更考验综合能力。

当我们盯着Token的增长数字时,其实看到的是一场生产力的迁移——从人力驱动,转向AI驱动。云计算的本质,从“给企业搭IT后台”,变成了“给企业装AI引擎”。

未来的云厂商,不再是基建承包商,而是AI能力的运营商。他们比拼的不再是有多少数据中心,而是能把AI的“生产力零件”造得有多快、多便宜、多安全。而对企业来说,Token的消耗规模,终将成为衡量其数字化程度的核心指标。

算力只是基础,Token才是AI时代的硬通货。