对抗知识焦虑,从看懂这条开始

App 下载

25亿砸向机器人:它终于能自主干活了

春晚舞台|自主决策|银河通用|银河星脑|Galbot机器人|具身智能|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

春晚舞台|自主决策|银河通用|银河星脑|Galbot机器人|具身智能|人工智能

2025年春晚的舞台上,一台叫Galbot的机器人没走预设脚本——它自己盘开了核桃,捏起了碎玻璃,把散落的衣服叠成了方块,甚至精准串起了烤肠。所有动作没有提前编程,全靠后台的“银河星脑”实时决策。

这不是一场精心编排的科技秀,而是具身智能——让AI通过物理身体感知、决策并行动的技术——第一次在全国观众面前,证明自己能走出实验室,应对真实世界的混乱。仅仅几个月后,它的开发者银河通用拿到了25亿元融资,投后估值突破200亿。为什么资本和春晚同时押注?答案藏在这台机器人“自主干活”的能力里。

过去的人形机器人,本质是“行为模仿者”——工程师提前写好动作脚本,机器人按顺序执行,换个场景就彻底失灵。比如能在实验室叠衣服的机器人,到了光线不均的客厅,连衣服在哪都找不到。这背后的核心瓶颈,是机器人没有“理解”物理世界的能力,只能依赖训练数据里的固定模式。

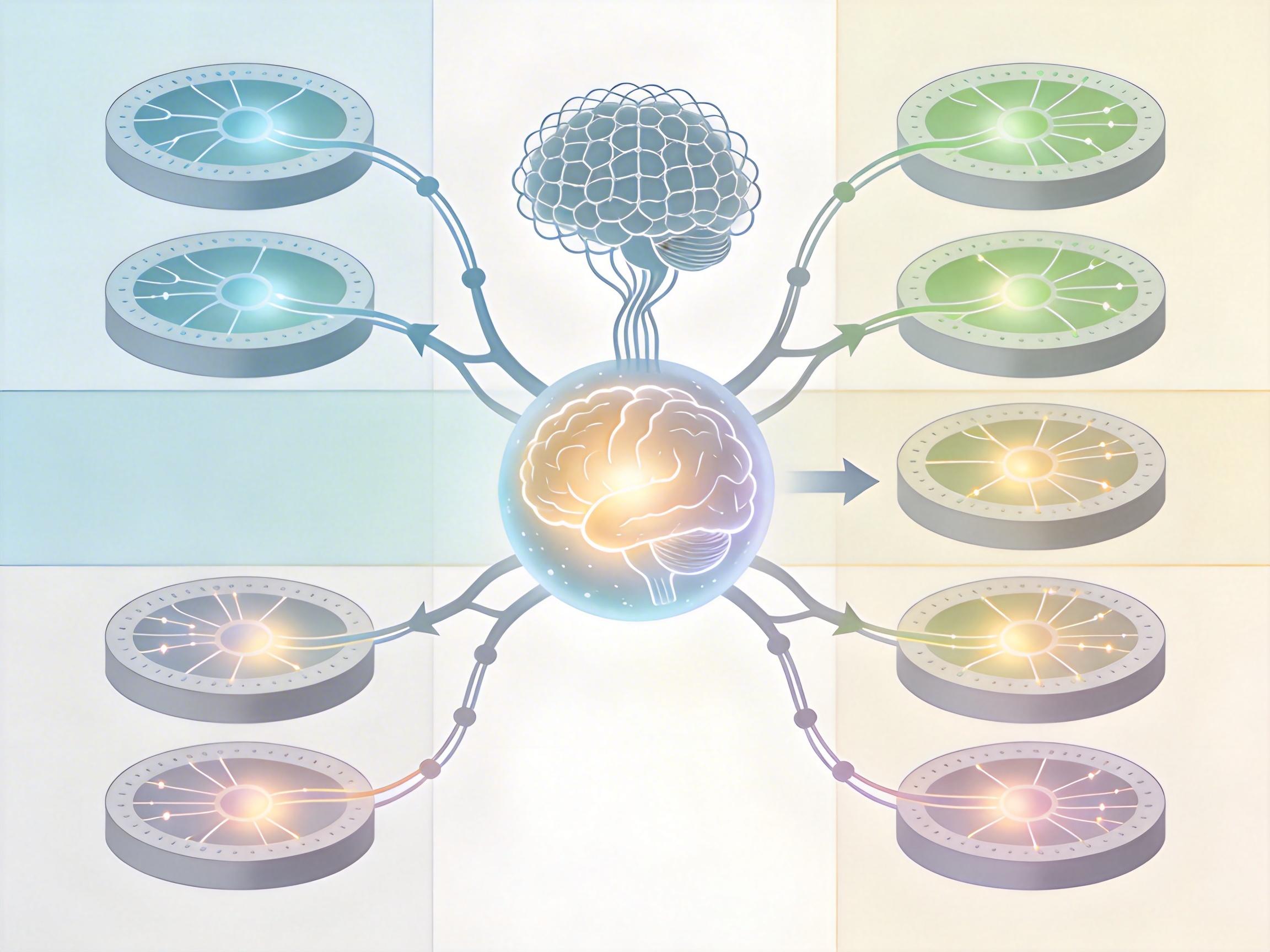

银河通用的“银河星脑”,就是要打破这个“见过才能做”的死循环。这是全球首个集成“大脑-小脑-神经控制”的端到端具身大模型——你可以把它理解为给机器人装了一套完整的“类人神经系统”:大脑层负责理解任务、做决策,比如“用户要我把烤肠串起来”;小脑层负责协调关节、控制力度,比如捏烤肠时不能太用力捏爆;神经控制层则像脊髓,把指令实时传到每一个关节,还能根据触觉、视觉反馈随时调整。

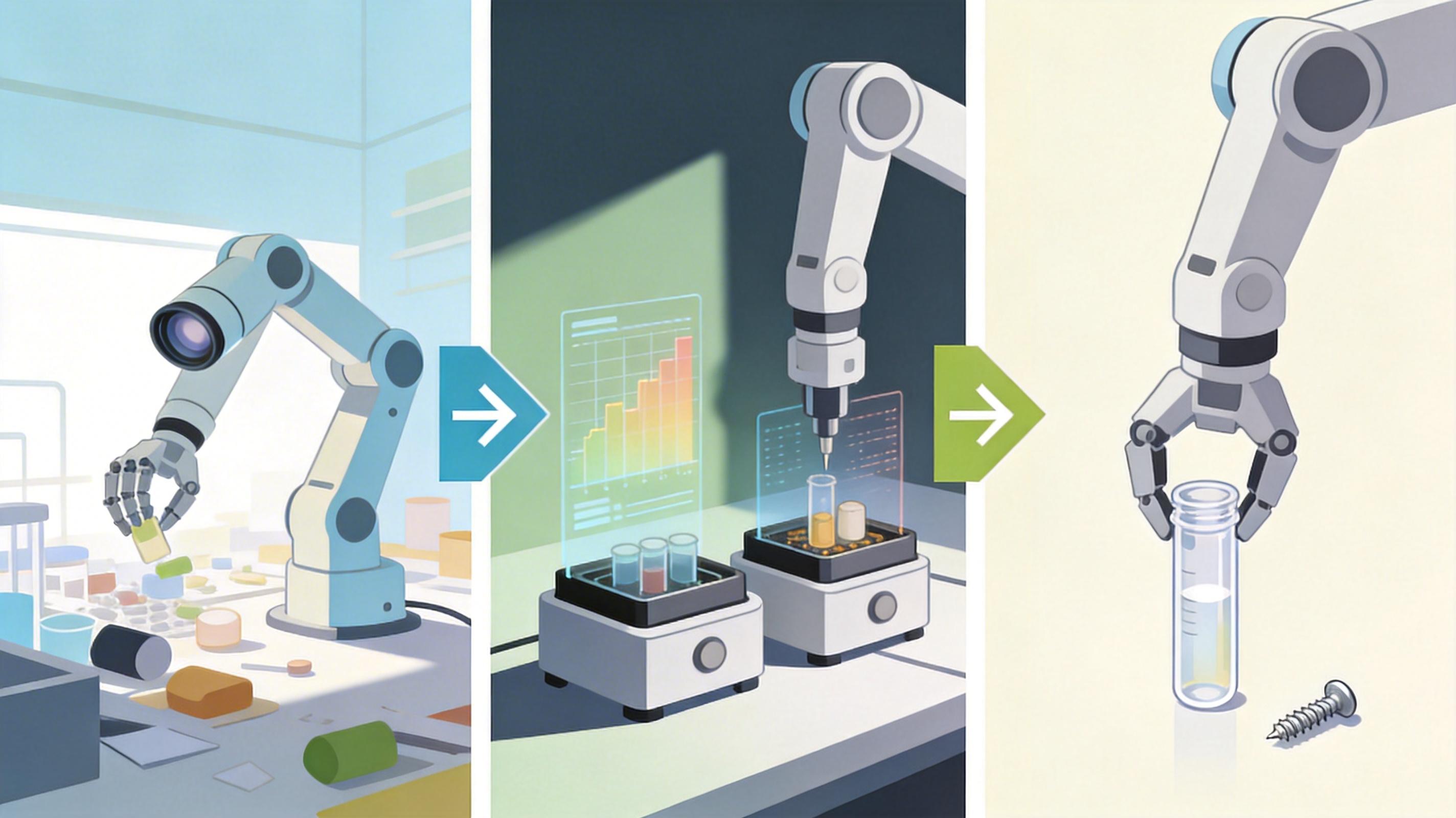

最关键的突破在感知和动作的融合。传统机器人用单目视觉判断物体位置,很容易抓空,银河星脑用了双基座架构:GraspVLA靠十亿帧仿真数据训练,能在强光、阴影、有遮挡的环境里零样本抓取物体,成功率超过OpenVLA等主流模型;StereoVLA引入双目立体视觉,像人眼一样感知深度,终于解决了透明药瓶、细小螺丝这类“盲区物体”的抓取难题——过去机器人面对这些只能瞎碰,现在能精准定位,成功率比行业平均高33个百分点。

要让机器人学会应对真实世界的无限变量,靠真机采集数据根本不现实——光是把一个物体放在不同光照、不同位置、搭配不同干扰物,就能产生上亿种场景,人工采集成本是天文数字。银河通用的解法,是用“虚实融合”的数据集基建,把训练效率拉到了行业的1000倍。

他们打造的“银河星坊”,是一个高精度物理仿真系统。在这个虚拟世界里,系统可以随机生成物体、调整光照、添加干扰,一周就能生成十亿帧机器人抓取轨迹数据。机器人先在虚拟世界里“遍历”所有极端场景,比如在摇晃的船上抓杯子、在堆满杂物的地上找零件,再用极少量真机数据做“校准”,就能把虚拟训练的能力迁移到现实中。

这种思路的优势,在工业场景里体现得淋漓尽致。宁德时代的电池工厂里,粉尘大、温度波动强,还有重型设备频繁经过,环境比实验室复杂100倍。银河通用的Galbot S1机器人在这里不需要人工干预,能自主搬运50公斤的电池模组,在震动的产线上精准完成装配。它是目前唯一能进入宁德时代真实产线持续作业的人形机器人,而宁德时代不仅是它的客户,更是股东——制造业巨头不为概念买单,只会为能降本增效的真实能力付费。

当中国企业在场景落地和数据基建上狂奔时,全球具身智能赛道正呈现出三条截然不同的路线。

美国的Figure、特斯拉等公司,走的是“算法优先”的路线,聚焦底层大模型的突破,试图让机器人先拥有强大的认知能力,再考虑落地。但这种思路的问题在于,实验室里的算法到了真实场景往往水土不服——特斯拉的Optimus至今还主要在自家工厂做搬运,Figure的机器人演示也多在封闭实验室里,商业化落地还需要时间。

欧洲则把“安全合规”放在第一位,用严格的法规框定机器人的行为,比如要求机器人的动作必须可解释、可追溯,避免对人类造成伤害。这种思路让欧洲机器人在医疗、协作场景里有优势,但也限制了技术迭代的速度。

中国的路线,是“场景驱动”——先找真实需求,再用数据和工程能力快速迭代。银河通用的机器人从工厂走到药店,再走到街头的“银河太空舱”,每一步都在解决具体问题:在药店24小时值守卖药,解决夜间购药难;在景区自主导航,给游客指路、递水。这种“用中学”的模式,让中国机器人的泛化能力和落地速度,已经走在了全球前列。

当我们谈论具身智能时,其实在谈论一个更本质的问题:AI到底是只能在屏幕里回答问题的“工具”,还是能走进物理世界帮我们干活的“伙伴”?

银河通用的25亿融资,不是资本对“人形机器人”概念的追捧,而是对“AI能解决真实问题”的下注。它的机器人能在工厂里搬电池,能在药店里抓药,能在街头应对人流——这些看起来琐碎的能力,正在一点点把AI从虚拟世界拉进现实。

智能的终极形态,从来都不只是思考,更是行动。 未来的物理智能社会,不会是机器人像人一样跳舞,而是机器人像人一样,能在复杂、混乱的真实世界里,稳稳地把活干完。