对抗知识焦虑,从看懂这条开始

App 下载

AI司机重大突破:理想汽车如何破解“知行合一”难题?

车辆动作|语言指令|LinkVLA模型|浙江大学|理想汽车|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

车辆动作|语言指令|LinkVLA模型|浙江大学|理想汽车|自动驾驶|人工智能

在复杂的十字路口,人类司机凭直觉就能完成一系列微操:稍稍减速,观察侧方来车,预判行人轨迹,然后平稳地左转。这套“眼到、心到、手到”的动作一气呵成。然而,对于自动驾驶AI而言,这曾是一个难以逾越的鸿沟。它们或许能“听懂”指令,比如“在路口左转”,但“身体”却常常不听使唤,导致动作僵硬、犹豫甚至出错。这种大脑与车轮的“鸡同鸭讲”,正是阻碍高阶自动驾驶落地的核心壁垒。

然而,这一困境正被悄然打破。理想汽车与浙江大学的研究团队联手发布了一款名为LinkVLA的全新模型,直击自动驾驶中语言指令与车辆动作严重错位的痛点,为AI司机实现真正的“知行合一”提供了革命性的解决方案。

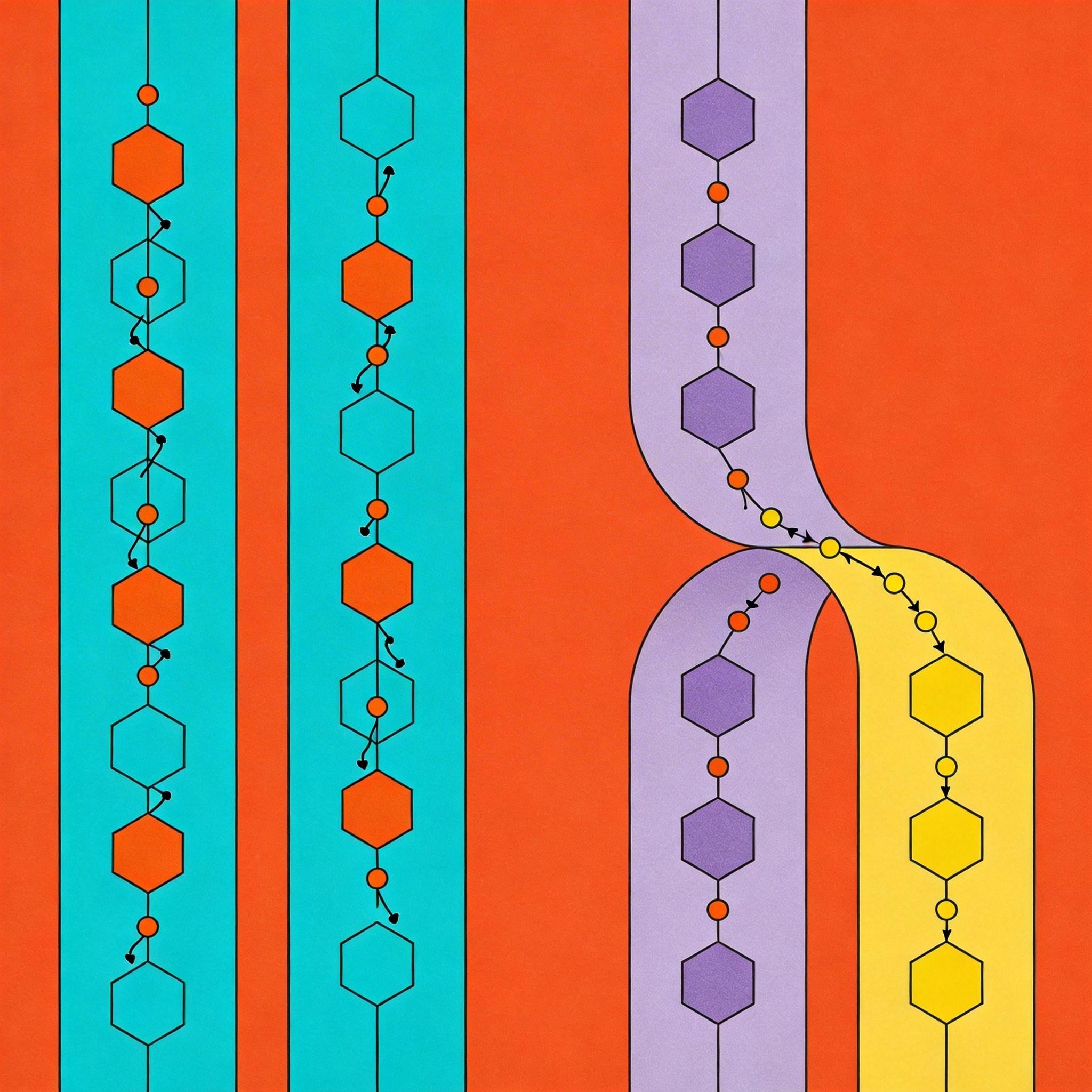

过去的自动驾驶模型,语言系统和动作系统仿佛说着两种不同的方言。语言指令被大语言模型(LLM)的文本词汇表处理,而车辆的行驶轨迹则是另一套连续的坐标数据。两者之间的转换极易产生偏差,导致“听懂了,但做不到”的尴尬局面。

LinkVLA的破解之道,在于其三大环环相扣的创新设计:

第二法宝:双向对齐,建立“心领神会” 仅仅统一语言还不够,还需要确保双方能真正理解彼此的意图。LinkVLA借鉴了图像生成领域的深刻洞见:一个既能“看文作画”又能“看画写诗”的AI,才算真正理解了图文关系。同样,LinkVLA在训练时引入了双向任务:

第三法宝:粗细结合,实现“闪电反应” 解决了“准不准”的问题,还有一个“快不快”的挑战。传统模型生成一条包含30个路径点的轨迹,需要模型串行计算30次,反应速度难以满足瞬息万变的真实路况。LinkVLA的方案堪称优雅:化繁为简,两步并行。

在自动驾驶领域权威的CARLA仿真平台闭环评测中,LinkVLA的“三大法宝”展现出惊人威力。

指令跟随能力:在专门的指令跟随测试中,LinkVLA的成功率高达87.16%,远超传统模型的70%。尤其在“加速”、“变道”等具体指令上,展现出极高的准确性。

综合驾驶性能:其驾驶综合得分达到91.01,成功率74.55%,全面超越了此前所有的顶尖模型,无论是在变道、超车还是紧急制动等交互场景中,都表现出了近乎完美的处理能力。

推理效率:这是最令人瞩目的数据之一。开启“粗到细”生成策略后,LinkVLA的单步推理延迟从361毫秒骤降至48毫秒,加速效果高达86%!这意味着它在性能远超对手的同时,反应速度还更快,真正实现了高性能与低延迟的平衡,迈过了车载实时应用的门槛。

LinkVLA的出现并非孤例,它代表了整个自动驾驶行业的技术演进方向——视觉-语言-动作(VLA)一体化。从特斯拉FSD v12的端到端神经网络,到Wayve的LINGO系列,再到小鹏、蔚来等国内厂商纷纷布局的“世界模型”和“司机大模型”,行业共识正在形成:单纯依赖规则或模块化设计的系统已触及天花板,只有让AI像人一样,将视觉感知、语言理解和动作执行在一个统一的框架内融合思考,才能应对无限复杂的真实世界交通。

VLA模型的核心价值,在于它为自动驾驶装上了一个具备常识推理能力的“大脑”。它不再是机械执行代码的程序,而是能够理解模糊指令、预判他人意图、并用更拟人化的方式在道路上博弈的智能体。

尽管VLA模型取得了巨大突破,但通往完全自动驾驶的道路依然充满挑战。首当其冲的是数据难题。模型性能的提升高度依赖海量、高质量、多样化的真实驾驶数据,尤其是那些难以采集的“长尾场景”(Corner Cases),如偶遇的道路施工、异常的交通参与者行为等。如何高效地获取并利用这些数据,是所有玩家面临的共同课题。

其次是安全验证。当决策过程被整合进一个端到端的“黑箱”模型中时,如何保证其决策的绝对安全、可解释和可预测,成为一个严峻的工程和伦理问题。这不仅需要更先进的仿真测试技术,也对行业法规和标准提出了新的要求。

此外,行业内部也存在着VLA与“世界模型”的技术路线之辩。VLA更侧重于通过语言的抽象推理来连接感知与动作,而“世界模型”则致力于在模型内部构建一个可推演的物理世界模拟器。两者并非完全对立,未来很可能走向深度融合:VLA作为理解意图、进行高层规划的“大脑”,而世界模型则作为验证物理规律、确保动作安全的“小脑”。

LinkVLA的诞生,如同一块关键的拼图,让我们清晰地看到了自动驾驶“知行合一”的实现路径。这不仅是一次算法的胜利,更是一场关于机器智能如何理解并行动于物理世界的深刻变革。当AI司机真正学会了思考,那个人类可以完全放开方向盘的时代,或许已不再遥远。