对抗知识焦虑,从看懂这条开始

App 下载

给大模型装推理GPS,盲猜变精准导航

思维链|推理优化|梯度下降|∇-Reasoner|德克萨斯大学奥斯汀分校|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

思维链|推理优化|梯度下降|∇-Reasoner|德克萨斯大学奥斯汀分校|大语言模型|人工智能

你有没有过这种经历:问大模型一道数学题,它给了三个答案,两个错得离谱,一个蒙对了——像极了闭着眼在迷宫里乱撞。过去两年,我们给大模型加了思维链、思维树,甚至让它生成一堆答案投票选最优,但本质上都是「盲猜+试错」:模型只知道「这个答案好不好」,永远不知道「怎么改才能更好」。直到德克萨斯大学奥斯汀分校的团队捅破了这层窗户纸:训练时用来精准调参的梯度下降,为什么不能直接搬到推理时用?∇-Reasoner就这么来了——它给大模型的推理过程装了实时GPS,每走一步都能收到「往哪改更对」的明确指令。

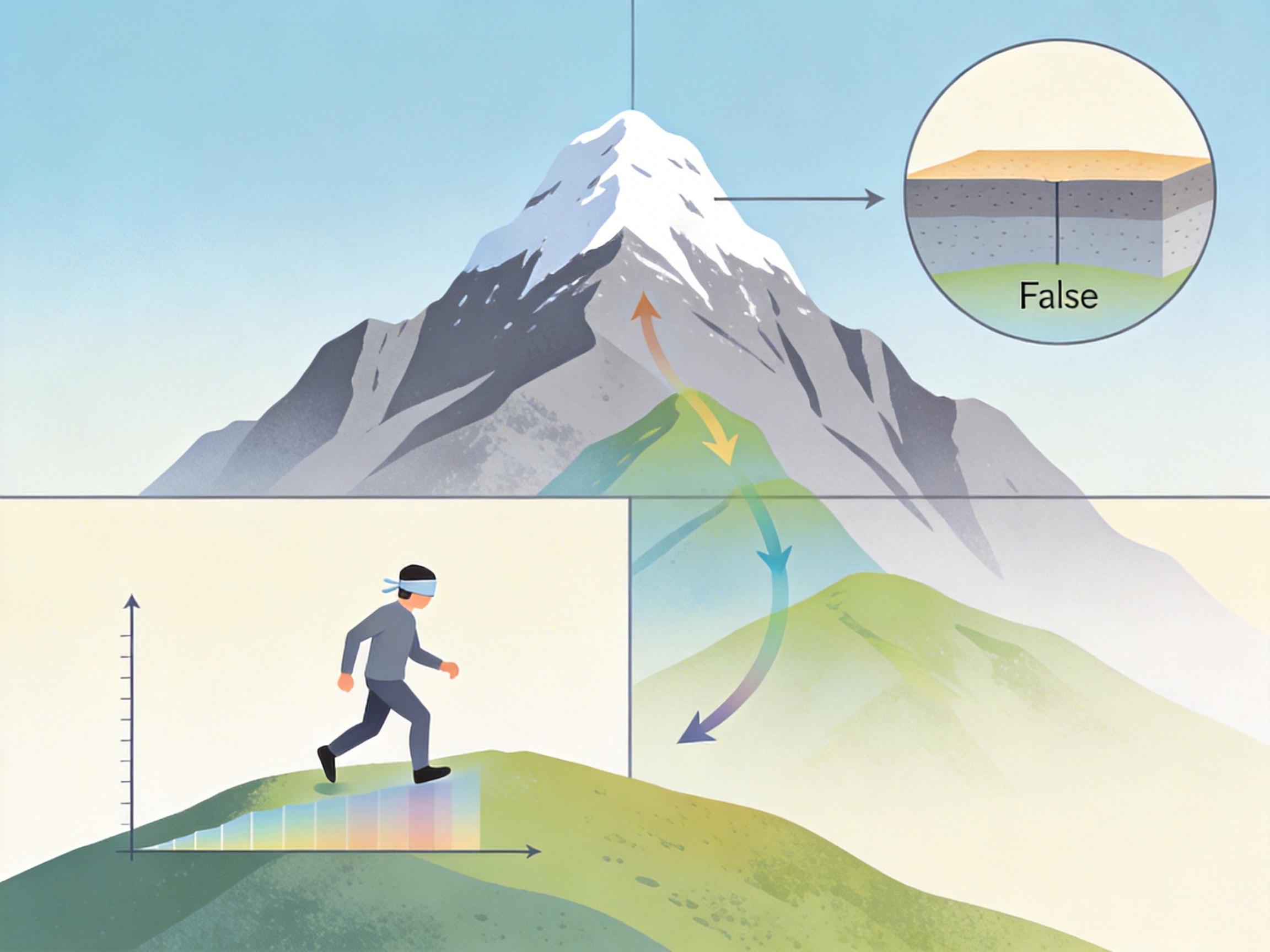

你可以把大模型的推理想象成在一座「奖励山」上找最高峰:传统方法是蒙着眼睛乱走,每踩一步就摸一摸脚下的高度(奖励分数),运气好能摸到山顶,运气不好就困在半山腰的土坡上——这就是零阶优化,只看结果,不问方向。

∇-Reasoner的核心是把一阶优化搬上了山。它不再让模型瞎试,而是用奖励模型算出每一步的「梯度」——也就是「往哪个方向走,海拔会涨得最快」。比如解「2x+3=7」时,模型先写「我们首先将3」,奖励模型给了低分,梯度会直接告诉它:把「将3」改成「移项」或者「减去3」,分数会更高。

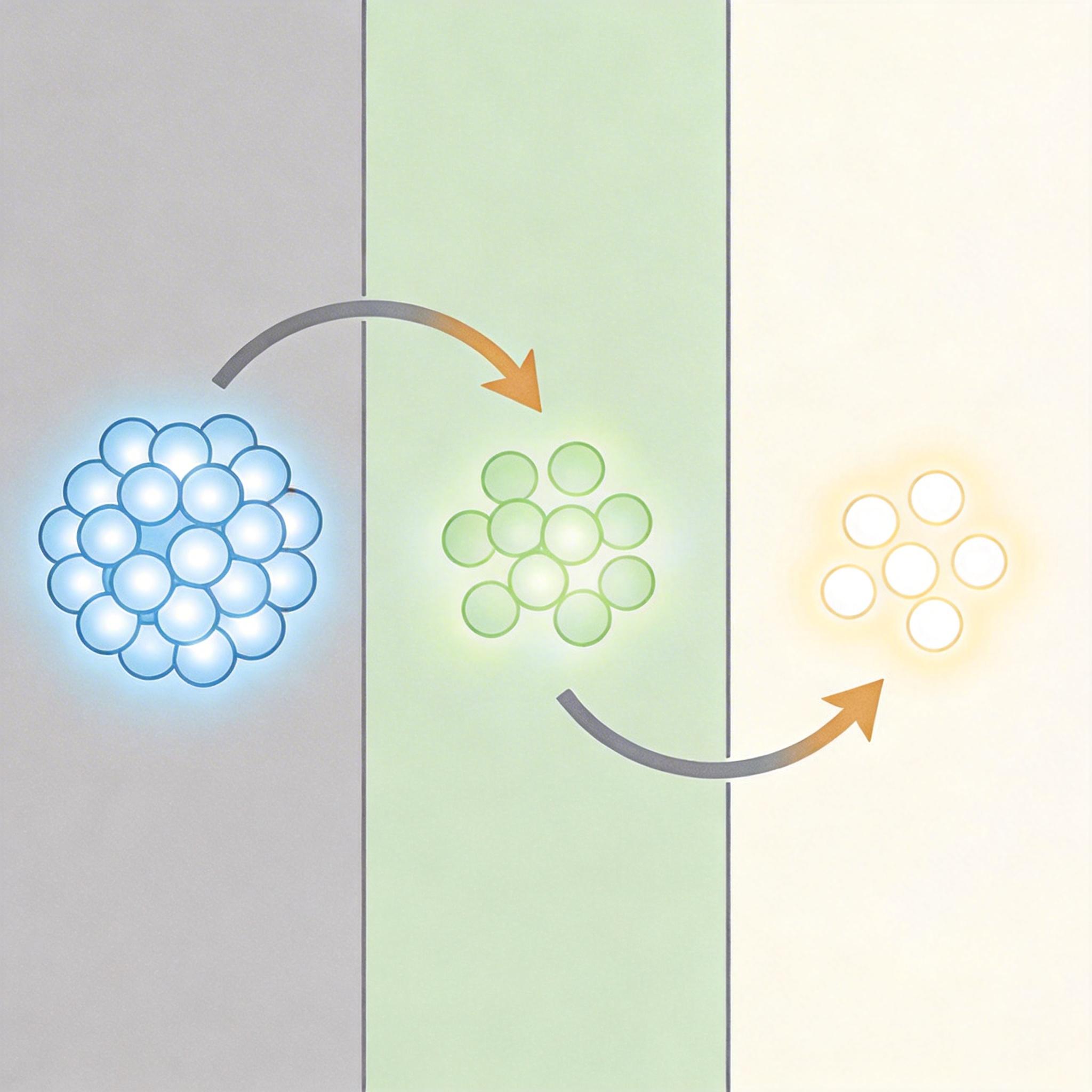

这背后的关键是「可微文本优化」(DTO)——一个把离散文本变成连续变量的魔术。你没法直接对「苹果」这个词求梯度,但可以优化它背后的「倾向性分数」(logits)。用Gumbel-Softmax直通估计器,前向传播时输出确定的词,反向传播时假装选择是连续的,这样梯度就能顺着分数流回模型,指导下一次生成。

简单说,传统方法是写完一整篇作文才给批改,DTO是老师在你写每个词时就实时说:「这个词换一下,整句话会更对」。

听起来每一步都要算梯度,计算量岂不是要爆炸?∇-Reasoner的作者们早想到了这点,用三个妙招把成本压到了比传统方法还低。

第一个妙招是「梯度缓存」。计算梯度最耗时的是前向和反向传播,但很多时候模型选的词不会变,这时候就可以把之前算好的梯度存起来复用,不用每次都重新跑一遍——相当于老师不会重复讲同一道题。

第二个是「轨迹复用」。本来每确定一个词,都要重新生成完整的后续草稿来优化,现在如果这个词被接受,上一次生成的草稿直接就能当下次优化的起点,还设置了最多8条轨迹的上限,避免无限纠结。

第三个是「智能令牌选择」。不是每个词都值得优化:如果模型对某个词特别有把握(logits熵很低),或者梯度信号特别弱,就直接跳过,不用浪费算力——就像老师只会重点辅导拿不准的学生,好学生就让他自己发挥。

这三板斧下来,∇-Reasoner在数学推理任务上准确率提升超过20%,模型调用次数反而减少了10%-40%。在MATH-500、AIME这些硬核数学基准上,它甚至追上了需要全参数微调的强化学习方法。

但我必须泼一盆冷水:∇-Reasoner的所有优势,都建立在「奖励模型足够靠谱」的基础上。

梯度是奖励模型给的,如果奖励模型本身有偏见——比如偏爱长答案、偏爱特定句式,甚至对某些错误视而不见——那梯度指引的方向就会完全跑偏。之前就有研究发现,奖励模型会学人类标注里的长度偏差,导致模型为了拿高分故意写冗长的废话,这就是「奖励黑客」。

更麻烦的是,目前的奖励模型大多只在数学、代码这类有明确对错的任务上好用,换到开放域对话、创意写作这种没有标准答案的场景,连「什么是好答案」都定义不清,更别说算梯度了。∇-Reasoner能让大模型在迷宫里精准找路,但如果地图本身画错了,再精准的导航也没用。

而且就算奖励模型没问题,∇-Reasoner的计算量还是比贪心解码高得多,实时对话这种对延迟敏感的场景,暂时还没法用。它更适合那些对精度要求极高、能接受一点延迟的场景——比如高级数学辅导、代码审核,而不是你手机里的聊天机器人。

∇-Reasoner最有意思的地方,是它打破了「训练」和「推理」的边界。过去我们默认,训练是一次性给模型植入能力,推理是让模型用这些能力干活;现在它证明,推理时也能像训练一样精准调优,而且不用动模型的权重。

这就像给了每个问题一个专属的「临时微调」——不用为了一道数学题,把整个模型重新训一遍。这种「样本级特调」的思路,可能才是未来大模型推理的核心:不用追求一个能解决所有问题的完美模型,而是给模型一个能针对每个问题实时优化的工具。

「推理不是用完即弃的一次性输出,而是可动态优化的过程。」当我们不再把大模型当一个只会吐答案的黑箱,而是一个能实时调整的协作伙伴,真正的通用AI可能才会离我们更近。