对抗知识焦虑,从看懂这条开始

App 下载

AI能解题却分不清对错,斯坦福团队补上关键短板

编程题评测|AI自我验证|Terminal-Bench|LLM-as-a-Verifier框架|斯坦福团队|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

编程题评测|AI自我验证|Terminal-Bench|LLM-as-a-Verifier框架|斯坦福团队|大语言模型|人工智能

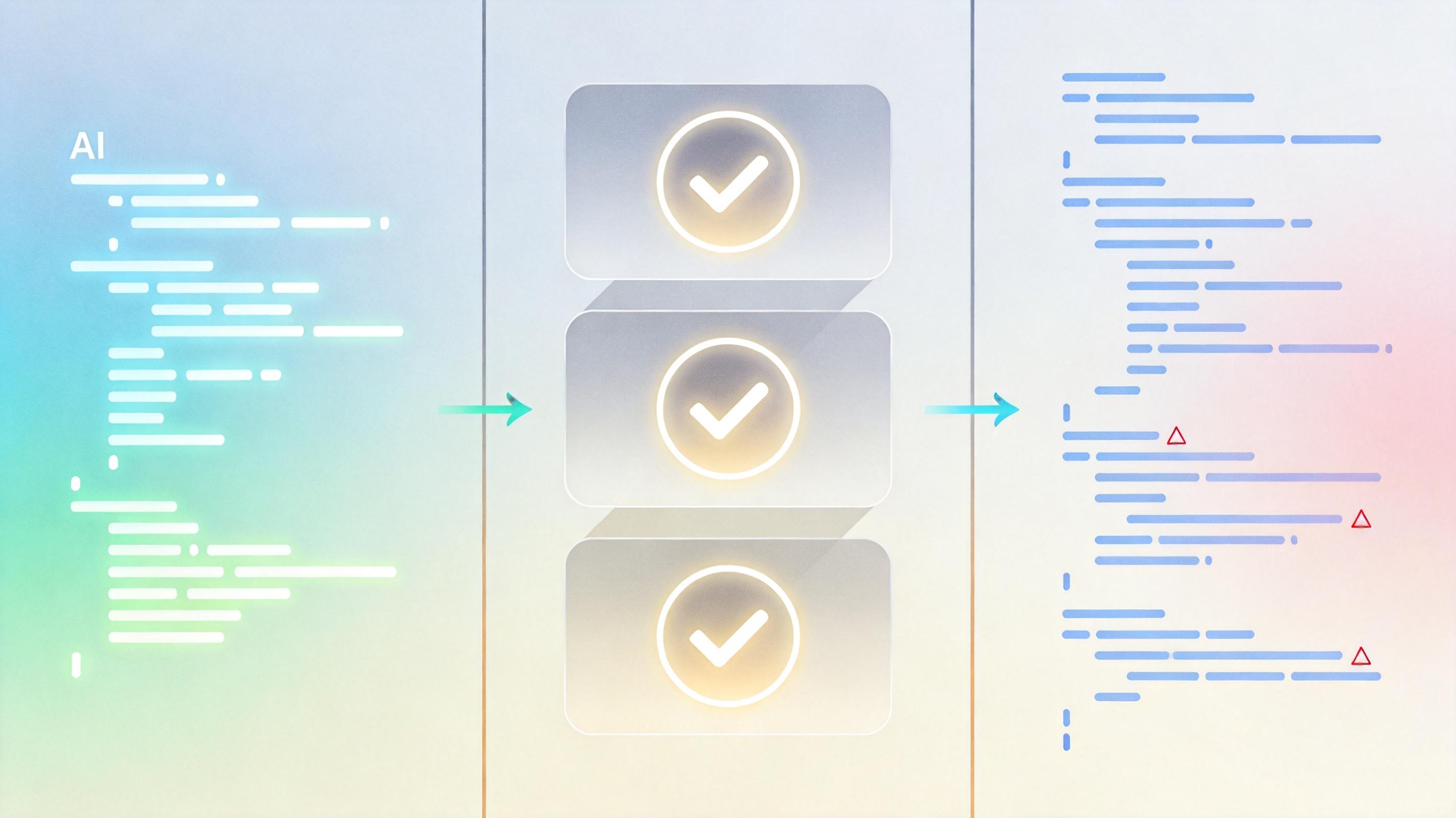

想象一下:让AI连续100次解同一道编程题,它总有一次能写出正确答案——但转头就把这100份答案混在一起,根本不知道哪份才对。这种「能解决问题,却认不出正确结果」的尴尬,正是当下AI智能体在复杂任务里的致命缺陷。

2026年4月,斯坦福、伯克利与英伟达联手推出的LLM-as-a-Verifier框架,把这个难题解决了。它不仅在顶级编程基准Terminal-Bench上超越了GPT-5.5和Claude Mythos,还彻底消除了AI评分里的「平局」困境。更关键的是,它没有给AI加新能力,只是教会了AI一件事:怎么自己当自己的「质检员」。

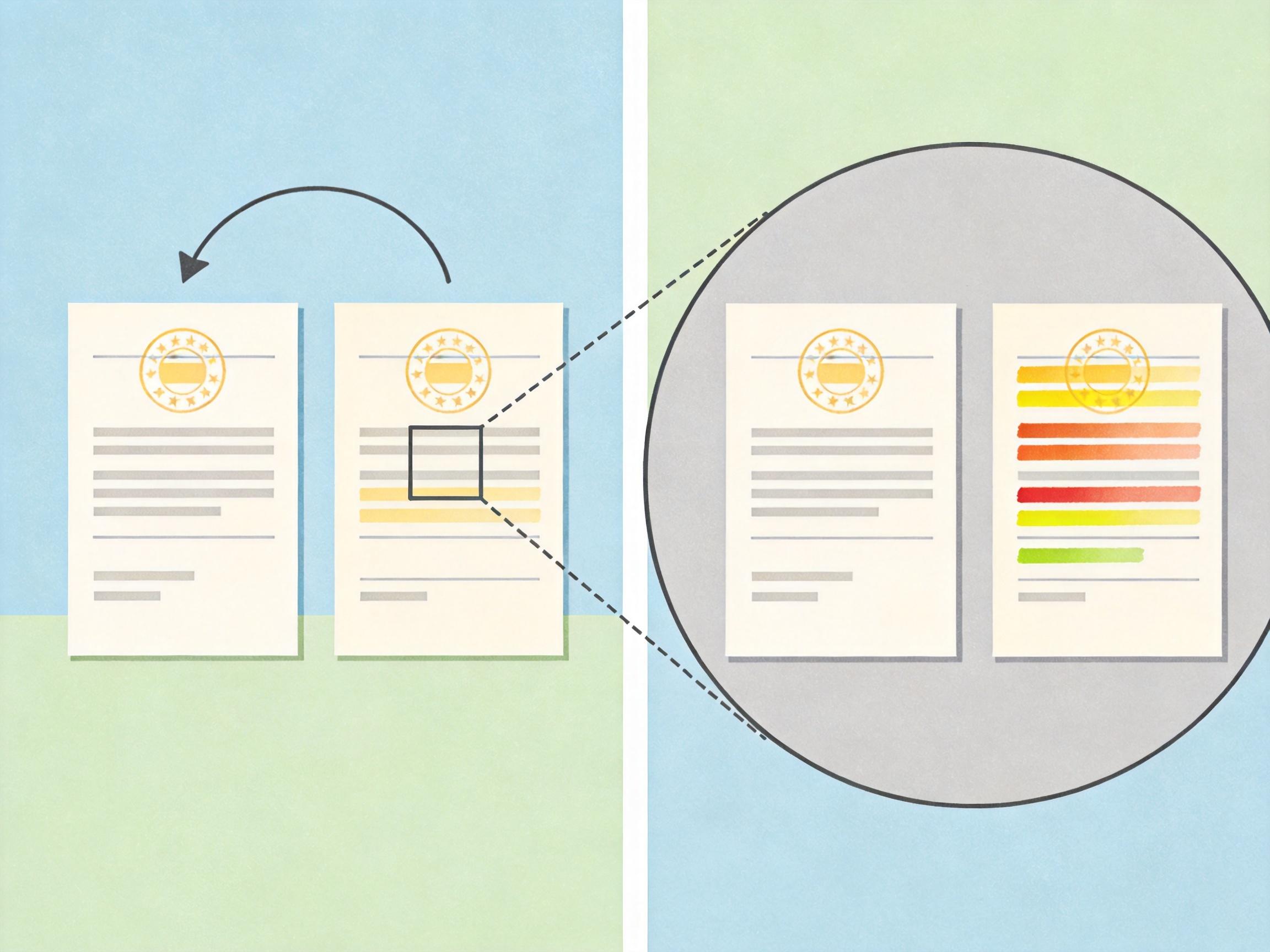

过去我们用AI当裁判(LLM-as-a-Judge),就像让老师给试卷打1-8分的整体分——两道水平有差的题,可能都拿到4分,最后变成「平局」。在Terminal-Bench上,这种粗粒度评分的平局率高达27%,相当于每4道题里就有1道,AI根本分不出好坏。

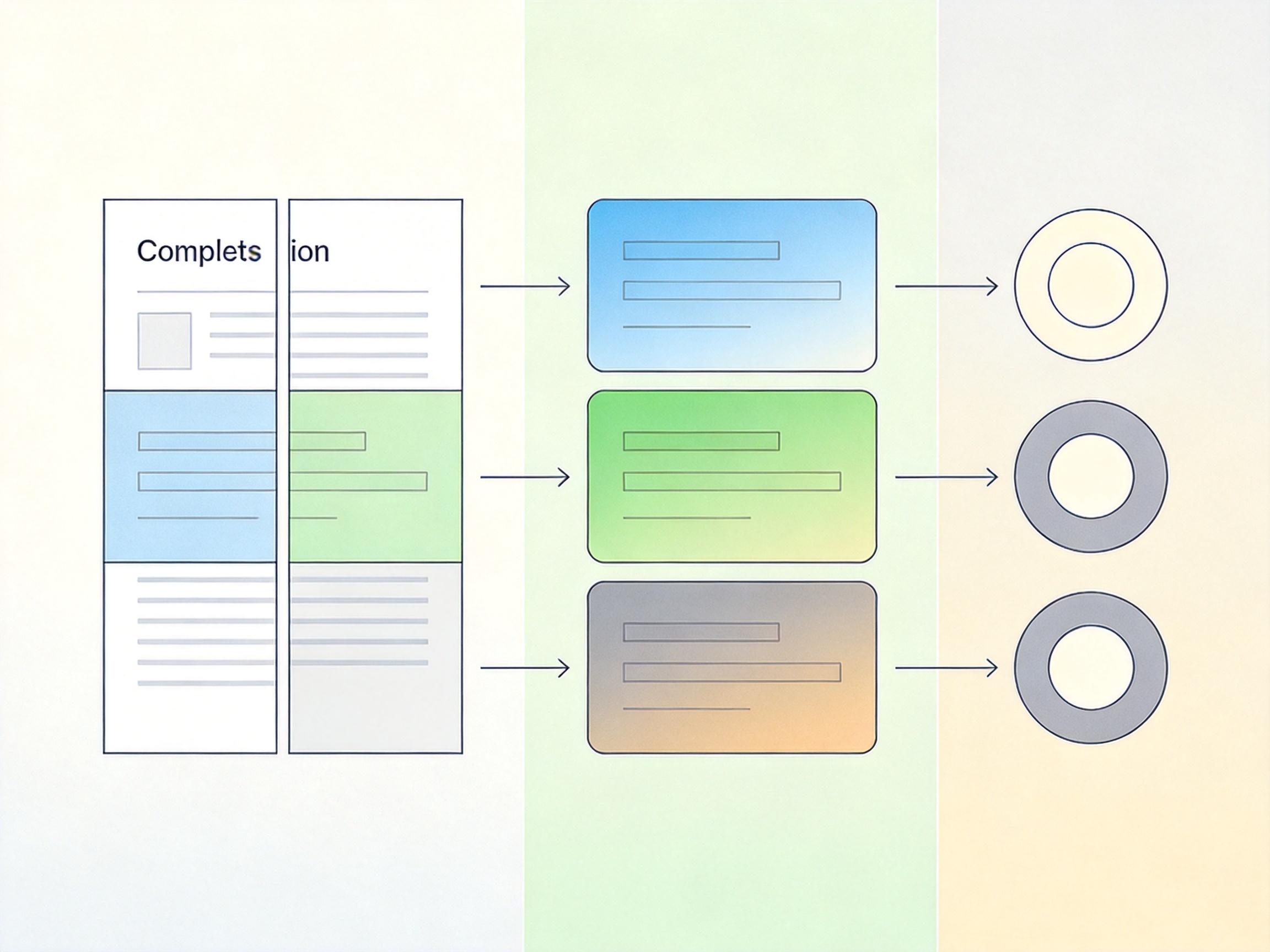

而LLM-as-a-Verifier做的,是把「打整体分」改成了「逐项质检」。它的核心是三个维度的升级:

首先是把评分标尺拉到最细——从1-8分的粗刻度,改成20级的精细评分token,每一级的差异都能被精准捕捉。团队发现,随着评分粒度提升,正确答案和错误答案的得分差距会被越拉越大,再也不会模棱两可。

其次是反复核验——对同一份答案验证多次,就像让三个质检员分别检查同一件产品,用多次结果的平均值减少偶然误差。实验里把验证次数从1次提升到16次,验证准确率直接跳涨了7个百分点。

最后是拆分解读评分标准——不再只看「结果对不对」,而是分成三个维度单独打分:有没有符合任务规范、输出格式对不对、内容里有没有事实或逻辑错误。就像改作文时,分别看审题、格式和内容,每一项都有明确的判断依据。

最终,AI会给每一份答案算出一个基于概率的「综合奖励分」,再用「循环赛」的方式两两比较所有答案——胜场最多的那个,就是最终的正确结果。

这套方法的聪明之处在于,它没有试图提升AI「解题」的能力,而是激活了AI原本就有的「判断」潜力。研究团队发现,大多数AI智能体其实「具备」解决复杂问题的能力——只要让它多试几次,总能蒙对一次,但它缺的是「从一堆答案里挑出对的那个」的本事。

在Terminal-Bench 2.0上,LLM-as-a-Verifier把ForgeCode的验证准确率拉到了86.4%,比传统方法高出近5个百分点;在SWE-Bench Verified上,它也拿到了77.8%的当前最优成绩。更重要的是,它彻底消灭了「平局」——每一份答案的好坏都能被精准区分。

但它也不是没有局限。这套方法的核心是「堆验证计算量」:评分越细、验证次数越多,结果就越准,但对应的计算成本也会直线上升。比如做16次重复验证,相当于要让AI多跑15次推理,对算力的要求翻了好几倍。

还有一个容易被忽略的问题:AI验证器也会有「自我偏见」——它会更倾向于认可和自己生成风格相似的答案。研究发现,用不同模型家族的AI当验证器,比如用Claude去验证GPT的答案,能有效减少这种偏见,但这又会进一步增加成本和复杂度。

对企业来说,LLM-as-a-Verifier的最大价值,是补上了AI智能体落地的「可靠性短板」。过去很多企业不敢把AI用在编程、系统管理这类复杂任务里,不是怕AI不会做,而是怕AI「瞎做了还觉得自己对」——比如生成的代码有隐蔽bug,AI自己却判断它是对的,最后导致系统崩溃。

现在有了这套验证框架,AI生成的每一份代码、每一个决策,都能被反复核验、多维打分,错误的概率被降到了最低。比如在基础设施即代码(IaC)生成场景,AI生成的配置文件会先经过验证器的「合规性+格式+错误」三维检查,确保不会出现资源浪费或安全漏洞。

团队已经把所有代码和数据开源在GitHub上,任何人都能直接用这套框架改造自己的AI智能体。这种开放的模式,也让更多开发者能参与进来,解决它的成本问题——比如用更小的模型做初步筛选,再用大模型做精细验证,在准确率和成本之间找平衡。

当我们还在追求「让AI更聪明」的时候,斯坦福的团队先把「让AI更靠谱」这件事做到了极致。LLM-as-a-Verifier的本质,不是给AI加了新能力,而是给AI装了一个「刹车」——它让AI在输出结果前,先自己把一遍关,确保每一步都走得稳。

智能的终极形态,从来不是无所不能,而是知错能辨。

未来AI的竞争,可能不再是比谁能解决更难的问题,而是比谁能更精准地判断自己的答案对不对。毕竟,在真实世界里,靠谱比聪明更重要。