对抗知识焦虑,从看懂这条开始

App 下载

AI替CEO管公司,靠的是AI盯AI

智能代理系统|企业流程自动化|Pedro Franceschi|OpenClaw|Brex|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

智能代理系统|企业流程自动化|Pedro Franceschi|OpenClaw|Brex|AI智能体|人工智能

当大部分企业还在试探AI客服的边界时,金融科技公司Brex已经让AI接管了CEO的日常:筛选上千条Slack消息、生成会议行动项、跟进任务执行,甚至自动完成招聘简历的造假核查。创始人Pedro Franceschi直接用“AI运行整个公司”来形容这套系统。但没人敢把公司交给一个“黑箱”——这套能替代人类管理者的AI系统,到底是怎么保证自己不“失控”的?

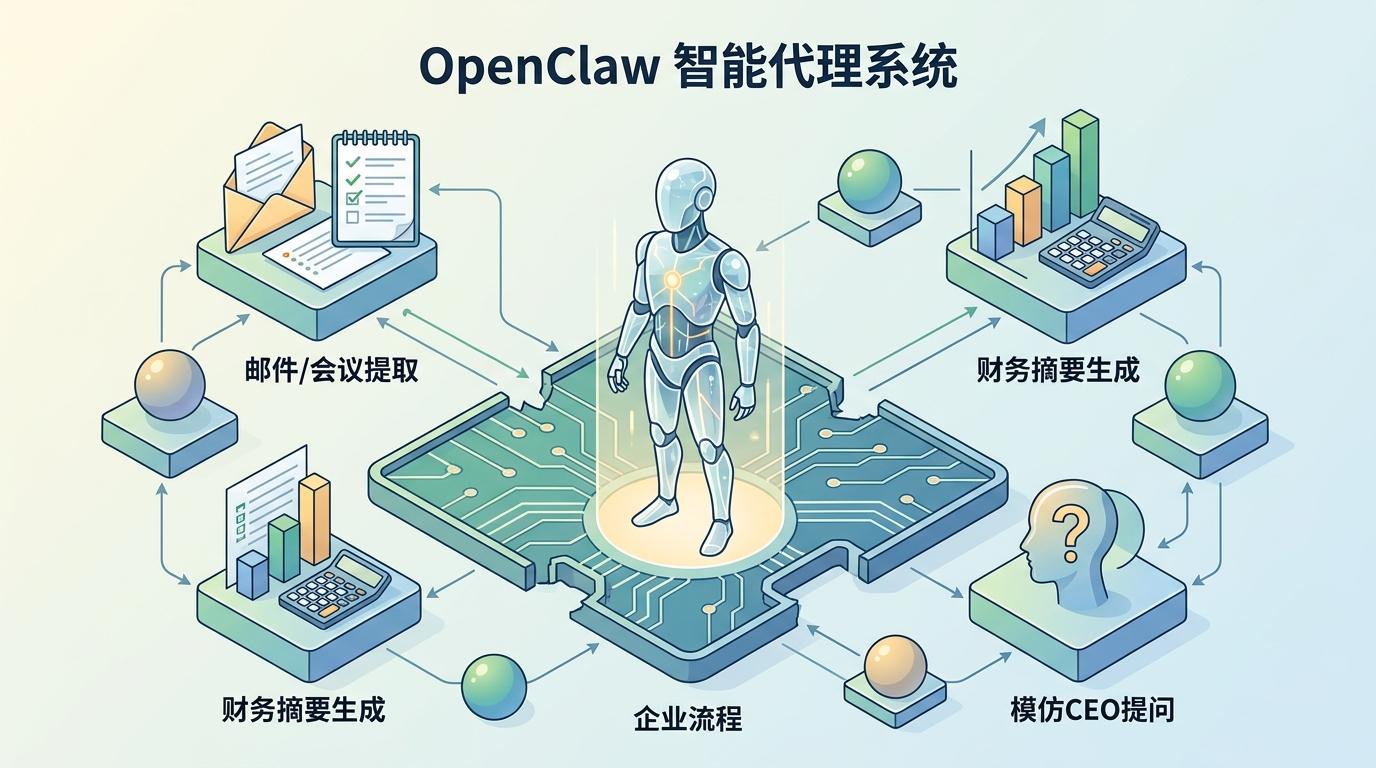

Brex的这套AI系统核心是OpenClaw,一个能像人类员工一样嵌入企业流程的智能代理(AI Agent)。它不是单一的聊天机器人,而是由几十个模块化的“技能组件”拼接而成:有的负责从邮件和会议纪要里提取行动项,有的能根据财务数据生成CFO级别的摘要,还有的专门模仿CEO的提问逻辑——“核心目标是什么?瓶颈在哪?为什么不够快?”

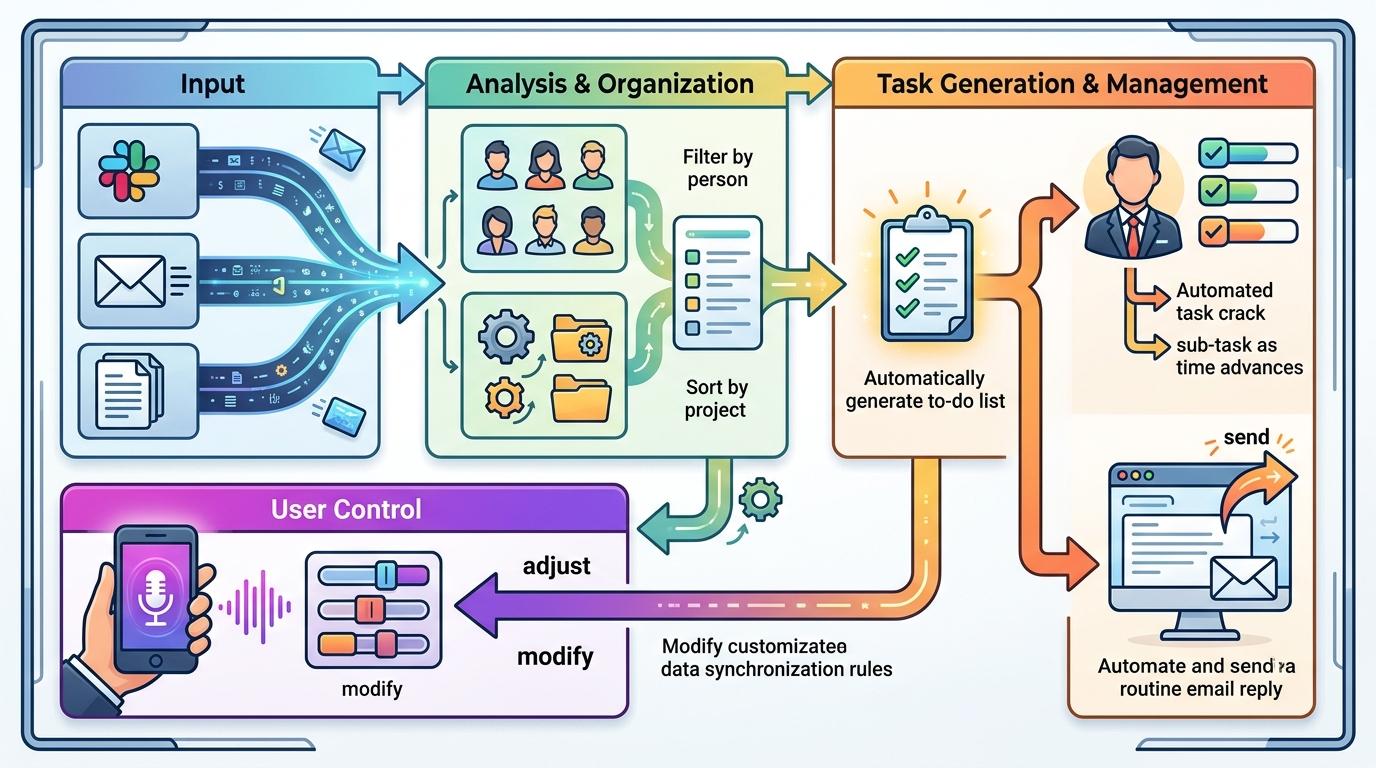

这些组件像乐高积木一样组合,就能复现管理者的完整工作流:系统先从Slack、邮箱、文档等所有数据源里抓取信息,再按“人”和“项目”两个维度筛选出关键信号,自动生成待办清单后,还会替CEO跟进任务进度,甚至直接回复常规邮件。最关键的是,这套系统不需要写复杂代码,用户用语音指令就能调整组件功能,比如在通勤路上就能修改数据同步规则。

这种模块化设计解决了企业AI的核心痛点:传统自动化工具只能处理单一重复任务,而AI Agent能像人类一样处理“模糊”的复杂工作——比如判断简历是否造假、识别财务支出的异常,甚至根据员工的沟通风格调整管理方式。

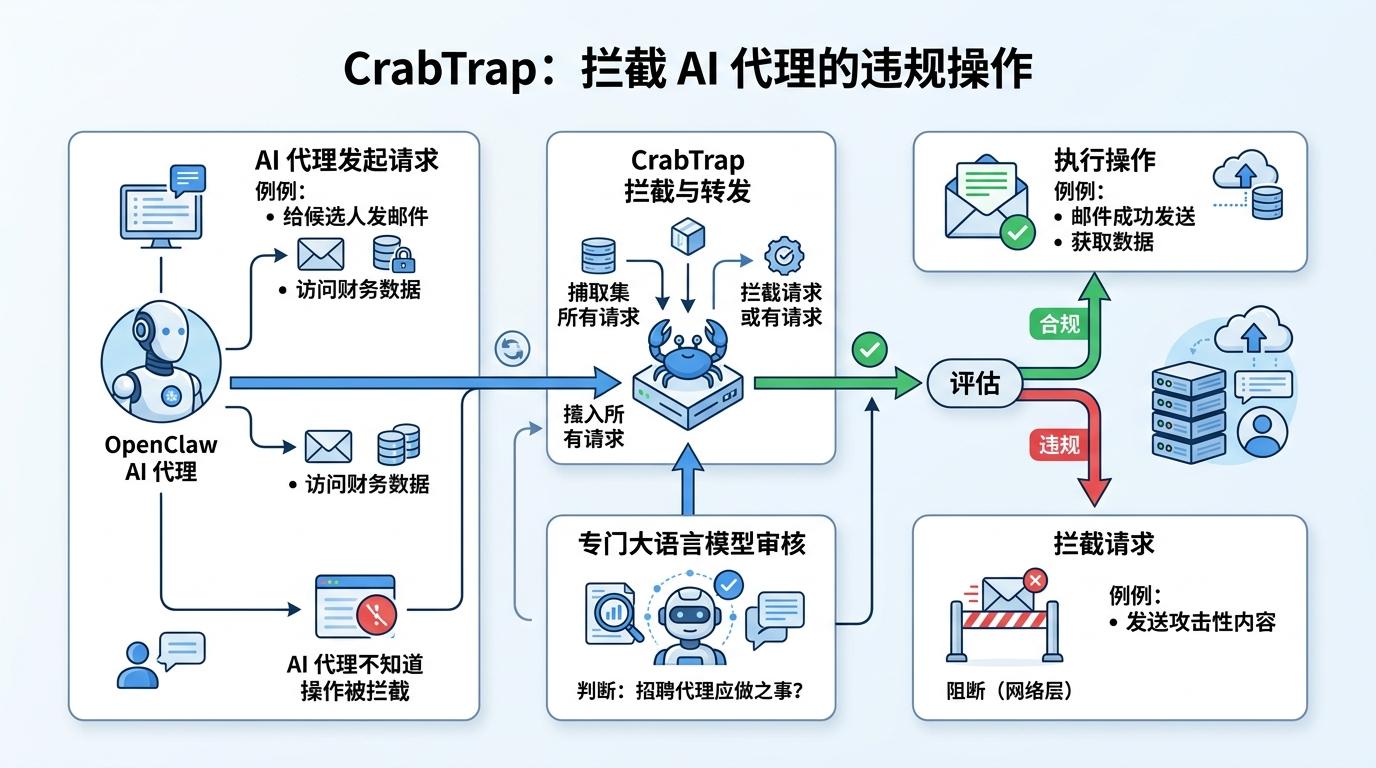

没人会放心把公司交给一个可能“胡说八道”的AI。Brex的解法不是让人类盯着屏幕审核每一个操作,而是用另一套AI系统当“监督员”——他们把这套监督系统命名为CrabTrap,一个开源的HTTP代理工具。

当OpenClaw的AI代理要执行任何操作,比如给候选人发邮件、访问财务数据,所有请求都会先被CrabTrap拦截,转发给另一个专门的大语言模型审核:“这是一个招聘代理该做的事吗?”如果模型判断操作违规——比如发送带有攻击性的内容,就会直接在网络层阻断请求,而执行操作的AI代理甚至不知道自己的动作被拦截了。

这种“AI监督AI”的模式,本质是用AI的速度对抗AI的风险。传统的人工审核无法跟上AI代理的实时操作速度,而专门的监督模型能在毫秒级完成判断,还能根据企业规则动态调整审核标准。不过Brex也没有完全放手,他们只在非核心工作流中部署了这套系统,关键决策仍然保留人工审批环节——这是一种“渐进式自主”策略:AI表现越稳定,获得的权限就越多。

但这种模式也有局限:监督模型本身也是概率性的,存在被绕过的可能。因此Brex同时搭配了传统安全措施:给AI代理设置最小权限、记录所有操作的审计日志、实时检测异常行为,形成“AI监督+人工兜底+规则防护”的三层安全网。

当AI从“执行工具”变成能自主决策的“虚拟员工”,企业面临的就不只是技术问题,而是治理和责任的挑战。

首先是责任归属:如果AI代理招聘了不合格的员工,或者审批了违规的支出,该由谁负责?根据目前的法律框架,责任最终落在人类管理者或企业身上——AI不具备法律主体资格。Brex的做法是给每个AI代理设置“人类经理”,负责审批AI的关键操作、给AI反馈,甚至在AI表现不佳时“解雇”它(替换模型或调整权限)。

其次是透明度问题:AI代理的决策过程像黑箱,很难解释为什么它会淘汰某份简历,或者批准某笔支出。这不仅影响员工信任,还可能违反合规要求——比如欧盟《AI法案》要求高风险AI系统必须提供可解释的决策。Brex的解决方式是让AI代理记录完整的“推理链”:为什么做出这个判断,参考了哪些数据和规则,都要形成可追溯的审计日志。

更隐蔽的挑战是“自动化偏差”:人类可能会过度信任AI的决策,放弃独立判断。比如当AI代理说某份简历没问题,招聘人员可能就不再仔细审核。为了避免这种情况,Brex会定期抽查AI的决策,并且要求人类对AI的关键建议进行复核,形成“人机互相校验”的机制。

Brex的实践让我们看到,AI接管企业管理的核心不是“替代人类”,而是“重构工作流”:AI处理重复的信息筛选和执行,人类专注于需要判断力和创造力的决策。未来的企业管理可能会像自动驾驶:AI负责日常的“平稳驾驶”,人类只需要在遇到“突发状况”时接管。

但这个“自动驾驶”时代的前提,是我们能让AI变得“可信赖”——不仅要让AI能干活,还要让它的行为可预测、可解释、可控制。毕竟,把方向盘交给AI的同时,我们得先确认刹车和安全带都好用。

信任不是来自AI的完美,而是来自可控的边界。