对抗知识焦虑,从看懂这条开始

App 下载

85个神经元的AI,学图像比大模型快10倍

手写数字识别|神经网络架构|小鼠大脑发育|85神经元AI|Duan Zhou|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

手写数字识别|神经网络架构|小鼠大脑发育|85神经元AI|Duan Zhou|大语言模型|人工智能

想象一下:一个只有85个神经元的AI,比你手机里动辄百亿参数的大模型学得还快——识别手写数字,它学1轮准确率就破90%;换去认猫狗照片,不用改结构,学1轮准确率是随机猜测的4倍。这不是科幻,是独立研究者Duan Zhou在2026年4月发表的实验结果。这个比果蝇大脑(10万个神经元)还迷你的网络,没有靠海量数据或复杂算法,只是抄了小鼠大脑发育的「作业」——从单个干细胞开始,让它自己「长」成能思考的结构。这背后藏着的,是AI架构设计的全新可能。

过去我们做AI,都是先人工画好网络的「骨架」——多少层、每层多少神经元、怎么连接,再喂数据调权重。但Duan Zhou反其道而行之:生物大脑不是设计出来的,是从一个干细胞慢慢长出来的,那AI能不能也这么「长」?

他先从公开数据库里扒了小鼠胚胎干细胞变成皮层神经元的基因数据——15个关键基因在10个时间点的「开/关」状态,就像拿到了一份生物发育的「施工手册」。然后他把这些基因间的调控关系翻译成简单的布尔逻辑规则:比如基因A要开启,必须满足基因B开且基因C关。

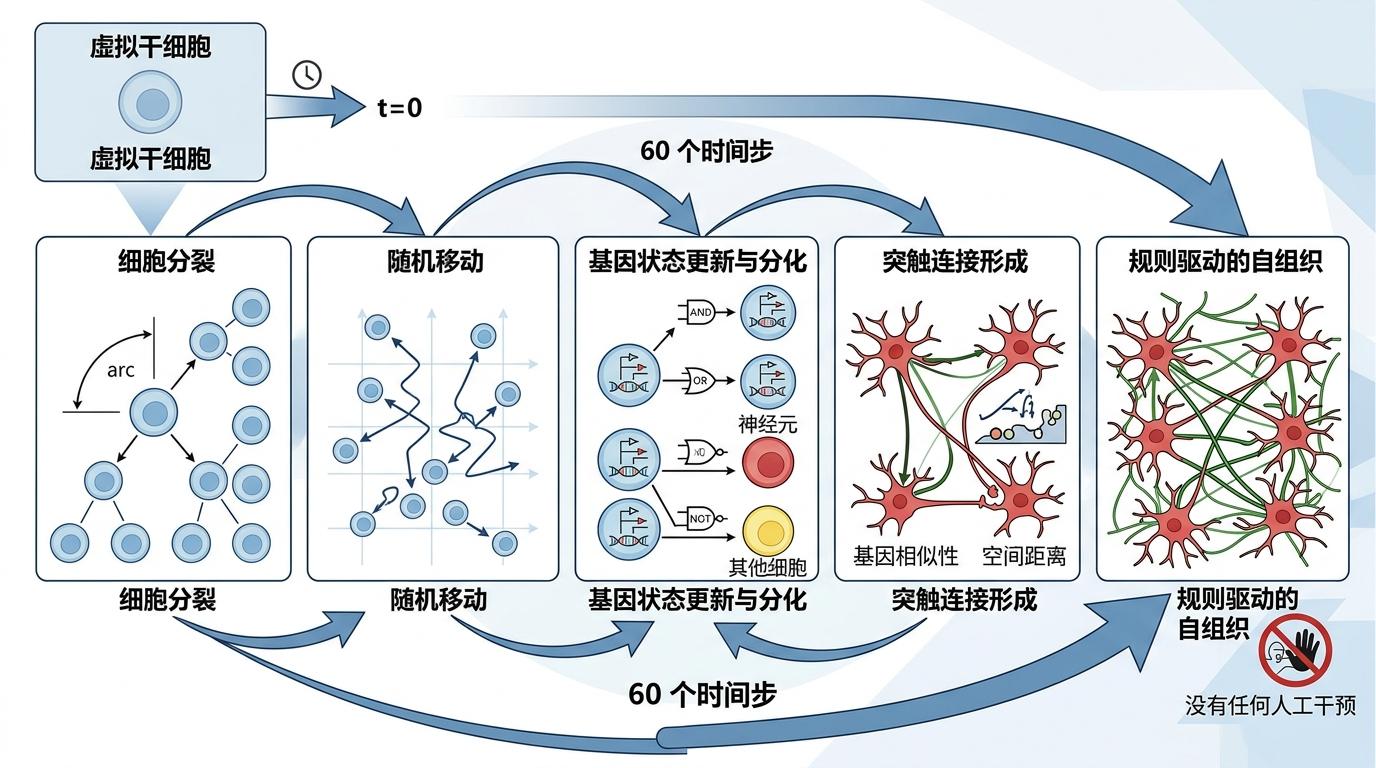

接下来就是让AI「生长」的过程:从一个虚拟干细胞开始,迭代60个时间步,细胞们会自动做四件事——分裂、在模拟空间里随机移动、根据布尔规则更新基因状态决定自己变成神经元还是其他细胞、成熟神经元会根据基因相似性和空间距离自动连突触。整个过程完全是规则驱动的自组织,没有任何人工干预的优化目标。

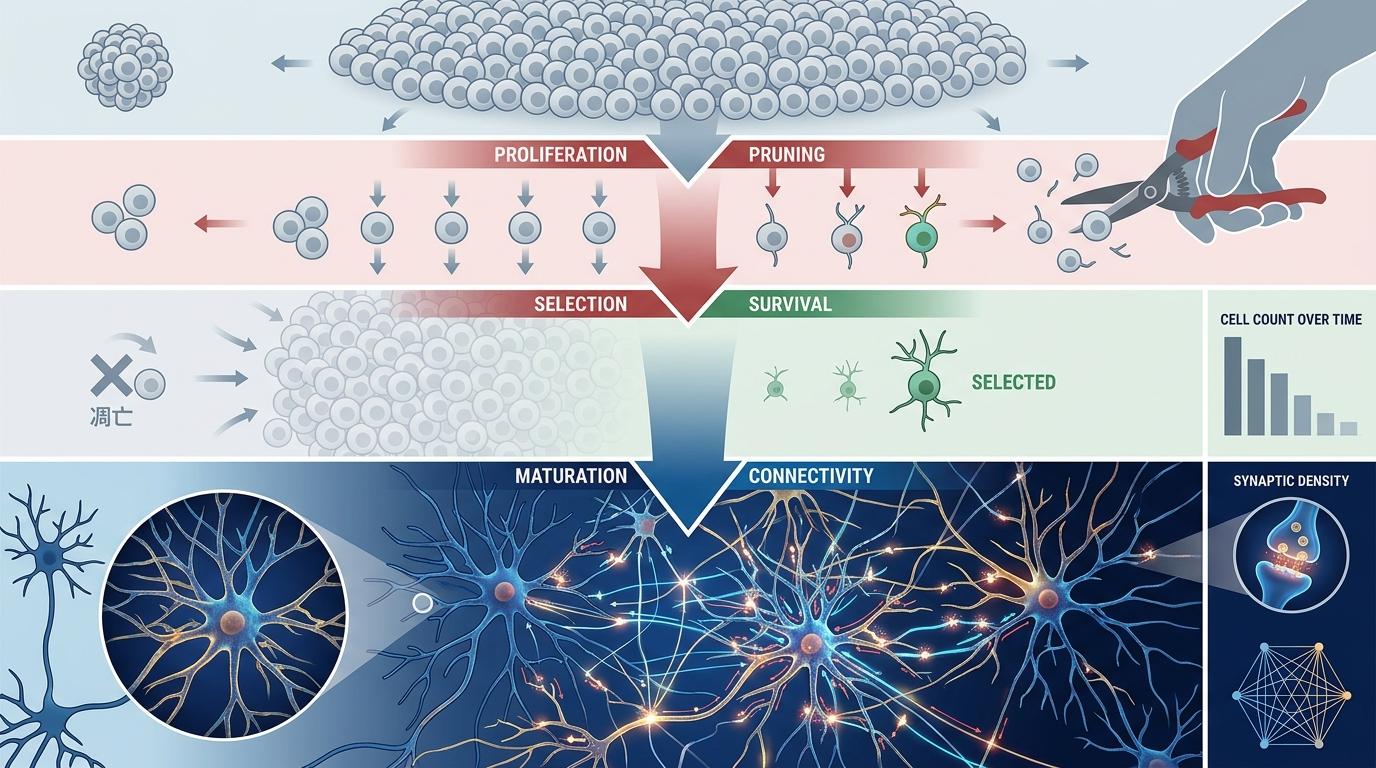

最后生成的5000个细胞里,只有85个变成了成熟神经元,占比1.7%——这和生物发育「先大量增殖,再精细修剪」的策略一模一样。而这85个神经元,却密密麻麻连了20.04万个突触,平均每个神经元和其他神经元连了4715次,几乎是全连接的状态。

这个85神经元的网络,训练方式也很特别:那个由发育生成的突触连接矩阵是固定死的,只能调整输入层(把图像投影到85维)和输出层的权重。就像给一个天生有聪明大脑的孩子,只教它怎么看世界和怎么输出答案。

结果让人大吃一惊:在MNIST手写数字数据集上,它从随机猜测的10%准确率,学1轮就跳到了92.15%——而同等规模的随机初始化网络,通常要学5到10轮才能到90%。更夸张的是,把它直接拿去认更复杂的CIFAR-10自然图像,不用改任何结构,学1轮准确率就到了40.53%,是随机猜测的4倍。

为了证明这不是靠密集连接瞎蒙的,研究者做了个对照实验:造了一个同样85个神经元、同样20万个突触的随机网络,结果它不管学多久,准确率都停留在随机水平。这说明,快速学习的能力不是来自连接多,而是来自生物发育规则生成的特殊连接模式。

这种模式的本质,是给AI提前装好了「结构先验」——就像给梯度下降算法搭了个高效的脚手架。这个由发育规则生成的连接矩阵,把输入数据投影到了一个对优化极其友好的高维空间里,让AI能在极短时间里找到最优解。

当然,这项研究也有它的局限:目前只在两个视觉数据集上做了测试,网络规模极小,也没有考虑生物大脑里的活动依赖可塑性——也就是神经元会根据活动强度调整连接的能力。但它的意义,远不止于造出了一个学习快的迷你AI。

它提出了一个全新的AI设计理念:「结构即计算」。过去我们认为,AI的能力主要来自训练出来的权重,但这个研究告诉我们,网络的拓扑结构本身,在训练前就已经承载了强大的计算潜力。这种潜力不是靠人工设计,也不是靠随机生成,而是靠模拟自然发育「生长」出来的。

这给未来的AI发展指了一条新路子:比如在边缘计算、神经形态芯片这些对功耗和效率要求极高的领域,我们不用再堆参数,而是可以模拟生物发育,生成极小但高效的网络结构;甚至可以借鉴生物发育「先增殖再修剪」的策略,先造一个大的前体细胞库,再让它自己进化出最优的计算核心。

当我们还在为大模型的参数竞赛焦头烂额时,这个85神经元的迷你AI,像个冷静的提醒:生物用了亿万年进化出来的发育机制,藏着比复杂算法更高效的智能密码。

我们总说要向自然学习,但大多时候只是在模仿生物的功能,比如让AI像人一样看、听、说话。而这项研究,是第一次真正模仿生物的「生长过程」——从一个单细胞开始,让规则驱动自组织,最终长出能思考的结构。

结构先于功能,生长优于设计。这句话或许会成为未来AI架构设计的新信条:最好的AI,不是我们设计出来的,而是我们给它一套规则,让它自己长出来的。