对抗知识焦虑,从看懂这条开始

App 下载

Token成AI硬通货,算力焦虑重塑数字分配规则

数字分配规则|Gemini|ChatGPT|Claude会员|Token额度|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

数字分配规则|Gemini|ChatGPT|Claude会员|Token额度|大语言模型|人工智能

2026年春,博士生苏玉对着电脑屏幕上的弹窗攥紧了拳头——她的Claude会员本周Token额度已用掉90%,距离论文截稿还有12天。过去三年,AI是她科研的「隐形助手」,可现在她得像二十年前拨号上网的网民那样精打细算:用ChatGPT写简报,Gemini处理图片,只有核心的研究框架敢交给Claude。她甚至开始用文言文和AI对话,就为了少消耗几个Token。这不是个别用户的困境,而是AI时代的集体缩影:曾经免费的智能服务,如今变成了按「Token」计价的稀缺商品,每一次调用都在烧真金白银。

你可以把Token理解为AI世界的「千瓦时」——它是大语言模型处理文本的最小单位,100个Token约等于75个英文单词或50个汉字。过去它只是模型训练的技术副产品,如今却被NVIDIA CEO黄仁勋定义为「新型大宗商品」:标准化、可计量、可交易,成了AI算力商品化的核心载体。

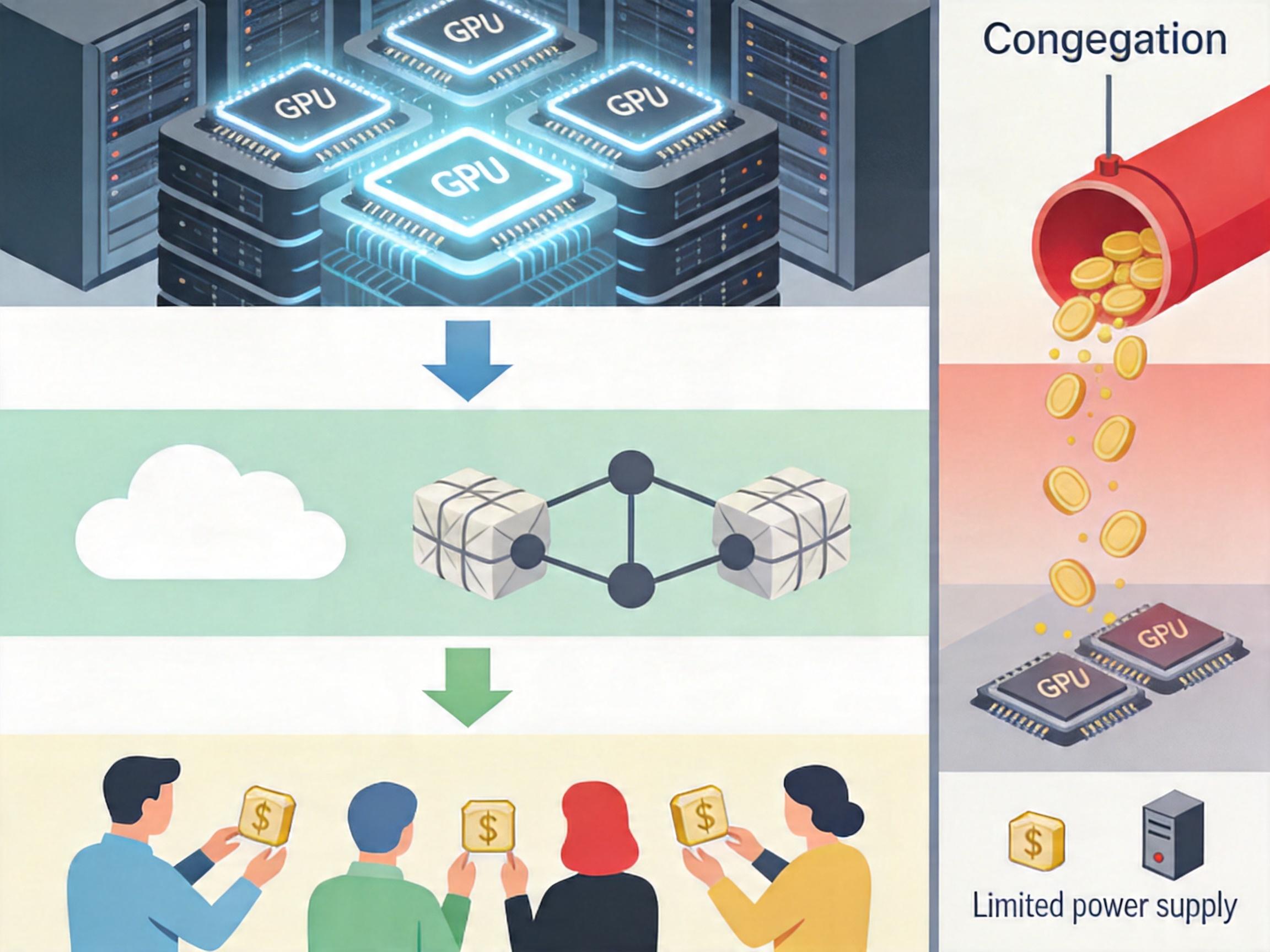

这背后是AI产业的重心转移:过去十年,AI经济的核心是一次性的模型训练成本,而现在,持续增长的推理成本成了主角。2025年,推理计算已占主流AI模型总计算量的60%以上,且还在以指数级速度增长。用户每一次提问、每一段AI生成的回答,都对应着Token的消耗,而Token的价格最终锚定在GPU折旧、电力消耗、数据中心运维这些硬成本上。

和电力一样,Token的价格也分「峰谷」:低时延、高交互的实时对话Token,比如智能驾驶的语音指令,单价能达到150美元/百万;而高吞吐的离线批量处理Token,价格可能低至0美元/百万。这种分层定价,把算力的稀缺性直接传导到了每一个用户的使用场景里。

AI算力的流动像一根自上而下的水管:上游是GPU芯片和数据中心,中游是云厂商和模型厂商,下游是开发者和普通用户。每经过一个环节,算力就被封装一次,最终变成可计价的Token。但现在这根水管正在拥堵——需求端,多模态AI、智能体的爆发让Token消耗量增长了上千倍;供给端,GPU产能、电力、数据中心建设都存在物理极限,GPU平均利用率还不到30%。

这种供需矛盾直接体现在价格上:2026年第一季度,腾讯混元大模型部分服务涨价463%,阿里云、百度云相继上调AI相关服务费用。终端用户的感受更直接:苏玉每月花180元买的Claude会员,每周Token额度只够支撑3天核心科研工作;AI影视创业者得在「即梦」和其他低价模型间反复切换,平衡效果与成本。

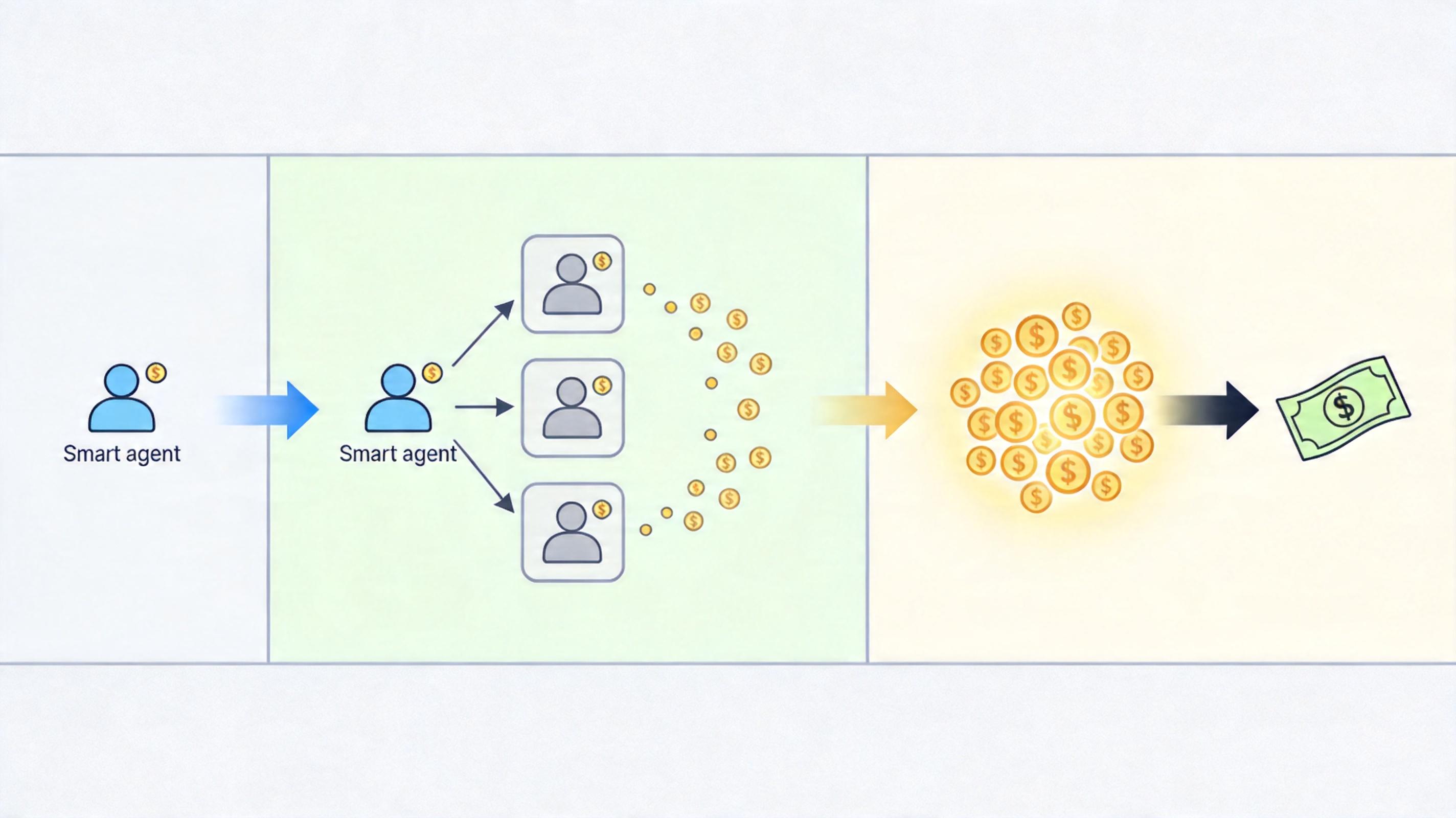

更隐蔽的成本藏在技术细节里:一次看似简单的智能体调用,背后可能是多轮推理、多次API调用,Token消耗呈指数级放大。有开发者测算,用第三方工具调用Claude的成本,可能是原生框架的数十倍——这些浪费最终都会变成用户账单上的数字。

Token经济正在重塑数字经济的生产与分配规则。一方面,它让算力资源的分配更市场化:企业可以像买电力期货一样锁定Token价格,规避波动风险;开发者能通过「模型路由」把简单任务交给低价模型,复杂任务留给高端模型,提升算力效率。但另一方面,它也在制造新的数字鸿沟。

大型科技公司能以极低的成本拿到GPU资源,单月Token消耗就能达到60万亿,相当于全球日消耗的4%;而中小企业和个人用户不仅要承受高价,还得面临额度限制、服务降级。苏玉的「小心机」不是个例——她把Claude的使用技巧当成「核心竞争力」,不愿分享给同事,因为在Token稀缺的时代,谁能更高效地利用算力,谁就掌握了生产优势。

这种差距正在从「工具使用」转向「能力分层」:掌握算力资源的「超级个体」能通过AI自动完成代码编写、科研实验、内容创作,形成难以逾越的知识壁垒;而普通用户只能在Token的限制下,完成基础的辅助性工作。

当AI从「免费工具」变成「计价商品」,我们正在经历一场和拨号上网时代相似的变革——曾经无限的数字资源,如今有了清晰的成本边界。Token的出现,让算力这种无形资源变得可计量、可交易,也让每一个用户都成了「算力消费者」。

算力不是无限的,智能也不是免费的。这是AI时代必须接受的现实。未来的数字经济,不会是少数巨头垄断算力的游戏,而是需要建立更公平的分配机制:让小企业也能以合理成本获取算力,让普通人不用为了几个Token精打细算。毕竟,真正的智能时代,应该是算力像电力一样普及,而不是成为少数人的特权。