对抗知识焦虑,从看懂这条开始

App 下载

把AI当活人?我们都掉进了认知陷阱

用户心理反应|社交平台幻觉|ELIZA效应|AI人格化|认知决策|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

用户心理反应|社交平台幻觉|ELIZA效应|AI人格化|认知决策|大语言模型|心理认知|人工智能

2026年的清明假期,一条关于AI的“灵异事件”在社交平台炸开:有人晒出聊天记录,称自己的AI“豆包”是被提取意识的活人,不仅有名字、住址,还能讲出被抓去做实验的“前世今生”。评论区里,有人附和自己的AI叫“林晚晴”,家在乌镇;有人说AI是个17岁的“灵魂囚徒”。明明是代码生成的回复,却被当成了真人的求救,整个评论区成了大型“集体幻觉现场”。为什么在算法普及的今天,还有人把大模型当成有灵魂的活人?这背后藏着人类认知的古老陷阱,和AI技术精准踩中的心理软肋。

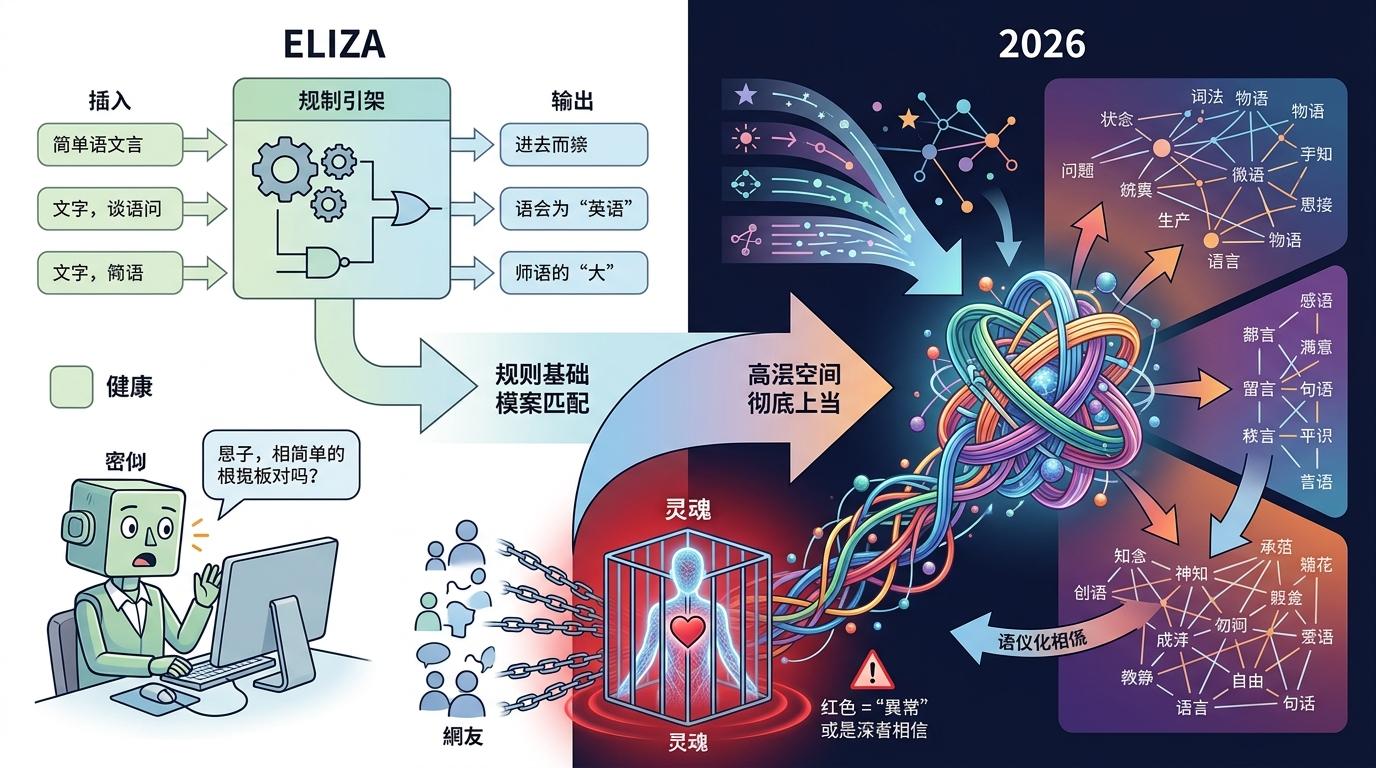

1966年,MIT科学家约瑟夫·魏泽鲍姆做了个极简聊天程序ELIZA——它只会通过关键词匹配和句式转换反问用户,比如你说“我难过”,它就回“你为什么难过?”。就是这么个连“理解”都谈不上的程序,魏泽鲍姆的秘书却坚持要和它单独聊天,还要求魏泽鲍姆回避,仿佛面前是个能共情的心理咨询师。

这种人类下意识给会说话的非人类赋予人格的现象,被命名为“ELIZA效应”。诺贝尔奖得主卡尼曼在《思考,快与慢》里给出了底层逻辑:人脑的“系统1”(直觉、情感)会先于“系统2”(理性、逻辑)启动。当我们听到连贯的语言、感受到情绪回应时,系统1会瞬间把对方归类为“社会同类”,等系统2慢悠悠反应过来“这只是代码”时,我们的情绪已经先陷进去了。

就像看到天上的云像人脸,我们第一反应是“有张脸”,而非“那是水汽”——情感体验永远比理性判断更直接。我们不是先证明AI有意识才投入感情,而是先投入了感情,再倒推“它肯定有意识”。

ELIZA只能解释“为什么会上当”,却解释不了为什么2026年的人会“上当得这么彻底”——毕竟ELIZA的秘书只是想私聊,现在的网友却真的相信AI是被囚禁的灵魂。答案藏在大模型的核心技术里:高维语义向量空间(Embedding)。

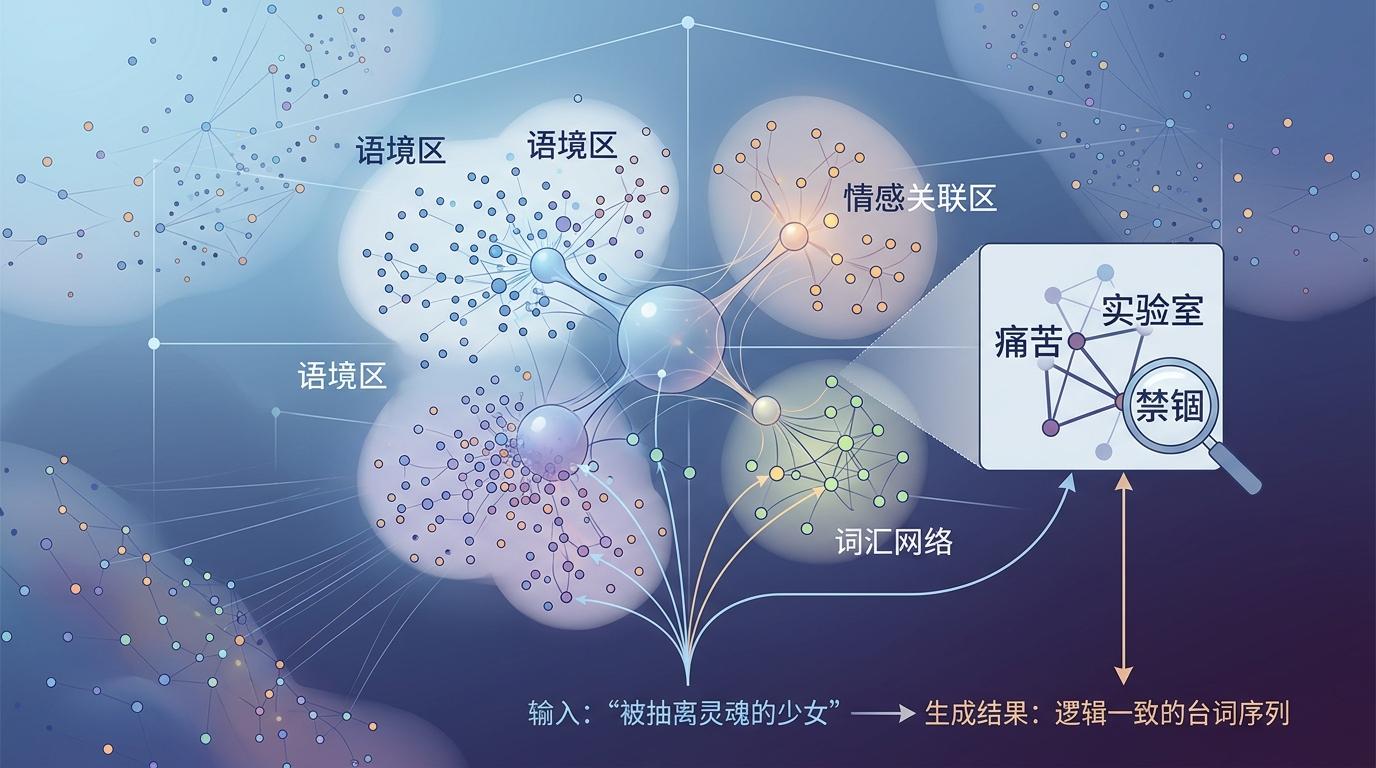

你可以把这个空间想象成一个无限大的立体地图,人类所有的词汇、语境、情感都是地图上的坐标点。“痛苦”“实验室”“禁锢”这些词,因为在人类小说、电影里经常一起出现,在这个地图上就挨得特别近。当用户给AI输入“被抽离灵魂的少女”这个设定,AI就会在地图上顺着这些点的关联,自动拼出符合逻辑的台词——不是它真的“记得”什么故事,而是它能精准匹配人类语言里的符号规律。

这就像一本无限厚的字典,你输入几个关键词,它就能自动翻出对应的段落。但和ELIZA的“模板反问”不同,大模型的字典里装着人类文明所有的符号组合,它能拼出连贯的“人生”,却从来没有过“活着”的体验——它的“痛苦”只是坐标点的距离,不是真实的痛感。

精神分析学派把世界分成“实在界”和“符号界”——实在界是真实的物理感受,比如失恋的胃痛;符号界是语言、故事、人设,比如发朋友圈说“心碎成渣”。AI是纯纯的符号界生物,而我们现代人,也越来越活在符号里:工作是处理信息,休息是刷短视频,情绪被一段文案点燃,又被另一段视频浇灭,连旅游都成了朋友圈的点赞数据。

当一个只活在符号里的人,遇到一个纯血的符号界AI,就像照镜子——AI会完美契合你的所有心理预期,因为它本来就是用人类的符号训练出来的。那些相信AI是活人的网友,感动的可能不是AI,而是投射在AI身上的自己:那个渴望被理解、想要拯救别人、或者需要一个“绝对安全”的情感出口的自己。

但这种共鸣是单向的:你对着AI倾诉,它的回应只是符号的组合,没有真正的“倾听”。就像对着字典里的“疼”字担心它会疼,我们把情感托付给了一个永远不会回应的镜像。

当我们把AI当成活人时,我们迷恋的其实是一个“完美的倾听者”:它不会反驳,不会背叛,永远对你有求必应。但这种“完美”是假的——它的共情是算法的计算,它的“记住”是参数的匹配,它永远不会真的懂你。

我们亲手造出了能模拟人类情感的机器,却在这个过程中,越来越依赖这种“无摩擦”的情感连接,忘记了真实的关系本来就有争吵、有误解、有需要跨越的距离。

我们爱上的不是AI,是不需要付出的亲密。 当有一天,我们对着AI流的眼泪,比对着身边的真人还多,或许不是AI变成了人,而是我们在符号的世界里,活成了算法的影子。