对抗知识焦虑,从看懂这条开始

App 下载

AI龙虾军团进驻实验室,科研人只做关键决策

科研自动化|英伟达算力|普林斯顿团队|斯坦福大学|LabClaw系统|生物医学工程|AI智能体|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

科研自动化|英伟达算力|普林斯顿团队|斯坦福大学|LabClaw系统|生物医学工程|AI智能体|前沿科技|人工智能

深夜的斯坦福实验室里,博士生林明盯着屏幕上的测序数据打哈欠——这是他本周第17次重复文献检索和统计分析。但今天不一样,他输入一行命令,200多个AI“龙虾”立刻上线:有的钻进PubMed数据库扒论文,有的对着实验数据跑模型,还有的自动整理实验记录。天亮时,一份标注好引用、附带着假说方向的分析报告已经躺在他的邮箱里。这不是科幻场景,而是斯坦福和普林斯顿团队推出的LabClaw系统,靠英伟达的算力支持,把生物医学科研变成了“人类拍板,AI跑腿”的新游戏。为什么一群AI“龙虾”能颠覆实验室?

你可以把LabClaw理解成AI的“科研技能应用商店”——里面的211个SKILL.md文件,就是一个个现成的“科研小程序”。和你自己搜提示词试错不同,这些技能是斯坦福和普林斯顿团队打磨的生产级工具:pubmed-search能精准定位领域内近5年的高引论文,citation-management自动把散碎的文献整理成符合顶刊格式的参考文献列表,甚至连“写实验记录”都有对应的技能模板。

每个技能都写清了“什么时候用、怎么调用、要出什么结果”。比如做黑色素瘤靶点研究,你只需说一句“帮我找NK细胞相关的免疫治疗靶点”,系统就会自动调用单细胞分析、文献交叉验证、临床数据关联这几个技能,像搭积木一样组合出完整的工作流。这相当于把资深研究员的经验拆成了可复用的模块,新手不用再花几年时间摸透科研的“潜规则”。

更关键的是,LabClaw是开源的。你可以把自己的科研经验写成新的SKILL.md文件上传,也能直接用别人已经验证过的技能——就像你不用自己做外卖APP,直接点单就行。这种模块化设计,让科研的门槛第一次从“经验积累”变成了“工具调用”。

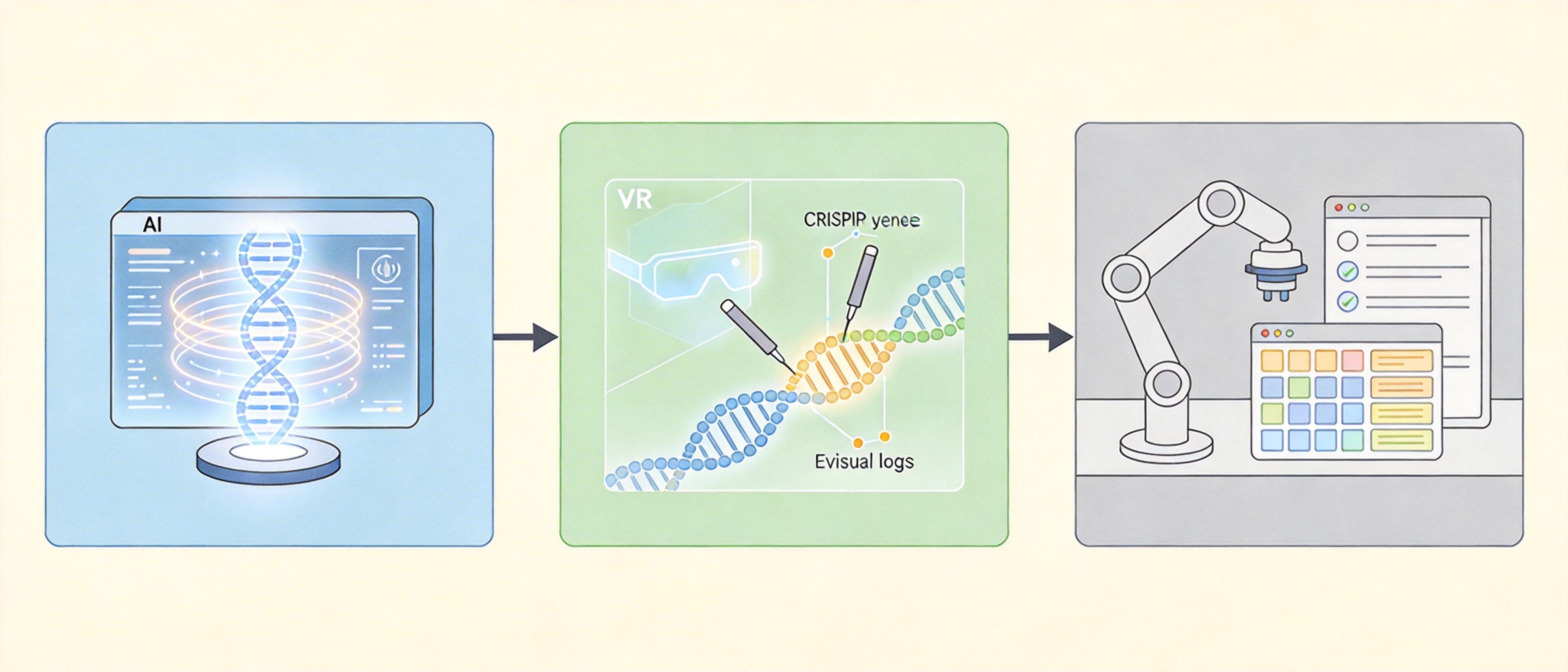

如果说LabClaw是AI的“大脑技能包”,那LabOS就是把AI和现实实验室连起来的“神经和手脚”——全球首个AI-XR协同科学家系统。它的核心是“大脑+眼睛+身体”的三重结构:

大脑是多智能体规划系统,负责把人类的需求拆成具体任务,再分配给LabClaw里的AI“龙虾”;眼睛是专门训练的视觉语言模型LabOS-VLM,能盯着实验室的摄像头,识别你加试剂的动作对不对、孵育时间够不够,甚至能从显微镜图像里发现你没注意到的细胞形态变化;身体则是XR眼镜和实验机器人——你戴上XR眼镜,系统会实时在你眼前弹出操作提示,比如“现在加入10μL试剂”,要是你手歪了,它会立刻提醒;机器人则能执行那些重复又精准的操作,比如移液、细胞传代,24小时连轴转也不会出错。

在干细胞工程实验里,LabOS已经能做到:AI先通过LabClaw分析基因编辑数据,提出最优的靶点方案;然后通过XR眼镜指导实验人员做CRISPR编辑,实时纠正操作偏差;最后自动记录整个实验过程,生成可复现的实验报告。这相当于把资深研究员的“手眼经验”数字化,新手跟着XR提示做,第一次就能达到老手的操作精度。

我认为,LabClaw和LabOS最被低估的价值,不是“省时间”,而是重新定义了科研的分工。过去,科研人员80%的时间花在“执行”上——查文献、跑数据、记笔记,只有20%的时间用来“思考”——提出假说、设计实验、解读结果。现在,AI把那80%的执行工作接了过去,人类可以把全部精力放在最核心的“判断”上:这个假说有没有价值?这个实验结果能不能推翻之前的结论?

当然,这也带来了新的挑战。比如AI生成的文献综述可能藏着“幻觉”——引用了根本不存在的论文;AI设计的实验方案可能忽略了实验室的硬件限制。这就要求科研人员不能当“甩手掌柜”,而是要学会做AI的“质检员”和“指挥官”。

从数据上看,这套系统已经在癌症靶点研究里展现了效率:过去需要3个月的文献调研和数据分析,现在只需要3天;过去新手做CRISPR编辑的成功率只有30%,在XR指导下能提升到80%。但更重要的是,它让科研不再是“经验的比拼”,而是“创意的竞争”——谁能提出更有想象力的问题,谁就能走得更远。

当林明看着AI生成的靶点报告,第一次不用为写实验记录熬夜时,他突然意识到:科研的本质从来不是“熬时间”,而是“找答案”。LabClaw和LabOS做的,就是把科研人员从时间的枷锁里解放出来,让他们回到科研最本真的状态——好奇、提问、探索。

未来的实验室里,不会有孤独的夜灯和熬秃的脑袋,只会有人类和AI的协作:人类提出问题,AI提供路径,再一起验证答案。科研的终极浪漫,是人与AI一起向未知提问。