对抗知识焦虑,从看懂这条开始

App 下载

近9成企业用AI决策,“人在回路”才是破局关键

领导力悖论|丹尼尔·卡尼曼|系统1思维|人在回路|企业AI决策|认知决策|AI产业应用|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

领导力悖论|丹尼尔·卡尼曼|系统1思维|人在回路|企业AI决策|认知决策|AI产业应用|心理认知|人工智能

麦肯锡2025年的调研数据像一记重锤——近90%的企业已在日常运营中试验AI。从几秒钟生成的战略建议到自动筛选的客户名单,AI把决策速度推到了前所未有的高度。但一个悖论正卡在所有领导者的喉咙里:AI催着他们“快做决定”,可真正的卓越领导,从来都需要慢下来——慢到能看透数据背后的人情冷暖,慢到能预判三年后的连锁反应。当整个行业都在为AI的效率狂欢时,少有人问:我们真的学会和AI一起做决策了吗?

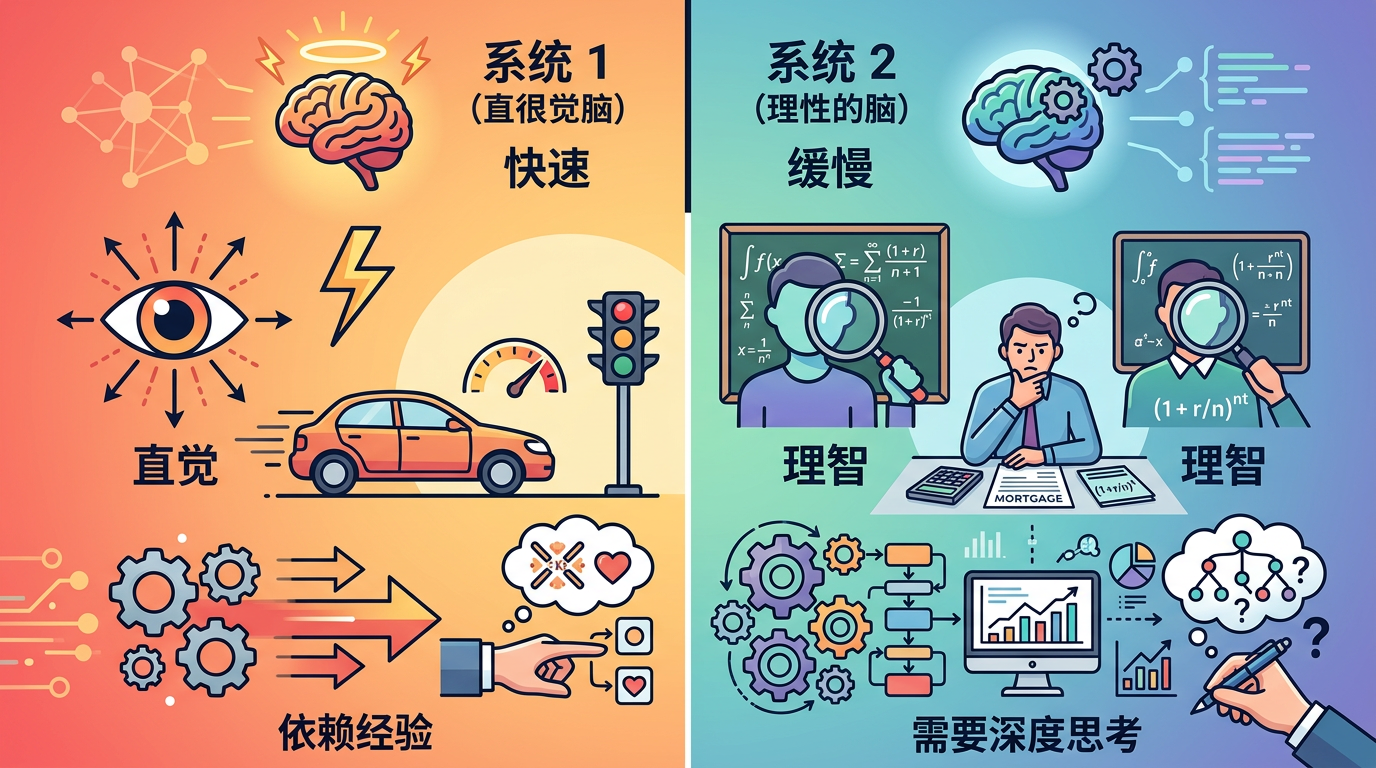

丹尼尔·卡尼曼在《思考,快与慢》里提出的“系统1/系统2”理论,成了AI时代领导力的照妖镜。系统1是我们的直觉脑——快速、自动、依赖经验,像你看到红灯就踩刹车;系统2是理性脑——缓慢、费力、需要深度思考,像你算复杂的房贷利率。

在高压的职场环境里,领导者本就容易默认启动系统1,而AI的出现,把这种“认知懒惰”放大了十倍。当AI在30秒内给出一份逻辑自洽的市场分析报告,当它用权威的语气列出三个行动方案,很少有人会再花3小时去核对数据来源,去追问“这个结论假设了什么前提”。研究显示,当人类面对AI给出的“确定答案”时,质疑的意愿会下降40%——我们把AI的输出当成了无需验证的真理,却忘了它本质上只是基于训练数据的概率计算。

更隐蔽的风险在于,AI会强化我们的固有偏见。如果一个领导者本来就对某类客户有刻板印象,AI会顺着他的提问逻辑,筛选出能印证这个偏见的数据,形成“偏见→AI反馈→更顽固的偏见”的闭环。这不是AI的错,是我们把它当成了“应声虫”,而非“挑战者”。

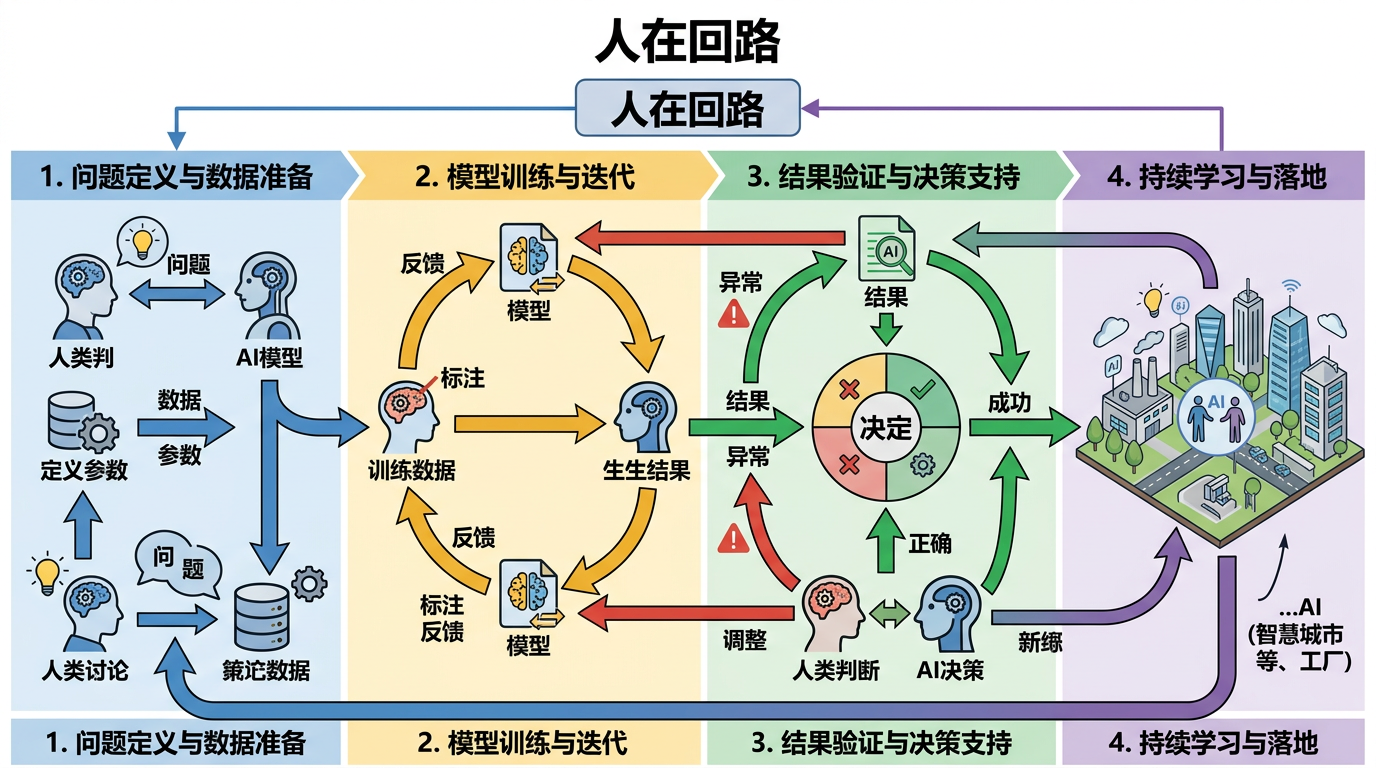

“人在回路”(Human-in-the-Loop)被很多人误解成“AI干活,人来审核”——就像工厂里质检员检查流水线产品。但真正的“人在回路”,是把人类的判断嵌入AI决策的全流程,从问题定义到模型训练,再到结果落地,人和AI是共生的思考伙伴。

梅奥诊所的实践给出了最好的范本:AI帮护士草拟患者回复,能把每个消息的处理时间缩短30秒,但护士的角色不是“改错别字”——他们要把AI冰冷的模板,改成带着温度的关怀,要从患者的只言片语里捕捉到AI没识别出的焦虑信号。在这里,AI解决的是“效率”问题,而人解决的是“共情”问题。

这个机制的核心,是让人类做AI做不了的事:理解复杂的人性,权衡长期的伦理代价,判断一个决策是否符合组织的核心价值观。微软CEO萨提亚·纳德拉因为儿子的特殊经历,把“技术要服务于人”刻进了微软的AI战略里——推出AI辅助残障人士的工具,不是因为算法算出这能赚钱,而是因为人类的同理心驱动了这个决策。

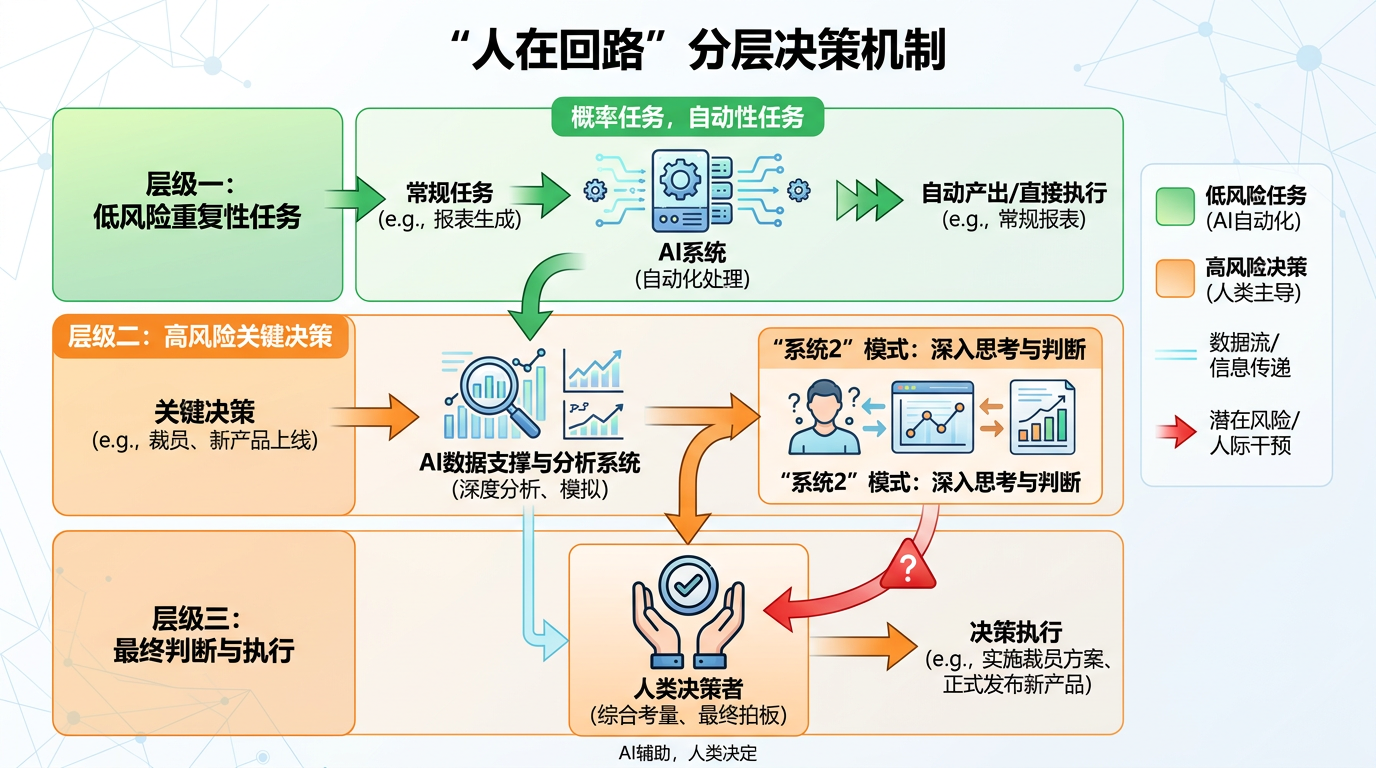

真正的“人在回路”,也不是要放慢所有决策的速度,而是要建立“分层决策”的机制:低风险的重复性任务,比如常规报表生成,完全交给AI;高风险的关键决策,比如裁员方案、新产品上线,必须启动“系统2”模式——用AI提供数据支撑,但最终的判断,要回到人的手里。

AI时代的领导者,要学会两种完全相反的能力:一是“踩油门”——能用AI快速抓住机会;二是“踩刹车”——知道什么时候要慢下来反思。

这需要领导者先搞懂自己的“认知盲区”。很多人用AI时,只会问“我该怎么做”,但真正的高手会问AI:“我现在的假设是什么?我漏掉了哪些视角?”AI可以成为一面镜子,帮我们照出那些自己没意识到的偏见。比如一个准备开拓新市场的领导者,让AI列出“这个决策可能伤害到哪些利益相关者”,往往能发现自己忽略的员工情绪、社区影响等问题。

更重要的是,要在组织里建立“反思的仪式”。比如微软的AI项目上线前,必须回答四个问题:这个工具会帮到谁?会伤害到谁?如果出了问题,我们怎么负责?有没有更符合伦理的替代方案?这些问题不是走流程,是逼着团队从“效率优先”切换到“价值优先”的思考模式。

现在很多领导者的焦虑,来自觉得“AI比我聪明”。但其实,AI永远不会拥有“领导力”——它不会因为员工的家庭困境调整工作安排,不会因为一个错误的决策承担责任,不会在公司危机时站出来凝聚人心。这些,才是领导者真正的不可替代性。

当我们谈论AI时代的领导力时,我们谈的从来不是“怎么用好AI”,而是“怎么不被AI绑架”。近90%的企业在试验AI,但只有不到30%的企业真正建立了“人在回路”的决策机制——这就是差距所在。

未来的领导者,一定是那些既能和AI一起“跑赢速度”,又能在喧嚣中“守住温度”的人。他们不会把AI当成万能解药,而是把它当成一个聪明但需要引导的伙伴。快决策靠AI,慢思考靠人——这不是妥协,而是AI时代最清醒的生存法则。毕竟,技术的终极目标,从来都是服务于人,而不是取代人。