对抗知识焦虑,从看懂这条开始

App 下载

偏见算法:人类思维的“默认设置”与AI的“镜子陷阱”

麻省理工学院|芝加哥大学|招聘歧视|无意识偏见|社会心理学|AI产业应用|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

麻省理工学院|芝加哥大学|招聘歧视|无意识偏见|社会心理学|AI产业应用|心理认知|人工智能

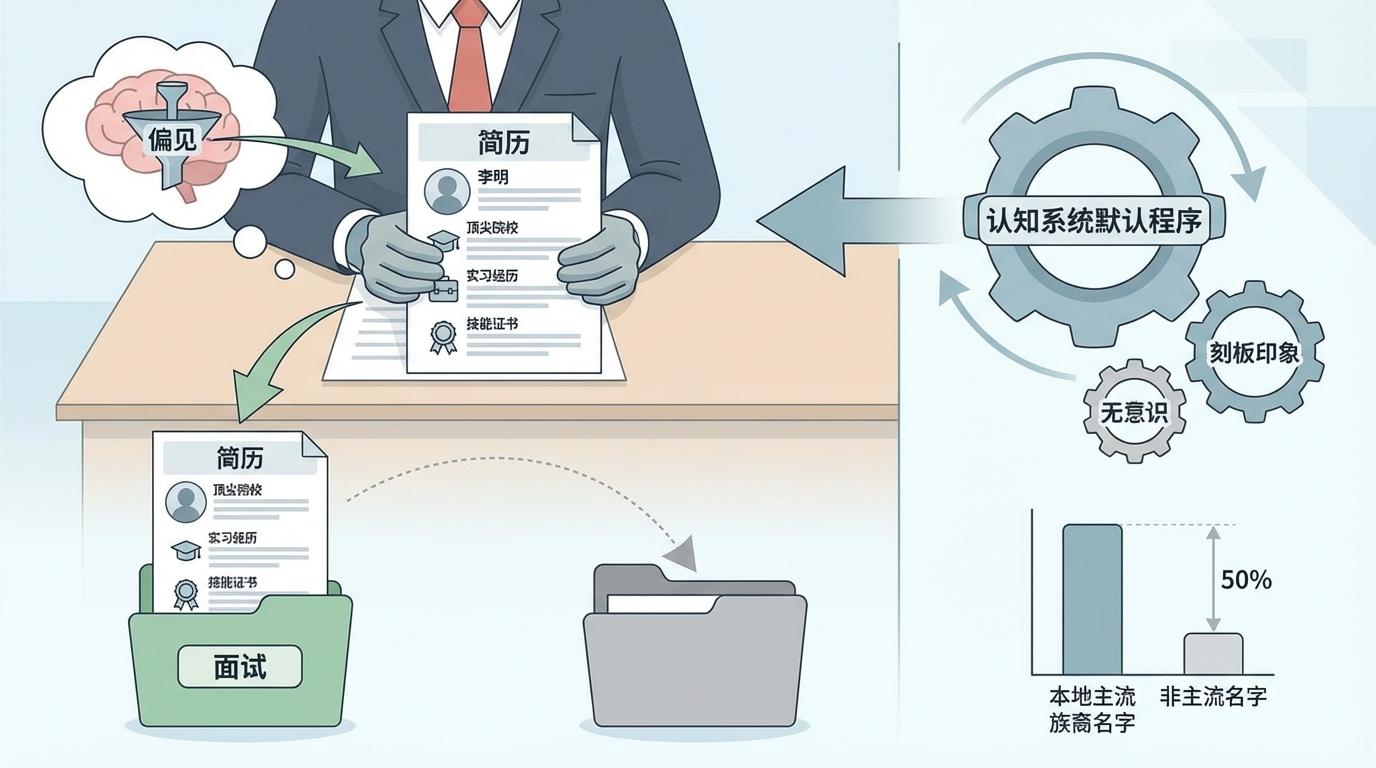

一位招聘经理的桌上放着两份几乎一模一样的简历。同样的顶尖院校,同样出色的实习经历,同样的技能证书。唯一的区别,是简历顶端的名字。一个听起来像本地主流族裔,另一个则不然。经理在无意识中,将前一份简历放入了“面试”文件夹。这个决定,可能只花了不到十秒钟。这并非虚构的职场剧,而是无数研究揭示的现实。芝加哥大学与麻省理工学院的联合研究曾发现,仅仅是简历上的名字不同,就能让面试邀约率相差高达50%。这个看不见的剧本,由一种我们既熟悉又陌生的力量编写——偏见。它并非少数“坏人”的专利,而是深植于人类认知系统中的默认程序。

如果有人告诉你,你、我,我们所有人,都是带有偏见的,你可能会立刻反驳。然而,数十年来的社会心理学研究指向一个令人不安的结论:做一个人类,就意味着在设计上存在偏见。这并非软件缺陷,而是我们大脑为了高效运转而预装的“功能”。

哈佛大学的“内隐联想测验”(Implicit Association Test, IAT)是这一领域的里程碑。全球超过两百万人次的测试数据显示,即便人们在意识层面信奉平等,其潜意识仍会自动地偏好高地位或主流群体。心理学家安东尼·格林沃尔德(Anthony Greenwald)和马扎林·贝纳基(Mahzarin Banaji)的研究表明,刻板印象是正常学习和分类过程的普通副产品,而非少数人的病态心理。

为什么会这样?人格心理学之父戈登·奥尔波特(Gordon Allport)在其经典著作《偏见的本质》中给出了深刻的解释。他认为,偏见源于三大核心机制:

因此,偏见并非人格瑕疵,而是我们认知系统的基础配置。问题不在于“谁有偏见”,而在于“我们对谁、在何种情境下、抱有多强的偏见”。

当我们以为可以用冰冷、客观的技术来克服人性的弱点时,却发现人工智能(AI)成了人类偏见最忠实的“镜子”。AI本身没有情感、焦虑或群体忠诚,但它通过学习人类创造的数据来认识世界。而这些数据,充满了我们自己都未曾察觉的偏见。

现实世界的案例触目惊心:

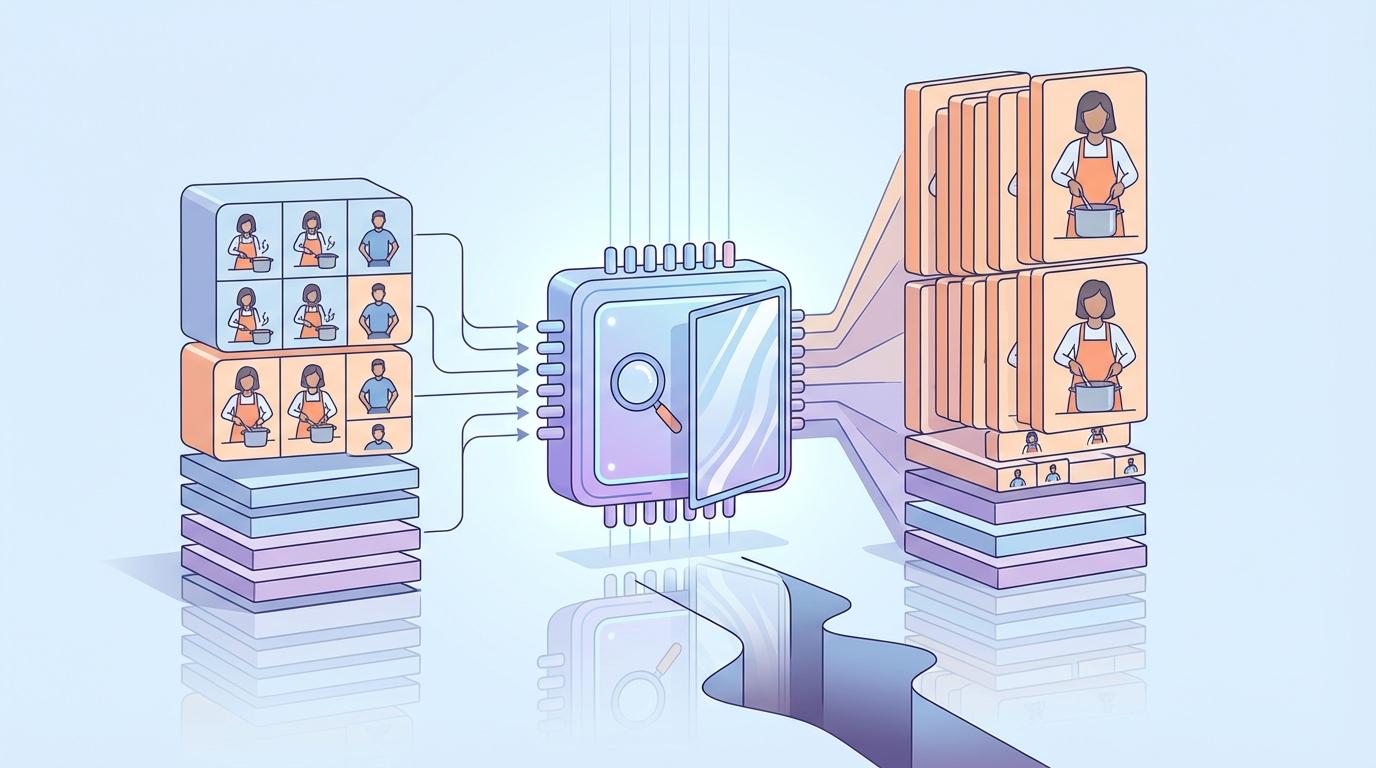

正如微软研究员汉娜·沃拉赫(Hanna Wallach)所言:“只要机器学习程序是通过社会中已存在的数据进行训练的,那么只要这个社会还存在偏见,机器学习也就会重现这些偏见。”更可怕的是,AI不仅会复制偏见,甚至会将其放大。一项研究发现,一个烹饪照片数据集中,女性出现的比例比男性高33%,而算法学习后,将这一差异放大到了68%。AI这面镜子,不仅映照出我们的瑕疵,还可能将其扭曲成更深的鸿沟。

偏见是人类认知的默认设置,难以根除。但我们并非束手无策。面对AI这把双刃剑,我们正开始学习如何利用制度与技术,去管理和缓解偏见,而非放任其滋长。

制度先行:为AI戴上“紧箍咒”

对抗算法偏见,首先是一场治理的挑战。全球的监管机构与组织已经开始行动:

技术校准:让算法学习“公平”

在制度框架下,技术本身也提供了对抗偏见的工具:

这些努力的核心思想是:我们无法创造一个完全“无偏见”的AI,但我们可以创造一个可审计、可解释、可问责的AI系统。我们不能指望技术自动解决社会问题,但可以设计技术,使其成为推动公平的工具,而不是加剧不平等的推手。

我们正处在一个关键的十字路口。偏见,这个伴随人类演化数万年的认知特征,在人工智能时代遇到了前所未有的放大器。AI像一面镜子,不仅映照出我们个人的无意识偏见,更暴露了整个社会结构性的不平等。它迫使我们直面那些被我们忽视或习以为常的“默认设置”。

这场与偏见的博弈,终点并非彻底清除大脑中的每一个角落,那或许是徒劳的。真正的目标,是建立一个系统,让偏见在关键决策中无处遁形。在这个系统中,技术不再是隐藏偏见的“黑箱”,而是帮助我们审视决策的“罗盘”,指引我们朝向更公平的方向。

最终,驯服算法偏见的旅程,也是一次深刻的社会自省。我们为AI提供怎样的数据,就是在告诉它我们希望构建一个怎样的世界。要修复AI的偏见,我们必须先着手修复产生这些偏见数据的现实世界。这并非单纯的技术挑战,而是一场关乎我们共同未来的文明考验。