对抗知识焦虑,从看懂这条开始

App 下载

AI创业估值锚点变了:论文引用量算钱

初创公司估值|AI学者引用榜|Google Scholar|学术引用量|商业经济|AI产业应用|社会人文|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

初创公司估值|AI学者引用榜|Google Scholar|学术引用量|商业经济|AI产业应用|社会人文|人工智能

2026年春,北京中关村的投资人办公室里,商业计划书被堆在了角落。屏幕上高频刷新的不再是用户增长曲线,而是Google Scholar的学术引用页面——有人靠80万次引用撑起视觉AI的半壁江山,有人凭30万次引用让初创公司直接跻身独角兽。当大模型的Demo惊艳感褪去,资本终于开始追问:到底是谁在为AI浪潮贡献真正不可替代的技术?这一切的起点,是一张在产研圈疯传的全球华人AI学者引用榜。

你可以把学术引用量理解成科研圈的“点赞+转发”——一篇论文被同行引用越多,说明它在领域内的影响力越大,甚至可能定义了整个技术方向。在AI圈,这个数字如今直接和公司估值挂钩:4万次引用是顶尖独角兽的入门券,10万次以上的学者,其研究往往成为整个时代的技术底座。

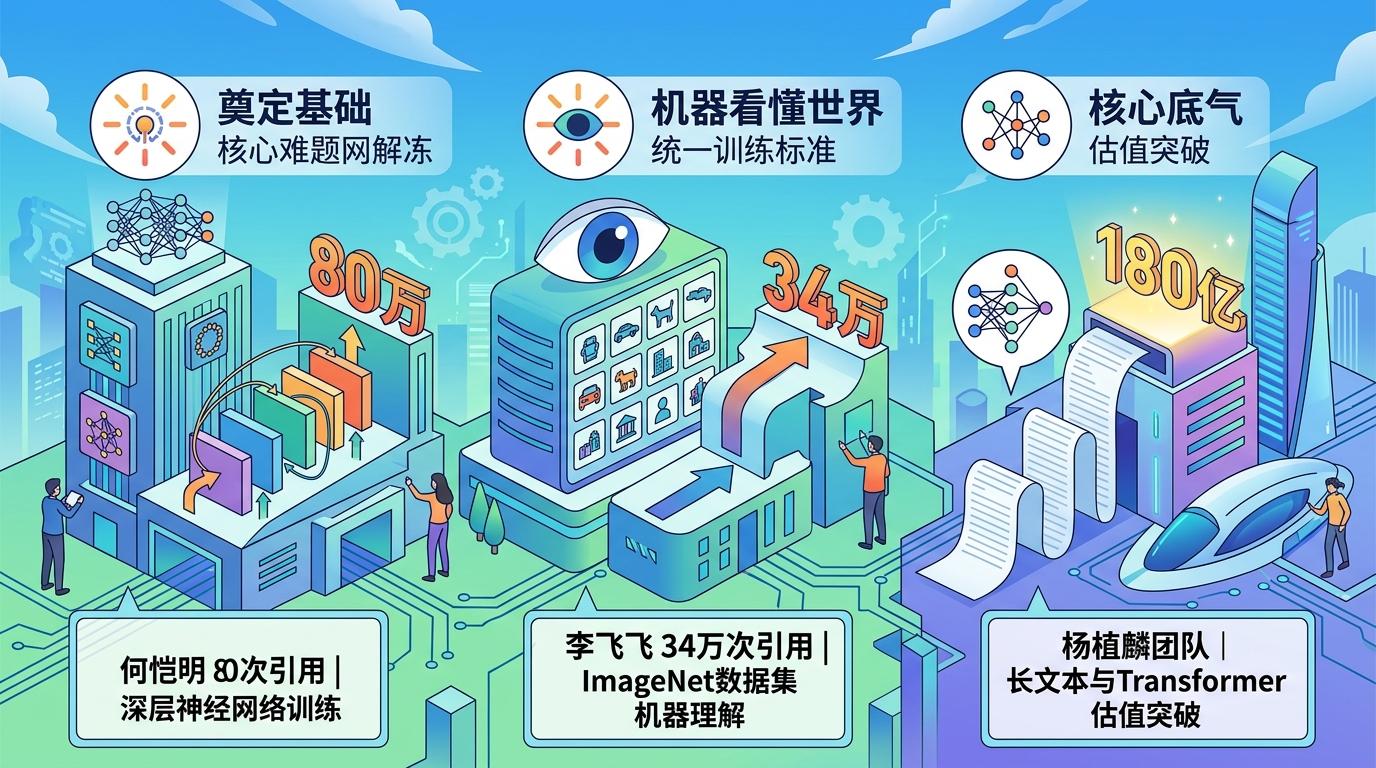

何恺明80万次引用的ResNet,解决了深层神经网络训练的核心难题,直接奠定了视觉AI的基础;李飞飞34万次引用背后的ImageNet数据集,让机器“看懂世界”有了统一的训练标准。而杨植麟团队在长文本和Transformer方向的积累,成为其公司估值突破180亿美元的核心底气。

但真实的逻辑比这更精确:引用量的本质,是学术共同体对“技术增量”的盖章认证。当资本不再相信“下一个爆款应用”的故事,这份认证就成了判断技术壁垒最客观的标尺。

高引用量的价值,不止于当下的技术壁垒,更在于一种被称为“技术复利”的能力——就像滚雪球,每一轮技术积累都能成为下一次创新的起点,而不是被技术迭代清零。

第一层复利是范式判断能力。学术团队习惯在信息不完整的环境下工作,他们擅长在技术方向尚未明确时建立假设、快速验证,这让他们能提前捕捉到范式转移的信号。比如当多数团队还在优化模型参数时,有些高引学者已经开始布局多模态融合的底层架构。

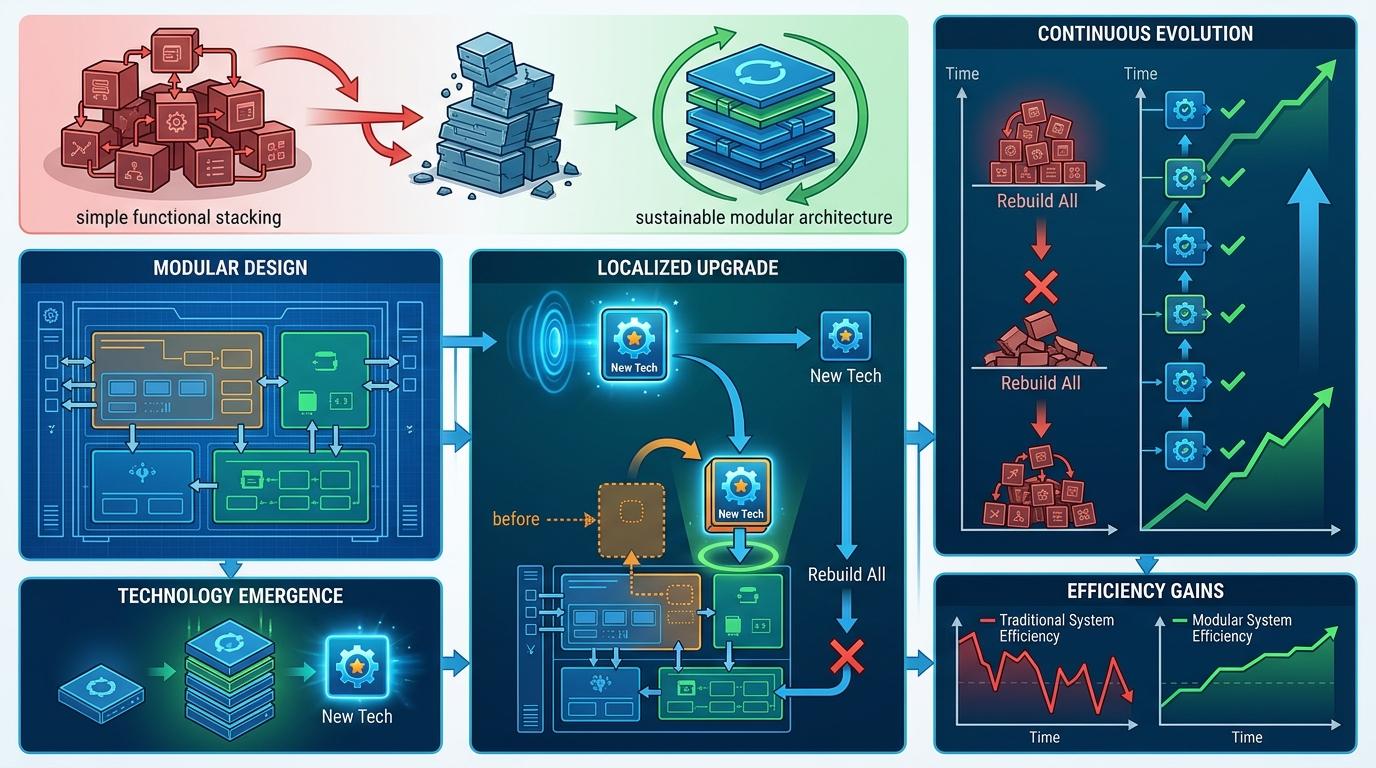

第二层是技术结构认知。他们不会把系统做成简单的功能叠加,而是构建可持续演进的模块化架构——当新技术出现时,只需要替换局部模块,不用推倒重来。这种设计,让团队能在技术迭代中始终保持效率优势。

第三层是人才号召力。顶尖研究者自带“磁吸效应”,优秀人才更愿意加入解决“真正困难问题”的团队,而不是追逐短期热点。这种稳定的人才生态,本身就是最坚固的技术壁垒。

过去,AI创业公司靠Demo和市场故事就能融资;现在,资本要的是“不可替代性”。这种转变,源于大模型能力的趋同——当所有公司都能做出看似惊艳的Demo,真正的差异就藏在底层的学术积累里。

新一代AI公司的估值远超传统垂直领域企业,核心原因在于他们的技术具备“通用能力”,能快速外溢到多个行业。但这种通用能力的基础,依然是学术研究的深度。比如那些在Transformer架构上有深厚积累的团队,能更快适应多模态、长文本等新场景的需求。

当然,这一趋势也暗藏风险。学术引用量并非完美的指标:有些团队可能为了刷引用而追逐热门方向,反而忽视了真正有价值的基础研究;还有些重要的技术突破,可能因为方向冷门而引用量不高。资本过度依赖引用量,也可能错过那些暂时未被学术圈认可的创新。

当AI行业从“讲故事”进入“拼硬功”的阶段,学术影响力终于回到了舞台中央。那些曾经在实验室里写下的论文,如今成了创业公司最硬核的护城河。

技术的价值,从来都不是短期的流量或Demo,而是长期积累下的不可替代性。这或许是AI创业最朴素的真相:真正能走得远的公司,永远是那些为行业贡献了底层技术增量的人。

潮水退去后,才知道谁在真正造浪。