9 天前

9 天前

当你抬手想拍一朵檐角的云,却发现双手正拎着刚买的菜——这种不用腾挪就能留存瞬间的场景,正在从想象落地成日常。一款搭载分体式架构芯片的智能眼镜,正把「解放双手」从一句口号变成真实的交互逻辑。

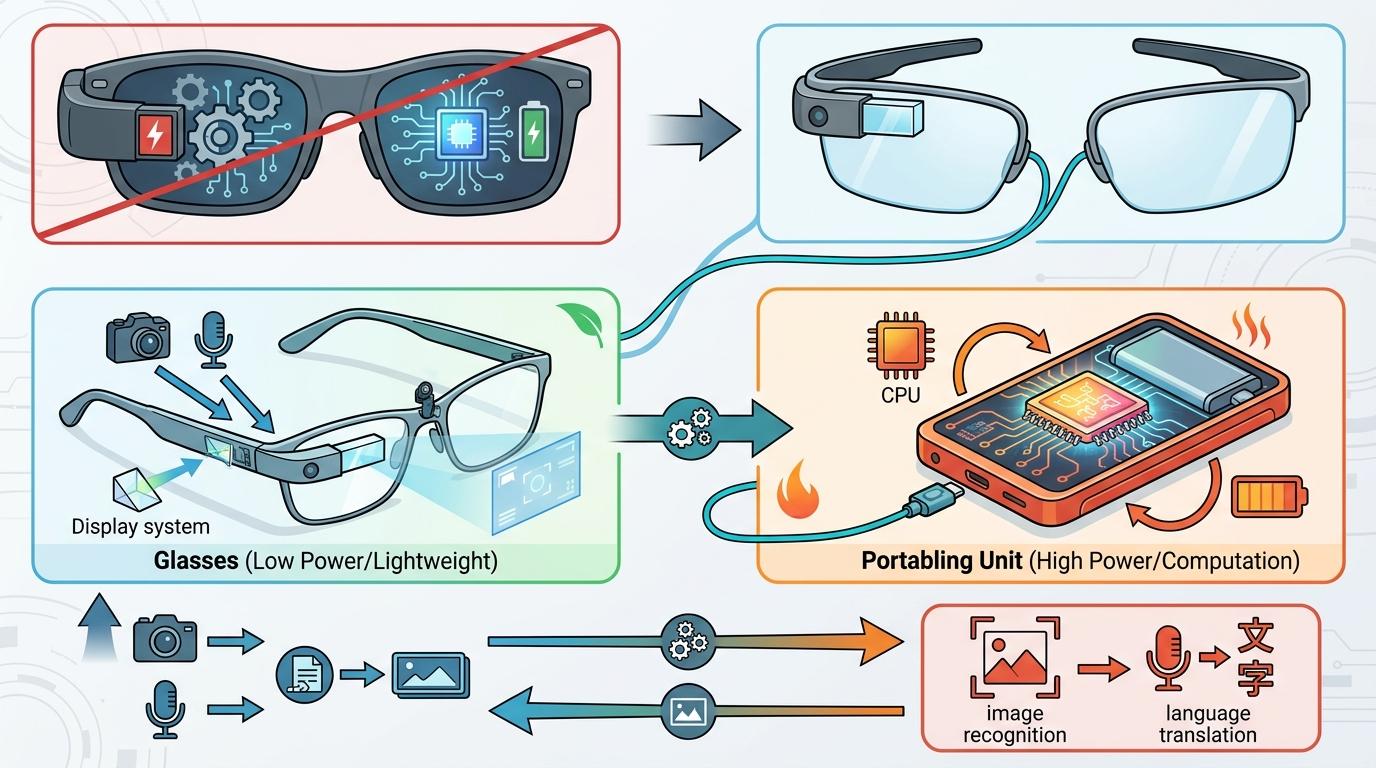

分体式架构的核心,是把计算、显示、传感模块拆解开,让眼镜本体只承担轻量化的采集与显示任务,高功耗的AI运算交给配套的便携处理单元。这就像把电脑的主机和显示器分开,既让眼镜能轻到和普通光学镜无差,又能支撑实时图像识别、语音翻译这类复杂功能。此前这类技术一直卡在功耗与重量的平衡上,如今终于在民用产品上找到可行路径。

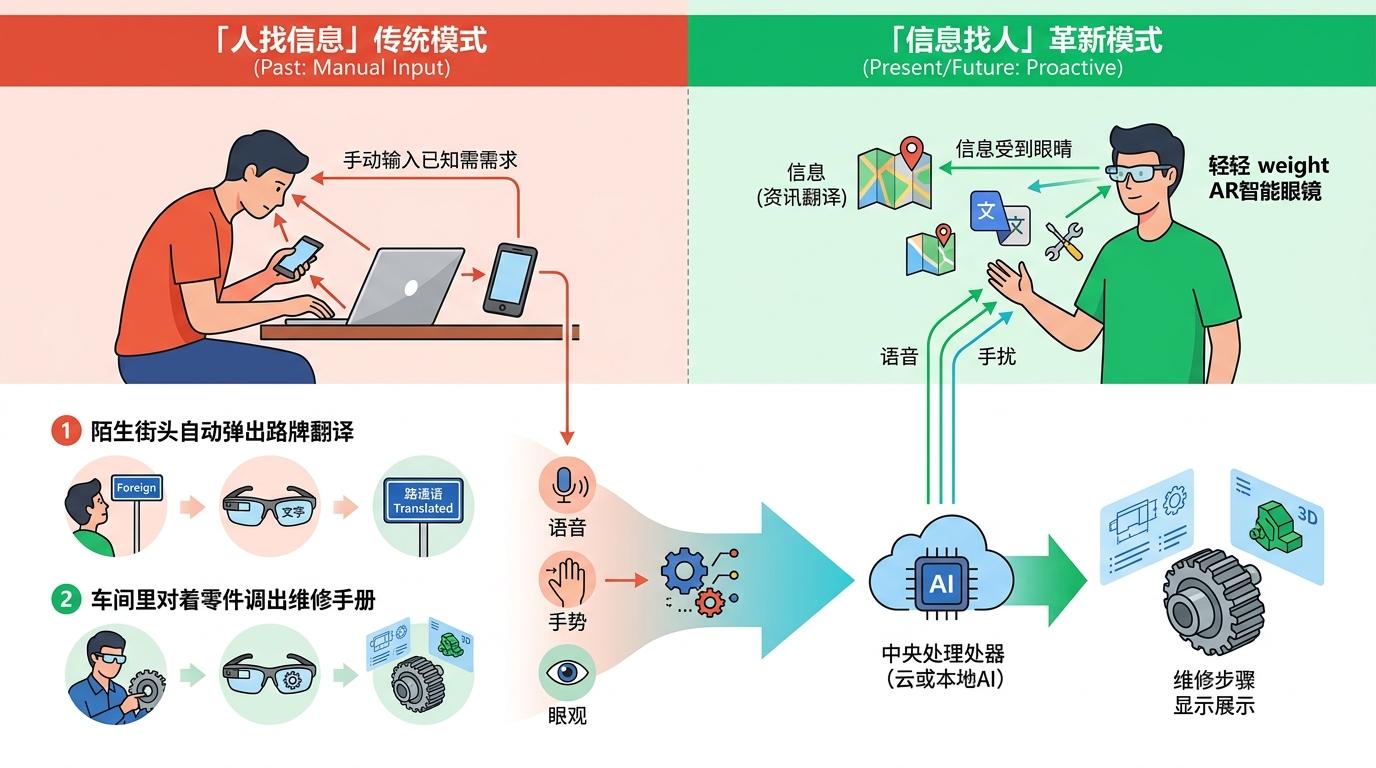

更重要的不是硬件的拆分,而是交互逻辑的重构。过去我们和电子设备的交互,总要盯着一块屏幕,用手指输入指令;现在,智能眼镜能通过语音、手势甚至眼动,在你需要时主动递来信息——比如在陌生街头自动弹出路牌翻译,在车间里对着零件调出维修手册。这种「人找信息」到「信息找人」的转变,才是真正的革新。

但热闹的技术突破背后,藏着还没补全的短板。隐私问题首当其冲:始终在线的摄像头和麦克风,像个随时张开的感官网,如何界定公共空间与私人边界?还有续航,即使分体式架构能降低功耗,目前多数产品的续航仍停留在半天水平,全天候佩戴还只是个目标。更不用说生态的碎片化,不同品牌的设备像一个个孤岛,跨设备协同还远未顺畅。

这些问题不是技术难题,而是人机关系的新考题。智能眼镜的终极形态,从来不是把手机戴在脸上,而是成为人的「延伸感官」——它懂你的语境,尊重你的边界,在你需要时出现,不需要时隐身。

当技术不再是冰冷的工具,而是能感知温度的伙伴,我们才算真正推开了人机共生的那扇窗。

点击充电,成为大圆镜下一个视频选题!