对抗知识焦虑,从看懂这条开始

App 下载

200亿绑定芯片厂,OpenAI赌的不是芯片是算力

算力采购模式|AI芯片投资|大规模数据中心|Cerebras|OpenAI|AI算力|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

算力采购模式|AI芯片投资|大规模数据中心|Cerebras|OpenAI|AI算力|人工智能

当你还在好奇AI聊天框的下一句回复时,OpenAI已经砸出了超过300亿美元——不是用来训练新模型,而是买芯片、建数据中心,甚至入股了一家芯片公司。这家名叫Cerebras的公司,做的芯片有餐盘那么大,是普通GPU的56倍,推理速度却能快20倍。更耐人寻味的是,OpenAI不是直接付钱买货,而是把采购、投资、融资拧成了一个环:买芯片的钱可以算成资产,投数据中心的钱能抵成本,连股权都和采购量绑定。这哪里是买硬件,更像是在给自己的算力命脉上保险。为什么一家AI公司要花这么大代价绑定芯片厂?这背后藏着AI行业最核心的生存逻辑。

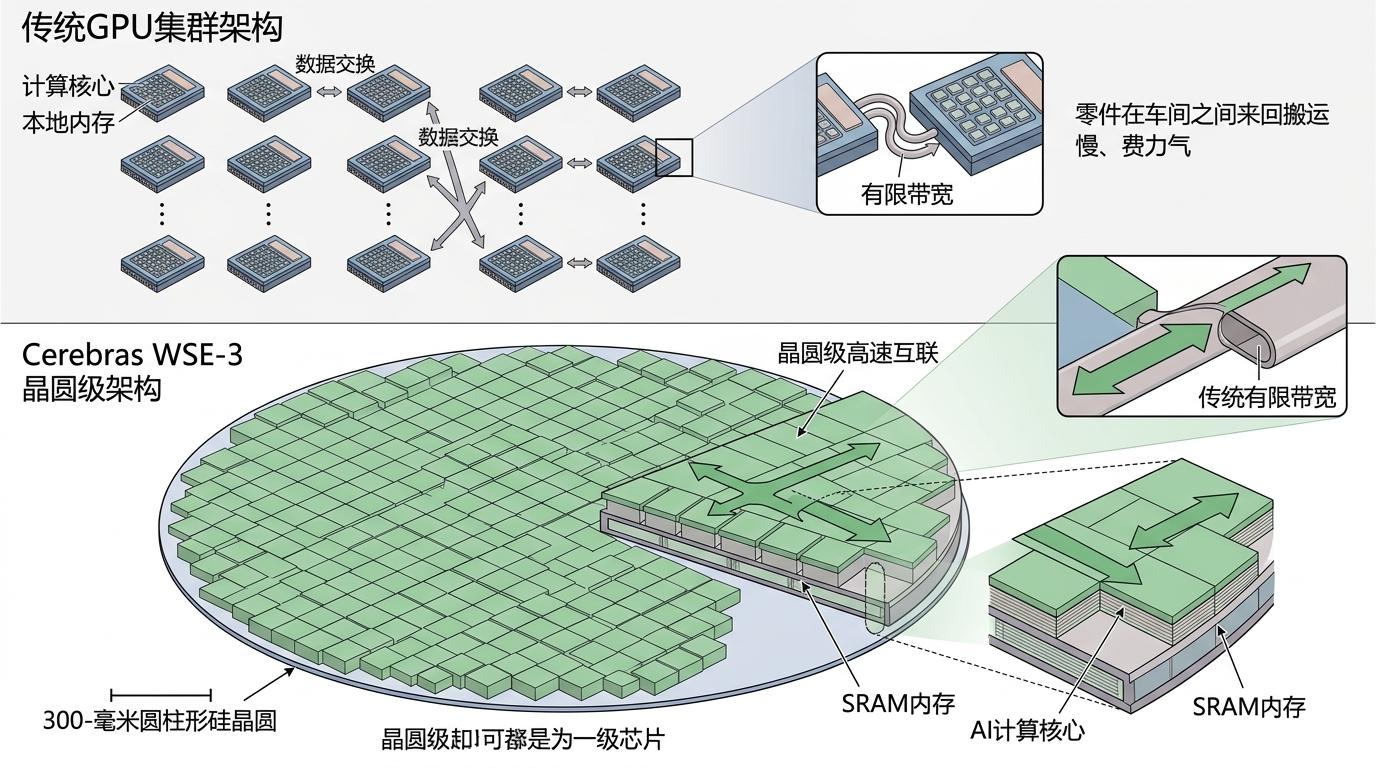

你可以把传统GPU集群想象成一群各自为政的小作坊:每个GPU是一个小车间,要做个大项目,得把零件在车间之间来回搬运,不仅慢,还费力气。而Cerebras的晶圆级引擎3(WSE-3)芯片,是把整个工业园区塞进了一块芯片里——它用一整片300毫米硅晶圆直接做成单芯片,集成了85万个AI计算核心、4万亿个晶体管,内存带宽是普通GPU的7000倍。

简单说,别人要靠几百上千个GPU来回传数据,它在自己内部就能把活干完。在AI推理的核心环节「解码」上,它的速度是GPU的25倍,单位功耗却低得多。对于OpenAI这类需要实时响应用户请求的平台,这意味着同样的电力成本,能处理的请求量翻了好几倍;用户等回复的时间,能从几秒压到几百毫秒。

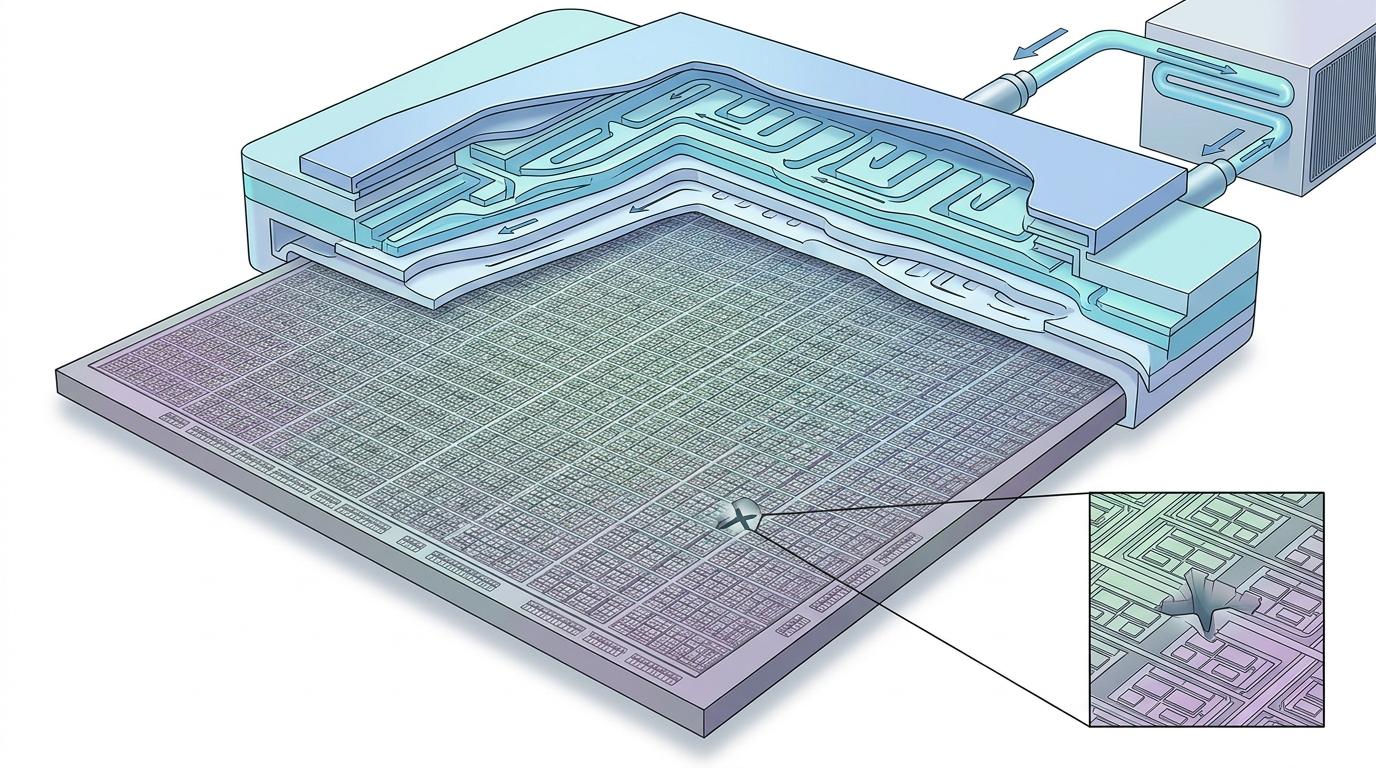

但这技术也不是没有门槛:整个晶圆做一块芯片,只要有一个小瑕疵就可能报废,良率控制难度极高;散热更是个大问题,得专门设计液冷系统。Cerebras花了10年才把这套技术落地,而OpenAI的大订单,相当于给它的量产能力投了信任票。

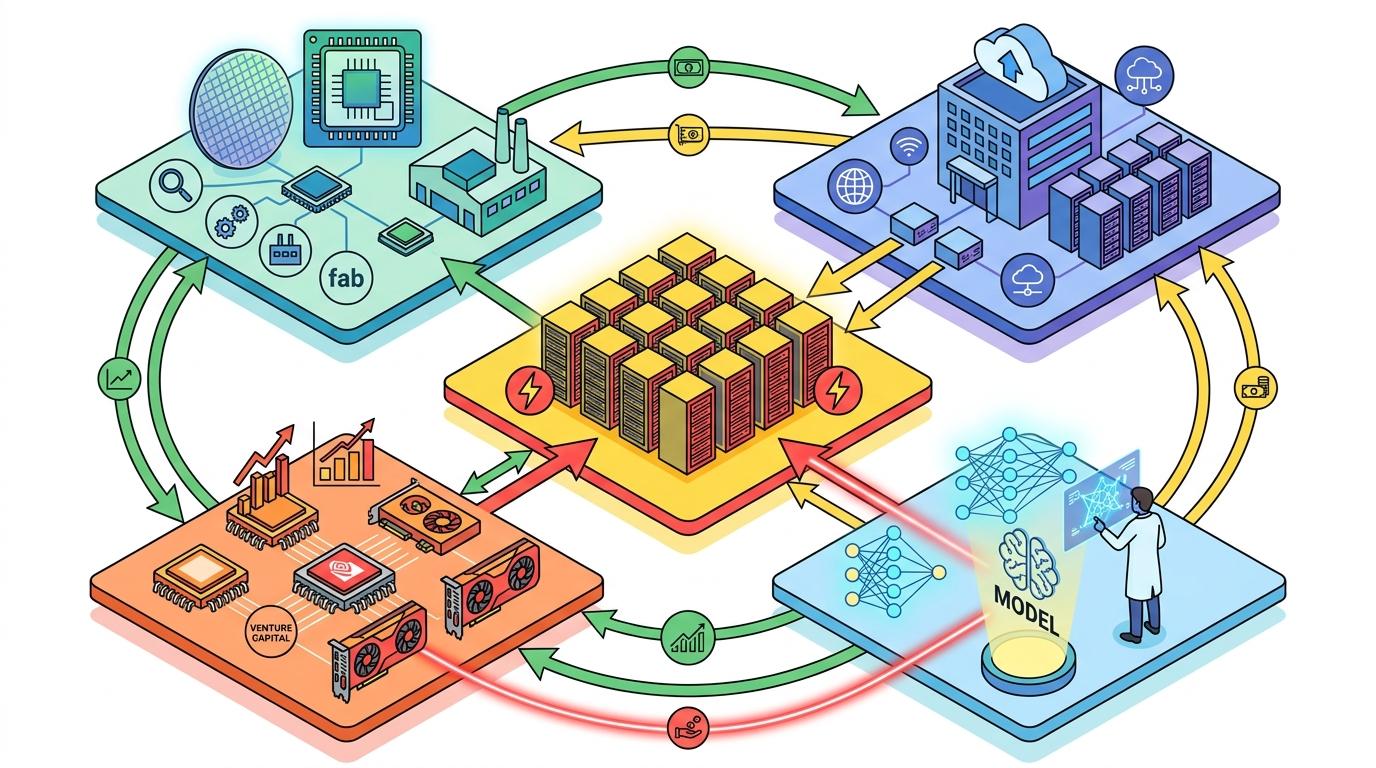

OpenAI和Cerebras的合作,远不止「客户-供应商」那么简单:未来三年花200亿美元买芯片,同时拿10亿美元帮Cerebras建数据中心,还能获得对方的股权认股权证。这种玩法,本质是把「采购成本」变成了「投资资产」。

从财务上看,OpenAI可以把投给数据中心的钱记为长期资产,把部分芯片采购款算成利息收入,直接抵消算力支出的成本——这对于正准备IPO的OpenAI来说,能让财报好看不止一个档次。而Cerebras拿到了稳定的大订单和资金,不仅能解决产能扩张的问题,还能靠OpenAI的背书冲刺350亿美元估值的IPO,一举摆脱之前依赖单一客户的风险。

这已经成了AI行业的通用玩法:OpenAI同时入股了AMD,英伟达投资了云服务商,云服务商又绑定了芯片厂——整个产业链像一张互相交织的网,你投我,我买你的货,大家一起出钱建数据中心,把算力的成本和风险分摊到整个生态里。毕竟,现在训练一个大模型要花上亿美元,单靠一家公司扛,没人能撑得起指数级增长的算力需求。

但这种绑定也藏着隐患:如果AI行业的增长速度不如预期,整个资本循环就可能断裂——就像当年互联网泡沫里,公司互相买广告撑营收的游戏一样。

为什么所有AI公司都在疯抢算力?因为AI的竞争,已经从「谁的模型聪明」变成了「谁能支撑更多人用模型」。

现在训练一个大模型的计算量,每6个月就翻一倍;而推理的算力需求,增长速度是训练的10倍——毕竟训练只需要一次,推理却要服务每一个用户的每一次请求。OpenAI的用户量每涨一倍,算力需求就要涨好几倍,要是跟不上,用户体验就会崩盘。

更关键的是,算力正在变成一种战略资源。美国的数据中心电力需求到2035年要翻4倍,光是AI服务器的功耗,就比普通芯片高5-8倍。现在各国都在抢芯片产能、抢电力资源、抢数据中心用地——谁先把算力基础设施建起来,谁就能把AI的门槛抬得更高,让后来者根本追不上。

OpenAI绑定Cerebras,也是在摆脱对英伟达的依赖。之前OpenAI90%的算力都来自英伟达,一旦英伟达断供或者涨价,整个公司都会陷入被动。现在它一边继续买英伟达的GPU,一边扶持Cerebras、AMD这些竞争对手,相当于给自己的算力供应链上了双保险。

当我们谈论AI的未来时,我们总在说模型、算法、应用,却很少注意到那些藏在幕后的芯片和数据中心。但实际上,谁掌握了算力,谁就掌握了AI的未来——就像谁掌握了石油,谁就掌握了工业时代的命脉。

OpenAI砸出的300亿美元,买的不是芯片,而是一张未来十年的算力入场券。它和Cerebras绑定的不只是资本和技术,更是整个AI行业的生存逻辑:在这个算力需求爆炸的时代,没有一家公司能独善其身,大家只能抱成团,一起把蛋糕做大,同时分摊随时可能到来的风险。

算力为王,不是口号,是AI时代的生存法则。