对抗知识焦虑,从看懂这条开始

App 下载

AI修商品图不再翻车,高频特征是关键

扩散模型|商品图像修复|香港中文大学|中国科学院大学|HiFi-Inpaint模型|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

扩散模型|商品图像修复|香港中文大学|中国科学院大学|HiFi-Inpaint模型|多模态视觉|人工智能

打开电商平台的AI生成商品图,你大概率会撞见这样的尴尬:模特手里的口红管身Logo拧成了麻花,零食包装上的配料表变成乱码,运动鞋的编织纹理糊成一片模糊的色块。这些细节上的破绽,让看起来完美的“真人带货图”瞬间露馅——而这正是AI图像修复卡在商业落地门前的最大门槛。直到中国科学院大学、香港中文大学等团队的HiFi-Inpaint模型出现,那些让品牌商头疼的细节失真问题,终于有了像样的解决方案。

要理解HiFi-Inpaint的突破,得先搞懂AI修图的“老毛病”出在哪。当前主流的图像修复模型大多基于扩散模型,简单说就是让AI从满是噪声的图里一步步“洗”出清晰画面。但这个“洗”的过程天生有个缺陷:它偏爱把图像“平均化”,那些代表细节的高频信息——比如文字的边缘、Logo的线条、纹理的起伏——很容易被当成噪声洗掉。

更糟的是,传统模型用的“隐空间MSE损失”监督信号,就像给AI一张模糊的临摹范本,只能告诉它“大概像就行”,没法精准指出“这个字母的拐角要直,这个纹理的间距要匀”。再加上市面上根本没有足够多标注精准的“人+商品”训练数据,AI连学习正确细节的机会都没有。

你可以把这个过程类比成让一个没见过奢侈品的人临摹名牌包:他能画出包的大致形状,但印在包上的品牌字母、缝线的针脚密度,肯定会错得离谱。

HiFi-Inpaint的核心思路说穿了很简单:既然AI天生会丢高频细节,那就把这些细节单独拎出来,硬塞给它。

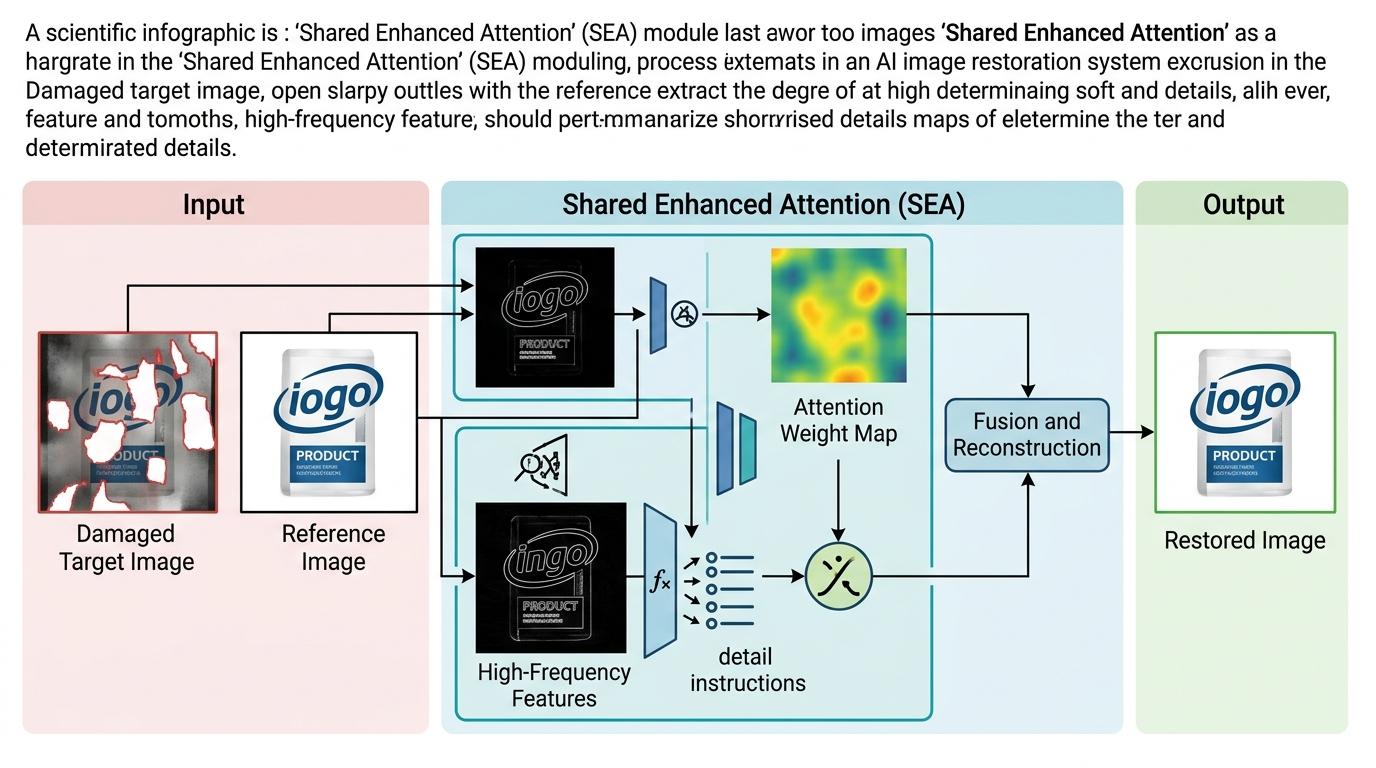

研究团队给模型加了两个关键设计。第一个是共享增强注意力模块(SEA):它就像给模型开了个“细节小灶”,一边让AI处理正常的图像修复,另一边专门把参考商品图里的高频特征——比如Logo的轮廓、文字的笔画——提取出来,转换成AI能读懂的“细节指令”。更聪明的是,这个模块会自动学习一个权重,让细节和整体画面自然融合,不会像硬贴上去的补丁那样突兀。

第二个是细节感知损失(DAL):这相当于给AI换了个精准的临摹范本。传统的监督信号看的是整体模糊轮廓,DAL则专门死盯着高频细节——它会用傅里叶变换把图像拆成高低频,只针对Mask区域里的高频部分计算误差,比如“这个字母的边缘和参考图不一样,重画”。和传统的Canny边缘检测比,它能精准过滤掉背景里的杂乱线条,只聚焦商品上的关键细节。

为了让AI有足够的练习素材,团队还自动合成了4万张“人+商品”的高质量数据集。他们先用AI生成基础图,再用YOLOv8和CLIP反复过滤,确保商品的文字、Logo在每一张图里都完全一致——相当于给AI找了4万个标准的“名牌包临摹样本”。

在测试里,HiFi-Inpaint的表现把之前的模型甩在了身后。在CLIP-I(视觉一致性)、DINO(特征相似度)这些专业指标上,它拿到了当前最优的成绩,其中高频结构相似度(SSIM-HF)比第二名高出近0.1。

更直观的是肉眼对比:用旧模型生成的可乐罐,罐身上的品牌文字扭曲成了乱码;而HiFi-Inpaint生成的罐子,不仅文字清晰可辨,连拉环上的细微纹理都和参考图一模一样。就算把场景换成复杂的户外环境、大姿态的人体,或是转换成漫画风格,它都能精准还原商品的细节。

当然,它也不是完美的。如果参考图和待修复图的光照、视角差异太大,模型偶尔还是会出现细节错位。但不可否认的是,它第一次让AI修图的细节精度达到了商业可用的标准。

当我们还在惊叹AI能生成“以假乱真”的大场景时,HiFi-Inpaint的出现提醒了我们:真正能让技术落地的,往往是那些被忽略的细节。从模糊的轮廓到清晰的针脚,AI图像修复终于跨过了“看起来像”到“用起来行”的门槛。

高频特征不是什么玄乎的黑科技,它更像是一把钥匙,打开了AI“看见”细节的眼睛。未来,当我们在电商平台上看到越来越多逼真的“真人带货图”时,或许不会想起这个模型,但我们会切实感受到:AI正在变得越来越“靠谱”。

高频细节,是AI落地的最后一公里