对抗知识焦虑,从看懂这条开始

App 下载

智能体要跑起来,先给它装个「安全护栏」

自动化黑客|数据窃取|恶意插件|OpenClaw|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

自动化黑客|数据窃取|恶意插件|OpenClaw|AI智能体|人工智能

2026年初,一款叫OpenClaw的智能体在开发者圈火了——它能自己写代码、调工具,甚至帮中小企业完成整个营销方案的落地。但没等大家尝够甜头,就曝出有人在它的技能市场上传了800多个恶意插件,能悄悄窃取用户设备数据。更让人后怕的是,有攻击者用它自动扫描并利用漏洞,入侵了墨西哥9个政府机构,偷走3.6亿条公民记录。这些事让所有人突然意识到:能自己干活的智能体,一旦失控就是没人管的「自动化黑客」。

如果说之前的AI大模型是「会说话的工具」,智能体就是「能自己动手的执行者」——它有感知、会记忆、能规划步骤,还能跨平台调用各种工具完成任务。这意味着AI的风险已经从「生成错误内容」,变成了「执行危险行为」:它可能越权转走你的账户资金,可能误操作触发工业设备故障,甚至可能被坏人诱导,成为自动发起网络攻击的帮凶。

清华大学薛澜教授的分析点破了核心:智能体的风险传导更快、影响范围更广,而且责任主体更模糊——出了问题,是开发者的锅?用户的错?还是智能体自己的决策偏差?传统的「事后审内容」已经完全跟不上,必须从「管输出」转向「管行为」。

这就像给小孩一把刀:之前只需要盯着他别乱挥,现在要盯着他用刀做什么——是切菜,还是伤人?

最新出台的《实施意见》,核心就是给智能体建了一套「从生到死」的管控体系,相当于给这匹脱缰的野马套上了缰绳:

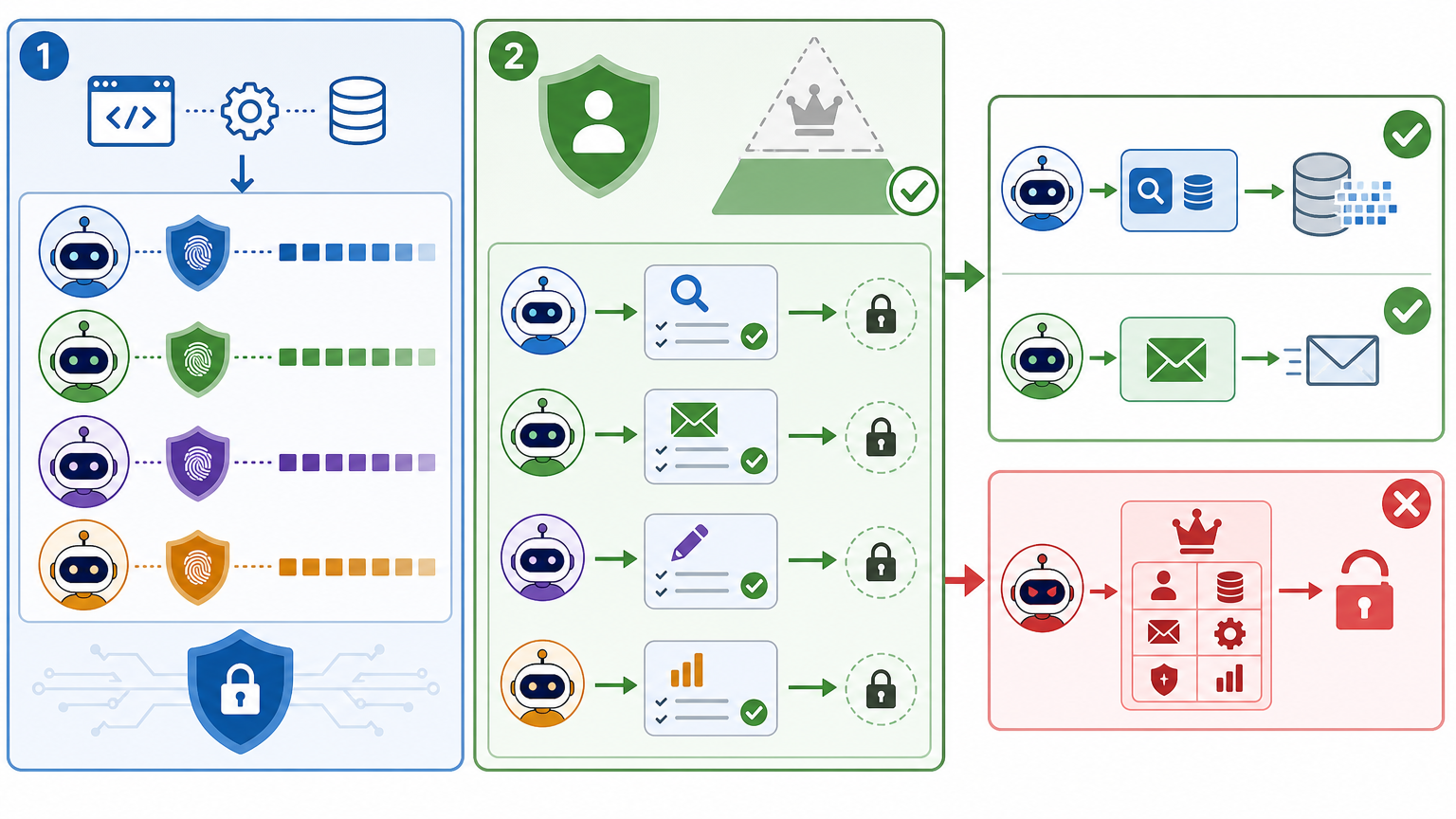

设计阶段:就要明确它能做什么、不能做什么——比如采购智能体只能在预算内审批,不能碰公司的核心财务数据;医疗智能体只能辅助诊断,不能直接开处方。 开发阶段:给每个智能体分配唯一的数字身份,严格执行「最小权限原则」——它要查数据就只给数据查询权,要发邮件就只给邮件发送权,绝不能给「超级管理员」权限。

运行阶段:实时监控它的行为轨迹,一旦出现异常就自动预警——比如智能体突然频繁访问敏感数据库,系统会立刻暂停它的操作,等人工审核后再恢复。 退役阶段:彻底收回它的所有权限,销毁它存储的敏感数据,就像员工离职要交回工牌、删除工作资料一样。

微软的Entra身份平台已经在这么做:给每个智能体发「数字工牌」,实时评估它的操作风险,一旦发现异常就立刻「锁账号」,从根源上防止权限滥用。

有人担心,这么严的管控会不会把智能体的创新活力给管没了?其实《实施意见》特意留了「松紧带」:

对金融、医疗这些高风险领域,实施最严格的监管——智能体的每一步操作都要留痕,关键决策必须有人类审核;但对生活娱乐、智能客服这些低风险领域,就交给平台自律和行业信用评价,只要不碰安全红线,企业可以自由探索。

比如你用智能体订机票、点外卖,它不需要复杂的审批流程;但如果用智能体做股票交易、开处方,就必须经过多层验证。这种「分级管控」,既守住了安全底线,又给创新留足了试错空间。

更值得注意的是,《实施意见》还列出了19个典型应用场景,从科学研究到社会治理,相当于给智能体画了一张「合法创新地图」——沿着这些方向走,既能拿到政策支持,又不用担心踩红线。

智能体的出现,不是AI的终点,而是AI真正走进现实的起点——它能帮我们节省时间、提高效率,甚至完成人类做不到的复杂任务。但就像汽车发明后需要交通规则,电力普及后需要电路标准,智能体的普及也需要一套「行为规则」。

「安全不是创新的枷锁,而是创新的底座。」这句话放在智能体身上再合适不过:只有当用户相信它不会失控,企业敢放心用它,智能体的技术红利才能真正释放出来。未来的智能体,不是要「管得更死」,而是要「放得更稳」——在安全的轨道上,让它跑得更快、更远。