对抗知识焦虑,从看懂这条开始

App 下载

AI预测不再是黑盒,人类要做系统的「刹车」

异常数据处理|人机协作|可解释性|AI预测系统|中科大团队|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

异常数据处理|人机协作|可解释性|AI预测系统|中科大团队|大语言模型|人工智能

当电网调度员盯着屏幕上的负荷曲线时,当金融风控师刷新着实时交易数据时,他们需要的从来不是一个冷冰冰的数字——而是一个能说清「为什么这么预测」「哪里可能出错」的可靠伙伴。过去十年,AI预测模型在精度上突飞猛进,但在真实世界里,它们更像只会输出答案的「考试机器」,遇到异常数据就卡壳,面对复杂场景就露怯,人类只能被动接受结果,出了问题也找不到问责的节点。直到中科大团队推出的这套系统,把「人」重新拉回了预测的核心流程里。

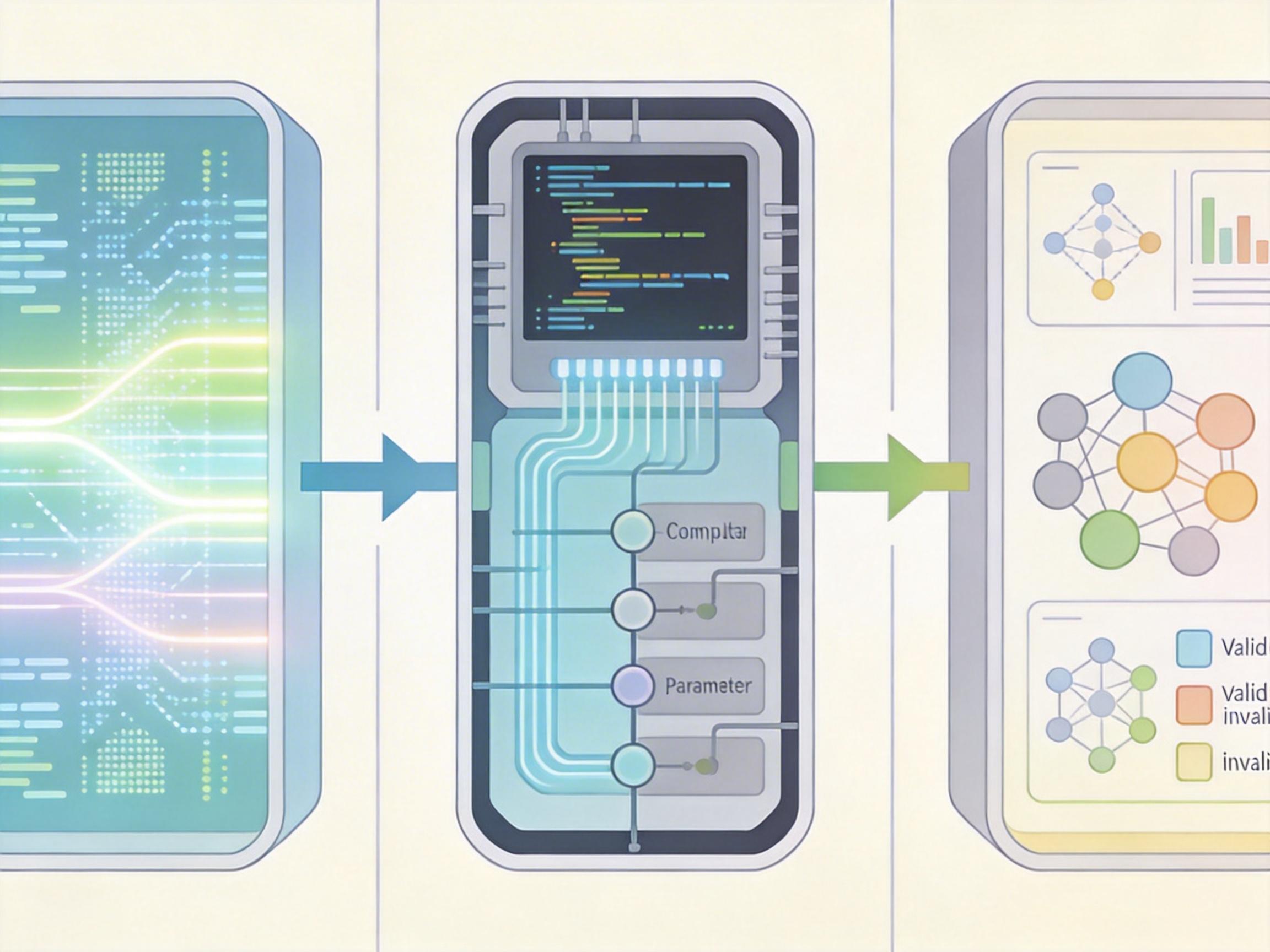

你可以把这套系统想象成一个三人特工小组:「规划者」先摸清楚任务全貌,分析数据里的趋势、异常和行业背景,甚至会去查相关的政策新闻;「执行者」拿着规划好的方案去跑模型,还会自己调整参数、排查失败原因;「审查者」则把所有实验结果汇总,生成带可视化图表的报告,指出哪个模型靠谱、哪个参数拖了后腿。

这三个AI不是简单按顺序干活,而是像真实团队一样随时沟通:执行者跑实验卡壳了,会立刻找规划者重新调整方案;审查者发现结果不对劲,会要求执行者再补做几组验证。更关键的是,人类专家全程握有「否决权」——AI出的规划方案要经过人审核,实验跑偏了人可以随时干预,最终的预测结果也需要人来确认。

这种「多智能体协同」的好处显而易见:过去一个数据科学家要花几天才能完成的分析、调参、报告流程,现在AI团队几小时就能搞定,而且每一步都留痕,出了问题能精准回溯到某一个环节。

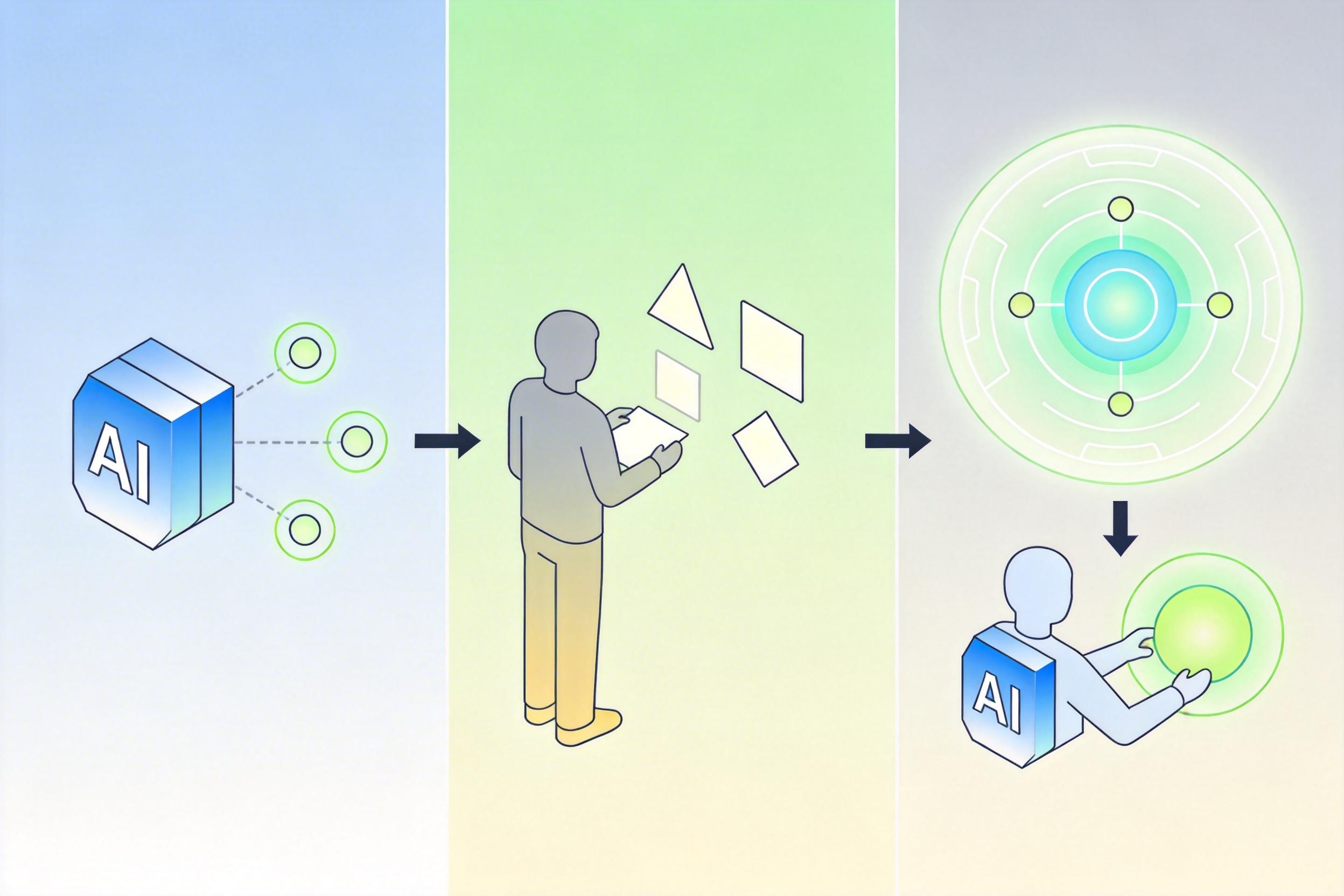

很多人以为AI的终极目标是「取代人类」,但这套系统恰恰反其道而行之——它把人放在了最关键的「刹车点」上。比如在电力负荷预测中,AI可能没意识到下周有个大型展会,或者某条线路要检修,这时候人类专家可以直接把这些信息输入系统,AI会立刻调整预测模型;再比如金融风控场景,AI识别出的高风险交易,最终要不要拦截,还是得由人类风控师根据实际情况判断。

这种「人在回路」的机制,解决了AI最致命的两个问题:一是「黑盒」偏见,AI的预测逻辑往往不透明,人类可以通过审核环节纠正模型的隐性偏差;二是「异常盲区」,真实世界里总有AI没见过的突发情况,人类的经验能补上这个缺口。

当然,这套机制也有局限:它需要人类专家具备AI协作能力,不能只会用传统工具;而且关键节点的人工审核,也会增加一定的时间成本。但在电力、金融、医疗这些高风险领域,「慢一点」远比「错一次」更重要。

这套系统还有一个特别的设计——「技能沉淀」。每完成一次预测任务,AI团队会把这次用到的模型选择策略、参数调整经验、风险点整理成一份「技能文件」,经过人类审核后,存入系统的知识库。下次遇到类似的任务,AI会直接调用这些沉淀的技能,不用从头再来。

比如第一次预测某地区的夏季电力负荷,人类专家指导AI考虑了高温、空调使用、节假日等因素,这些经验会被写成一份「夏季电力负荷预测技能」。下次再做类似任务,AI会自动加载这些规则,甚至还能根据新数据优化参数。

这种「持续进化」的能力,让系统从「一次性工具」变成了「可积累的资产」。企业不用每次都从零开始搭建模型,而是能不断复用之前的经验,降低长期成本。不过这也对数据管理提出了更高要求——技能文件需要定期更新,否则就会变成过时的「老经验」,反而误导AI。

当我们谈论AI预测时,总习惯把「精度」放在第一位,但真实世界的决策,从来不是比谁算得更准,而是比谁能在复杂、不确定的环境中,做出更可靠的判断。这套系统的价值,就在于它重新定义了AI和人类的关系:AI不是取代人类的「对手」,而是放大人类能力的「伙伴」。

未来的时间序列预测,会越来越像一场人机协作的「交响乐」——AI负责演奏精准的主旋律,人类则负责把控节奏、调整细节,甚至在关键时刻按下暂停键。毕竟,再聪明的AI,也替代不了人类对真实世界的理解和判断。

人机协同的本质,是让AI懂规则,让人类掌方向。