对抗知识焦虑,从看懂这条开始

App 下载

1MB模型修出高清夜景,AI轻量化的极限突破

AI竞赛|Retinex理论|夜景照片修复|1MB模型|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AI竞赛|Retinex理论|夜景照片修复|1MB模型|多模态视觉|人工智能

你有没有过这种经历:晚上用手机拍的照片,要么暗得像一团糊,要么亮了却满是噪点,修图软件拉到顶还是像蒙了层雾。2026年的一场AI竞赛彻底改写了这个局面——17支顶尖团队在「模型必须小于1MB」的死命令下,硬生生把手机夜景照修成了堪比专业相机的效果。要知道,1MB还没一张普通壁纸大,却能在手机上实时处理1200万像素的照片。这不是什么黑科技噱头,而是一群工程师在「螺蛳壳里做道场」的极致创新。问题是,他们到底怎么做到的?

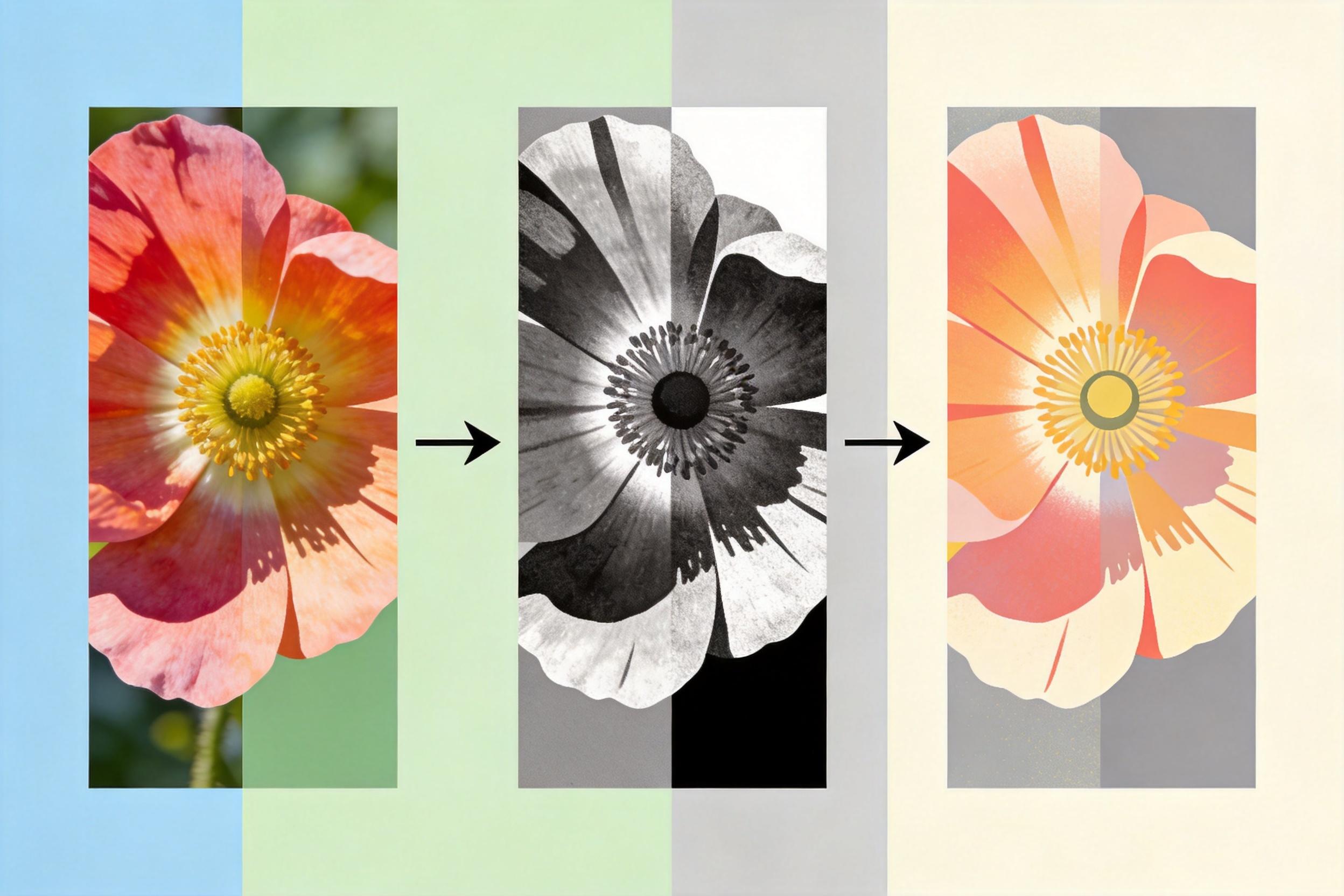

要搞懂这些小模型的魔力,得先从我们的眼睛说起。1963年,科学家埃德温·兰德提出了Retinex理论——我们看到的图像,其实是物体本身的反射率(比如白墙的白)和环境光照(比如夜晚的暗)的结合。低光照片之所以差,就是光照分量拖了后腿。

你可以把这个过程想象成:一张夜景照片是「脏玻璃+窗外的风景」,Retinex理论就是教我们先把玻璃擦干净(调整光照),再还原风景本身(保留反射率)。传统的Retinex方法靠人工调参数,容易擦出划痕(比如光晕、色偏),而AI的作用就是学会自动擦玻璃,还能顺便补好风景里的细节。

这次竞赛的冠军团队,就是在Retinex理论的基础上,用Transformer这个「全局视野工具」代替了传统AI的「局部放大镜」。Transformer能像人看照片一样,同时关注暗角和亮区,不会为了提亮暗部就把亮区曝成白板。

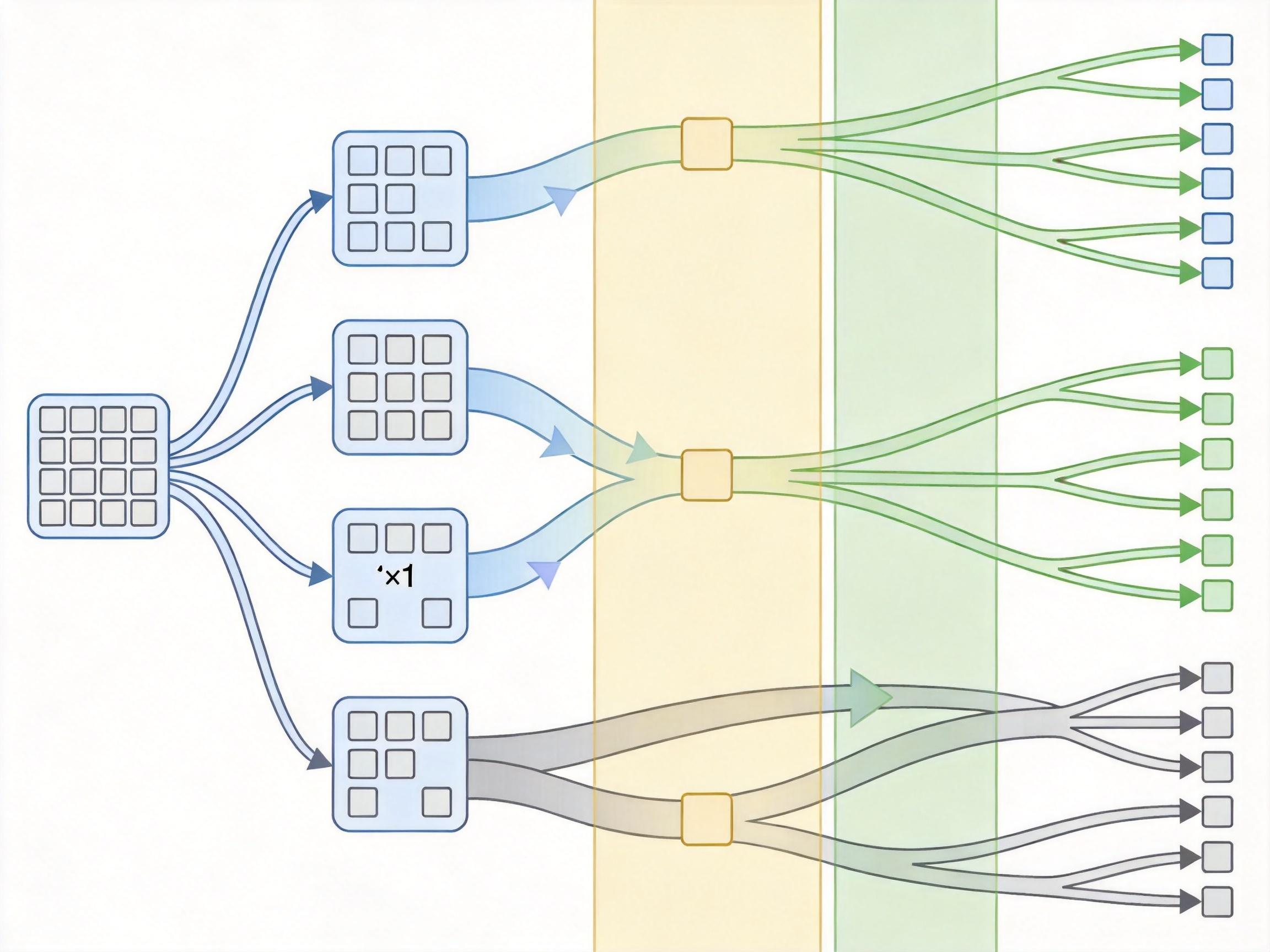

如果说Retinex是「道」,那结构重参数化就是让小模型变强大的「术」。这是一种「训练时复杂,推理时简单」的魔术手法——

训练模型的时候,工程师给它搭了个「多分支工作室」:有负责抓细节的3×3卷积,有负责调全局的1×1卷积,还有负责补漏的残差连接,就像一群分工明确的画师一起画一张画。这个阶段模型虽然复杂,但能学透所有细节,不会漏掉暗部的一根头发丝。

等到要用到手机上的时候,工程师用数学公式把这个「多分支工作室」合并成了一个「单人画室」——所有分支的功能都被整合进一个3×3卷积里。就像把一群画师的技巧浓缩进一个人身上,画出来的效果一模一样,但速度快了好几倍,占用的空间也直接砍到1MB以内。

冠军团队还加了两个「buff」:一是用通道压缩砍掉了冗余的计算通道,就像把画师的工具箱从100支笔精简到10支最常用的;二是用渐进式训练,先让模型学小图的光影逻辑,再放大到1200万像素,避免了一口吃成胖子的混乱。

除了冠军的「Retinex+Transformer+重参数化」组合拳,其他队伍的野路子也值得一看——

亚军团队走了「灰度辅助」的路线:把彩色照片转成灰度图,用灰度图里的清晰结构当「导航图」,引导AI修复彩色细节,就像先画好线稿再上色,既快又准,模型只有55万参数。

季军团队玩起了「传统+AI」的混搭:先用老算法把照片的亮度拉到正常水平,再让AI去补细节,相当于让AI站在传统方法的肩膀上干活,省了不少力气。

还有一支团队直接把模型压缩到了10万参数——相当于一张普通Word文档的大小,靠的是给AI加了「双注意力」:既关注哪里暗,又关注哪里该保细节,把每一个参数都用在了刀刃上。

更值得关注的是,这些团队都避开了一个误区:不是参数越少越好,而是每一个参数都要解决具体问题。比如有的团队为了压缩而砍掉了色彩处理的分支,结果照片修得亮了却偏色严重,反而拿不到好成绩。

这场1MB模型的竞赛,本质上是一场「效率革命」——当我们不再追求越大越好的模型,而是开始琢磨如何用最少的资源解决最实际的问题,AI才真正能走进我们的口袋。

现在的手机夜景模式,要么要等好几秒的多帧合成,要么耗电快得离谱。而这些1MB的模型,能在毫秒级的时间里完成修复,还不怎么耗电。也许再过一年,你拿起手机拍夜景的时候,根本不用等,按下快门的瞬间,一张亮堂、清晰、色彩自然的照片就已经在相册里了。

小模型,才是AI落地的大未来。