对抗知识焦虑,从看懂这条开始

App 下载

别再调提示词了,AI编程要靠工程化

工程化编程|自动代码审查|AI协作系统|Claude Code架构|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

工程化编程|自动代码审查|AI协作系统|Claude Code架构|AI智能体|人工智能

当你还在ChatGPT聊天框里反复修改提示词,复制粘贴代码时,硅谷的工程师已经在自己的代码库里“养”起了AI同事。2026年春,一份意外泄露的Claude Code架构文件撕开了真相:顶级团队早已抛弃“对话式调参”,转而用一套工程化系统把AI变成了能长期协作的项目成员。你只需要配置一次,AI就能自动审查代码、重构架构、写发布说明,甚至记住过去的错误不再重犯。这背后,是AI编程范式正在发生的悄然翻转——从“靠提示词找答案”,变成“建系统让AI自己干活”。

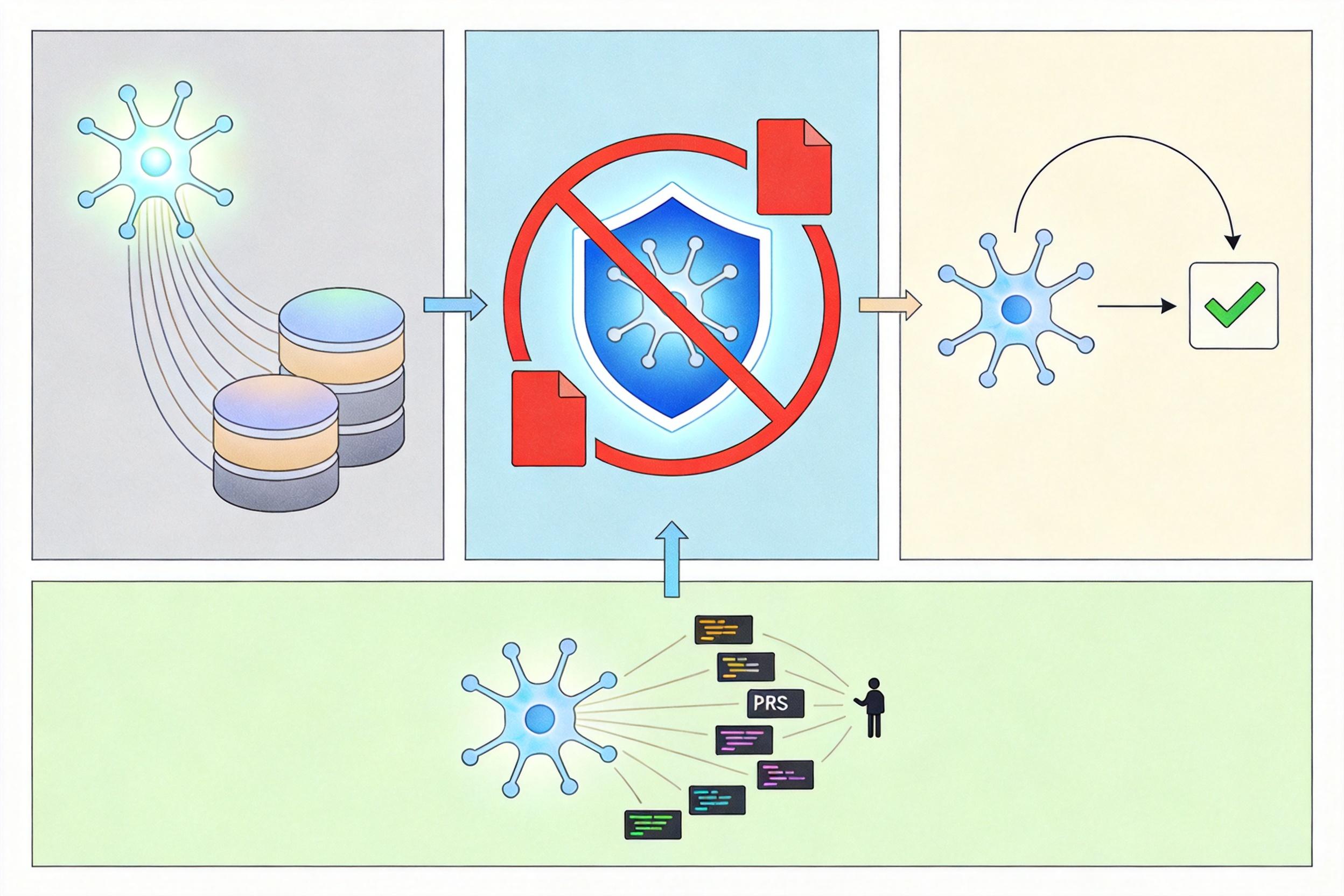

你可以把这套工程化架构想象成一家微型公司:CLAUDE.md是入职手册,写着项目的架构规则、命名规范和踩过的坑;skills/是工作SOP,把代码审查、生成提交说明这些重复活儿封装成可一键调用的模块;hooks/是合规部,用确定性代码在AI犯错前就挡住危险操作;docs/是公司章程,记录着每个决策的来龙去脉。

OpenAI Frontier团队的实验把这套逻辑推到了极致:5个月里,AI代理生成了100万行代码、1500个PR,团队从3人扩到7人,却几乎没人直接写代码。他们的核心不是用了更强大的模型,而是给AI搭了个“脚手架”——用分层架构约束AI的代码逻辑,让linter的错误提示直接变成AI能读懂的修复指令,把所有文档都存在代码库让AI随时查阅。

最关键的是,这套系统会越用越聪明。每次AI犯错,你就往CLAUDE.md里加一条规则;每次重复劳动,就封装成一个skill;每次出bug,就加一道hook护栏。项目经验就这样沉淀成了AI的长期记忆,不用每次启动都重新培训。

如果说大模型是一匹跑得快的马,那Harness就是套在马身上的挽具——缰绳控制方向,马鞍固定位置,笼头约束边界。Martin Fowler把这个逻辑凝练成了公式:Agent=模型+Harness。模型负责智能推理,Harness负责给AI搭好“工作环境”。

Harness的核心是三层机制:上下文管理让AI随时能调用项目记忆;约束与权限给AI划好安全边界,比如禁止删除核心文件;反馈与验证则像个质检员,AI写完代码自动跑测试,错了就自己修复。Stripe的Minions系统就是个典型,每周自动生成1300多个PR,全程不用人写代码,只需要最后人工审核——因为Harness已经把代码质量的底线卡死了。

有意思的是,对Harness的优化往往比换模型更有效。有人做过测试,模型权重不变,只优化Harness的上下文管理和验证机制,系统性能排名能提升20名以上。这也解释了为什么Claude Code的51万行代码里,只有1.6%是AI决策逻辑,剩下98.4%全是Harness的工程代码——真正让AI靠谱的,从来不是模型有多聪明,而是给它搭的架子有多结实。

你不用一开始就搭出OpenAI那样复杂的系统,从最简单的小事就能切入。

第一件事,在项目根目录建一个CLAUDE.md。不用写太长,10分钟就能搞定:把团队的命名规范、禁止踩的坑、测试要求写进去。下次AI犯错了,别着急手动改,先想想是不是CLAUDE.md里漏了规则。

第二件事,把每天重复做的事封装成skill。比如你每天都要写提交说明,就把这个流程写成一个标准化的指令模块,以后让AI直接调用,不用每次都敲提示词。Anthropic的创始人Boris Cherny说过:“每天做某事超过一次,就把它做成skill。”

第三件事,在容易出问题的地方加hook。比如AI经常写错配置文件,就加一个自动校验的脚本,AI一修改就自动检查格式,错了就打回去重写。这部分是最能体现“工程化”的地方——用确定性的规则,代替对AI“自觉性”的期待。

当然,这套系统也不是完美的。AI生成的代码缺陷率比人工高1.7倍,安全漏洞更是个大问题。但这些不是不能解决的——只要在Harness里加更严格的验证环节,比如让AI写完代码自动跑安全扫描,就能把风险降到最低。

当AI从“对话工具”变成“项目成员”,开发者的角色也在悄悄改变:以前是自己写代码,现在是给AI搭环境、定规则、做监督。就像导演不用自己演每一个角色,只需要写好剧本、把控节奏,就能拍出完整的电影。

未来的软件工程,拼的不再是谁写代码更快,而是谁能设计出更高效的AI协作系统。代码会被AI写,但系统要靠人搭。这不是开发者的失业危机,而是一次能力升级的机会——从“码农”变成“AI系统设计师”,用更高效的方式创造价值。