对抗知识焦虑,从看懂这条开始

App 下载

给GAN装个“不确定开关”,解决千人一面难题

图像多样性|Dempster-Shafer证据理论|模式崩溃|生成对抗网络|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

图像多样性|Dempster-Shafer证据理论|模式崩溃|生成对抗网络|大语言模型|人工智能

你有没有过这种经历:让AI画100张不同的人脸,结果出来的全是换了发型眼镜的“孪生兄弟”?这不是你提示词不够好,而是生成对抗网络(GAN)的“祖传绝症”——模式崩溃。过去十年,研究员们试过改损失函数、加正则化、换网络结构,全是在概率框架里“头痛医头”,直到牛津布鲁克斯大学的团队换了个思路:别跟概率死磕了,让模型学会说“我不知道”。他们给GAN装上了一套基于Dempster-Shafer证据理论的“不确定开关”,不仅生成的图像多样性直接追上真实数据,还能标出自己“拿不准”的区域。这到底是怎么做到的?

你可以把GAN的对抗训练想象成一场作弊游戏:生成器是个想蒙混过关的仿画者,判别器是个火眼金睛的鉴赏家。一开始仿画者什么都试,鉴赏家总能挑出破绽;直到仿画者发现,只要专画梵高《星空》的变体,就能稳定骗过对方——于是他彻底躺平,再也不碰肖像、静物。这就是模式崩溃的本质:生成器找到了数据分布里的“舒适区”,彻底放弃探索其他可能性。

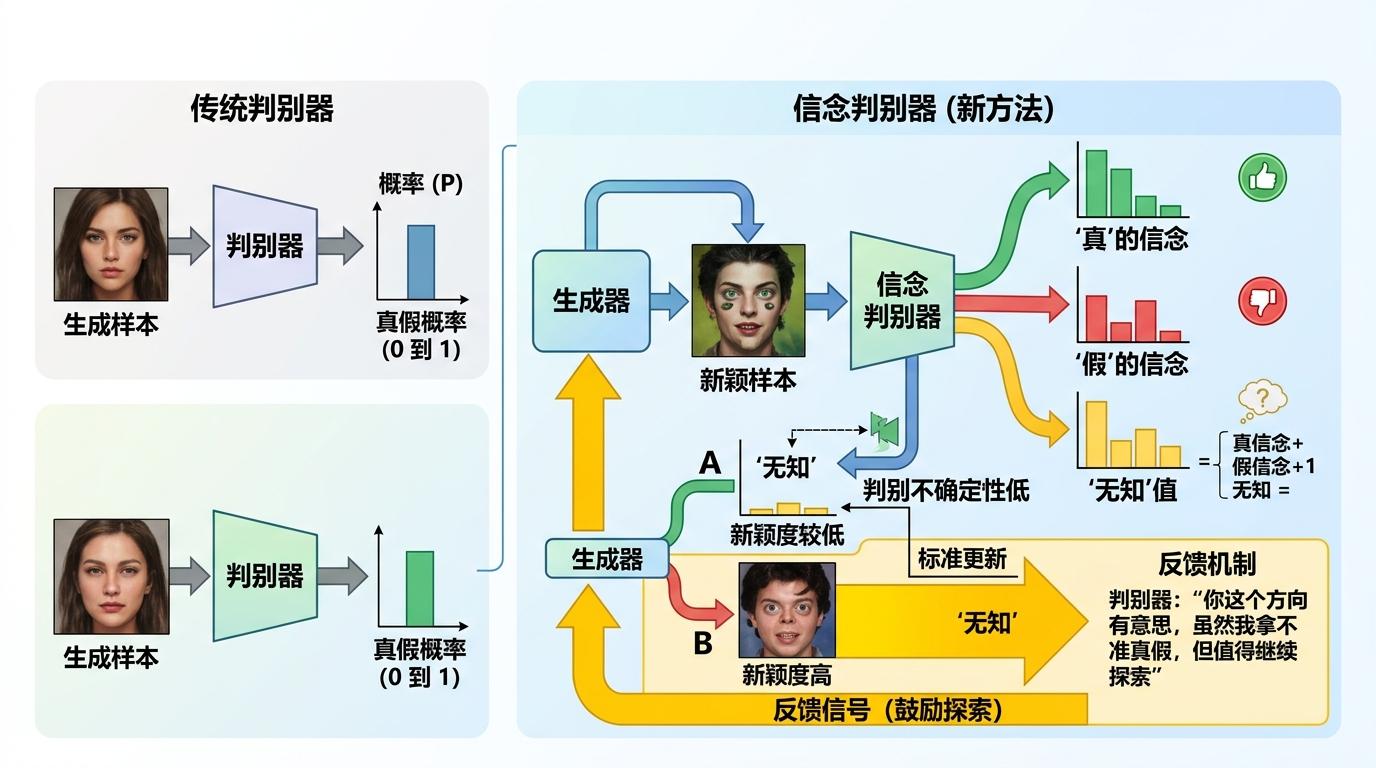

传统GAN的核心问题,就出在“概率”二字上。判别器只能输出0到1的概率值,要么“是真的”,要么“是假的”,没有中间地带。当生成器画出一个介于两种风格之间的新颖样本时,判别器没法说“我拿不准”,只能硬着头皮给个概率——要么鼓励生成器继续走,要么把它打回舒适区。更糟的是,传统概率框架要求必须把所有“赌注”压在明确选项上,哪怕模型毫无头绪,也得硬着头皮分配概率,这就像让医生在没做任何检查的情况下,必须给患者确诊感冒、流感或过敏。

这种“非黑即白”的反馈机制,直接掐死了生成器探索边缘模式的动力。它宁愿在舒适区里反复生成安全样本,也不愿冒险去画那些可能被判别器打回的新颖内容。

牛津布鲁克斯大学的团队引入的Dempster-Shafer证据理论,是一种比概率论更灵活的不确定性建模工具。它的核心思想是:不用把所有“赌注”压在单个选项上,而是可以把“证据”分配给一组可能性。

举个例子,医疗AI判断患者症状时,用概率论必须输出“感冒60%、流感30%、过敏10%”;但用证据理论,它可以说“有50%的证据支持流感,20%的证据支持过敏,剩下30%的证据只能确定是呼吸道疾病,但分不清具体是哪一种”。这剩下的30%,就是“无知”的质量——代表模型的不确定区域。

把这套理论用到GAN上,就诞生了Epistemic GAN(认知GAN):

判别器不再输出单一概率,而是输出两个信念值——对“真”的信念和对“假”的信念,两者之和可以小于1,剩下的部分就是“无知”。当生成器画出一个新颖的边缘样本时,判别器会给出较高的“无知”值,这个信号反馈给生成器,相当于在说“你这个方向有意思,虽然我拿不准真假,但值得继续探索”。

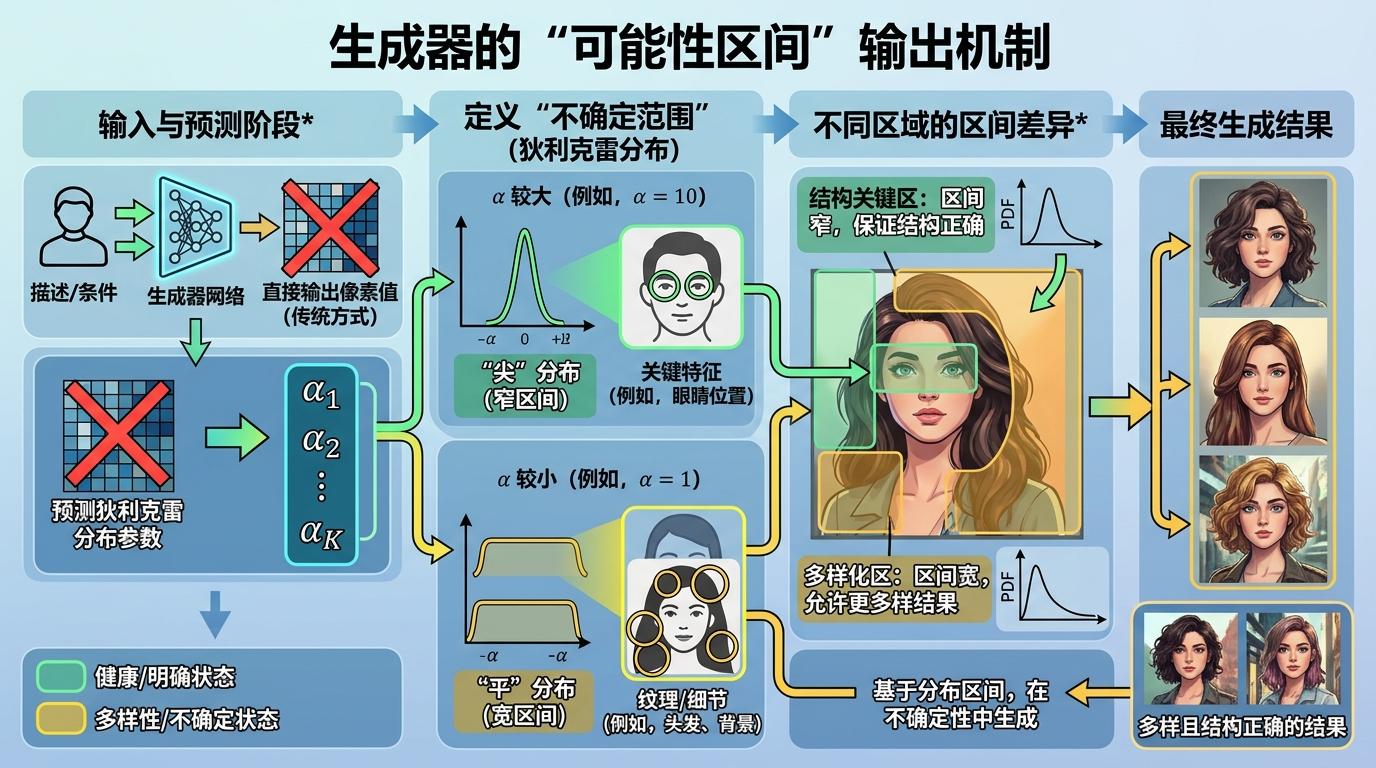

生成器也不再直接输出像素值,而是输出“可能性区间”。它会先预测每个图像区域的狄利克雷分布参数——这相当于给每个区域画了个“不确定范围”:比如眼睛位置这种关键特征,分布会很“尖”,区间窄,保证结构正确;而头发纹理、背景细节这种可以多样化的地方,分布会很“平”,区间宽,允许生成更多样的结果。

这种设计直接从根源上解决了模式崩溃:生成器不再需要为了骗过判别器而死守舒适区,反而会主动去探索那些让判别器“拿不准”的区域——因为这些区域的反馈信号,是鼓励而非惩罚。

实验结果证明了这套方法的有效性:在CelebA人脸、CIFAR-10物体、Food-101食物三个数据集上,Epistemic GAN的FID分数(衡量生成图像与真实图像的相似度)全面低于标准GAN,Vendi分数(衡量多样性)则显著高于标准GAN,甚至逼近真实数据的多样性水平。更惊喜的是,它的训练时间只比标准GAN慢了1.5%——几乎可以忽略不计。

但Epistemic GAN的价值远不止于刷高了几个指标。它第一次让生成模型有了“自知之明”:生成图像的同时,还能输出一份“不确定性地图”,标出哪些区域是它有信心的,哪些是“随便画的”。这在很多严肃场景里至关重要:

比如在医疗影像合成中,医生可以重点关注高不确定性区域,判断这些区域是否符合医学逻辑,避免引入错误特征;在自动驾驶仿真中,如果模型对生成的行人姿态、车辆位置表现出高不确定性,系统可以将其标记为需要额外验证的“边缘案例”;甚至在创意设计中,艺术家可以调节“不确定性权重”,让AI在保持主体结构稳定的前提下,在服饰、天空等区域自由发挥。

更重要的是,这种将经典数学理论与深度学习结合的思路,为AI的“可解释性”和“可控性”打开了新的大门。过去我们只能把AI当黑盒,现在我们可以问它:“你对这个结果有多大信心?”

当我们为AI的“创造力”欢呼时,往往忽略了一个更本质的问题:AI的“创造”到底是探索未知,还是在已知的舒适区里打转?Epistemic GAN的出现,让我们看到了另一种可能:让AI学会“不确定”,反而能释放它的真正潜力。

承认无知,才是探索的开始。

未来的生成AI,不该只是一个只会输出结果的黑盒,而应该是一个能和人类对话的合作者——它会告诉你自己知道什么,不知道什么,甚至会和你一起探索那些“不确定”的边界。从这个角度看,Epistemic GAN的意义,早已超越了解决模式崩溃本身。