18 天前

18 天前

你对着摄像头画了张网页草图,话音刚落,一段带注释的HTML代码已经跳在屏幕上;你举着满是公式的论文页面打断AI的讲解,它立刻停下原话题,指着图里的模块讲起逻辑——甚至你开门的噪音,它根本不会分心。这不是科幻片里的场景,而是多模态AI实时交互的新形态:它能同时“看”“听”“理解”,还能边接收信息边输出结果。

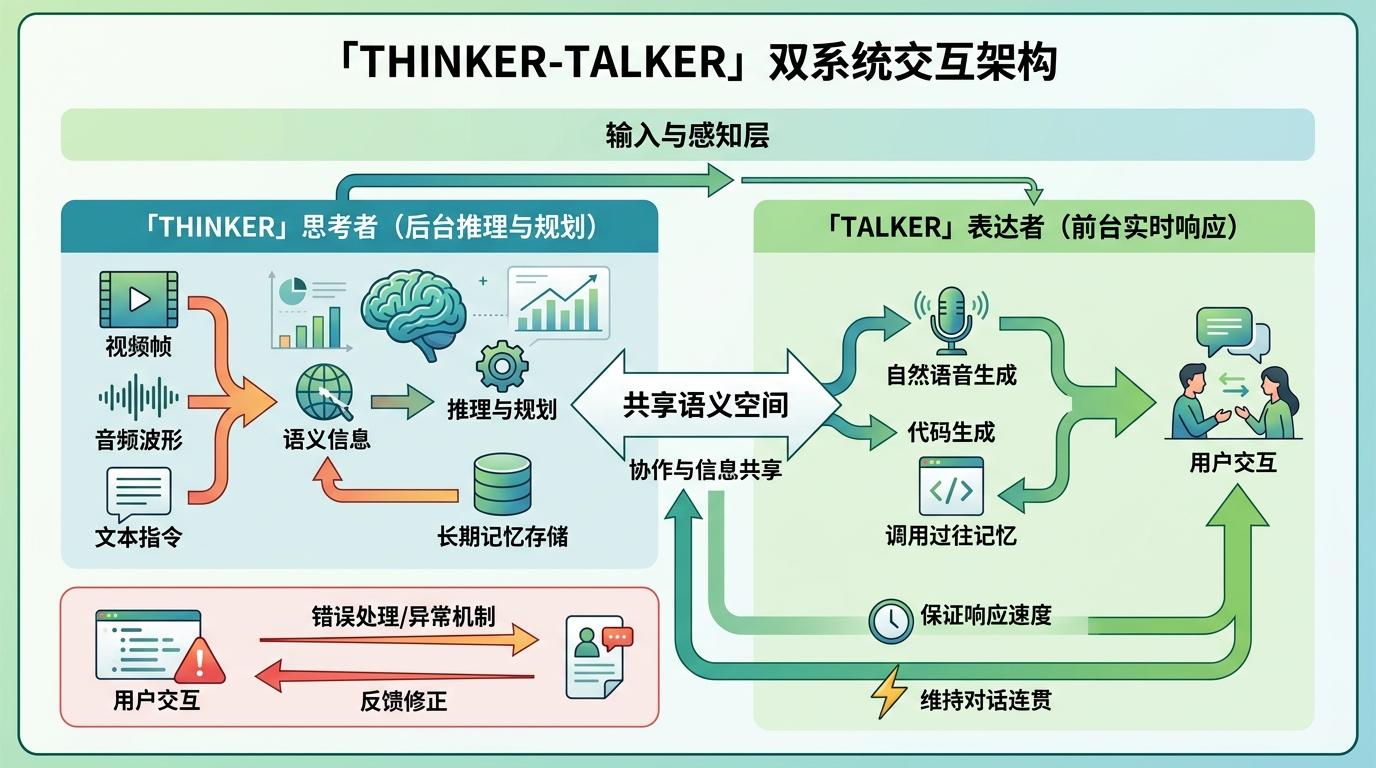

支撑这种流畅交互的核心,是一套名为Thinker-Talker的双系统架构。可以把它类比成一个分工明确的双人组:Thinker是那个躲在后台的“思考者”,负责把视频帧、音频波形、文本指令翻译成统一的语义信息,完成推理、规划这些复杂任务;Talker则是直面用户的“表达者”,它不用等Thinker把所有问题想透,就能根据已有的信息生成自然的语音或代码,甚至能调用之前的“记忆”维持对话连贯。两者通过共享的语义空间协作,既保证了响应速度,又不会丢失思考深度。

要让这套双人组真正“同步”,还得解决一个老问题:AI说话总“嘴瓢”。以前的模型生成语音时,文本编码和语音合成的节奏经常错位,要么漏读数字,要么拖长音节。现在的自适应速率交错对齐技术,相当于给两者配了个动态节拍器——它会根据语义自动调整文本和语音的匹配节奏,比如遇到长句时放慢合成速度,碰到专业术语时加重咬字,让AI的表达终于像真人一样稳定。

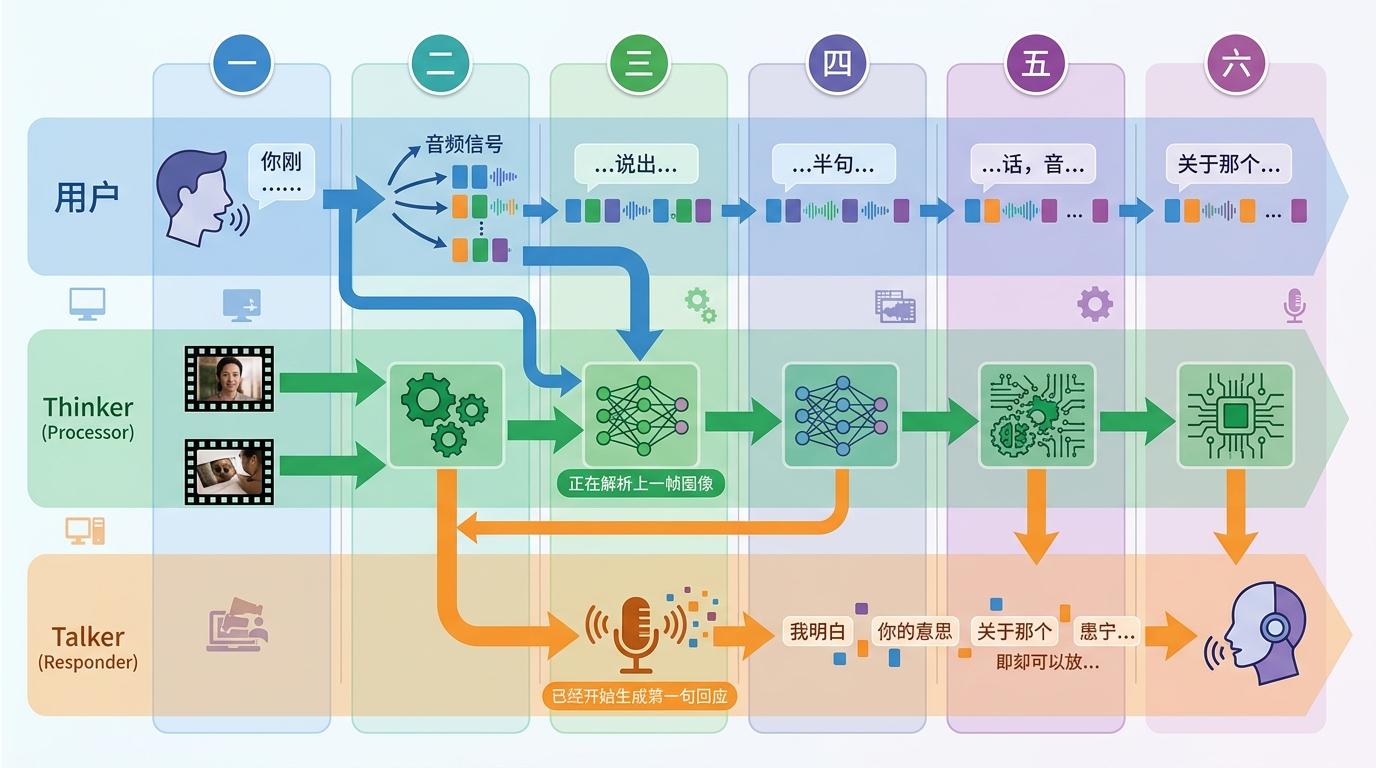

更关键的是,这套系统实现了“流式处理”:你刚说出半句话,音频信号已经被切分成小段送入模型;Thinker还在解析上一帧图像,Talker已经开始生成第一句回应。这种边输入、边处理、边输出的设计,把交互延迟压缩到了人类难以察觉的程度——你不会再经历“说一句等三秒”的尴尬,AI的接话速度,和对面坐个真人没什么两样。

但它还不是完美的。比如面对语义模糊的指令,它可能会优先输出流畅的回应,而非准确的结果;处理超长时间的视频时,依然会出现信息遗漏;更重要的是,它所有的“思考”都基于训练数据里的既有知识,还没法像人类一样产生真正的创意。这些问题,正是下一代多模态AI要啃下的硬骨头。

从键盘输入到语音对话,再到现在的实时多模态交互,AI正在一步步贴近人类的自然沟通习惯。未来的人机协作,或许不再是人类给AI下命令,而是像和同事搭档一样——你画草图,它写代码;你翻论文,它讲逻辑,两者无缝配合,把想法变成现实。

交互越自然,协作越高效。

点击充电,成为大圆镜下一个视频选题!