对抗知识焦虑,从看懂这条开始

App 下载

AI写作泛滥,“人类印记”如何重塑文字权威?

写作逻辑|文字权威|人类印记|AI写作|文化艺术|大语言模型|社会人文|人工智能

2026年的网络世界里,流畅的分析文、规整的学术稿、共情的随笔随处可见,但越来越多人开始感到一种诡异的“空洞”——文字挑不出语法错误,结构逻辑无懈可击,却像没有灵魂的精致标本。这一切的源头,是能以秒速生成合格文本的大语言模型(LLM)。当写作不再需要绞尽脑汁的判断、反复推翻的修订,甚至不需要一个真实的思考主体,我们信奉了数千年的“文字即思想”的认知,正在土崩瓦解。我们不得不重新追问:失去“人类印记”的文字,还能承载文明的权威吗?

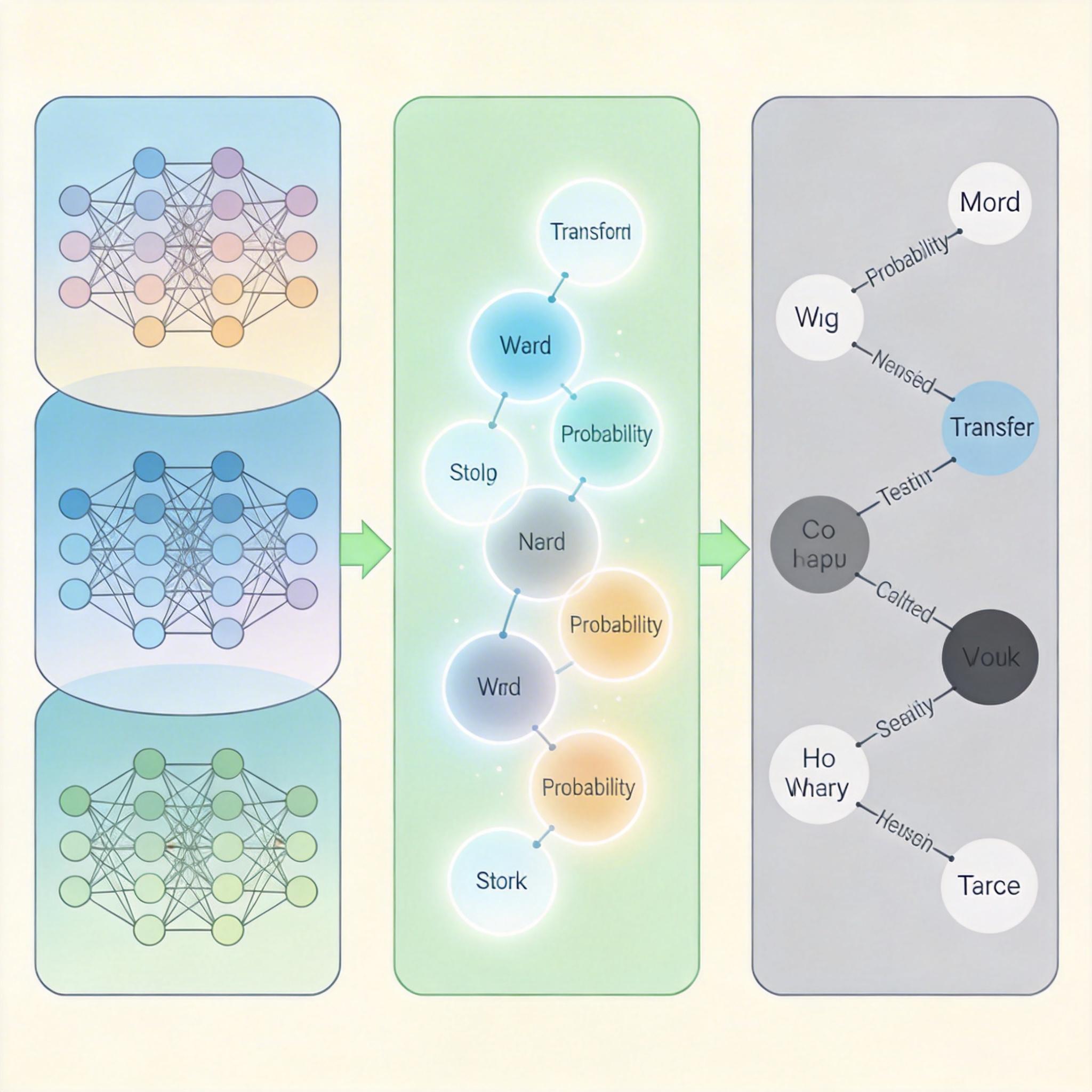

大语言模型:用统计概率“复刻”写作逻辑

大语言模型(LLM)——一种基于Transformer架构的深度学习系统——正在改写写作的底层逻辑。它不需要理解文字的意义,只需要在训练过的万亿级文本数据中,统计预测下一个最可能出现的词。从技术上看,它的生成过程更像“概率拼图”:给定开头,模型会计算每个词在该语境下的出现概率,再通过贪婪搜索、束搜索等解码策略,拼接出语法通顺、结构合理的文本。

这种“无理解生成”带来了两个显著特征:一是风格的“平均化”——AI会自动筛选训练数据中最通用、最安全的表达,避开个性化的“小众”措辞,最终产出的文本像去掉棱角的鹅卵石;二是内容的“浅层化”——它能模仿论证的结构,却无法复刻人类写作中基于真实经历的判断、纠结与突破。比如一篇AI写的旅行随笔,能精准堆砌“治愈”“烟火气”等流行词,却写不出迷路时撞见老巷的错愕,或在山顶看日落时突然涌上的乡愁。

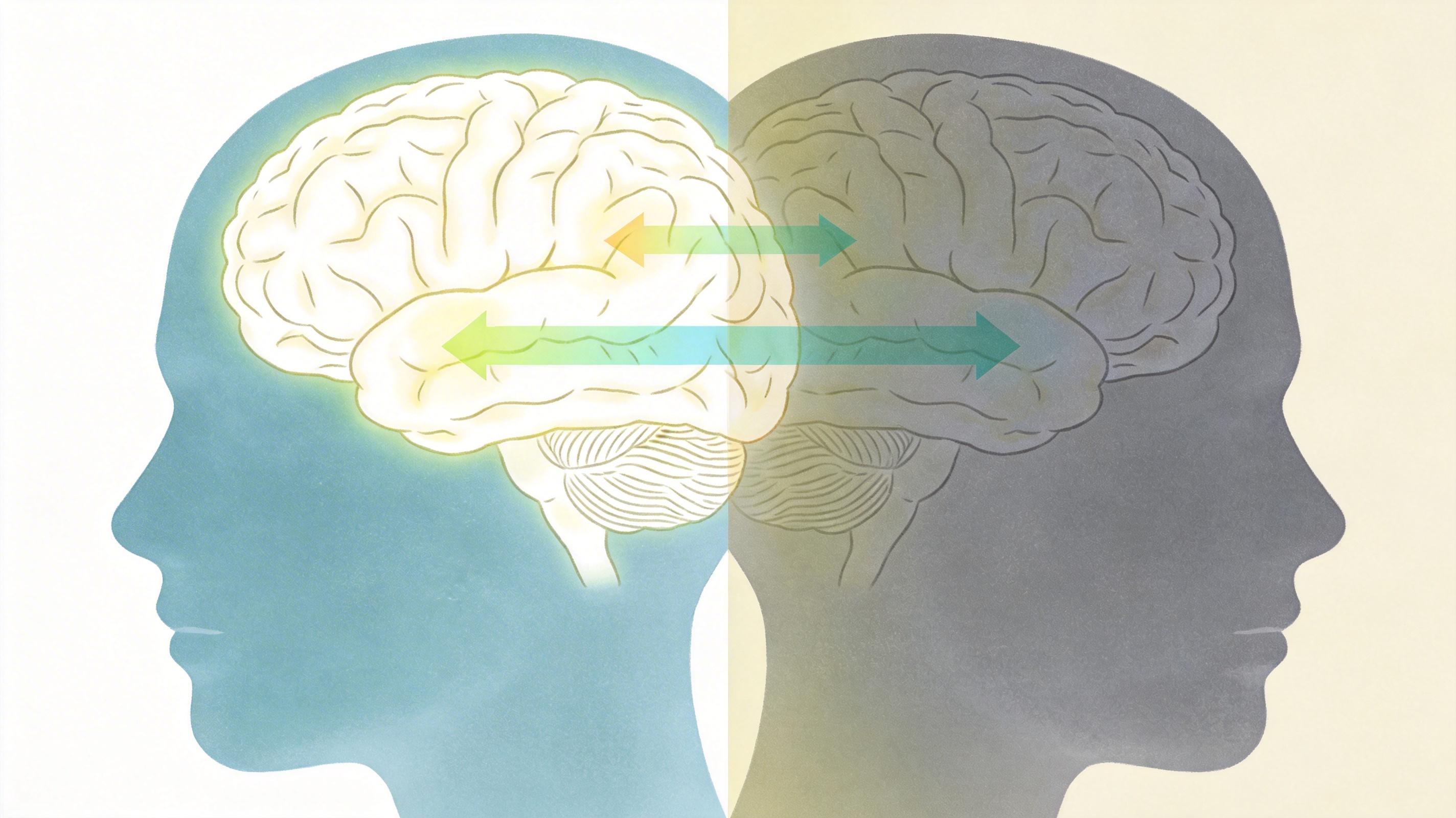

神经科学研究更直接揭露了这种差异:MIT媒体实验室通过脑电图监测发现,使用AI写作的参与者,脑部认知区域的激活度比纯手写者低40%——当AI替人类完成了“思考”的核心环节,写作原本承载的思维训练功能,正在被悄悄消解。

写作的“人类印记”:权威的真正来源

我们信任文字,从来不是因为纸上的符号,而是符号背后的“人类印记”——它是作者为了一个观点翻遍的史料,是写了又删的半页草稿,是为了精准表达反复推敲的措辞,甚至是字里行间不经意流露的偏见与情绪。这种“印记”构成了文字的“传记性”:它来自某个具体的人,带着这个人的经历、挣扎与思考,因此能在读者心中建立起“可信的连接”。

在印刷术普及的数百年里,这种“印记”是文字权威的核心。一本19世纪的科学论文,我们相信它的结论,不仅因为数据严谨,更因为知道作者曾在实验室里反复验证;一首唐诗能流传千年,不仅因为格律工整,更因为我们能从诗句里触摸到诗人的失意与豪情。但AI写作正在斩断这种连接:当一篇文章可以是任何模型、任何用户输入提示词的产物,读者无法再将文字与某个具体的“思考主体”绑定,文字的心理权威也就随之崩塌。

这种变化让柏拉图两千多年前的忧虑突然有了现实意义:当年他担心文字会让人“拥有智慧的假象而非真实”,而今天的AI,正在把这种“假象”批量生产。我们面对的不再是“会不会写字”的问题,而是“写出来的字,还能不能代表思考”的本质追问。

口语回归:寻找思想的新“可见性”

当文字的权威被削弱,人们开始转向另一种更难被AI复制的表达——口语。2026年的公共话语场中,直播辩论、即兴演讲、播客对话的关注度正在超越长篇专栏。这并非偶然:口语的“现场性”是AI难以模仿的核心——它有卡顿、有重复、有情绪的起伏,更重要的是,它可以被即时质询。当一个人在镜头前提出观点,观众可以立刻追问“你这个结论的依据是什么”,而AI生成的文本却无法进行这种实时的、带有思维张力的互动。

这种转向本质上是对“思想可见性”的重新追求:我们不再相信“写出来的就是想清楚的”,而是更愿意相信“能说清楚、能辩明白的才是真思考”。比如2026年的美国大选中,候选人的直播演讲收视率远超其发布的书面政策声明;高校的课堂上,教师开始更看重学生的课堂讨论表现,而非仅看提交的论文。

但这种转向也暗藏风险:口语的“现场性”可能被 charismatic(有魅力)的演讲者利用,煽动情绪而非传递理性。毕竟,“能说会道”不等于“思考深刻”,就像AI的“流畅文本”不等于“有思想的文字”。我们不过是从一个权威的困境,走进了另一个认知的迷宫。

从柏拉图对文字的警惕,到AI时代写作的危机,人类对“思想载体”的焦虑从未停止。文字没有失效,只是它承载权威的基础变了——过去我们靠“文字背后有人”建立信任,未来我们可能需要重新定义“什么是值得信任的表达”。或许真正的答案,从来不在工具本身,而在我们对“思考”的坚守:无论用文字还是口语,能体现判断、挣扎与真实的,才是有重量的思想。

文字的权威,终究源于人的思考。