对抗知识焦虑,从看懂这条开始

App 下载

不用摄像头,雷达也能精准还原人体动作

MIT联合团队|南洋理工|隐私保护感知|人体动作建模|毫米波雷达|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

MIT联合团队|南洋理工|隐私保护感知|人体动作建模|毫米波雷达|多模态视觉|人工智能

想象一下:术后老人在卧室练习走路,智能系统能精准判断他的步态是否稳定,却不会记录下他的白发或皱纹;独居长辈在浴室滑倒,AI能第一时间触发警报,全程没有任何镜头在‘注视’。这不是科幻——南洋理工、MIT等五校联合团队,用毫米波雷达实现了高保真人体建模,让隐私敏感场景的智能感知,终于不用再以‘被看见’为代价。关键是,它的精度已经能比肩传统视觉系统,甚至在复杂环境下表现更稳。这背后到底是怎么做到的?

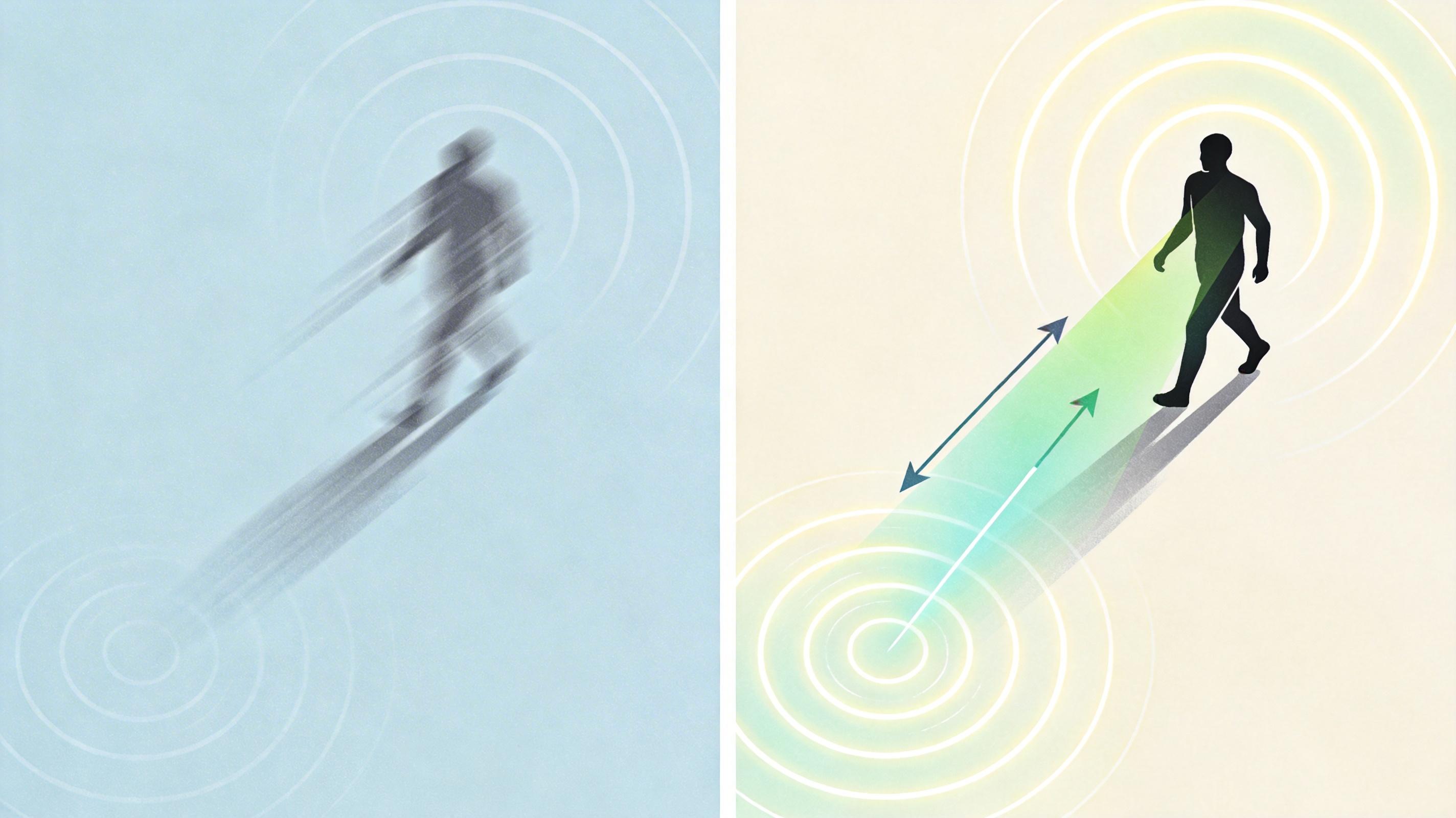

过去的毫米波人体感知,大多停留在‘数骨架点’的阶段——就像用几根火柴棍拼出人的动作,只能判断大概姿势,细节全丢了。更麻烦的是,现有数据集要么规模小,要么只开放经过处理的稀疏点云,就像把一张高清图压缩成像素画,很多关键信息早就没了。

这次团队推出的M4Human数据集,直接把门槛拉高了一个量级:66.1万帧同步数据,是此前最大数据集的81倍;20名不同身高体重的参与者,覆盖50类动作——从日常起身、康复训练到篮球羽毛球这类动态运动全包含。更重要的是,它首次同时开放了**原始雷达张量(RT)**和雷达点云(RPC)。

你可以把原始雷达张量理解成雷达‘看到’的完整‘全息底片’——它保留了电磁波反射的所有空间、强度和时序信息,不像点云只留下经过筛选的‘亮点’。正是这份完整信息,让高精度人体建模成为可能:团队用Vicon动作捕捉系统,给每个参与者贴了37个解剖学标记点,生成的3D人体网格能精准还原关节角度、肌肉拉伸甚至身体重心变化,精度达到厘米级。

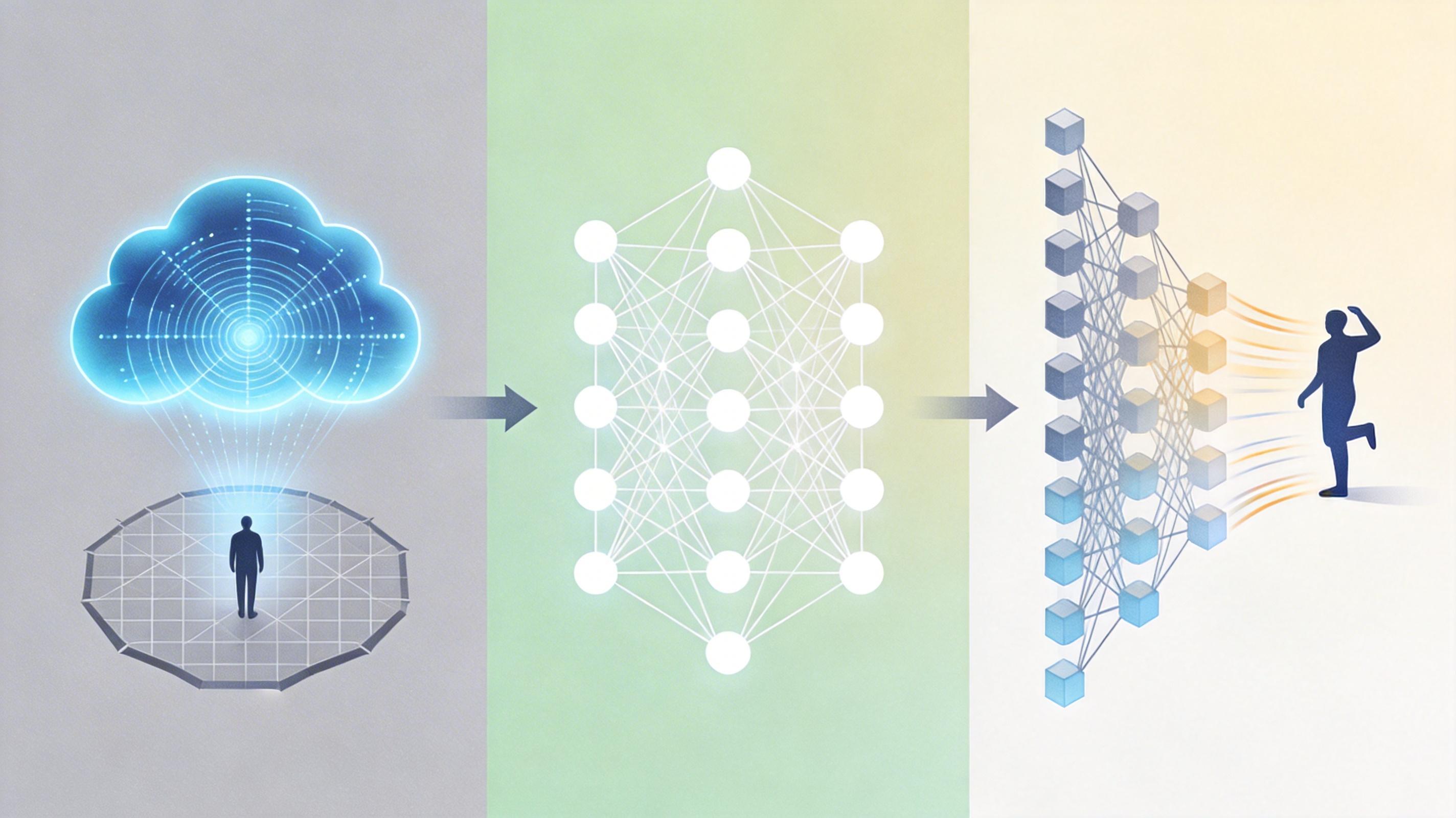

团队配套提出的RT-Mesh模型,是第一个直接用原始雷达张量做人体网格重建的算法。它的逻辑像极了中医的‘望闻问切’:

第一步先‘定位’:把3D雷达数据转换成鸟瞰图,用轻量级网络快速找到人体在空间中的位置,就像先圈出要诊断的区域;第二步再‘细辨’:截取对应区域的原始雷达张量,用3D卷积和Transformer提取细节特征,最终回归出人体的姿态、形状和运动轨迹。

实验结果很直观:在随机测试中,它的精度和RGB-D视觉系统不相上下;而在跨参与者、跨动作的泛化测试中,原始雷达张量的优势彻底显现——比稀疏点云的表现稳定得多,推理延迟却只有2.74毫秒,计算量仅2.6 GFLOPs,完全能在边缘设备上实时运行。

更有意思的是多模态融合:把雷达数据和视觉数据结合后,精度还能再上一个台阶。比如在跟踪人体移动轨迹时,雷达的距离感知能力天生比视觉准;而视觉能补充雷达难以捕捉的细节,二者刚好形成互补。

这可能是最关键的问题:毫米波雷达的隐私友好性,到底是‘噱头’还是真保障?

答案很明确:雷达捕捉的是电磁波反射信号,只能还原人体的轮廓、动作和运动轨迹,完全无法识别外貌、肤色等身份信息——就像用手摸出一个人的体型,却看不到他的脸。而且M4Human数据集在采集时,全程没有用RGB摄像头做标注,从根源上避免了隐私数据的产生。

当然它也有局限:比如在极端遮挡环境下,雷达信号可能会被干扰;对于手指这类精细动作,目前的精度还不如视觉系统。但团队已经在测试中验证,通过特征归一化等预处理,还能进一步降低个体重识别的风险——也就是说,就算有人拿到雷达数据,也很难把它和具体某个人对应起来。

更值得关注的是,这种‘隐私即设计’的思路,刚好踩中了当下的需求:欧盟GDPR、美国HIPAA等法规对敏感场景的数据采集越来越严格,而毫米波雷达天然符合‘最小必要’的隐私原则,不用额外做数据脱敏或去标识化处理。

从依赖摄像头的‘被看见’,到用雷达感知的‘被理解’,这次研究其实是给智能感知行业提了个醒:技术的进步,不该以牺牲人的隐私为代价。

M4Human带来的不只是一个数据集或一个模型,更是一种新的范式——当我们不再执着于‘看清楚’,而是转向‘感知本质’,很多之前无解的问题,比如隐私敏感场景的智能监护、复杂环境下的人机交互,突然有了更合理的答案。

看见不必窥视,感知可以温柔。 未来的智能系统,或许会像一个贴心的助手:它知道你需要帮助,却不会盯着你的一举一动;它能精准响应你的需求,却不会留下任何能指向你的隐私痕迹。