对抗知识焦虑,从看懂这条开始

App 下载

机器人刷人类第一视角视频,学会了用剪刀喷壶

跨设备迁移|第一视角视频|灵巧机械手|上海期智研究院|清华大学|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

跨设备迁移|第一视角视频|灵巧机械手|上海期智研究院|清华大学|AI智能体|人工智能

想象一下:你对着自家服务机器人演示了一遍开抽屉,转身它就自己拉开了储物格;工厂里刚换上的灵巧机械手,不用工程师重新编程,就能熟练抓起扳手拧螺丝;甚至未来某个机器人刷到TikTok上的维修教程,看完直接上手修好了你的旧耳机。这不是科幻——清华大学和上海期智研究院的团队,已经让不同型号的灵巧机械手通过人类第一视角视频学会了用剪刀、喷壶、鼠标,真实环境里平均任务完成进度超过80%。更关键的是,换个机械手,它居然不用重新训练。这到底是怎么做到的?

传统机器人训练,就像请私教一对一教切菜:工程师通过遥操作手把手示范,成本高不说,换个机械手就得重新来——毕竟每只“手”的关节数量、灵活度都不一样。而这次的UniDex平台,相当于给机器人找了上千个第一视角的“自学视频”:人类戴着手环相机拍自己冲咖啡、剪袋子、按鼠标,平台把这些视频转换成机器人能看懂的训练数据。

核心的突破是一套**人机协同重定向程序**——你可以把它理解成精准的“动作翻译官”。它不管人手和机械手的形态差异,先死死对齐两者的指尖轨迹,手掌等部位则通过算法自主调整,确保机器人的动作不仅像人类,还符合物理逻辑——比如握剪刀时指尖能准确卡住剪柄,按鼠标时不会戳到按键边缘。这个过程里,人类只需要偶尔微调,比一对一私教效率高了几十倍。

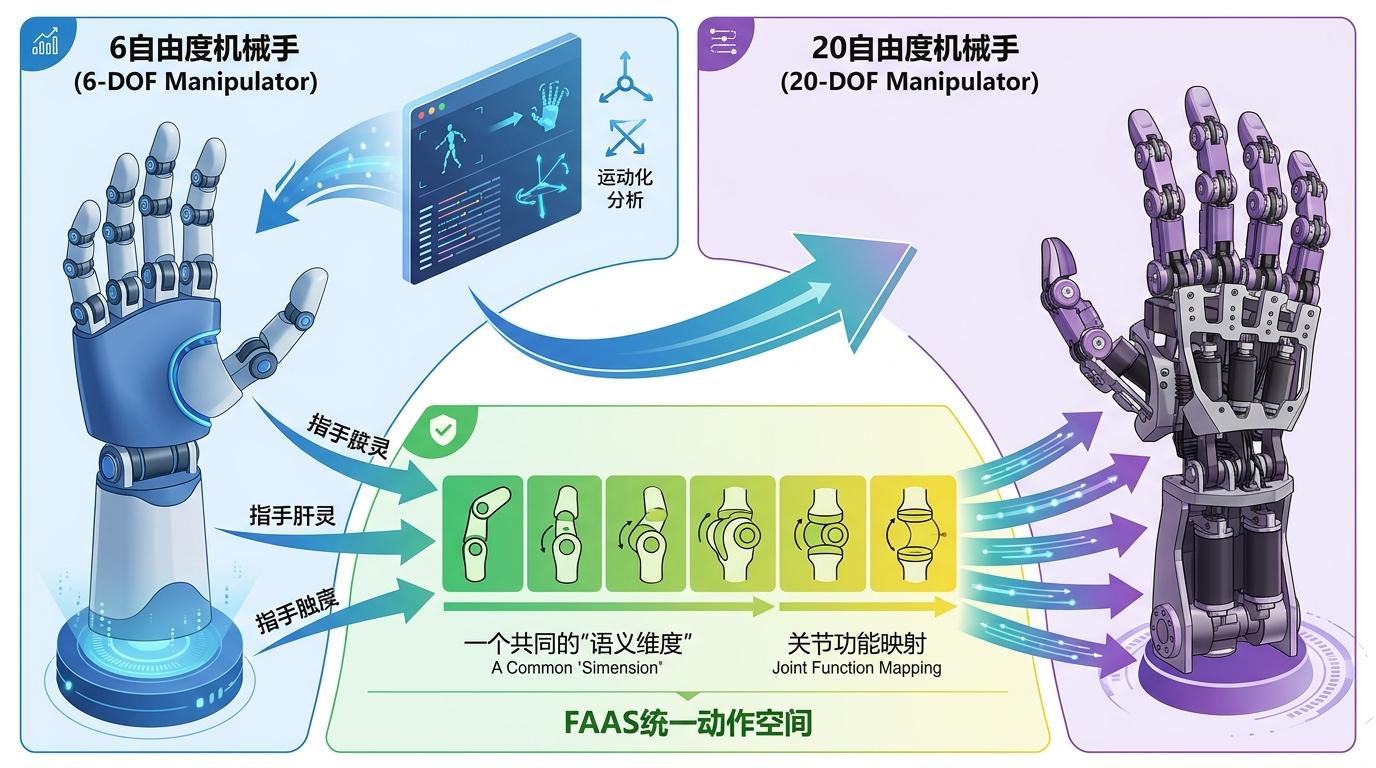

解决了“翻译”问题,下一个难关是:怎么让6自由度的机械手学会的动作,能直接传给20自由度的机械手?团队的答案是**FAAS统一动作空间**——把所有机械手里功能相同的关节,映射到同一个“语义维度”。

比如,不管是哪款机械手的指根弯曲关节,都归到动作空间的同一维度;所有手腕的旋转动作,也对应同一个控制信号。这就像不同型号的手机,都用统一的Type-C接口充电——只要功能一致,就能无缝对接。

这套逻辑的效果立竿见影:在真实实验里,用6自由度Inspire手训练的“冲咖啡”策略,直接放到20自由度Wuji手上,成功率依然能达到40%到60%;而传统方法换个手型,基本得从零开始。更划算的是,两条人类视频演示的数据,就能抵得上一条昂贵的机器人遥操作数据,微调成本直接砍半。

团队把未来机器人的学习路径,画成了一座“数据金字塔”:最底层是无标签的人类视频——就是我们刷的TikTok、美食教程,这部分数据量最大,成本最低;中间层是带动作标注的视频;最上层则是带反馈的精细动作数据。

现在的UniDex,已经能处理金字塔中层的数据,但更诱人的是底层的无限可能:随着3D视觉算法的进步,未来机器人或许真的能像人类刷短视频一样,纯靠无标签视频学会开抽屉、修电器,甚至更复杂的技能。当然,目前还有不少坎要跨:比如怎么让机器人理解触觉——握杯子时用多大劲才不会碎;怎么处理完全没见过的机械手结构,依然保持稳定操作。

我们总说机器人要“拟人”,但过去的思路是让机器模仿人的“身体”,这次的研究,是让机器模仿人的“学习方式”——从观察中获取经验,在通用逻辑上迁移技能。

未来的服务机器人,或许不需要预装几百个功能包,只需要跟着主人看几天日常操作,就能学会开特定的抽屉、用家里的扫地机;工厂里的机械手迭代,也不再需要停机编程,接上电源就能复用旧技能。

数据即老师,观察即训练。 当机器人能像人类一样“看会”技能,它们才真正迈出了走进我们日常的第一步。