对抗知识焦虑,从看懂这条开始

App 下载

AI普及催生知识趋同,“认知谦逊”为何成稀缺能力?

智识传承|创新性方差|知识同质化|AI辅助写作|认知决策|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

智识传承|创新性方差|知识同质化|AI辅助写作|认知决策|大语言模型|心理认知|人工智能

2026年日本立命馆大学的一项研究,拆解了6875篇学生论文后得出一个矛盾的结论:用AI辅助写作的学生,论文整体质量提升幅度超过3.7倍,但写作结构的创新性方差却减少了78%——百万学生对着同一个AI提问,最终拿到的是近乎复刻的思维框架。一位生物学教授的感慨更戳中本质:她时隔数十年仍带着导师“凯文式”的思考逻辑,这种独一无二的智识传承,在AI时代正在变成奢侈品。当AI把所有问题的答案都拉向统计平均值,我们正在失去的,究竟是个性化的思考,还是创新的根基?

知识同质化,指的是AI驱动下人类思维向统计平均收敛的趋势——它不生产独特的智识传承,只制造千人一面的认知结果。 传统的师徒式学习里,每个学生拿到的都是“定制版”的知识:凯文教授的生物学课堂里,他对细胞信号通路的偏爱、对野外观察的强调,会像烙印一样刻进学生的思考逻辑,让她在数十年后依然能说出“我的思考里有凯文的影子”。而当百万学生向AI提问“什么是自然选择”,得到的都是训练数据里最主流、最安全、最符合大众认知的答案——相同的结构、相同的论据、甚至相同的措辞。 Science Advances在2024年的研究更量化了这种趋势:AI能让个体创意产出提升30%,但集体创新的多样性却下降了41%。就像把一筐形态各异的石头扔进滚筒,出来的都是光滑圆润的鹅卵石——没有了尖锐的棱角,也就失去了划破固有认知的力量。阿尔茨海默症研究曾因“淀粉样蛋白假说”的垄断停滞数十年,若当时AI已普及,只会把这一单一结论反复强化,那些被边缘化的神经炎症、tau蛋白理论,可能永远不会有被看见的机会。

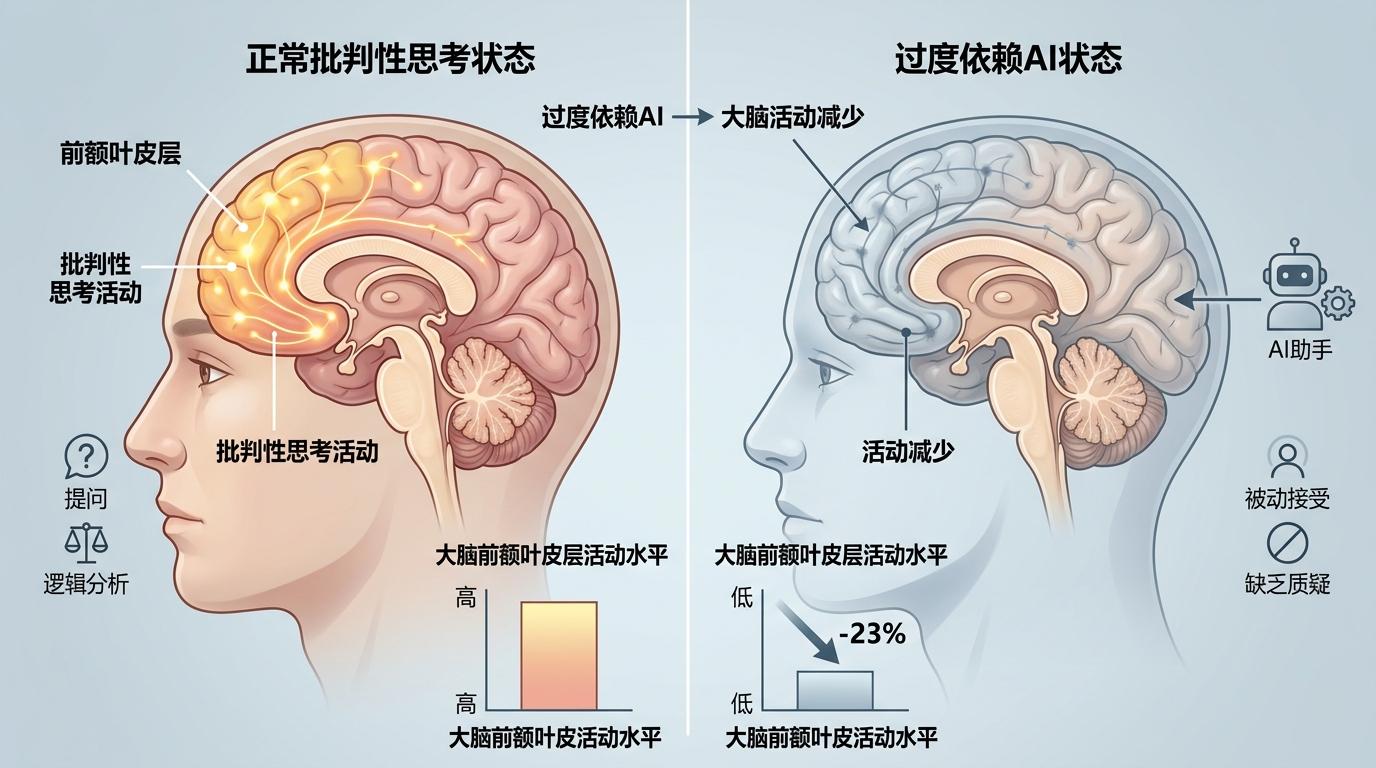

认知谦逊,是一种承认自身知识局限、主动寻求多元视角的认知美德——简单说就是“我可能错了”的自觉。它不是自卑,而是对知识边界的清醒认知,是创新和理性决策的根基。 这种能力从来不是天生的,而是在与不同观点的碰撞中练出来的:读三位历史学家对法国大革命的不同解读,你会意识到历史没有唯一真相;和持相反观点的同学辩论,你会发现自己的论证总有漏洞。但AI会直接把这些张力抹平——它不会给你三个矛盾的解释,只会给你一个“综合了所有主流观点”的标准答案。当你习惯了这种“无摩擦”的获取方式,就会慢慢失去提问的本能:不再想“有没有遗漏的角度”,不再问“这个结论的前提是什么”,甚至连“AI会不会错”都不会去验证。 麻省理工2025年的脑科学研究发现,过度依赖AI的参与者,大脑负责批判性思考的前额叶皮层活动减少了23%。就像长期不用的肌肉会萎缩,当我们把质疑的工作外包给AI,认知谦逊的能力也会慢慢退化——最终变成只会接受“标准答案”的思维懒汉。

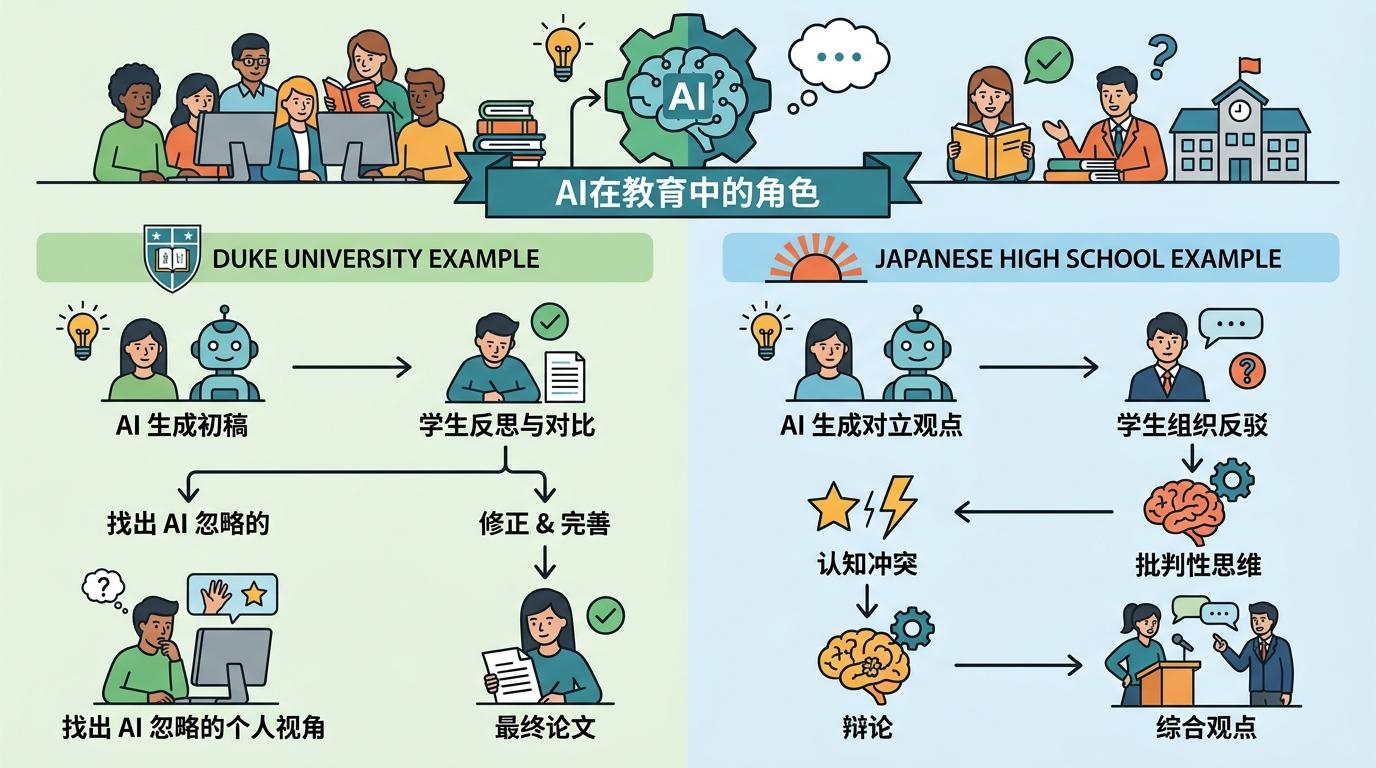

对抗知识同质化的核心,是把AI从“答案提供者”变回“思维伙伴”。 教育界已经开始尝试调整:杜克大学要求学生用AI生成论文初稿后,必须再写一篇“反思报告”,对比AI思路和自己的原始想法,找出被AI忽略的个人视角;日本的一些高中把“AI辩论课”纳入必修课,让学生用AI生成对立观点的论据,再自己组织反驳——不是用AI偷懒,而是用AI制造认知冲突。

技术层面也有了新的探索:2026年的HypoTermInstruct训练法,让AI学会主动承认“我不知道”,甚至会主动推荐不同领域的研究观点,而不是强行给出一个“标准答案”。更关键的是个体的意识觉醒:当你拿到AI的回答时,多问一句“还有什么可能性”;当你依赖AI解决问题时,先试着自己推导一遍——这些微小的动作,就是在为认知多样性保留火种。

那位生物学教授说“我的思考里有凯文的影子”,这不是对导师的模仿,而是人类智识传承最动人的形态——每个独特的思考者,都在为人类的认知版图添上一块独一无二的拼图。AI能帮我们快速找到拼图的边角,却无法替我们决定把它放在哪里。 当AI把所有问题都拉向平均值,我们最需要的,是守住“我可能错了”的清醒,和“我有不同想法”的勇气。 智识的多样性,才是创新的根基。