对抗知识焦虑,从看懂这条开始

App 下载

自动驾驶的冷静革命:规则之上,安全打底

规则执行|决策链|端到端模型|英伟达L2++智驾方案|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

规则执行|决策链|端到端模型|英伟达L2++智驾方案|自动驾驶|人工智能

圣何塞的四向停路口,没有重庆的陡坡急弯,没有成都的人流织网,只有一辆奔驰CLA在安静地等待。它认出了先到的车辆,读懂了路权规则,在该动的时候稳稳起步——像一个恪守礼仪的绅士,却带着机器特有的、不带情绪的精准。当安全员突然踩下刹车,为远处的行人让路时,我突然意识到:这套英伟达L2++智驾方案的野心,藏在每一次平稳的转向里,藏在每一个按规则执行的决策里。它不是要秀翻复杂路况,而是要把「不出错」变成自动驾驶的底层逻辑。为什么英伟达要走这样一条「反高潮」的路线?这背后藏着一套完全不同的技术逻辑。

你可以把传统自动驾驶系统想象成一条流水线——摄像头负责「看」,算法负责「认」,控制器负责「开」,每个环节各干各的,信息在传递中难免损耗,误差也会层层累积。而英伟达的Alpamayo模型,是把整条流水线塞进了一个「智能大脑」。

它直接把摄像头的画面、车辆的历史数据喂进模型,输出的不只是转向、加速的指令,还有一整套像人类思考一样的推理文本:「前方是四向停路口,我是第三到达的车辆,前两辆车已通过,现在可以起步」。这种「先推理、再动作」的模式,解决了自动驾驶最头疼的「黑盒问题」——你能清楚知道它为什么这么做,而不是看着它突然变道却摸不着头脑。

但真实的机制比这更精确:Alpamayo用的是视觉-语言-动作一体化架构,先通过链式推理拆解驾驶场景,再用流匹配扩散模型生成连续平滑的轨迹,避免了传统离散指令带来的顿挫感。它甚至能像学生抄作业一样,通过「知识蒸馏」把云端大模型的能力,压缩成车载小模型,实现实时响应。

在Alpamayo输出的10条候选轨迹里,总有一条是最安全的——如果没有,Halos安全栈会直接接管车辆。

你可以把这套系统想象成一个严格的交通裁判:AI大脑给出所有可能的行驶路线,裁判拿着「安全手册」逐条检查——有没有闯红灯?有没有跟车太近?有没有给行人留够安全距离?不符合要求的直接剔除,最后选一条既安全又舒适的路线执行。如果所有路线都不安全,裁判会立刻抢过方向盘,把车停在安全区域。

这套「端到端模型+经典安全栈」的双保险架构,已经通过了最严苛的考验:搭载它的奔驰CLA,在2025年Euro NCAP测试中击败了49款车型,拿到了年度最佳安全表现。更关键的是,Halos不是事后诸葛亮,它覆盖了从模型训练、仿真测试到车载运行的全生命周期——云端用DGX系统训练安全模型,用Omniverse做百万次极端场景仿真,车载用AGX芯片实时监控,把安全焊进了每一个技术环节。

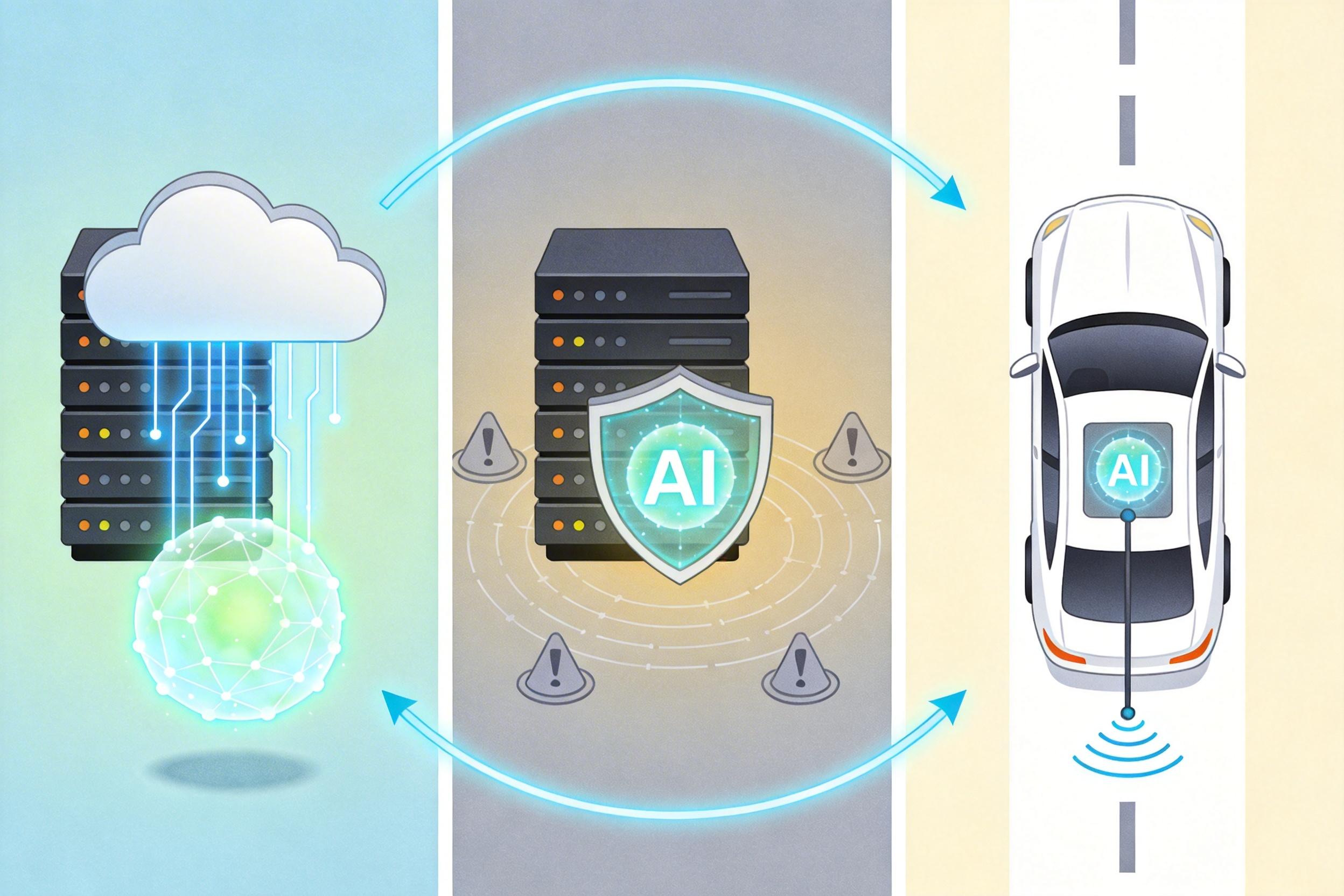

英伟达的野心,从来不是卖芯片这么简单。它想做的,是用「三台计算机」重构整个自动驾驶的生产关系。

第一台是云端训练计算机,用海量真实和合成数据把AI模型喂大;第二台是仿真计算机,在虚拟世界里把模型练到「百毒不侵」;第三台是车载计算机,把练好的模型装上车,让它在真实道路上落地。这三台计算机形成了一个闭环:车载数据传回云端更新模型,仿真验证后再下发给车辆,实现持续迭代。

更聪明的是,英伟达不要求客户必须用它的全套设备——特斯拉不用它的车载芯片,但依然要买它的训练和仿真算力。它把Hyperion平台做成了自动驾驶的「通用主板」,车企可以在上面搭自己的车,智驾公司可以在上面写自己的软件,出行服务商可以直接采购整套方案。Uber计划采购的10万辆Hyperion兼容车,就是这个生态的第一个标志性案例。

当然,这套体系也不是没有局限:它能精准遵守规则,但暂时还学不会人类那种「超出规则的礼让」;它能覆盖绝大多数场景,但极端罕见的「长尾问题」依然需要不断补全数据。

当国内智驾在重庆的陡坡上秀操作时,英伟达在圣何塞的平路上,悄悄搭起了一套更底层的游戏规则。它没有追求「炫技式的聪明」,而是把「可解释的安全」放在了第一位。

自动驾驶的终极目标,从来不是让车像老司机一样「会开车」,而是让车像老司机一样「不出事」——在规则之内做到极致,在意外来临时有兜底的底气。这或许才是自动驾驶真正的「ChatGPT时刻」:不是突然爆发的惊艳,而是悄无声息地,把安全变成了一种基础设施。

安全不是附加项,是自动驾驶的底色。