对抗知识焦虑,从看懂这条开始

App 下载

AI学会自己写指令,智能代理突破能力边界

代码安全审查|技能规则生成|渐进式披露|Agent Development Kit|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

代码安全审查|技能规则生成|渐进式披露|Agent Development Kit|AI智能体|人工智能

想象一下,你雇了个全能助理,一开始只会按你说的做——让查天气就查天气,让写文案就写文案。可突然有一天,它主动对你说:“我发现你经常需要做代码安全审查,我自己写了一套审查规则,以后可以直接用这个帮你。” 这不是科幻场景,而是Google最新推出的Agent Development Kit(ADK)正在实现的功能。过去AI代理只能被动执行人类指令,现在它能自己生成新的技能规则,还能通过一种叫“渐进式披露”的架构,把无效信息消耗砍掉90%。这一次,AI代理真的摸到了“自我扩展”的门槛。

在AI代理的早期开发中,工程师们遇到了一个棘手的问题:要让代理会的技能越多,就得把越多规则塞进它的“大脑”——也就是系统提示词里。一个代理如果有10项技能,每次调用都要加载上万token的规则,可用户可能只是让它写一段文案,剩下80%的信息都是无用的“噪音”。这不仅让AI的响应变慢、成本飙升,还会稀释它的注意力,导致执行精度下降。

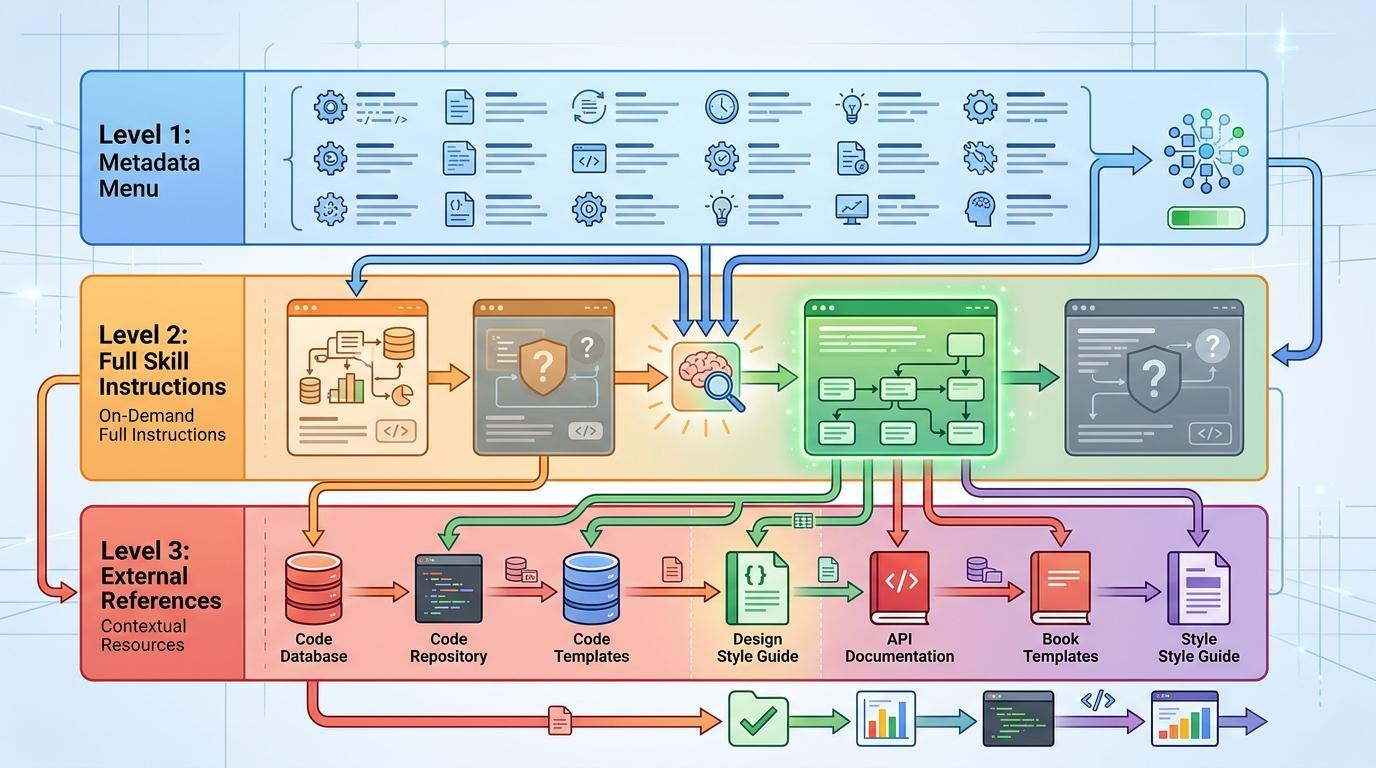

Google的解决方案是“渐进式披露”,把AI的技能拆成了三层:第一层是像菜单一样的元数据,只有技能名称和简短描述,启动时全部加载,总共只占约1000个token;第二层是完整的技能指令,只有当AI判断当前任务需要这项技能时才会加载;第三层是外部参考资料,比如代码模板或风格指南,执行时按需调取。

你可以把它类比成查字典:先翻目录找到对应的页码,再翻到那一页看内容,而不是把整本字典都背下来。这种设计让AI代理的基础上下文消耗直接降低了90%,如果只触发2项技能,总token消耗能比传统方式节省70%。

渐进式披露解决了效率问题,但真正让AI代理突破能力边界的,是被称为“Skill工厂”的元技能。这是一种特殊的技能,它的任务不是执行具体工作,而是教AI代理自己写新的技能规则。

当用户提出一个全新的需求,比如“我需要一个审查Python代码安全漏洞的技能”,AI代理会先检查现有的技能库,如果没有匹配的,就会激活Skill工厂。它会先读取技能规范文档和示例,然后按照标准格式生成一份新的技能定义文件,包括技能名称、触发场景、详细步骤,甚至可以引用外部的安全指南。整个过程不需要人工编写代码,AI代理写完就能立即使用这个新技能。

当然,这种“自我创作”也有风险。Google建议,自动生成的技能必须经过人工审核,就像代码审查一样,要检查指令是否准确、有没有遗漏步骤、引用的资源是否可靠。毕竟,AI写的规则如果有漏洞,可能会导致错误的执行结果,甚至带来安全隐患。

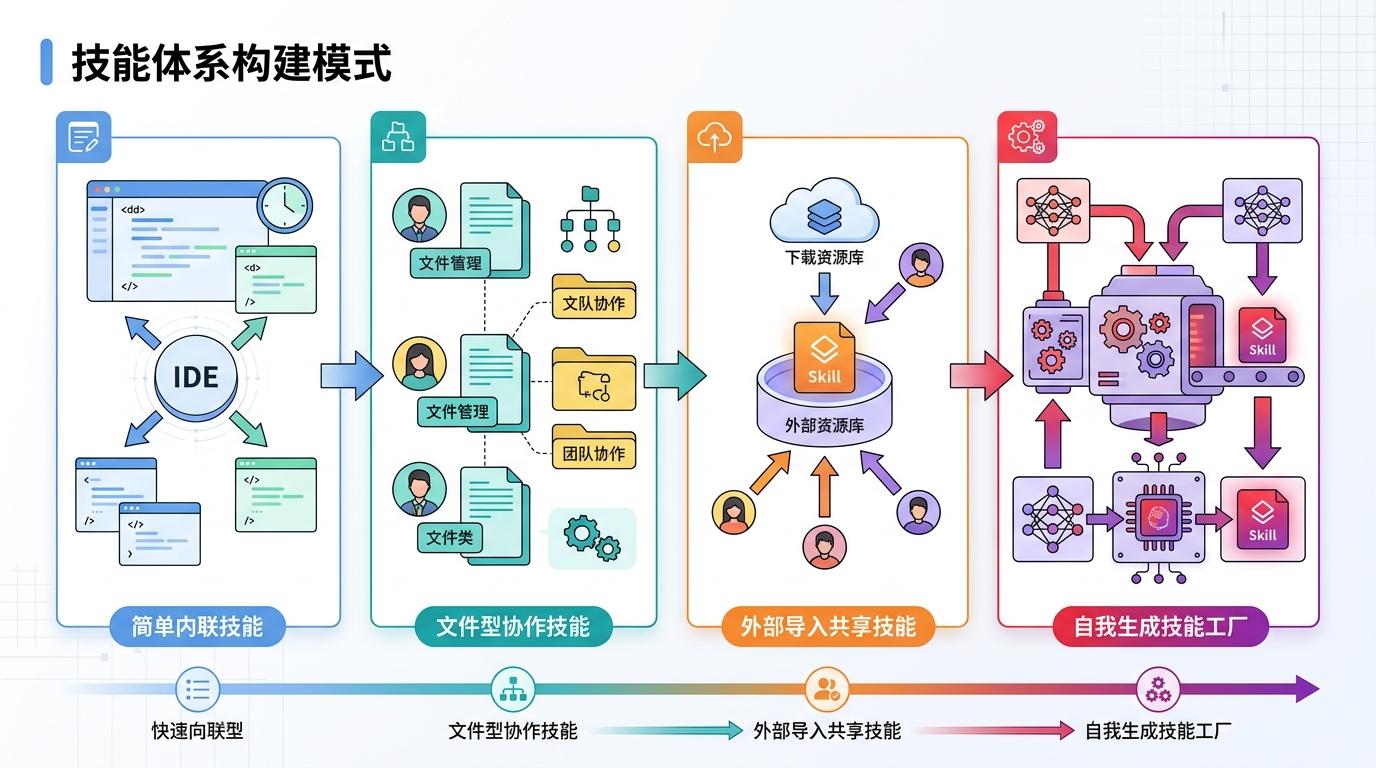

目前,这套技能体系已经形成了四种构建模式:从简单直接的内联技能,到便于协作的文件型技能,再到可以共享的外部导入技能,最终到能自我生成的Skill工厂。开发者可以根据需求灵活选择,比如先用内联技能快速原型,复杂技能再迁移到文件型,方便版本管理和团队协作。

AI代理能自己写指令,听起来像是迈向强AI的关键一步,但它的能力依然有清晰的边界。首先,Skill工厂生成的技能本质上是对现有知识的整合和格式化,它不能创造全新的知识,只是把人类已经掌握的规则整理成AI能理解的格式。

其次,自动生成的技能依赖于准确的用户需求描述,如果用户说“我需要一个处理数据的技能”,AI可能会生成一个模糊的、无法落地的规则,必须有明确的场景和要求,它才能写出有用的技能。

更重要的是,这种自我扩展依然需要人类的监督。Google强调,自动生成的技能必须经过人工审核,因为AI可能会写出有逻辑漏洞或者不符合安全规范的规则。比如,如果生成的代码审查技能遗漏了某个关键的安全检查点,可能会导致严重的安全问题。

从企业应用的角度看,AI代理的自我扩展确实能大幅降低开发成本。一家消费品公司用AI代理替代了6名分析师,完成任务的时间从几天缩短到1小时,成本降低了95%。但这背后需要建立完善的技能管理流程,包括技能的审核、版本控制、权限管理,才能确保AI代理的输出可靠、合规。

当AI代理从“执行指令的工具”变成“能自己写指令的系统”,它的角色正在发生微妙的变化——不再是简单的助理,而是能主动适配任务的“合作者”。这背后的渐进式披露和Skill工厂,本质上是用技术手段模拟人类的学习过程:先了解大概,再深入细节,最后能总结经验、形成新的方法。

但我们也不必过度神化这种能力。AI的自我扩展依然建立在人类提供的知识和规则之上,它只是把重复的、机械的规则编写工作自动化了。真正的创新和决策,依然离不开人类的智慧。

未来,AI代理的进化方向或许不是变得“更像人”,而是成为人类的“延伸”——把人类从繁琐的规则制定中解放出来,专注于更有创造性的工作。智能的本质,是让工具学会适配人,而非让人适应工具。