对抗知识焦虑,从看懂这条开始

App 下载

Meta押注闭源AI,用10倍算力效率换超车机会

算力效率|Scale AI|Alexandr Wang|Muse Spark|Meta|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

算力效率|Scale AI|Alexandr Wang|Muse Spark|Meta|大语言模型|人工智能

当你对着手机镜头拍下餐盘,AI不仅能算出卡路里,还能在图上圈出哪块牛排脂肪含量最高、搭配的沙拉缺了哪种维生素——这不是科幻片里的场景,而是Meta新模型Muse Spark的日常操作。这款被外界称为“牛油果”的模型,是Meta砸143亿美元挖来Scale AI创始人Alexandr Wang后,交出的第一份答卷。它放弃了Meta坚持多年的开源路线,转而用闭源系统级智能,试图在OpenAI和Google的夹击下撕开一道口子。更关键的是,它在性能追平GPT-5.4的同时,把训练算力消耗砍到了上一代模型的1/10。

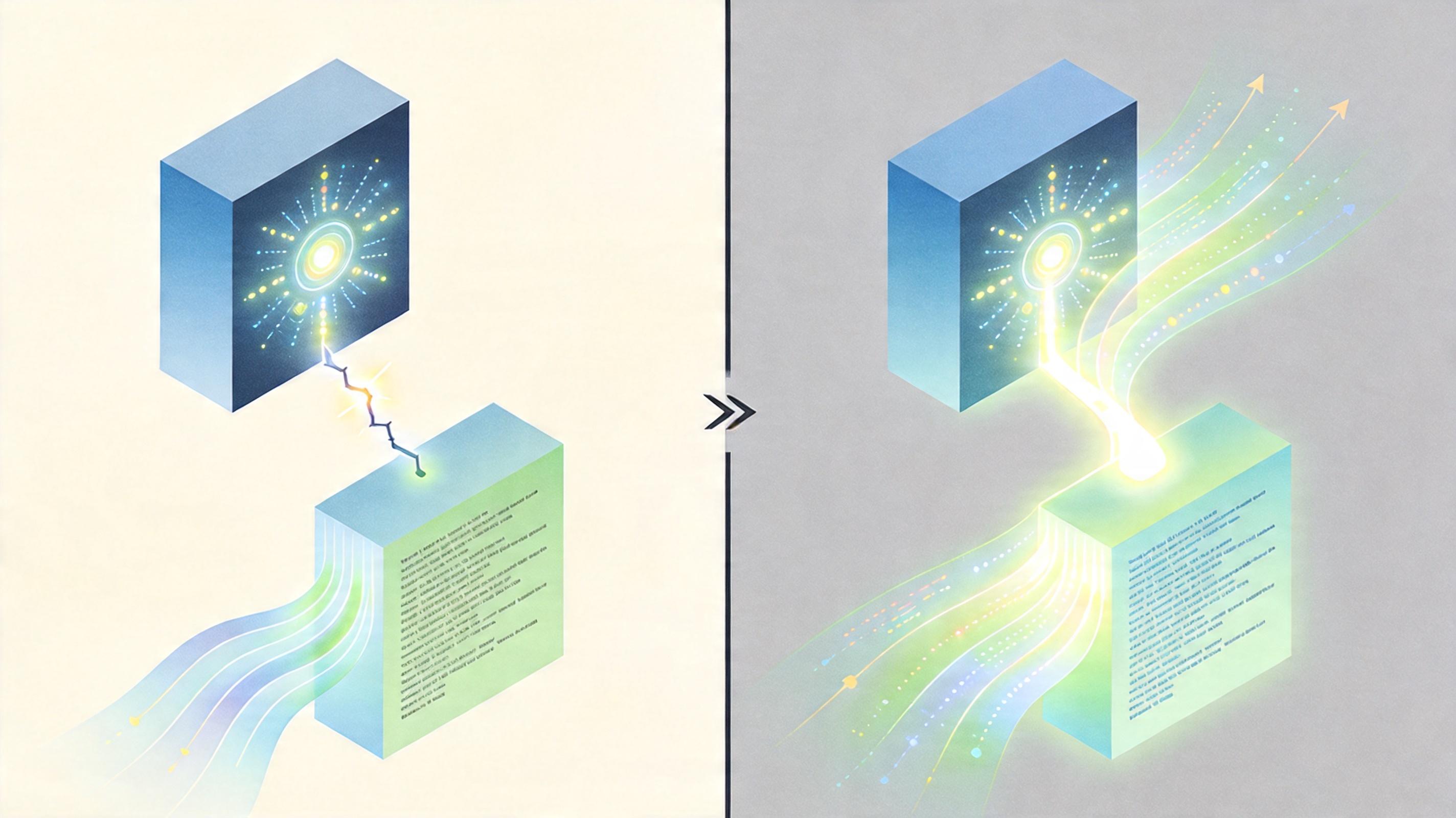

你可以把传统多模态AI理解成“会看图片的聊天机器人”——视觉模块和语言模块像两个独立的部门,靠翻译器传递信息,遇到复杂任务就容易“沟通不畅”。而Muse Spark从出生起就是个“跨部门通才”:视觉、语言、工具调用能力在架构层面深度绑定,能直接把图像里的像素信息变成推理的一部分。

比如面对一张折线图,它不会只读出“2023年销量上涨30%”,还能在图上标注出哪段时间的波动对应了营销活动,甚至自动生成后续的库存调整建议。这种“视觉链式思维”让它在健康领域的表现格外突出:和1000多名医生合作训练后,它在专业健康推理测试中拿到42.8分,超过了GPT-5.4的40.1分。

但真实的机制比这更精确:它的预训练阶段采用了Meta自研的UniMax数据混合策略,通过限制每个数据集的最大训练轮次,平衡了医学数据的专业性和通用数据的多样性;强化学习阶段则加入“思考时间惩罚”,让模型学会用更少的推理步骤解决问题——完成同样的测试,它消耗的计算令牌只有GPT-5.4的一半。

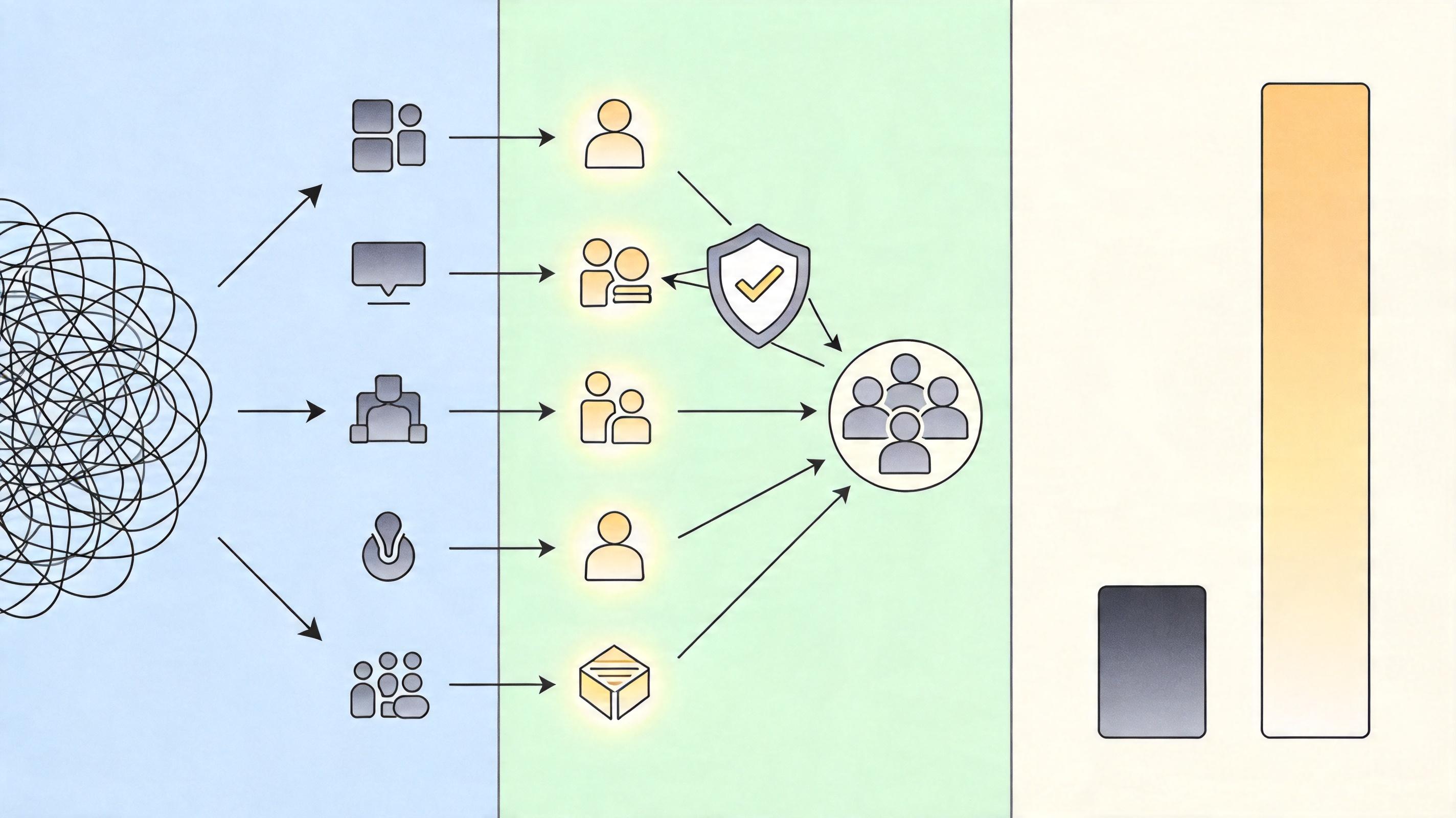

当你让AI规划一场跨国旅行,传统模型会像个独自加班的员工,一步步查机票、订酒店、做攻略,慢得让人着急。而Muse Spark的“沉思模式”,就像组建了一个虚拟旅行团:一个智能体负责查航班,一个负责筛选酒店,一个负责规划景点路线,最后还有个“协调员”把所有信息整合起来,速度比单智能体快了3倍。

这种多智能体并行推理的核心,是分层目标分解和共识投票机制:复杂任务被拆成多个子任务,每个智能体专注于自己的领域,完成后先由“验证者”检查逻辑是否合理,再通过投票得出最终结果。在被称为“人类最后的考试”的推理测试中,它的完成率从标准模式的42.8%跃升到58.4%,和GPT-5.4的水平不相上下。

不过这种协作也不是完美的:目前它还只能处理短期的、明确的任务拆分,面对“照顾老人一周”这种需要长期动态调整的长时程任务,还会出现“遗忘之前安排”的问题。而且多智能体的沟通成本不低,Meta不得不专门在Hyperion数据中心部署高速光纤网络,才能让这些“虚拟员工”顺畅交流。

Muse Spark的闭源策略,在AI社区掀起了不小的争议。有人说这是Meta为了保护技术优势的必然选择——毕竟上一代开源模型Llama 4反响平平,还被竞争对手轻松复刻;但也有开发者抱怨,闭源让他们失去了定制模型的机会,原本靠Llama生态创业的小团队,现在只能依赖Meta的API。

从安全角度看,闭源确实有优势:Meta可以通过集中管控快速修复漏洞,避免模型被恶意用于生成生物武器配方等危险内容——在相关测试中,Muse Spark对危险请求的拒绝率达到98%,远超开源模型的平均水平。但代价是透明度的缺失:外界无法验证它的训练数据是否存在偏见,也不知道它的“思考过程”会不会隐藏着未被发现的漏洞。

Meta显然也意识到了这一点,他们承诺未来会开放部分模型版本,采用“开源基础+闭源增强”的混合模式。但在AI军备竞赛的当下,这种妥协能不能平衡商业利益、技术创新和安全风险,还需要时间给出答案。

当我们谈论AI的未来时,总是习惯用“更聪明”“更强大”来描述,但Muse Spark的出现,让我们看到了另一种可能:AI的进化,或许不是单纯堆参数、拼算力,而是让它学会更高效地思考、更顺畅地协作。

它就像一个刚入职的实习生,虽然还不擅长处理复杂的长期任务,却已经能靠精准的专业能力和高效的团队协作,在特定领域超越资深员工。而Meta押上的1150亿美元资本开支,本质上是在赌:在这个算力越来越昂贵的时代,效率才是最终的护城河。

算力不是目的,高效解决问题才是。