对抗知识焦虑,从看懂这条开始

App 下载

把AI数据中心搬去大海,划算吗?

能源消耗|服务器散热|海浪发电|海上数据中心|海洋科学|AI算力|地球环境|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

能源消耗|服务器散热|海浪发电|海上数据中心|海洋科学|AI算力|地球环境|人工智能

当你刷着AI生成的短视频,或是用ChatGPT查资料时,可能不会想到:支撑这些服务的数据中心,正在悄悄吞噬越来越多的能源。国际能源署预测,到2030年全球数据中心耗电量将超过日本全年用电量,其中近四成能耗都花在了给服务器降温上。为了破解能源与散热的双重瓶颈,有人把目光投向了占地球表面71%的海洋——美国一家初创公司造出了85米高的“海上高尔夫球”,打算把AI算力搬进大洋深处。但这个看起来完美的解决方案,真的能绕过陆地的麻烦,还是只是把问题换了个更昂贵的场景?

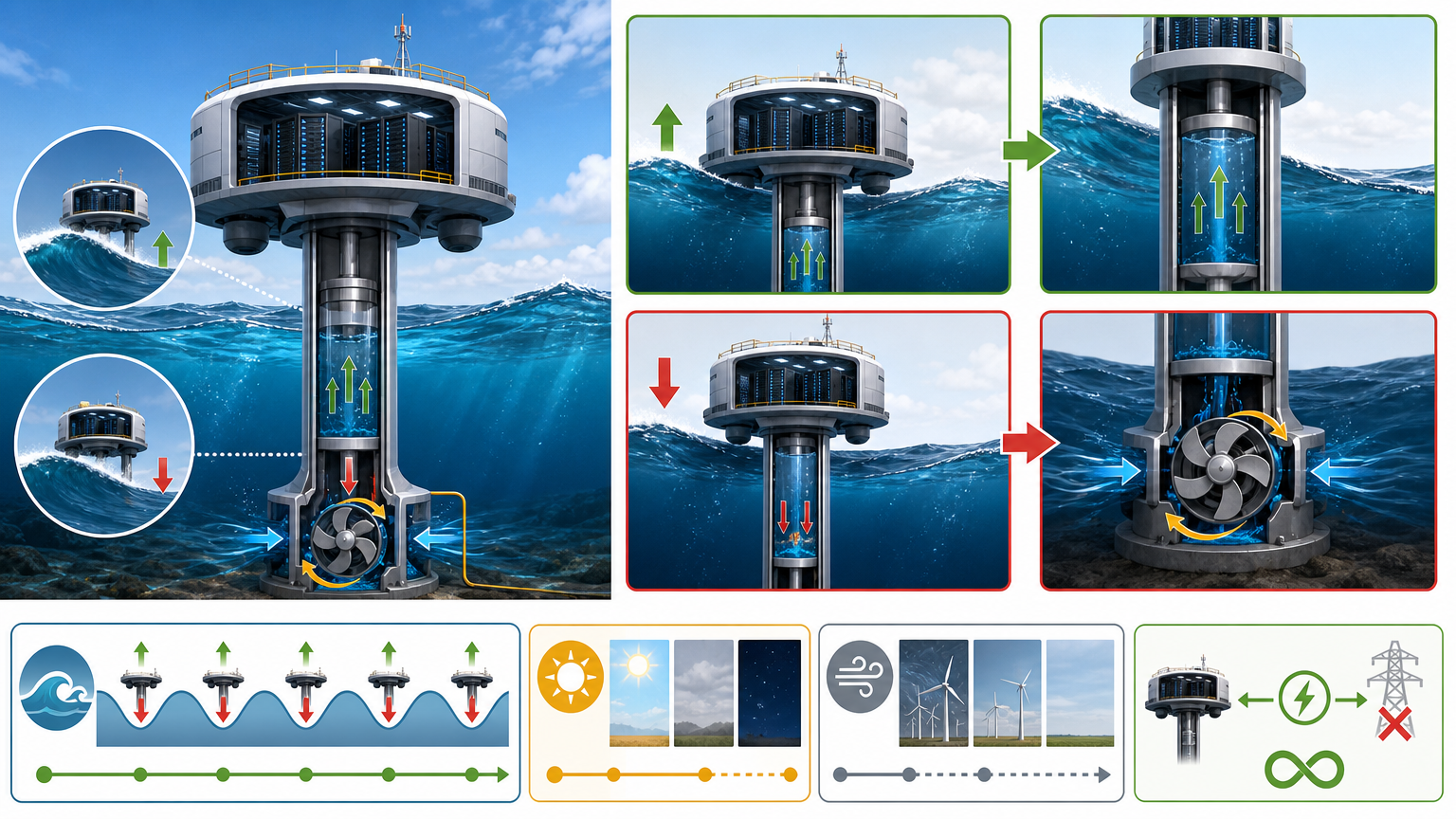

你可以把这个海上数据中心想象成一个插在海里的巨型注射器:当海浪把平台托起来,就像拉起注射器的推杆,海水被压进平台底部的长管;海浪落下时,海水又被挤出去,推动管内的涡轮转动发电——这就是它自给自足的能量来源,完全不用依赖陆地电网。和太阳能、风能不同,波浪能几乎是24小时不间断的,只要有海就有稳定的动力。

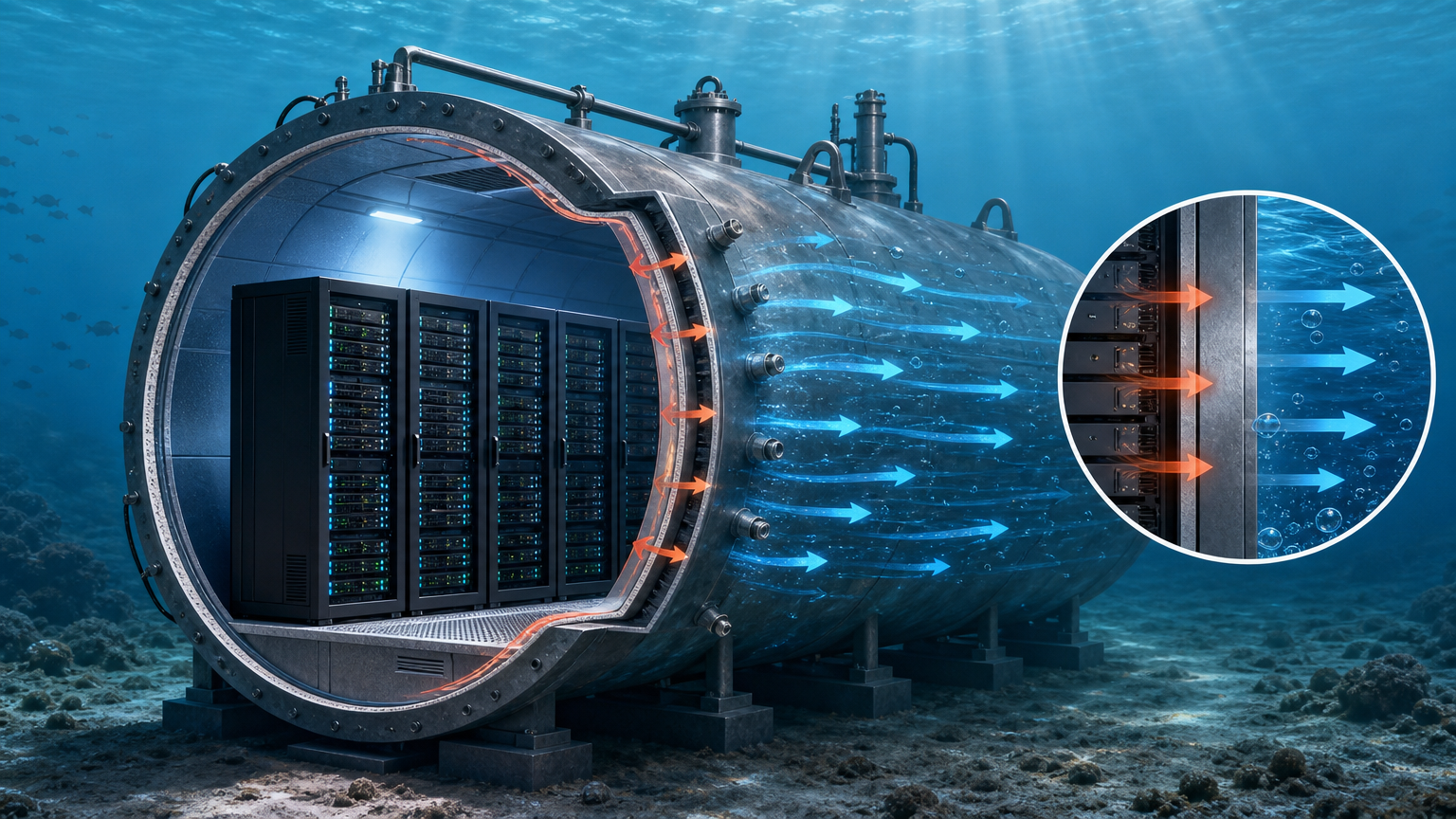

而降温的逻辑更简单:把服务器密封在水下的金属舱里,就像把热包子放进凉水里。海水常年保持低温,舱壁直接变成了热交换器,服务器产生的热量会被源源不断的海水带走,连空调都省了。微软早年的水下数据中心实验显示,这种冷却方式能让服务器故障率降到陆地的1/8,还能把数据中心的能源使用效率(PUE)压到1.03左右——这意味着几乎所有电力都用在了计算上,而不是浪费在降温上。

但真实的技术比这更精确:为了对抗海水腐蚀,整个平台用厚钢板焊接而成,水下模块还充入了氮气隔绝湿气;涡轮特意设计成无齿轮结构,减少了海浪冲击带来的机械磨损。

海洋看起来温柔,实则是个严苛的考场。首先是盐雾和海浪的双重攻击:哪怕是最耐腐蚀的钢材,在高盐度的海水中也会慢慢生锈,海洋生物还会附着在平台表面,堵住散热的缝隙。有海洋工程专家估算,海上设备的维护成本是陆地的3到5倍,光是清理附着的贝类和藻类,每年就要花掉一大笔钱。

更现实的问题是延迟。这些海上数据中心靠卫星和陆地通信,哪怕用最先进的星链系统,延迟也比光纤电缆高得多。这意味着它没法支撑你刷短视频、聊AI聊天bot这类需要实时响应的服务,只能处理训练AI模型、模拟气候这类可以“离线跑几天”的任务。而现在AI算力的最大需求,恰恰是那些需要低延迟的消费级应用。

还有绕不开的经济账。陆地数据中心靠规模摊薄成本,一个园区能装几十万台服务器,但海上平台受限于结构,单台的算力规模有限。劳伦斯伯克利国家实验室的专家算了一笔账:海上数据中心的建设成本是陆地的2到3倍,回本周期至少要10年,远不如陆地数据中心划算。

当然,不是所有人都想把数据中心扔去远海。有人盯上了更务实的近岸方案:比如把数据中心建在退役的海上风电平台上,直接用风电供电;还有日本企业打算把旧货轮改造成浮动数据中心,利用现成的船体降低成本。中国的海南和上海也试点了“海上风电+水下数据中心”的组合,把风电直接输给水下的服务器,连输电损耗都省了。

这些近岸方案避开了远海的高延迟和维护难题,还能享受海水冷却的优势。比如葡萄牙的SIN01数据中心,直接从大西洋抽海水冷却,排放的水温只升高1摄氏度,还能把废热回收给周边的工厂用。但它们也有自己的局限:近岸海域的使用权、环保评估,还有和陆地电网的对接,都是绕不开的坎。

更关键的是,不管是远海还是近岸,海上数据中心都还没走出实验期。微软的水下数据中心项目烧了几年钱后暂停,中国的试点也还在小规模运行。没人能确定,这种模式能不能真的规模化,会不会只是资本追捧的又一个概念。

当我们为AI的神奇惊叹时,其实背后是算力的军备竞赛。陆地的电网在过载,水资源在枯竭,我们不得不向海洋要空间、要能源。海上数据中心不是完美的答案,它只是把陆地的瓶颈换成了海洋的挑战——但至少,它给我们指了一个方向:算力的未来,或许不在云端,而在蓝色的大洋里。

算力的边界,终是自然的边界。 我们可以用技术突破物理的限制,但永远没法绕过自然的规则。那些漂在海上的“高尔夫球”,既是人类对算力的渴望,也是我们和自然达成新平衡的尝试。至于它能不能成为未来的主流,或许只有时间和海洋知道。