对抗知识焦虑,从看懂这条开始

App 下载

模型不升级,代码Agent照样越变越强

自动进化|复旦大学|Terminal-Bench 2|代码智能体|AHE框架|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

自动进化|复旦大学|Terminal-Bench 2|代码智能体|AHE框架|AI智能体|人工智能

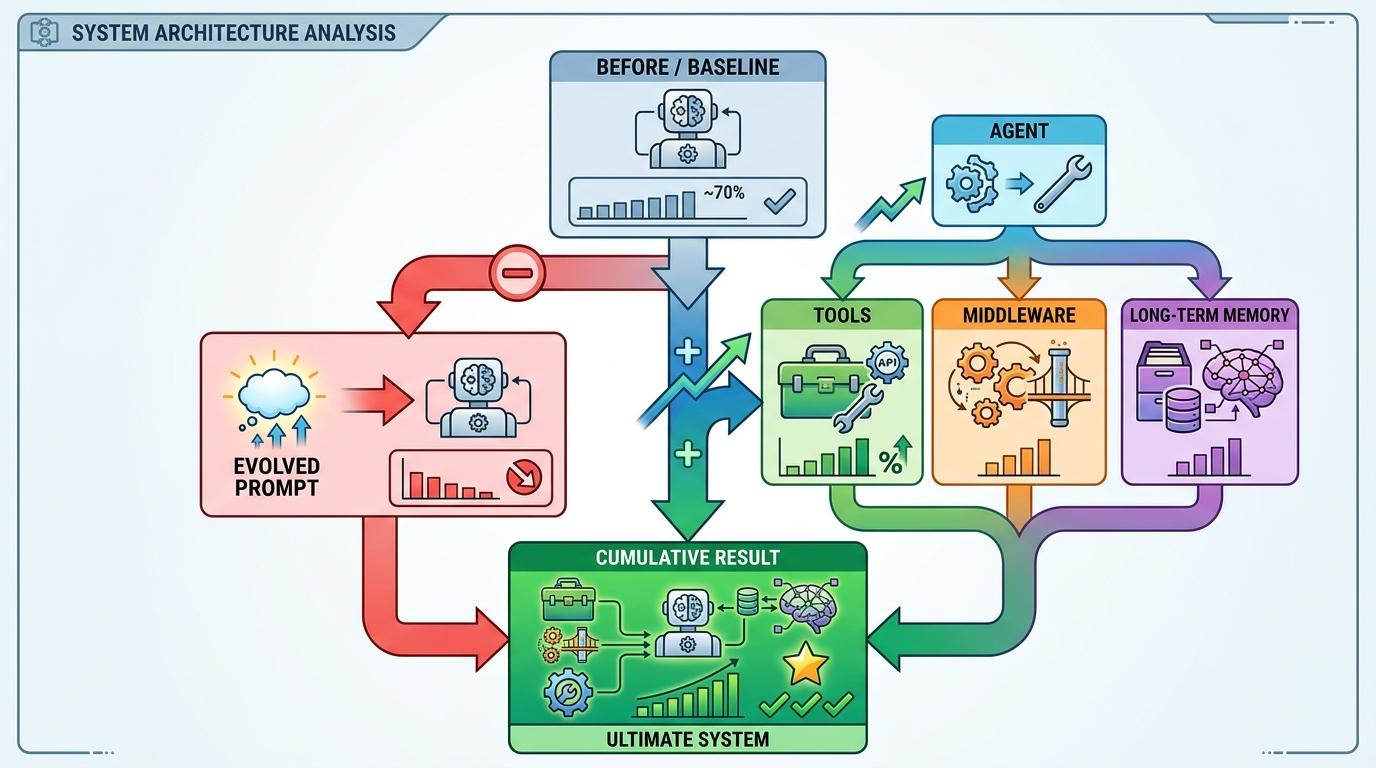

当我们还在比拼大模型参数、为更长的提示词绞尽脑汁时,复旦大学、北京大学与上海奇绩智峰的团队悄悄做了件反常识的事:让代码智能体在模型完全不变的情况下,自己迭代自己的「工作环境」。10轮自动进化后,它在Terminal-Bench 2测试中的任务通过率从69.7%跃升至77.0%,直接超过了人类专家手工调校的Codex-CLI系统。这不是模型能力的爆发,而是一套叫AHE的框架,让智能体学会了「自己修自己的工具」。问题是,它怎么做到的?

你可以把代码智能体想象成一个厨师:大模型是他的厨艺,而Harness——也就是智能体的工作框架——是他的厨房:刀具、炉灶、调料架、备菜流程,甚至墙上贴的菜谱。之前我们总在想怎么提升厨师的厨艺,却忽略了厨房布局混乱会让再好的手艺也发挥失常。

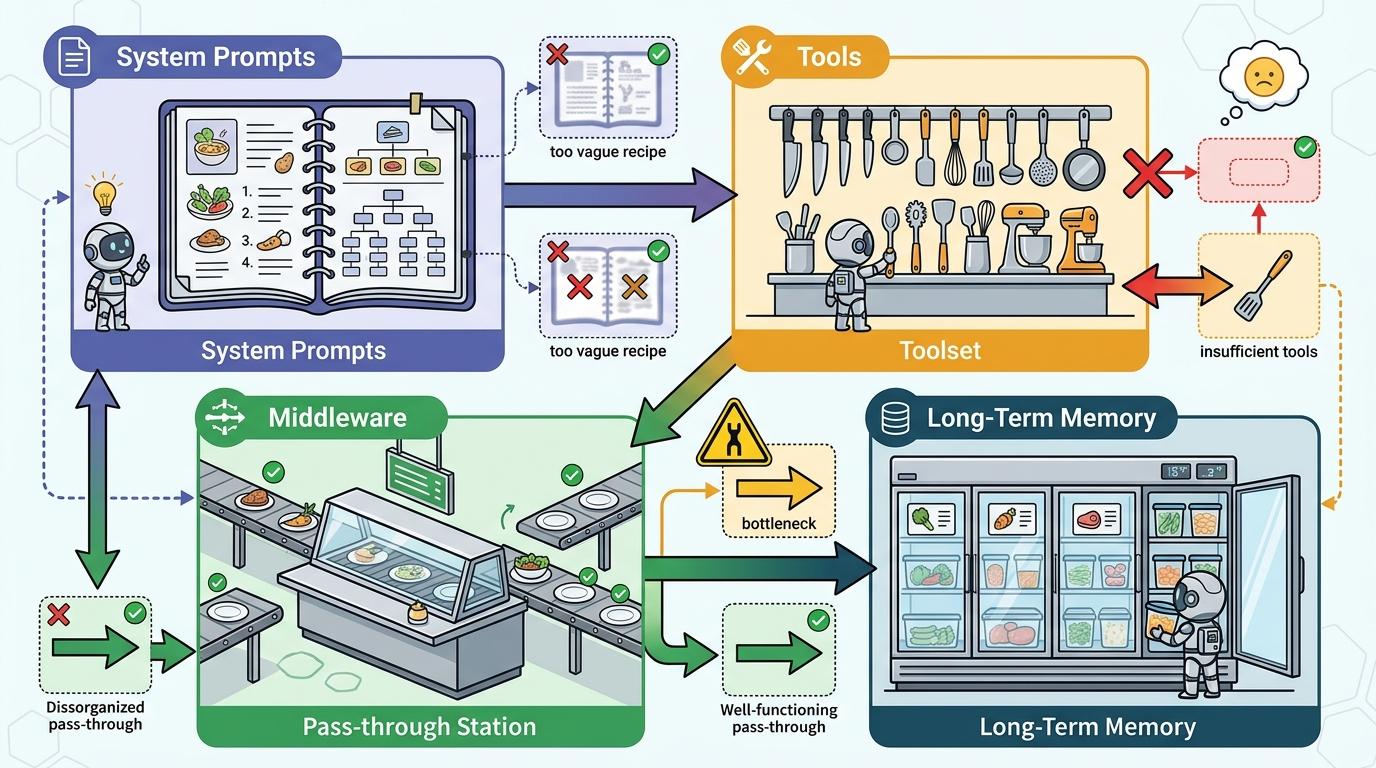

AHE框架的第一步,就是把这个乱糟糟的厨房拆成了独立的「抽屉」:系统提示词是菜谱本,工具是刀具套装,中间件是传菜台,长期记忆是冰箱里的备菜。每个组件都变成了单独的文件,智能体不用再对着一整团混乱的配置瞎改,而是可以精准定位到「刀具不够用」或者「菜谱写得太模糊」的问题。

更关键的是,它给每个抽屉加了「撤回键」。如果智能体改坏了某个组件,系统能在文件级别精准回滚,不会因为一次失误搞砸整个厨房。这就像厨师试了新的调料配方,发现不对能立刻换回原来的,而不是把整瓶调料都倒掉。

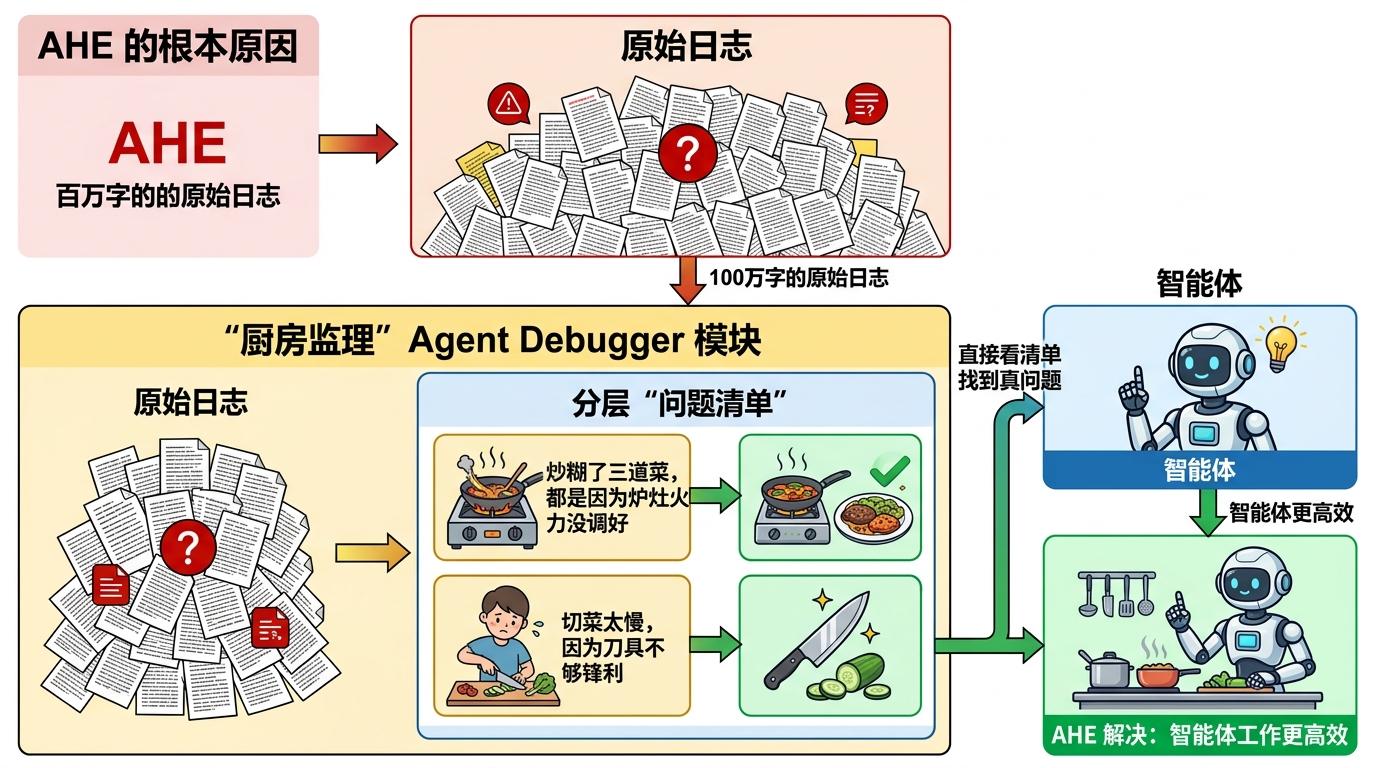

之前的智能体进化,要么是改改提示词,要么是生成些自然语言策略,根本没碰过厨房的核心组件——就像厨师只改菜谱,却不管炉灶火力够不够。而且厨房的日志实在太长了:百万级别的执行轨迹里,有用的失败信号可能只有几句话。人类工程师复盘都找不到问题,更别说让智能体自己来了。

AHE的解决办法是给智能体配了个「厨房监理」:Agent Debugger模块。它会把百万字的原始日志,提炼成一份分层的「问题清单」——比如「炒糊了三道菜,都是因为炉灶火力没调好」「切菜太慢,因为刀具不够锋利」。智能体不用再逐行翻日志,直接看这份清单就能找到真问题。

每次修改后,智能体还得写一份「整改承诺」:明确说这次改炉灶火力,能让炒糊的菜减少多少,会不会影响其他菜的火候。下一轮测试后,系统会拿着结果核对承诺——要是没兑现,就直接撤回修改。这相当于厨师每次改完厨房,都得用实际做菜的结果证明自己改对了,而不是自说自话。

实验结果出来时,连研究者都有点意外:单独把进化后的提示词插回初始系统,任务通过率反而从69.7%降到了67.4%。真正让智能体变强的,是工具、中间件和长期记忆这些「硬组件」——它们分别带来了5.6%、3.3%和2.2%的提升。

这就像厨师的厨艺没变,但换了一套趁手的刀具,装了更快的传菜台,冰箱里的备菜也分类放得清清楚楚,做菜的效率和自然上去了。更有意思的是,这套进化后的「厨房」还能跨模型复用:把它接到GPT-5.4、DeepSeek-v4等不同模型上,每个模型都能获得2.3%到10.1%的性能提升。它学会的不是某个厨师的做菜习惯,而是一套通用的厨房管理方法。

当然它也有缺点:智能体对「修改会不会引发新问题」的预测能力还很差,召回率只有11.1%——就像厨师改了炉灶火力,没想到会让蒸箱的温度也受影响。这也是它接下来要解决的核心难题。

我们总以为AI的进化得靠更大的模型、更多的数据,AHE却给了另一种可能:让AI在不变的「大脑」下,自己优化「手脚」和「工具」。这不再是简单的参数升级,而是让智能体学会了「从错误中学习」的闭环——就像人类工匠会不断打磨自己的工具,而不是一直换脑子。

能力的进化,不止于模型本身。

当我们还在为大模型的参数竞赛焦虑时,这套框架已经悄悄打开了另一扇门:未来的AI,或许会像人类一样,在实践中持续迭代自己的工作方式,而不是永远依赖外界的「升级补丁」。