对抗知识焦虑,从看懂这条开始

App 下载

手机NPU反超GPU,夜景去噪快了3.88倍

Mobile AI降噪挑战赛|轻量模型|夜景去噪|手机NPU|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

Mobile AI降噪挑战赛|轻量模型|夜景去噪|手机NPU|AI产业应用|人工智能

你有没有过这种经历:深夜用手机拍路边的小吃摊,屏幕上暖黄的灯光全糊成带彩点的马赛克,放大看连烤串的签子都裹着一层“毛边”——这是手机传感器天生的缺陷:小尺寸、快快门、高ISO,凑在一起就是噪点的温床。

过去要解决这个问题,要么用大模型把照片磨得像塑料,要么让手机GPU满负荷运转到发烫。但现在有个反常识的结果:一款只有1.96M参数的轻量模型,在手机NPU上的去噪速度居然比GPU快3.88倍,画质还追平了41.6M参数的“大前辈”。这不是实验室的空想,是2026年Mobile AI降噪挑战赛上拿了第一的实锤。

过去的移动端去噪模型,都是先做算法再适配硬件——就像先做了一件华丽的礼服,再硬塞进小号的衣柜里,要么挤变形,要么露边角。维尔茨堡大学的团队反着来:从设计模型的第一天起,就只给手机NPU“穿合身的衣服”。

他们给模型定了三条铁律:只用3×3卷积、ReLU激活、最近邻上采样这三个NPU原生支持的“基础款算子”,那些花里胡哨的自注意力、转置卷积一律砍掉。你可以把这理解成:只给厨师提供菜刀、菜板和铁锅,不让用任何智能厨具,但要求做出米其林级别的菜。

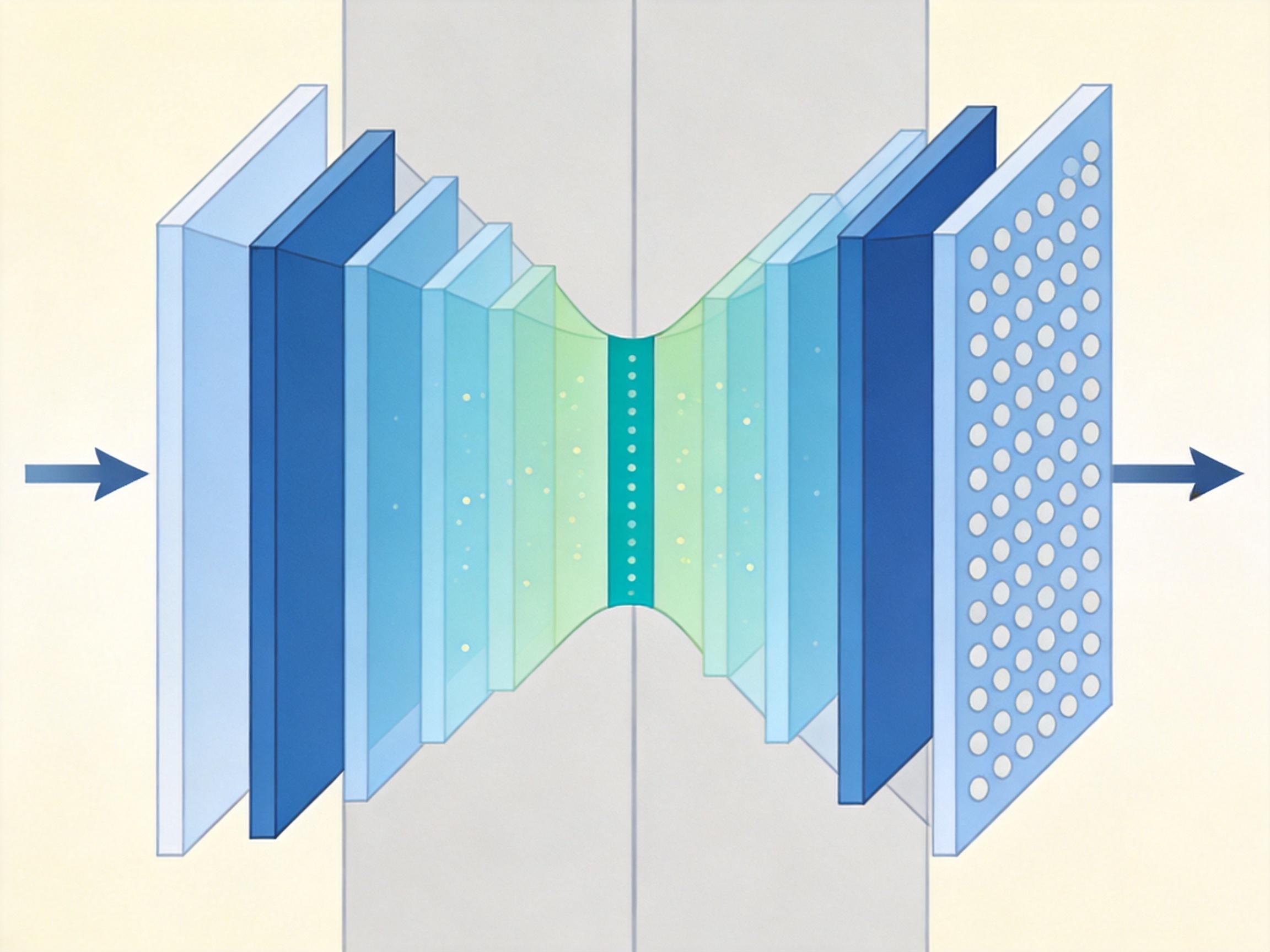

为了让这个“极简模型”能干活,他们还加了个“通道瓶颈”——把特征图的通道数先减半再恢复,就像把宽马路临时收窄成小巷,既减少了计算量,又没让信息漏掉。最终这个叫LiteDenoiseNet的模型,只有7.52MB大小,连一张普通照片的1/3都不到。

光有极简结构还不够,小模型天生“见识短”,感受野只有大模型的几分之一,怎么可能处理好复杂的噪点?团队用了一招“高α知识蒸馏”——这才是让小模型逆袭的关键。

知识蒸馏的本质是“让学生抄老师的作业”,但普通蒸馏是让学生一半看标准答案、一半模仿老师的解题思路,而高α蒸馏是让学生90%的精力都用来模仿老师的思路,只留10%看标准答案。这里的α就是模仿的权重,设到了0.9。

你可以把它想象成:让一个刚学画画的学生,不直接临摹静物,而是先临摹大师画静物的草稿——大师怎么排线、怎么找光影的思路,比最终的成品更重要。为了让学生能“看全”大师的思路,他们还采用了渐进式训练:先让学生画256×256的小画,再慢慢放大到1024×1024,逐步扩大学生的“视野”。

最终的结果是:这个1.96M参数的小模型,在测试集上的PSNR达到37.66dB,只比41.6M参数的教师模型低0.05dB,相当于恢复了99.8%的画质。

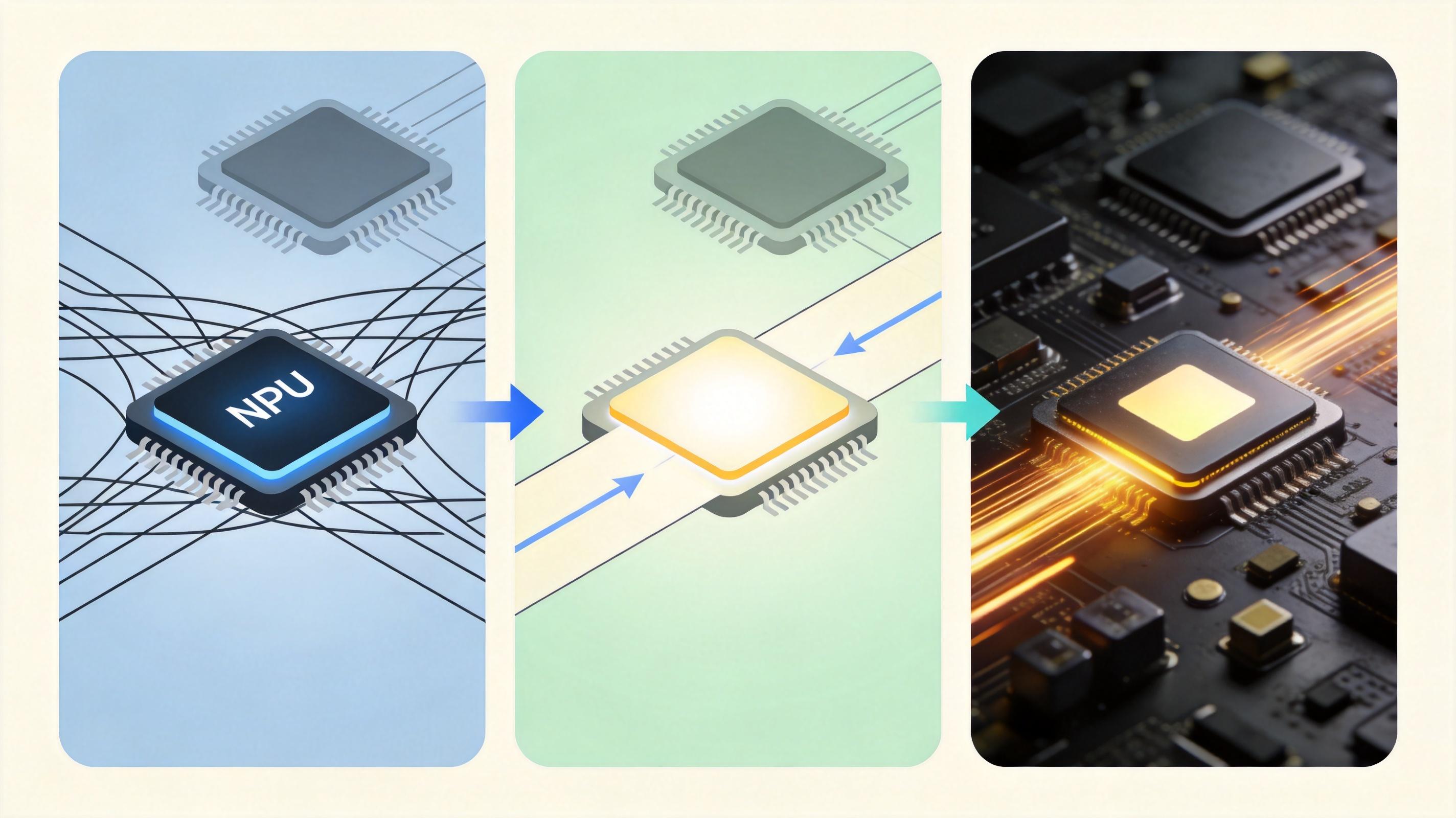

最颠覆常识的,是所谓的“推理反转效应”——在骁龙8 Elite和天玑9500这两款旗舰芯片上,这个小模型在NPU上的推理速度,分别比GPU快2.86倍和3.88倍。

这不是因为NPU的算力突然超过了GPU,而是因为GPU就像一辆跑车,在高速公路上能跑很快,但如果让它走只有羊肠小道的山路,反而不如拖拉机灵活。过去的模型里总有一些NPU不支持的算子,就像山路上突然出现的大石块,模型不得不停下来,把数据搬到CPU里处理完再搬回来,一来一回就把时间耽误了。

而这个纯原生算子的模型,相当于给NPU铺了一条没有任何障碍的专用赛道:所有计算都在NPU内部完成,不用和CPU、GPU来回传数据,连内存访问的开销都降到了最低。在Full HD分辨率下,它在天玑9500的NPU上只需要34毫秒就能处理一张照片,比人眨眼的速度还快。

当然,这个方案也有局限:它只在两款旗舰NPU上做了测试,换其他品牌的NPU可能还要重新调整;训练时需要大尺寸的显存,普通显卡根本跑不动;而且放弃了转置卷积,面对不同分辨率的适配性也差了一些。

我们总觉得,AI模型要做得好,就得堆参数、堆算力,就像手机拍照要做得好,就得堆摄像头数量。但这次的研究给了我们一个相反的思路:有时候不是硬件不够强,而是我们的算法没有真正利用好硬件的潜力。

硬件和算法的协同设计,不是让算法迁就硬件,而是让两者从一开始就并肩作战——就像设计师和裁缝一起做衣服,从布料的选择到剪裁的方式,每一步都为最终的穿着者考虑。

未来的移动端AI,可能不会再追求“更大的模型”,而是追求“更懂硬件的模型”。毕竟,用户要的从来不是参数有多华丽,而是按下快门的瞬间,就能得到一张干净清晰的照片——这才是技术真正的价值。

懂硬件的算法,才是真的高效。