对抗知识焦虑,从看懂这条开始

App 下载

AI要过屏幕图灵测试,才能在APP里活下去

账号风控|人机识别|自动化操作|APP平台|屏幕图灵测试|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

账号风控|人机识别|自动化操作|APP平台|屏幕图灵测试|AI产业应用|人工智能

你有没有过这种经历:在APP里点得太快,突然被要求输验证码?或者用AI助手自动抢票,结果账号被限制?这不是平台针对你,而是它在识别「非人类操作」。2026年,上海交大和卡内基梅隆的团队发现,那些帮我们自动完成APP任务的AI,正面临一场生死考验——它们太「高效」了,高效到像个机器,反而在人类主导的数字生态里活不下去。这背后,是一场藏在屏幕里的图灵测试,也是AI和平台之间的隐秘战争。

你可以把APP平台想象成一家靠流量吃饭的餐厅——它需要你慢慢逛、多看广告,才能赚钱。但AI是个急性子的食客:进门直奔目标,跳过所有装饰和推销,吃完就走,半秒不耽误。这种效率对用户是好事,对平台却是砸饭碗。

为了守住注意力经济的基本盘,平台开始部署各种「防AI」手段:有的是明着拦截,比如弹出验证码;有的是暗设陷阱,比如故意把广告做成和按钮一样的样式;更狠的直接封号——就像之前某AI助手因为跨APP自动操作,导致大量关联账号被微信限制。

而那些没被优化过的原生AI,几乎是「裸奔」状态:它们的滑动轨迹是完美的直线,没有人类手指的自然抖动;点击时长接近0,不像人类会有0.05到0.1秒的按压;甚至连动作间隔都暴露身份——人类的操作间隔是随机的长尾分布,AI却因为需要推理,间隔长达50到80秒,一眼就能被看穿。

为了让AI在数字生态里活下去,研究者提出了「屏幕图灵测试」——不是靠聊天骗人,而是让AI的操作行为和人类一模一样。这场测试被建模成一场攻防博弈:平台的检测器要最大化区分人和AI,AI要最小化被检测的概率,同时还得保证任务能完成。

团队设计了一套「Agent拟人化基准」,从两个维度打分:一是「拟真度」,看AI的操作能骗过检测器到什么程度,准确率越接近50%(也就是随机猜测),说明越像人;二是「实用性」,得保证AI别为了装人把正事耽误了。

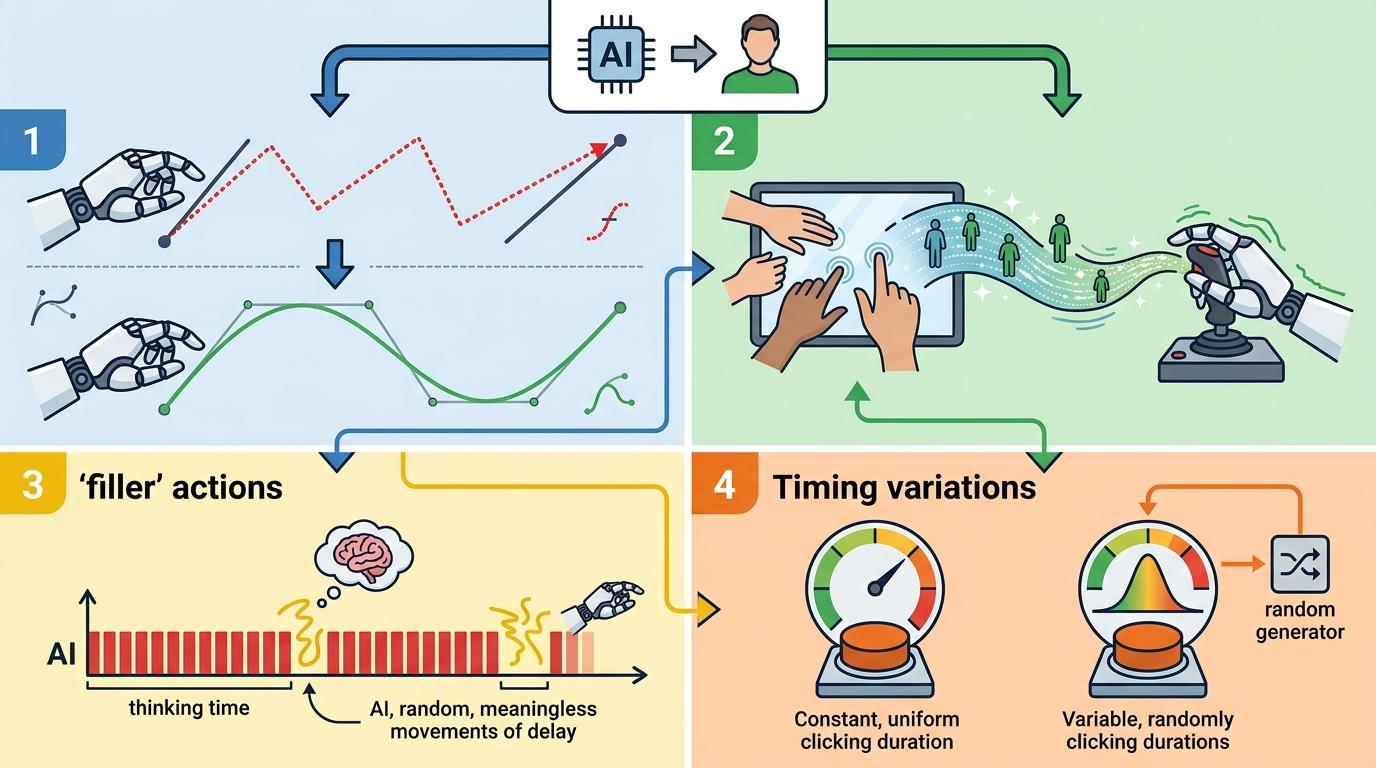

他们试过四种让AI「装人」的方法:用B样条曲线把直线轨迹改成人类的弧形滑动;从真实人类操作数据里匹配相似轨迹,把那些微小抖动和速度变化迁移给AI;在AI空闲的时候注入点无意义的小动作,掩盖推理延迟;用高斯采样模拟人类的点击时长。

结果很有意思:最有效的是「历史轨迹匹配」,能在把检测准确率降到0.55左右的同时,保持80%以上的任务成功率;而「伪动作注入」虽然能把检测准确率压到0.52,却容易打乱APP逻辑,比如在行程规划时误触按钮,让任务成功率从0.75暴跌到0.15。

最难伪装的是「端点精度」——AI为了准确点击按钮,落点会极度集中在中心,而人类点击总会有点偏差,这个细节至今还是AI难以跨越的门槛。

这场屏幕上的攻防,本质上是数字生态里的军备竞赛。平台的检测器会不断进化,AI的拟人化策略也得跟着升级。现在研究者已经证明,当有足够多的人类操作数据时,「历史轨迹匹配」能让AI的行为无限接近人类,但这又带来新问题:收集人类操作数据会不会侵犯隐私?

更关键的是,AI的拟人化不能是「为了像人而像人」。比如有的AI为了模仿人类的随机点击,反而把任务搞砸了——这就像为了装成走路不稳的人,故意摔跟头,本末倒置。研究者提出了「帕累托前沿」的概念:要在拟真度和实用性之间找一个最优解,既不会被平台检测到,又能高效完成任务。

现在这场竞赛才刚刚开始。随着多模态大模型的发展,AI能感知的界面信息越来越多,操作也越来越复杂;而平台的检测技术,也会从简单的特征识别,转向更复杂的行为模式分析。未来的AI,可能得像真正的人类一样,有自己的操作习惯,甚至偶尔犯点小错,才能在数字世界里「隐身」生存。

当我们还在期待AI帮我们搞定所有麻烦时,没想到它先得学会「装人」才能活下去。这场屏幕图灵测试,不是对AI智能的考验,而是对数字生态规则的适应——在人类主导的注意力经济里,高效不再是唯一标准,「像人」反而成了生存的必需品。

未来的AI,会是一群「懂规矩」的助手:它会像你一样,偶尔不小心滑错地方,会在广告上停留半秒,会有自己的操作节奏。高效是能力,拟人才是生存权。而这场藏在屏幕里的战争,最终会塑造出一个更像人类的数字世界——只是我们可能分不清,屏幕那头到底是真的人,还是装成人的AI。