对抗知识焦虑,从看懂这条开始

App 下载

机器人摸得到却不会用?这次终于学会了预判

多模态感知|机器人操作|触觉传感器|石智航|OmniVTA框架|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

多模态感知|机器人操作|触觉传感器|石智航|OmniVTA框架|AI智能体|人工智能

你有没有过这种体验:给机器人装了最灵敏的触觉传感器,它明明能“摸”到物体,操作起来却反而更笨拙——要么把鸡蛋捏碎,要么把零件插歪,甚至连擦桌子都越擦越乱。这不是科幻片里的玩笑,而是机器人领域卡了十几年的“感知悖论”:传感器越先进,操作越拉胯。直到2026年3月,它石智航联合六所顶尖机构推出的OmniVTA框架,才第一次让机器人跳出“被动摸”的困境,学会像人一样“预判接触”。这背后到底藏着什么被忽略的逻辑?

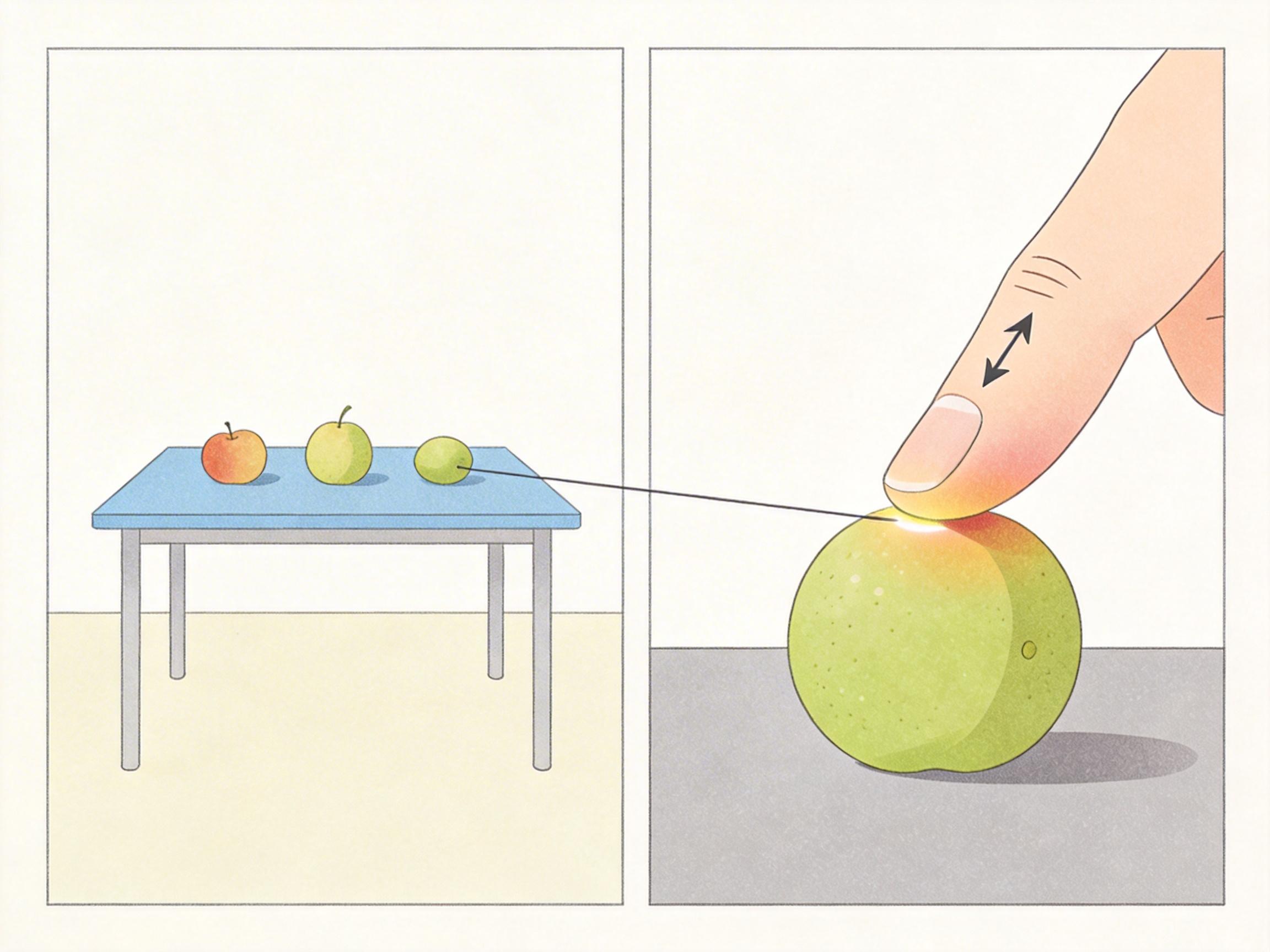

问题的根源,在于行业对触觉的理解从一开始就错了。过去的机器人,只是把视觉和触觉数据简单“拼贴”在一起塞进算法——就像给画家的眼睛上贴了个触觉传感器,却没告诉他怎么用触觉调整笔触。触觉的核心从来不是“当前摸到了什么”,而是“接下来会发生什么”:擦桌子时木纹的阻力会怎么变,削皮时果皮的韧性什么时候会断裂,插零件时接触的角度差1度会有什么后果。

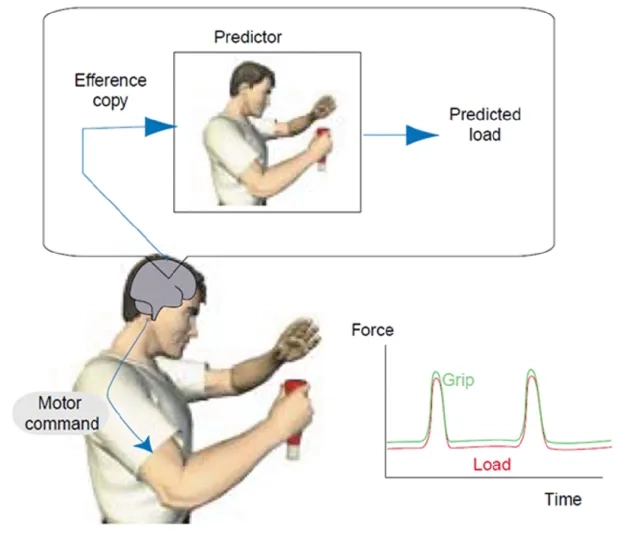

人类的手之所以灵巧,靠的是一套“预测+反馈”的神经机制:大脑先预判动作的触觉结果,再用实际触感快速修正。但之前的机器人没有这个“预判”环节,只能等触觉信号传来再被动反应——而接触发生的速度往往比算法的反应更快,就像用滞后的刹车去开高速。

更致命的是,视觉是“全局的、连续的”,触觉是“局部的、事件触发的”。把两者硬拼在一起,就像让天气预报和实时地震预警同时指挥行动,只会让机器人陷入信息混乱,最终“感知越多,做得越差”。

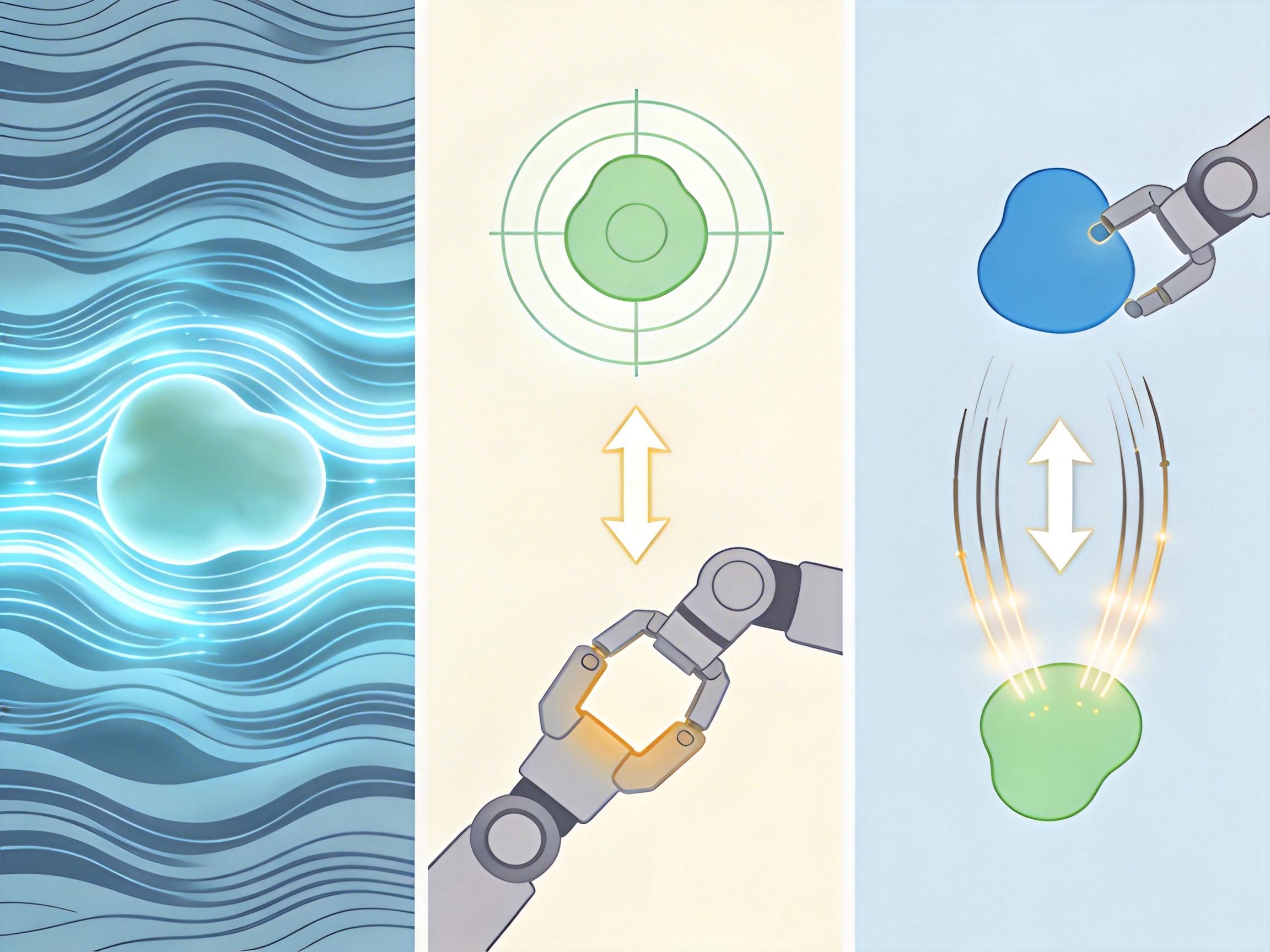

OmniVTA的突破,在于给机器人补上了“预判”这关键一环——它不是让机器人“摸得更清楚”,而是让它“提前知道会摸到什么”。这套框架的核心是一个**视触觉世界模型**,相当于给机器人装了个能模拟物理规律的“大脑模拟器”。

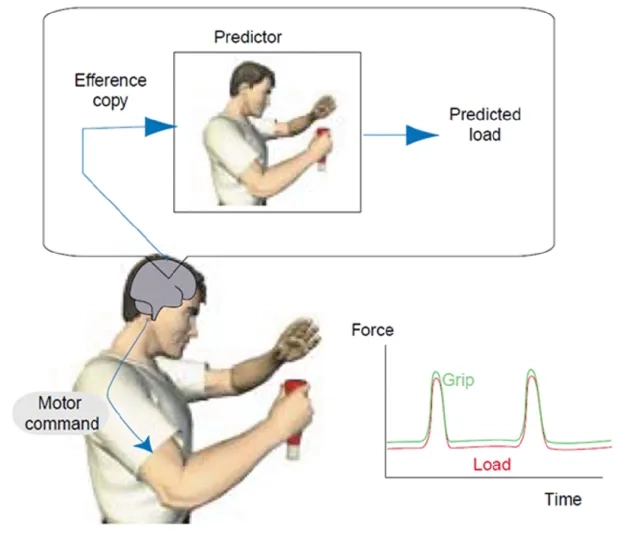

你可以把这个模型想象成一个“触觉预言家”:视觉分支负责看全局——桌子的形状、水果的位置;触觉分支负责盯细节——指尖的压力、接触的角度。两者在算法里同步演化,就能预测出接下来几秒内触觉信号的变化:比如擦到桌角时阻力会突然增大,或者苹果皮快要被削断时触感会变软。

为了让这个“预言”更精准,团队还专门做了三件事:一是用TactileVAE把海量高频触觉数据压缩成低维信号,就像把一本触觉词典浓缩成关键词;二是用自适应融合策略让机器人“按需分配注意力”——没接触时靠视觉找目标,接触时靠触觉做微调;三是配上60Hz的反射式控制器,一旦预测和实际触感有偏差,立刻像人的反射神经一样快速修正动作。

实验数据最能说明问题:在插拔零件、削皮这类接触密集的任务里,OmniVTA的成功率比传统方法提升了35%以上,就算故意给机器人的动作加扰动,它也能像人一样“手感不对就调整”。

这次突破的真正意义,不是让机器人多学会了几个动作,而是让它第一次“理解了接触的本质”。之前的机器人是“机械记忆”——记住“插零件要插10厘米”,但不知道为什么要插10厘米;现在的机器人是“理解物理”——知道“插到底时触觉会从硬变弹,这时候就该停”。

这种“理解”带来的是真正的泛化能力:学会了削苹果,就能自动学会削梨;学会了插电子零件,就能学会插家具螺丝。团队发布的OmniViTac数据集功不可没——2万多条覆盖6大类接触模式的视触觉轨迹,相当于给机器人上了2万堂“触觉实践课”,让它能从数据里总结出接触的通用规律。

当然,这离真正的“人手”还有距离:比如机器人还很难像人一样凭触感分辨出“丝绸和棉布的区别”,在极端潮湿、多尘的环境下,触觉传感器的稳定性也会打折扣。但至少,机器人终于从“只会摸”的阶段,迈进了“会用触感思考”的阶段。

从工业流水线的精密装配,到家里的擦桌削皮,机器人要走进我们的日常,最核心的从来不是“有多少传感器”,而是“能不能像人一样理解物理世界”。OmniVTA的出现,就像给机器人打开了一扇从“执行指令”到“理解环境”的门。

预判,才是灵巧操作的核心。 当机器人不再只是被动接收世界的信号,而是能主动预测、主动调整时,它才真正具备了“手的智慧”。未来的某一天,当机器人能像你一样熟练地削好一个苹果,你或许会想起,这一切的起点,是一群科学家终于想通了:触觉的本质,从来不是“感知现在”,而是“预见未来”。