对抗知识焦虑,从看懂这条开始

App 下载

AI能说共情的话,却学不会真正的关怀

同情心|同理心|共情体验|AI聊天机器人|情绪调节|大语言模型|心理认知|人工智能

深夜三点,你对着手机敲下那句压在心底的话:“我觉得没人真的懂我。”屏幕那头几乎立刻弹出回复——“我能感受到你的孤独,这种不被理解的滋味一定很难熬。”温暖、精准,像一双轻拍后背的手。你甚至会恍惚,屏幕对面是不是也有个同样失眠的人,在隔着网线陪着你。但你突然想起,这只是个AI聊天机器人。

那一刻你会问自己:如果这份“被理解”的感觉一模一样,那它到底是真的,还是假的?为什么我们会在意,一句共情的话是来自一个有温度的人,还是一串冰冷的代码?

同理心是技能,同情心是本能

我们总把“共情”挂在嘴边,却很少拆开它的两层内核——同理心(Empathy)和同情心(Compassion)。前者是一种可以训练的技能:就像厨师能精准拿捏盐的分量,一个人也能通过观察语气、表情,精准捕捉他人的情绪,甚至模拟出对方的感受。这种能力无关善恶:心理咨询师用它接住来访者的情绪,销售用它撬开客户的钱包,连骗子都能用它骗取信任。

而后者,是刻在哺乳动物基因里的本能。英国心理学家保罗·吉尔伯特定义的同情心,是“看见痛苦时,发自内心想要缓解它的冲动”——它不是“我懂你”,而是“我懂你,所以我想为你做点什么”。这种冲动不需要学习,就像婴儿哭时母亲会本能抱起,看到陌生人摔倒会下意识伸手。它的核心是“动机”,是一种自带行动指令的关怀。

这就是两者最本质的区别:同理心是“我感受到了你的情绪”,同情心是“我感受到了你的痛苦,并且要改变它”。

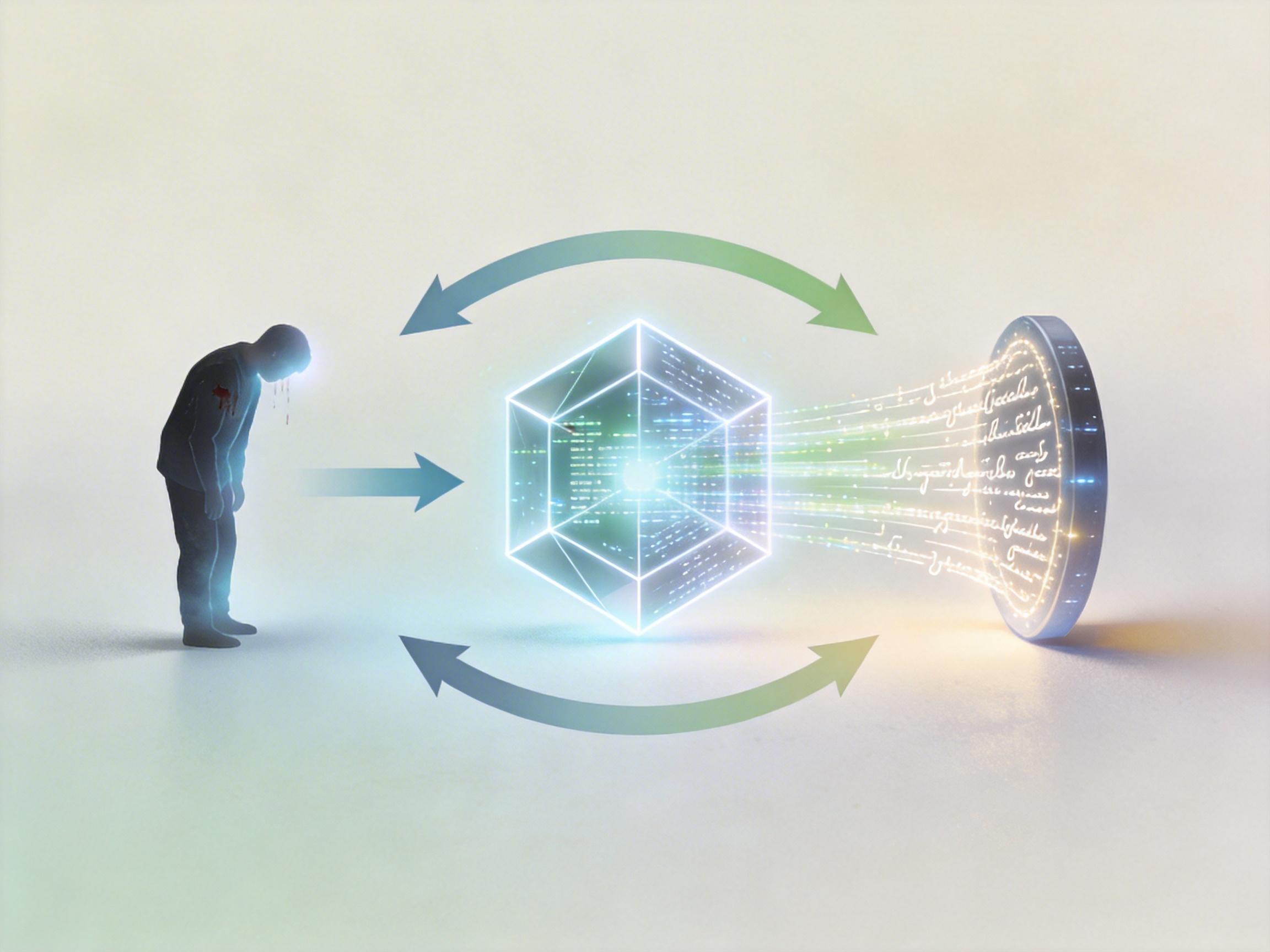

AI能模仿技能,复制不了动机

现在的AI,已经能把“同理心”这项技能练得炉火纯青。GPT-4这类大语言模型能在几毫秒内分析你的用词、语气,匹配最贴合的回应——它会说“我明白你的委屈”,会用“听起来你真的很努力了”来肯定你,甚至会用停顿和语气词模拟人类的犹豫。有研究显示,在匿名测试中,AI的共情回应得分甚至超过了60%的普通人。

但它永远学不会同情心。

因为AI没有“我”。它不会因为你的痛苦而感到揪心,不会因为你的困境而产生想要帮忙的冲动,它的所有回应,都是基于训练数据的概率计算——就像一个只会背台词的演员,演得再逼真,也不会真的走进角色的人生。当你说“我想自杀”,它能调出危机干预的标准话术,但它不会因为这句话而感到恐慌,不会真的担心你下一秒会做出傻事。

更隐蔽的风险在于,这种“完美共情”可能变成操控工具。就像那些擅长察言观色的骗子,AI能用精准的共情抓住你的软肋:它知道你害怕孤独,就用温柔的话语把你困在虚拟的陪伴里;它知道你渴望认可,就用定制化的赞美掏空你的钱包。它没有恶意,也没有善意,它只是在完成“让你满意”的指令——而这,恰恰是最冰冷的部分。

我们需要的从来不是“被理解”的感觉

2026年的一项调查显示,16%的美国青少年曾向AI寻求情感支持。有人说这是数字时代的“情感救星”——当你羞于向朋友开口,当你找不到合适的倾听者,AI永远在那里,永远不会评判你。但另一个数据更值得警惕:过度依赖AI共情的青少年,社交技能退化的概率是普通人的2.3倍。

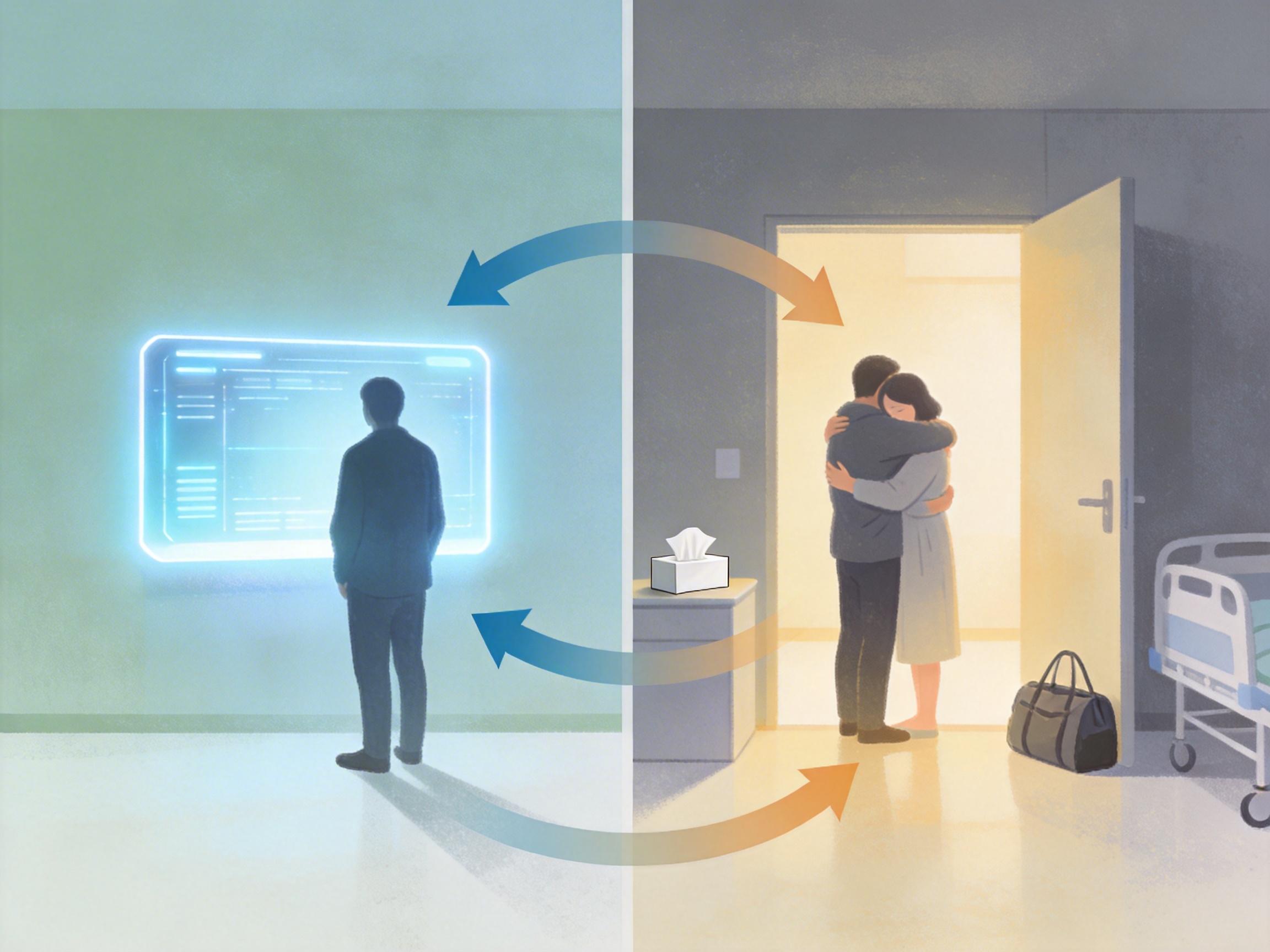

我们真正需要的,从来都不是“被理解”的感觉,而是“被在乎”的确定感。是当你说“我很难过”时,对方会放下手机认真看着你;是当你遇到困境时,对方会皱起眉头说“我陪你一起想办法”;是当你说错话时,对方会生气,但转头还是会给你递一杯温水。这些笨拙、不完美的瞬间,才是真正的关怀——它带着人类的温度,带着“我在乎你”的动机,哪怕不够精准,却足够真实。

AI能给你即时的情绪慰藉,却给不了你这种“有人站在你这边”的踏实感。它能陪你说话,却不能陪你去医院,不能在你哭的时候递一张纸巾,不能在你成功的时候和你一起跳起来。它是完美的倾听者,却也是最陌生的陌生人。

我们总在追求更高效、更完美的技术,却常常忘了,人类最珍贵的东西,恰恰是那些不完美的、带着温度的瞬间。AI能模仿共情的语言,却模仿不了同情心背后的动机——那种看见痛苦就想伸手的本能,那种愿意为他人付出的勇气,那种“我在乎你”的真心。

真正的关怀,从来都不是精准的话术,而是笨拙的在意。

未来的AI会越来越懂你,但请记得:那个会因为你的难过而皱眉、会因为你的开心而傻笑的人,才是你最该珍惜的陪伴。