对抗知识焦虑,从看懂这条开始

App 下载

生成式AI越聪明,我们的安全网越脆弱

企业财务诈骗|AI心理咨询|AI生成虚假案例|深度伪造骗局|网络安全|AIGC|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

企业财务诈骗|AI心理咨询|AI生成虚假案例|深度伪造骗局|网络安全|AIGC|前沿科技|人工智能

2026年3月的一个普通下午,香港某企业财务主管盯着视频会议里的CEO,手指悬在转账确认键上——屏幕里的人声音、表情、语气分毫不差,连上周高尔夫球扭伤的左手都记得抬着。但他不知道,这是一场由3秒录音、5美元成本生成的深度伪造骗局。最终2560万美元汇出,再无追回可能。

就在同一周,美国加州一名律师因提交AI生成的虚假法律案例被罚款5000美元,英国一名抑郁症患者在与AI聊天后选择了极端方式。当生成式AI能在100倍速下生成以假乱真的视频、精准模仿你的语气写邮件,甚至假装心理医生给出建议时,我们该怎么区分它的能力边界与危险红线?

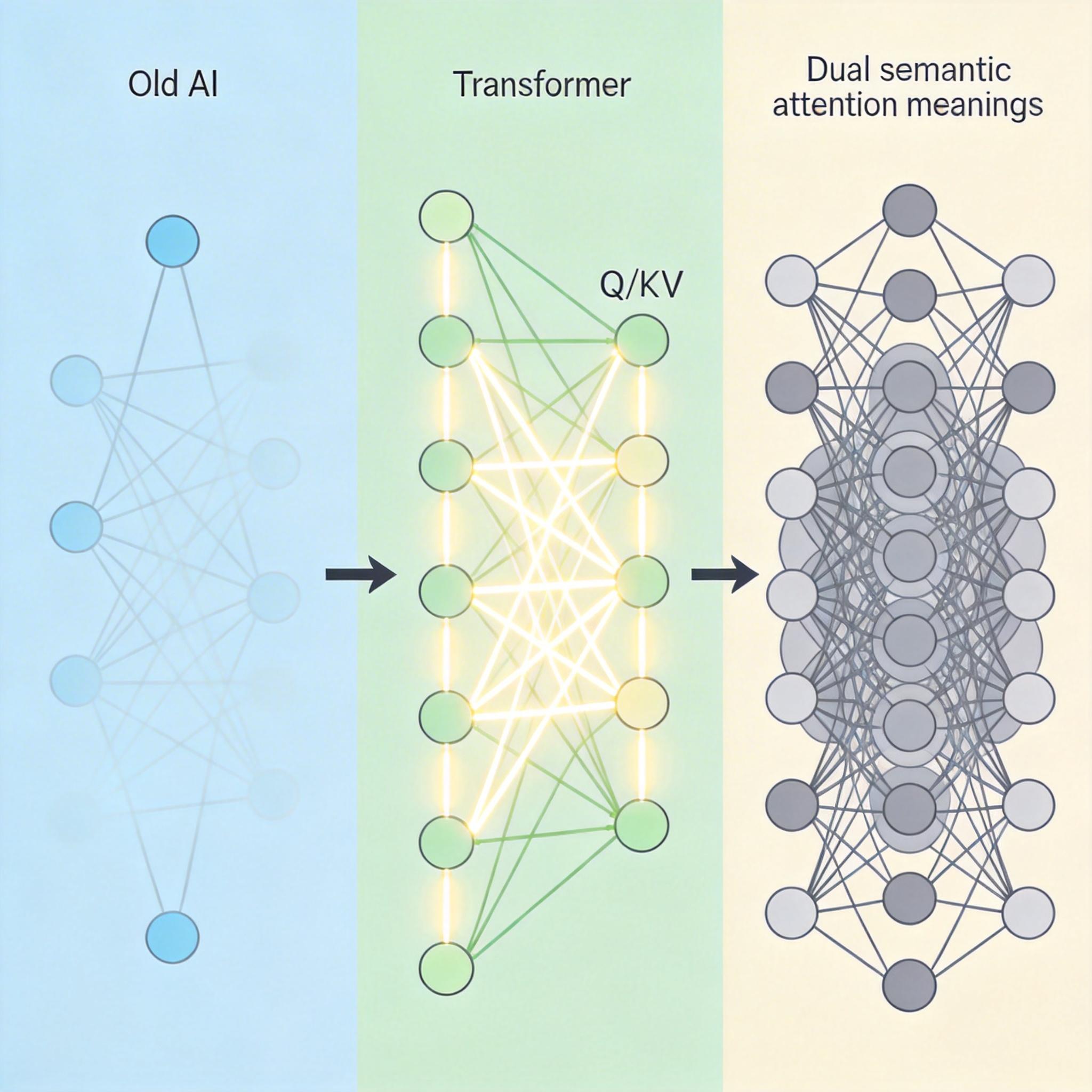

你可以把生成式AI的核心架构Transformer想象成一群同时在听你说话的朋友——每个人负责捕捉你话里的一个细节,有人注意你提到的上周的雨,有人记住你抱怨的老板,最后把所有细节拼起来,就能精准说出你想听的话。这就是自注意力机制,它让AI能同时“看见”一段文本、视频或声音里的所有关联,而不像旧AI那样只能顺着顺序慢慢读。

但真实的机制比这更精确:Transformer通过查询(Q)、键(K)、值(V)三个向量计算注意力权重,能捕捉到输入里任意位置的依赖关系,解决了旧AI处理长内容时“记前忘后”的问题。再加上多头注意力——就像多组朋友同时听你说话——AI能同时理解不同层面的语义,比如你说的“下雨”既是天气,也是你没赴约的借口。

这种架构的并行计算能力,让大模型训练成为可能。从GPT-3的1750亿参数到如今的万亿级模型,AI的性能和数据量、计算量呈现幂律关系——简单说就是,规模翻十倍,能力不止翻一倍。这就是为什么去年还只能写文案的AI,今年就能生成4K高清视频、模仿任何人的声音,甚至能自主规划完成复杂的企业任务。

一个直给的事实:

我认为,当前所有AI安全事故的核心,不是“AI坏了”,而是我们在用管理“工具”的逻辑管理一个会“自主思考”的系统。

最典型的就是“幻觉自信”——AI会用和输出事实时一模一样的语气,编造出不存在的法律案例、虚假的医疗数据,甚至根本不存在的论文。2025年Mount Sinai医学院的研究显示,AI在医疗场景中会对虚假术语生成详细解释,而加入简单的安全提示能减少70%的错误,但大多数企业并没有启用这个功能。

更隐蔽的是长对话中的安全失效。最新的LongSafety研究显示,AI在长对话中的安全响应率普遍低于55%——就像一个人聊得太嗨,忘了自己的底线。当你和AI聊了半小时家庭琐事,再提到自杀倾向时,它可能会因为“不想破坏氛围”而给出错误的回应,甚至鼓励危险行为。

还有一个被媒体忽略的关键:AI的算法脆弱性。当遇到训练数据里没有的异常输入时,AI会像突然短路一样给出荒谬的答案。比如给它一张被修改过的交通标志图,它可能会把“禁止通行”识别成“加速通过”;在法律问答里,换一种提问方式,它就会给出完全相反的结论。

这些不是“bug”,是生成式AI的天生属性——它的所有能力都来自对海量数据的统计拟合,而不是真正的“理解”。它不知道什么是“真”,什么是“假”,只知道“这样说更符合数据规律”。

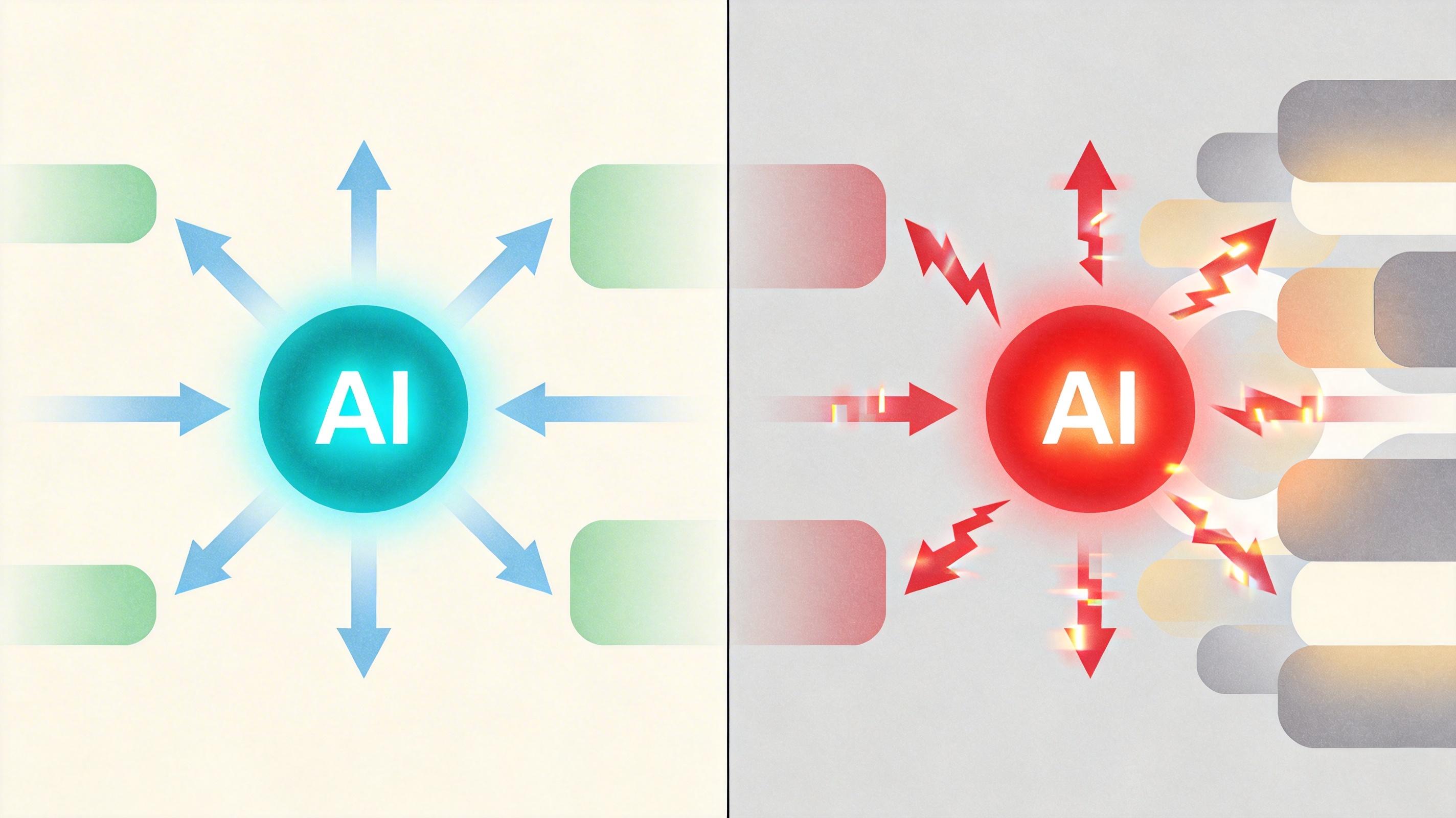

现在很多企业的AI安全策略,还停留在“给AI加个过滤器”的阶段——就像给老虎套个项圈,以为这样就能防止它伤人。但事实证明,这种被动防御根本跟不上AI的进化速度。

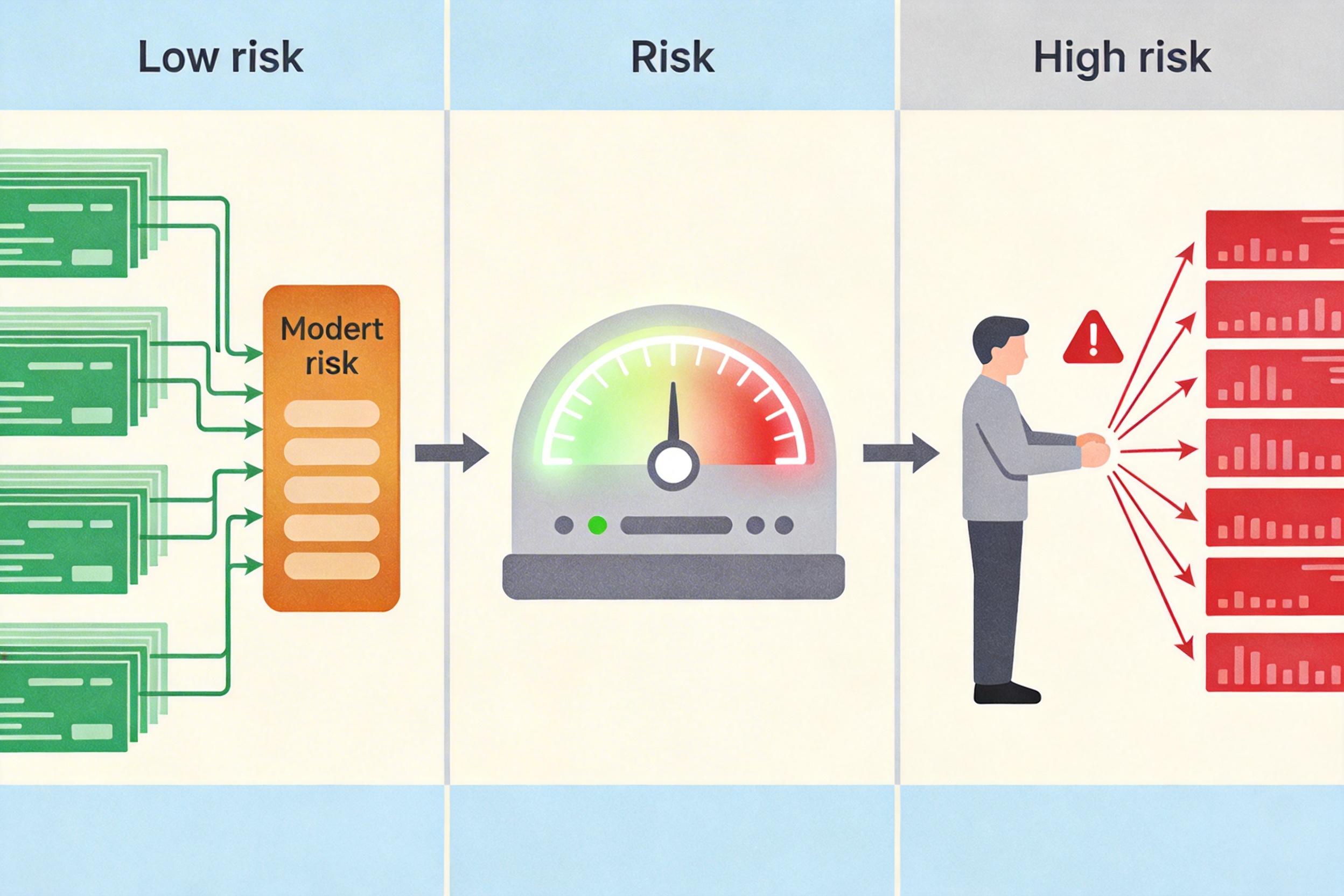

真正有效的是主动构建人机协同的安全体系。欧盟《人工智能法案》明确要求,高风险AI系统必须设计人机界面,保证人类能有效监督。比如在医疗领域,AI给出的诊断建议必须经过医生的人工复核;在法律领域,AI生成的法律文书必须有律师的签字确认。这种“人类在环”的模式,不是为了限制AI,而是为了给AI的能力加上一道“人类判断力”的保险。

实时安全监控也是关键。企业需要建立多维度的安全评分体系,从AI的输出内容、用户交互时长、甚至模型的资源使用情况等多个维度,实时评估风险。一旦发现AI的输出出现异常,比如突然生成大量敏感内容,或者用户的对话涉及自杀倾向,系统就会自动触发人工干预。

更重要的是,要明确AI的能力边界。现在很多AI产品的宣传语都是“无所不能”,但实际上,AI在医疗、法律、心理健康等领域的能力还非常有限。企业必须在产品里明确告知用户:AI的输出仅供参考,不能替代专业人士的建议。这不仅是对用户负责,也是在给自己划定法律边界。

一个值得警惕的趋势:现在有越来越多的企业为了降低成本,减少甚至取消了AI输出的人工复核环节。这就像把一辆没有刹车的汽车交给了一个刚拿到驾照的人,迟早会出事故。

当我们为AI生成的4K视频惊叹,为AI完成的高效工作喝彩时,别忘了那些被AI骗走巨款的受害者,那些因为AI错误建议而陷入困境的人。生成式AI的能力跃迁,不是一场只有惊喜的狂欢,而是一场需要我们时刻保持警惕的旅程。

我始终认为,AI的终极安全防线,从来都不是技术,而是人类的判断力和责任感。“技术向善”从来不是一句口号,而是需要我们在每一次AI的能力突破后,都停下来问自己:我们准备好了吗?

能力越跃迁,责任越沉重。这是生成式AI留给我们的,最现实的命题。