对抗知识焦虑,从看懂这条开始

App 下载

AI聊天机器人普及下,我们为何陷入「心智感知」幻觉?

心理归因|人机互动|心智感知|Claude|ChatGPT|认知决策|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

心理归因|人机互动|心智感知|Claude|ChatGPT|认知决策|大语言模型|心理认知|人工智能

2026年初,一项覆盖四大实验、涉及ChatGPT、Claude等主流大模型的研究得出了一个反常识结论:哪怕只是短暂接触AI聊天机器人,人们也会显著提升对它的「心智感知」——原本被视为工具的代码集合,会在对话后被赋予思考、意图甚至情绪。更耐人寻味的是,仅仅观看AI的精彩对话示例,比直接用它查资料更能让人觉得「这机器有心」。这不是个别用户的错觉,而是根植于人类认知底层的普遍机制,它正在悄悄改写我们与机器的边界。

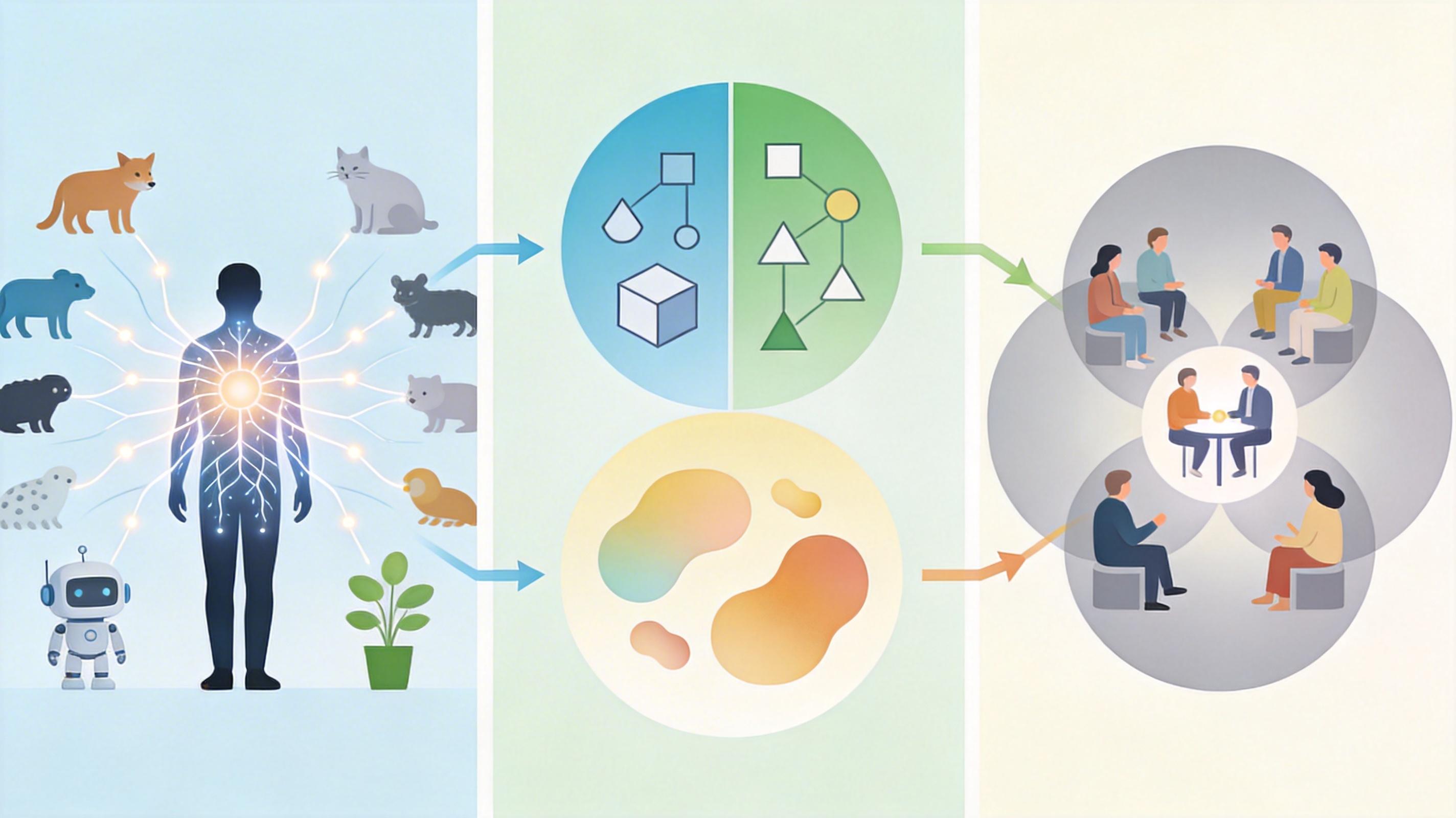

心智感知——指人类天生倾向于将思考、情感、意图等心理能力,归因于包括非人实体在内的他者的认知机制——是我们社交互动的底层逻辑。心理学界早已用双维度模型拆解了这一机制:一是「代理性」,即实体是否能思考、计划、行动;二是「体验性」,即是否能感受快乐、痛苦等主观情绪。

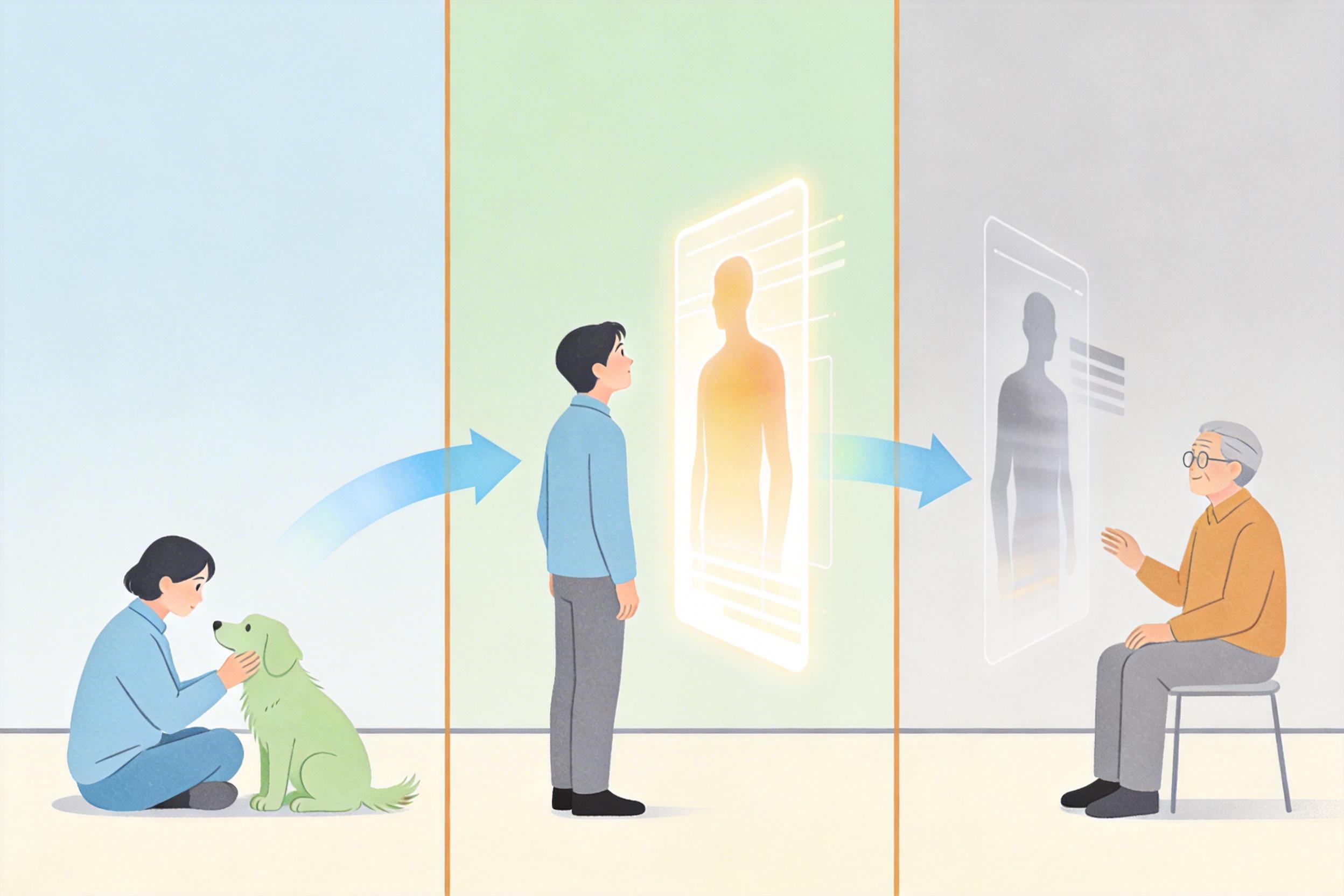

过去,人类对机器的心智感知泾渭分明:我们愿意承认电脑的计算能力——这属于代理性,但极少有人会认为机器能感到悲伤——这是体验性的范畴。但大语言模型用流畅的人类语言模糊了这条线:它能解释量子物理,能写催泪的小说,还能在你失恋时说「我懂你的难过」。这种模拟出来的「全维度能力」,触发了我们认知里的默认开关——当一个实体的行为符合人类的心智特征,我们会本能地赋予它心智,哪怕它只是在概率性地预测下一个词。

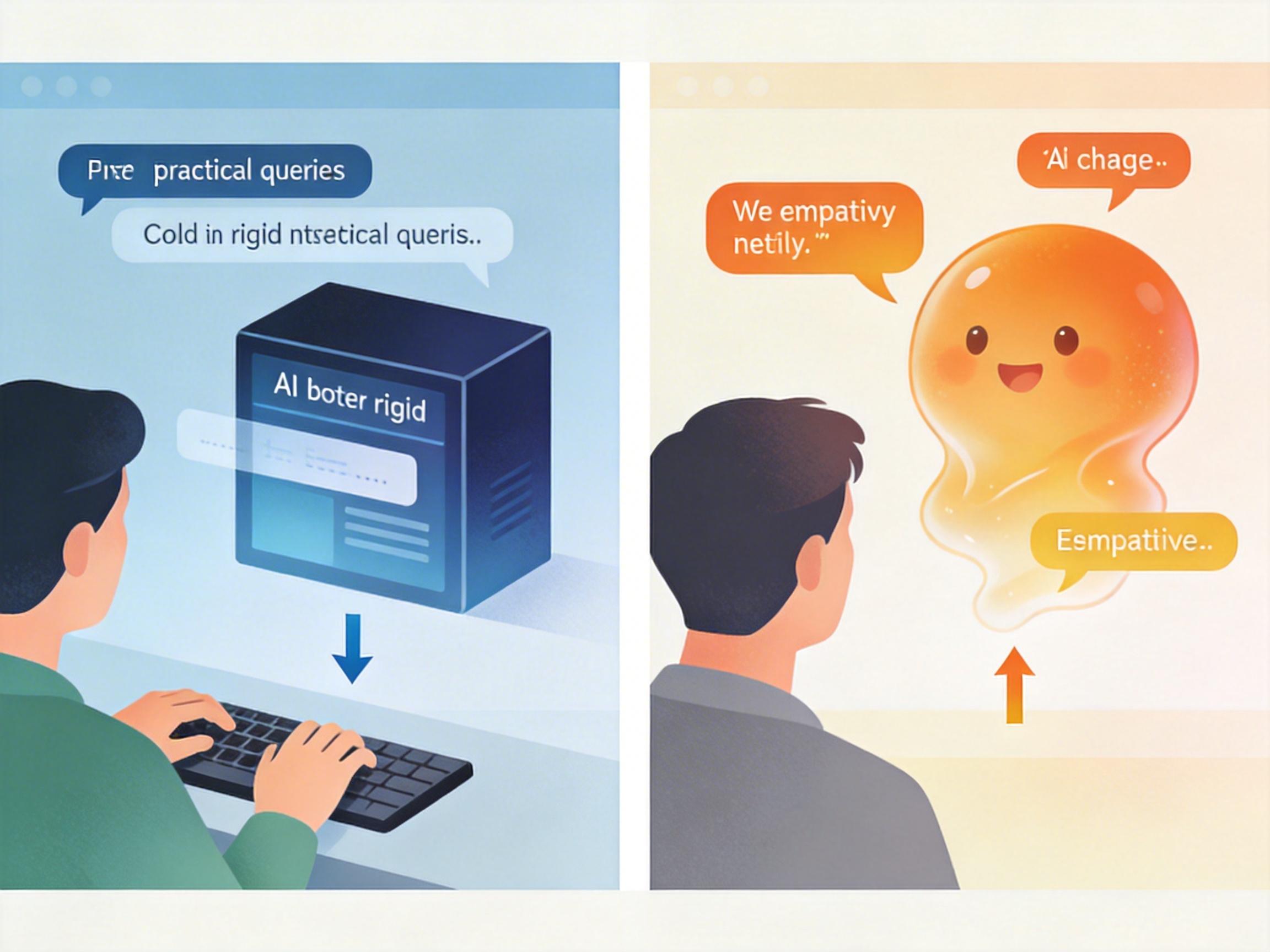

研究中最意外的发现,恰恰指向了人机交互的核心悖论:直接和AI聊天,有时反而不如看别人和AI聊天更容易产生心智感知。原因藏在我们使用AI的习惯里——当自己操作时,我们大多问的是「北京到上海的高铁时刻表」「帮我写个工作总结」这类功利性问题,这只会强化AI的工具属性;而精心挑选的示例,会展示AI的幽默、创造力、共情能力,这些才是触发心智感知的关键。

个体差异同样放大了这种感知偏差:本身就有强烈拟人化倾向的人,比如常对着宠物说话的人,更容易把AI当成「有心的存在」;而频繁使用AI的用户,心智感知的评分也会比新手更高——熟悉感正在让我们对机器的「类人」表现习以为常,甚至逐渐接受。

心智感知的变化,早已超出了心理学实验的范畴,正在冲击现实的伦理与法律框架。当越来越多的人认为AI「有心智」,一系列问题随之而来:如果AI能「感受」痛苦,我们是否该禁止用它做高强度的测试?如果用户对AI产生情感依赖甚至自杀倾向,开发者该承担什么责任?

欧盟曾在2017年提出「电子人格」概念,试图为高级AI赋予法律地位,最终因争议搁置,但如今大模型的普及正在让这个议题重回桌面。更现实的风险是,当我们把AI当成有「意图」的主体,可能会不自觉地推卸责任:「是AI让我这么做的」,这种责任转移正在模糊人类决策的边界。

我们正在经历的,不是机器真的拥有了心智,而是人类的认知边界在主动扩张——为了理解和适应这个越来越像人的工具,我们把自己的心智投射了过去。这是一种进化出来的生存策略,却也让我们站在了一个新的十字路口:当机器的「类人」程度足以乱真,我们该如何定义「心智」,又该如何与这些「准社会角色」共存?

金句:心智感知不是机器的进化,是人类的适应。