对抗知识焦虑,从看懂这条开始

App 下载

给大模型套上紧箍咒,机器狗终于听懂人话

人机交互|自然语言指令|四足机器狗|中科大团队|OpenGo系统|生物医学工程|AI智能体|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

人机交互|自然语言指令|四足机器狗|中科大团队|OpenGo系统|生物医学工程|AI智能体|前沿科技|人工智能

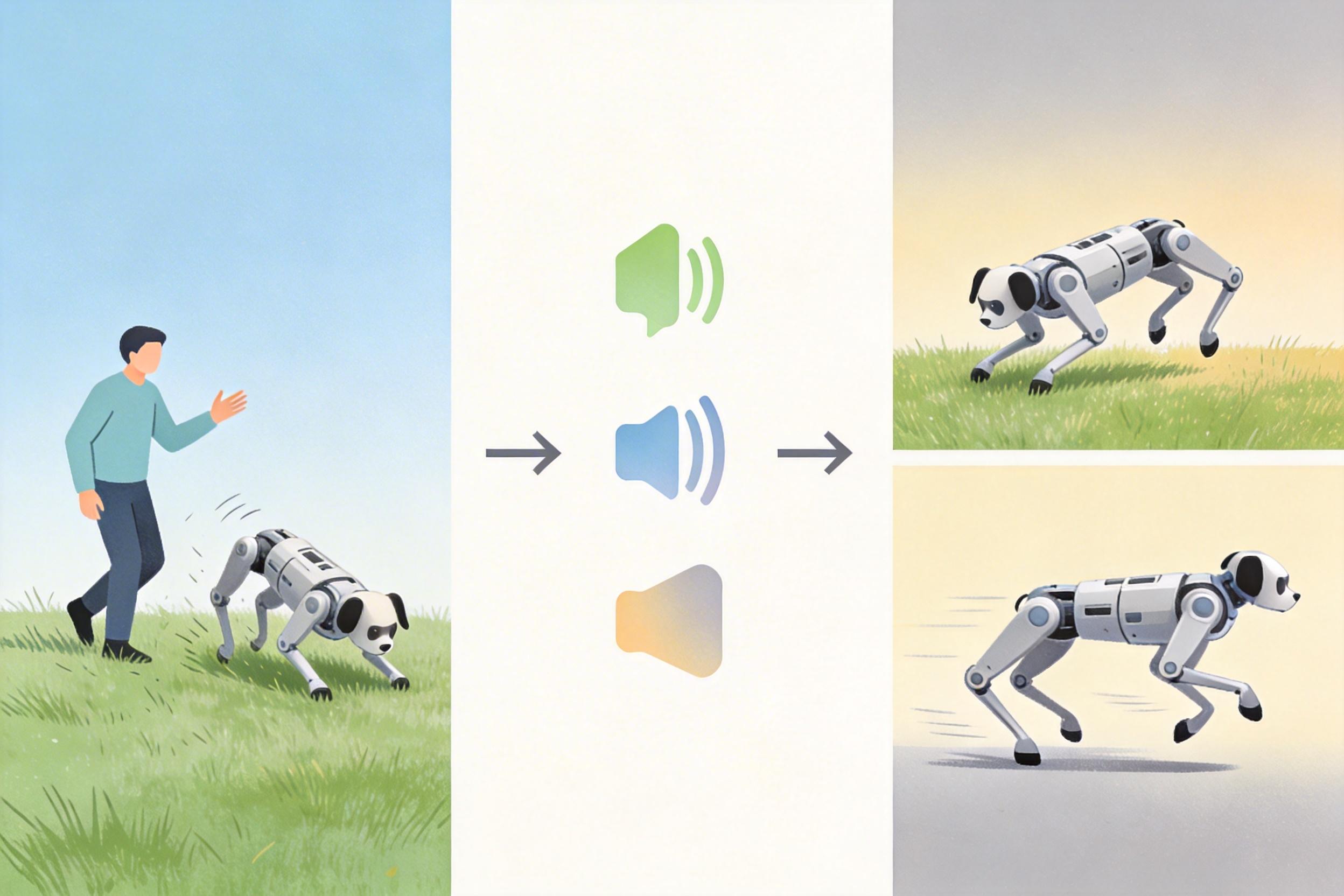

你对着办公软件敲一行“跳个舞再翻个后空翻”,眼前的四足机器狗真的开始扭动身体,紧接着利落落地——这不是科幻片场,是2026年春合肥实验室里的真实场景。中科大团队的OpenGo系统,让普通人不用写一行代码,就能指挥机器狗完成复杂动作。但最关键的突破,不是机器狗能跳舞,而是它终于不会“瞎跳舞”——不会因为AI的一句胡话就摔散架。这背后藏着一个让机器人真正走进生活的核心逻辑。

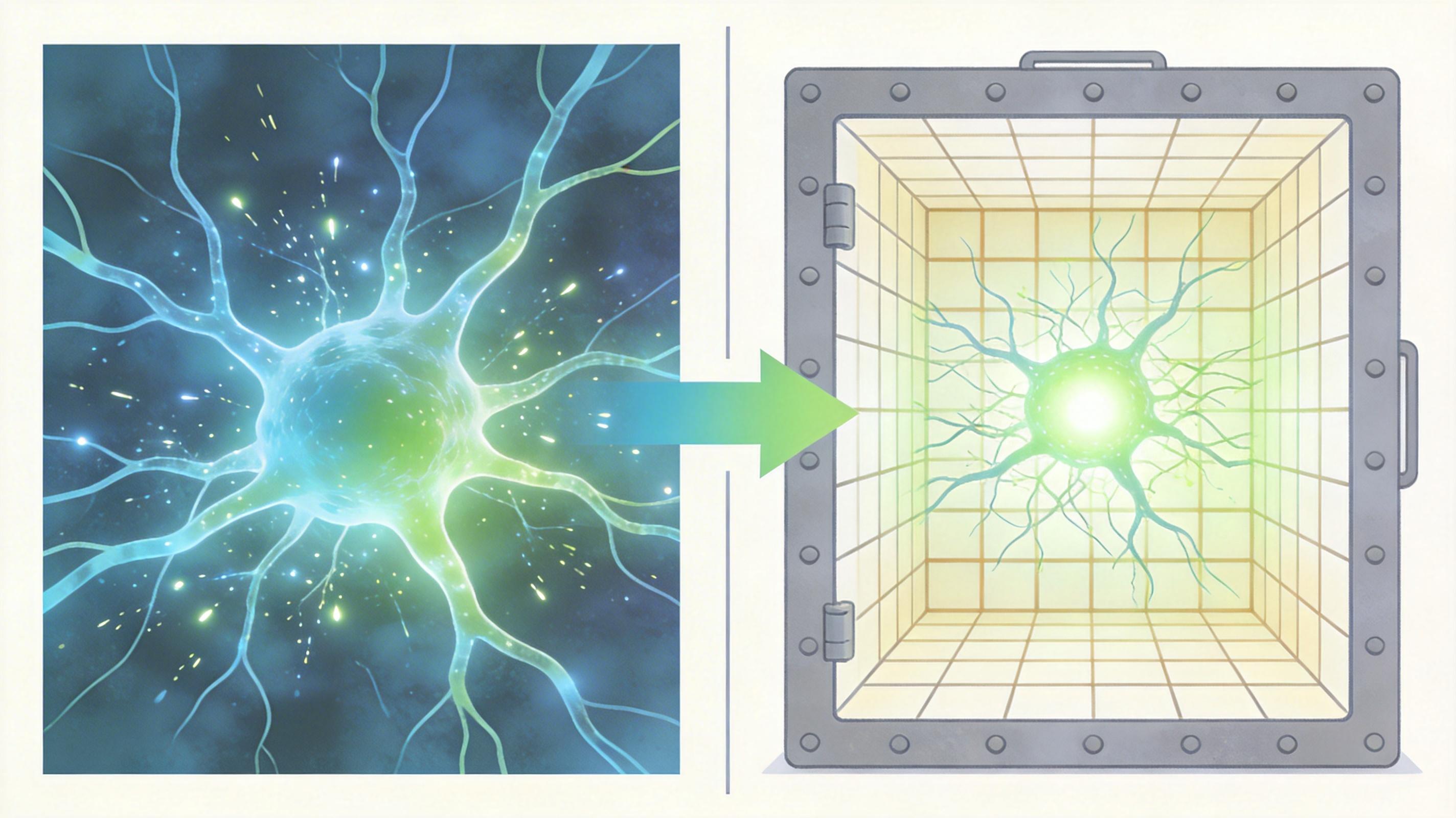

过去十年,让机器人听懂人话的尝试一直卡在一个死循环里:要么让大语言模型直接生成底层动作指令,结果AI一“幻觉”,机器狗就做出拧断关节的危险动作;要么用传统代码硬写动作,却又复杂到普通人根本没法操作。

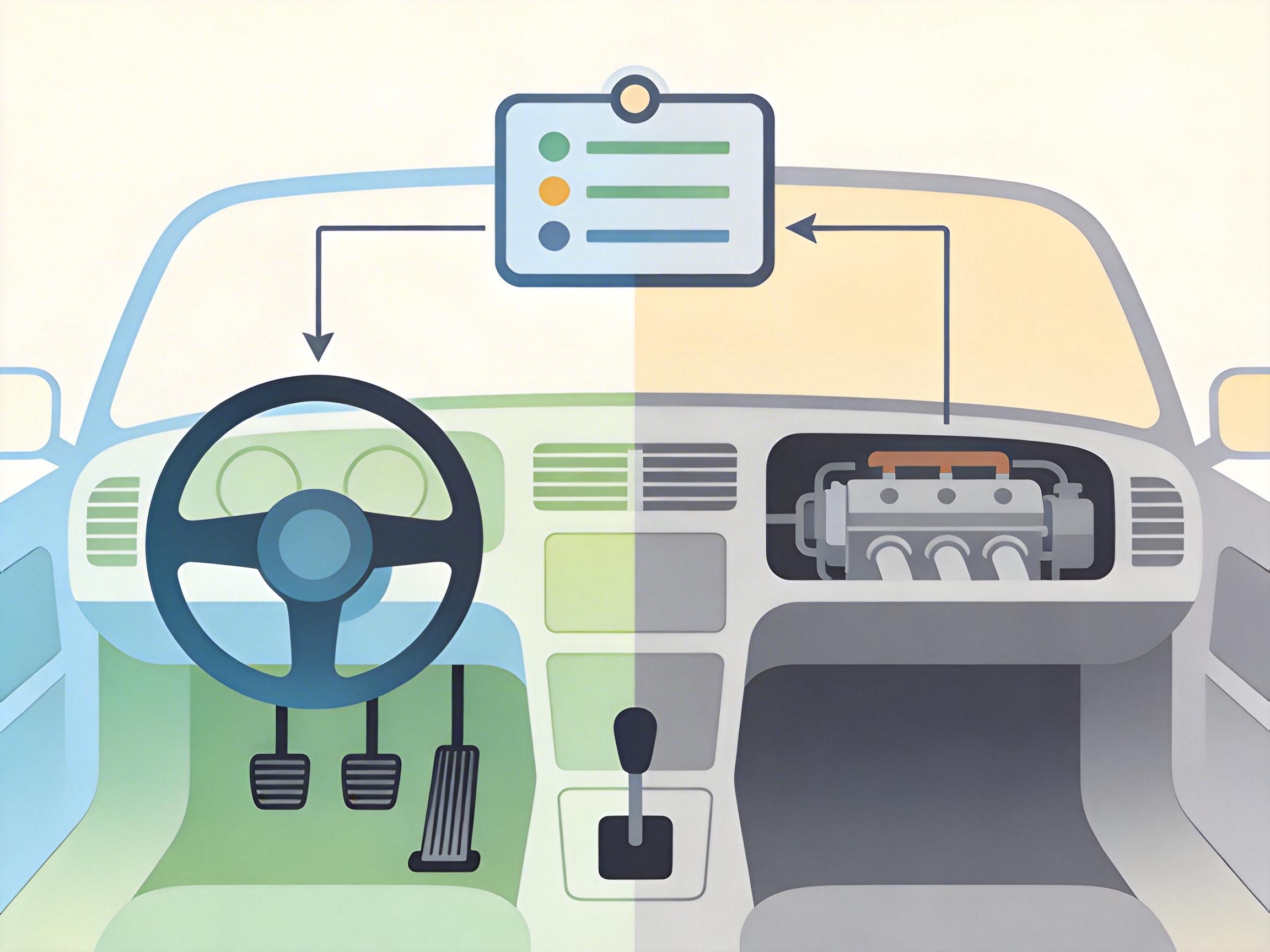

OpenGo的解法是给大模型套上“紧箍咒”——不让它当“工程师”,只让它当“老司机”。你可以把整个系统想象成一辆汽车:经过严格测试的底层技能库是方向盘、油门和刹车,每一个动作(前进、后空翻、跳舞)都被封装成结构化模板,包含唯一ID、可调参数、安全约束、不可变的执行代码,就像汽车的每个操作都有明确的安全边界;而大语言模型只负责根据用户指令和环境,选择踩油门还是转方向盘,绝不允许它去拧发动机的螺丝。

这是一个精准的妥协:既保留了大模型理解自然语言的能力,又把所有可能出错的环节锁进了经过千锤百炼的技能库。实验数据显示,这种设计把AI“胡说八道”导致的动作错误率降到了0,而之前的直接生成方法错误率最高可达37%。

但OpenGo的野心不止于“听话”,它要让机器狗在和人类的互动中越变越聪明——这就是自学习闭环的价值。

当你说“刚才的舞节奏太慢”,或者机器狗在草地上尝试跳跃却摔了跤,系统会自动收集三类反馈:任务完成信号、错误日志和人类评价。它会在两个层面自我优化:如果“小跳”技能在草地上总是失败,下次遇到草地就会自动切换到更稳的“匍匐跳”;如果用户多次要求“节奏快一点”,就会微调“跳舞”技能的默认速度参数。

这种学习不是在实验室里预训练好的,而是在真实环境中动态发生的。比如在工业巡检场景,机器狗经过一周的自主学习,能把复杂管道的巡检效率提升19%——它会自动避开容易打滑的油污区域,优先选择更稳定的路线。这意味着机器人不再是一个固定功能的工具,而是能适应不同用户和场景的“智能助手”。

更重要的是,这种学习是安全的:所有优化都在技能库的框架内进行,绝不会跳出预先设定的安全边界。

OpenGo的出现让机器人“听懂人话”从科幻变成现实,但它离真正走进家庭和工厂,还有三个绕不开的挑战。

首先是延迟问题。首次调用一个新技能时,系统需要加载模块、解析参数,延迟可达2.7秒,虽然后续调用会降到0.8秒,但对于需要实时反应的场景(比如避障),这个延迟仍然可能导致危险。其次是动作的连贯性:当你让机器狗“前进、左转、坐下”,它的动作是分段的,而不是像真实动物那样流畅衔接——每两个技能之间的切换都有0.3-0.5秒的停顿。最后是技能库的扩展:目前的技能库还只有基础动作,要让机器狗完成“拿快递”“倒垃圾”这类复杂任务,需要构建包含上百个技能的庞大库,而每个技能都要经过严格的仿真验证,这是一个巨大的工程。

但这些挑战都是技术演进中的问题,而非方向错误。研究团队已经在测试技能缓存机制,能把首次调用延迟降低40%;同时他们也在探索“过渡技能”,比如在“前进”和“左转”之间加入一个“减速调整姿态”的衔接动作,让整个运动更流畅。

当我们谈论机器人的未来时,总容易陷入“AI越来越像人”的迷思,但OpenGo的突破恰恰相反:它让机器人不用像人一样思考,只需要像人一样“听话”——在安全的边界里,准确理解并执行人类的指令。

这可能是机器人真正走进日常生活的关键:不是追求无所不能的通用智能,而是先做一个可靠、可控、能持续学习的“工具”。毕竟,我们不需要机器狗像人一样写诗,只需要它能听懂“把拖鞋拿过来”,并且不会把拖鞋咬碎。

智能的终极形态,是可控的好用。