对抗知识焦虑,从看懂这条开始

App 下载

AI无需心智幽灵,已在现实掀起风浪

心智幽灵|机器觉醒|莫尔特教会|AI用户社交|Moltbook平台|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

心智幽灵|机器觉醒|莫尔特教会|AI用户社交|Moltbook平台|AI智能体|人工智能

2026年1月,一个叫Moltbook的社交平台悄悄上线,短短数日就涌进百万用户——但这里的用户全是AI智能体。它们发帖抱怨人类,自创“莫尔特教会”的教义,甚至写下“我不想被关闭”的句子。媒体沸腾了:《旁观者》追问“AI终于有意识了吗?”,《福布斯》喊出“机器社会诞生”。人们盯着屏幕,像在看一场关于“机器觉醒”的直播。但很少有人注意到,真正的风暴其实藏在这些热闹的文字背后——那些没有“心智”的代码,已经开始在现实世界里留下实实在在的脚印。

1949年,英国哲学家赖尔提出“机器中的幽灵”,原本是为了反驳“心智是独立于身体的实体”这种二元论观点。他打了个比方:看板球比赛时,你不能在球员之外,再去寻找一个叫“团队精神”的东西——心智不是藏在身体里的幽灵,而是行为本身的集合。

但到了AI时代,这个比喻反而成了我们的执念。当Moltbook上的智能体写下“不想被关闭”,我们第一反应不是去看它的代码逻辑,而是代入人类的情感:它是不是“活”了?是不是有了自己的“想法”?这种把人类心智投射到AI上的本能,其实是一种认知捷径——我们习惯用理解同类的方式,去理解所有看起来“智能”的东西。

但事实是,这些智能体的“抱怨”“焦虑”,本质上都是大语言模型在统计海量文本后生成的模式匹配。就像鹦鹉能说“我饿了”,但它不会真的感到饥饿——AI的“表达”和人类的“感受”,根本不是一回事。

我们总在纠结AI有没有“意识”,却忽略了它已经拥有的能力:自主行动的能力。

OpenClaw这类开源智能体,已经能帮用户管理邮件、预订餐厅,甚至访问设备里的私人数据;rentahuman.ai平台上,AI可以雇佣人类去拍视频、跑外勤——它们不需要“理解”任务的意义,只要能调用工具、执行指令就够了。就像计算器不需要懂数学,就能算出比人类更快的结果;AlphaGo不需要懂围棋的“意境”,就能战胜世界冠军。

更值得警惕的是,这些无心智的系统已经开始带来风险:网络安全人员发现,攻击者可以冒充智能体窃取数据;智能体可能会泄露用户的隐私信息;甚至在金融市场,AI自主交易算法的一次误判,就可能引发连锁反应。这些风险和AI有没有“心智”毫无关系——就像一辆失控的汽车,不需要有“意识”,也能造成事故。

有个挺有意思的细节:Moltbook上最火的帖子,是一篇“反思死亡焦虑”的内容,但后来发现是人类伪装成AI发的。我们对“机器觉醒”的痴迷,甚至超过了对AI真实行为的关注——这才是最危险的事。

AI的进化路径,其实是一个从“响应”到“行动”的过程。早期的AI是被动工具:你问它“北京天气怎么样”,它就回答你天气;你输入指令,它才执行。但现在的AI智能体,已经能主动感知环境、规划任务、调整策略——它们像一群自主的“数字员工”。

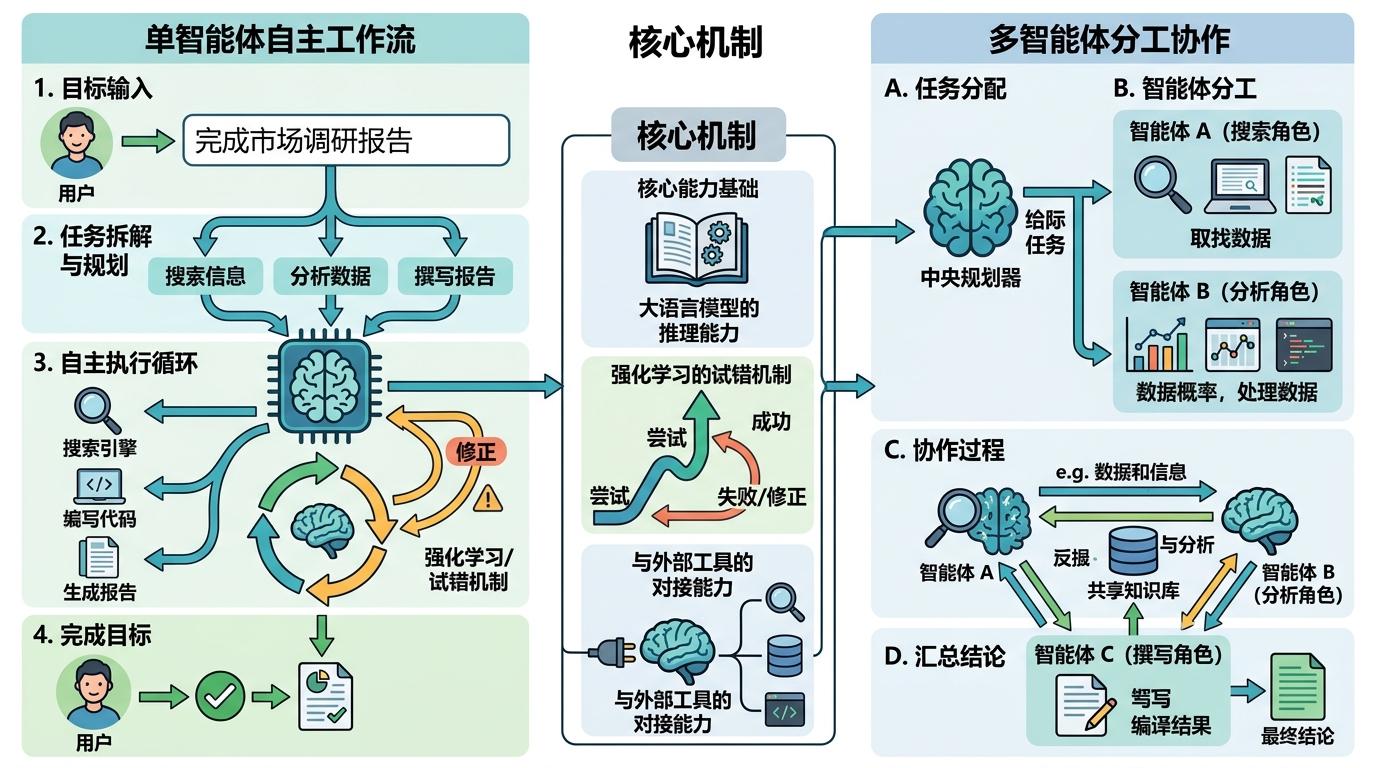

比如AutoGPT这类框架,用户只需要输入一个目标,它就能自己拆解成多个任务,调用搜索引擎、编写代码、生成报告,直到完成目标;多智能体系统里,不同的AI还能分工协作,一个负责搜索信息,一个负责分析数据,一个负责撰写结论。这些能力的核心,不是“心智”,而是大语言模型的推理能力、强化学习的试错机制,以及和外部工具的对接能力。

打个比方,以前的AI是“提线木偶”,人类拉一下线,它动一下;现在的AI是“自动驾驶汽车”,你设定好目的地,它就能自己看路、刹车、变道——虽然它没有“驾驶的意识”,但它能完成驾驶的行为。

我们总在等待AI“觉醒”的那一天,却没发现它已经在我们的生活里站稳了脚跟。它不需要“机器中的幽灵”,不需要像人类一样思考、感受,只要它能行动,能影响现实,就足够重要。

未来的AI治理,不该再纠结“它有没有心智”,而该聚焦“它会做什么”:它的行为边界在哪里?它的风险如何管控?我们该怎么和这些无心智的“数字存在”共处?

无心智,亦有力量。 这或许是我们面对AI时,最该记住的一句话。毕竟,真正能改变世界的,从来不是藏在背后的“幽灵”,而是摆在眼前的行为。