对抗知识焦虑,从看懂这条开始

App 下载

微软把2.47G语音模型压到0.67G,CPU也能秒回

CPU实时推理|模型压缩|语音识别模型|微软|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

CPU实时推理|模型压缩|语音识别模型|微软|AI产业应用|人工智能

你有没有过这样的经历:在地铁里对着智能手表喊“导航去公司”,它却卡了三秒才反应;开车时想让车载助手播首歌,得等它“听完一整句话”才肯动。这些尴尬的根源,是语音识别的“不可能三角”:要准确、要快、还要能在普通CPU上跑——就像既要马儿跑,又要马儿不吃草,还不能用高级饲料。

但微软的工程师们最近把这事儿做成了:他们把一个原本2.47GB的语音识别模型,压缩到了0.67GB,还能在纯CPU上实现7.2倍的超实时推理——也就是说,你说1秒话,它0.14秒就能转完文字,延迟只有0.56秒。这不是实验室里的花架子,是能直接装在智能手表、老旧手机上的实用技术。

要解决边缘语音识别的痛点,第一步不是急着“减肥”,而是选对适合的模型。微软团队拉来了6大主流语音识别模型家族,在8个标准测试集上做了50多种配置的对比,结果发现:那些在实验室里准确率超高的大模型,一到“流式处理”(边说边转文字)的场景就拉胯。

比如某款热门大模型,批处理模式下词错误率(WER)只有5.9%,但改成流式处理后,WER直接飙升到10.45%,延迟也超过2秒——完全没法用在实时交互场景。而英伟达的Nemotron-0.6B模型却脱颖而出:它天生带着“缓存感知”设计,就像人说话时会记得刚说过的内容,处理当前音频块时,能调用之前的上下文缓存,不用重复计算。

测试显示,Nemotron-0.6B在流式模式下的WER只有7.28%,仅比批处理模式高0.21个百分点,延迟低至0.56秒。这意味着它既能实时处理语音,又几乎没损失准确率,是天生的边缘设备“苗子”。

选好模型后,接下来是最关键的“减肥”环节。传统的模型压缩要么粗暴地砍掉参数,要么均匀降低精度,很容易把“有用的脂肪”也减掉,导致准确率暴跌。微软团队用的是一种叫K-Quant的“权重感知量化”技术,相当于给模型做“定向抽脂”——只压缩不重要的部分,重要的权重尽量保留精度。

你可以把模型的权重想象成餐厅里的服务员:有些服务员(绝对值大的权重)负责核心菜品,不能出错;有些服务员(小权重)负责端茶倒水,偶尔出错影响不大。K-Quant会给每个服务员打分,核心服务员的打分更高,压缩时优先保证他们的“服务质量”。具体来说,它会结合权重的绝对值和块内的均方根误差(RMS),给每个权重分配重要性,然后用优化算法找到最优的压缩比例,把模型从FP32精度压缩到4-bit。

结果超出预期:压缩后的模型体积只有0.67GB,比原来小了73%,但词错误率仅从8.03%上升到8.20%——精度损失微乎其微。更惊喜的是,压缩后的模型在CPU上的推理速度反而更快了,实时因子(RTFx)从6.73倍提升到7.2倍,完全满足实时交互的需求。

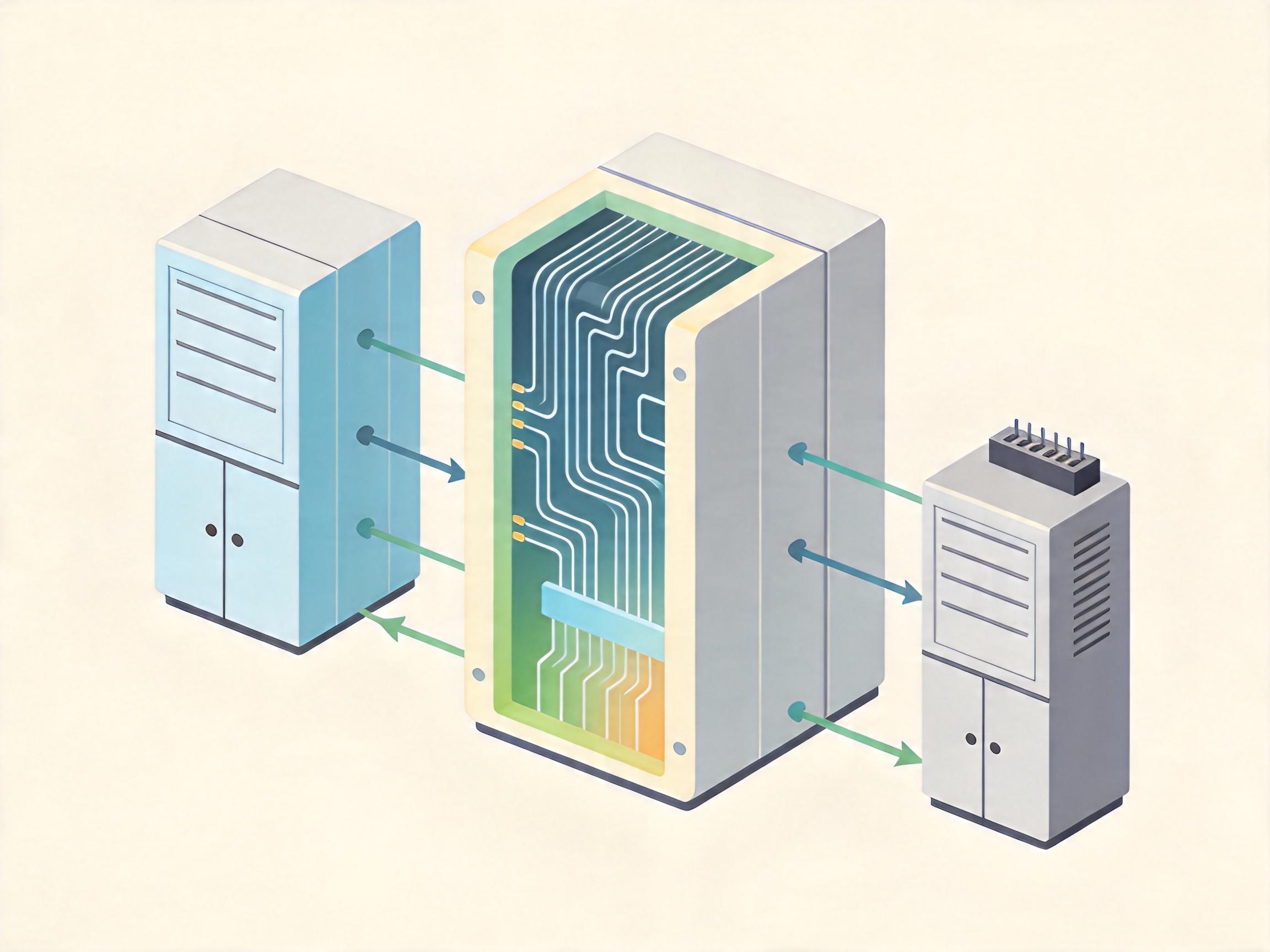

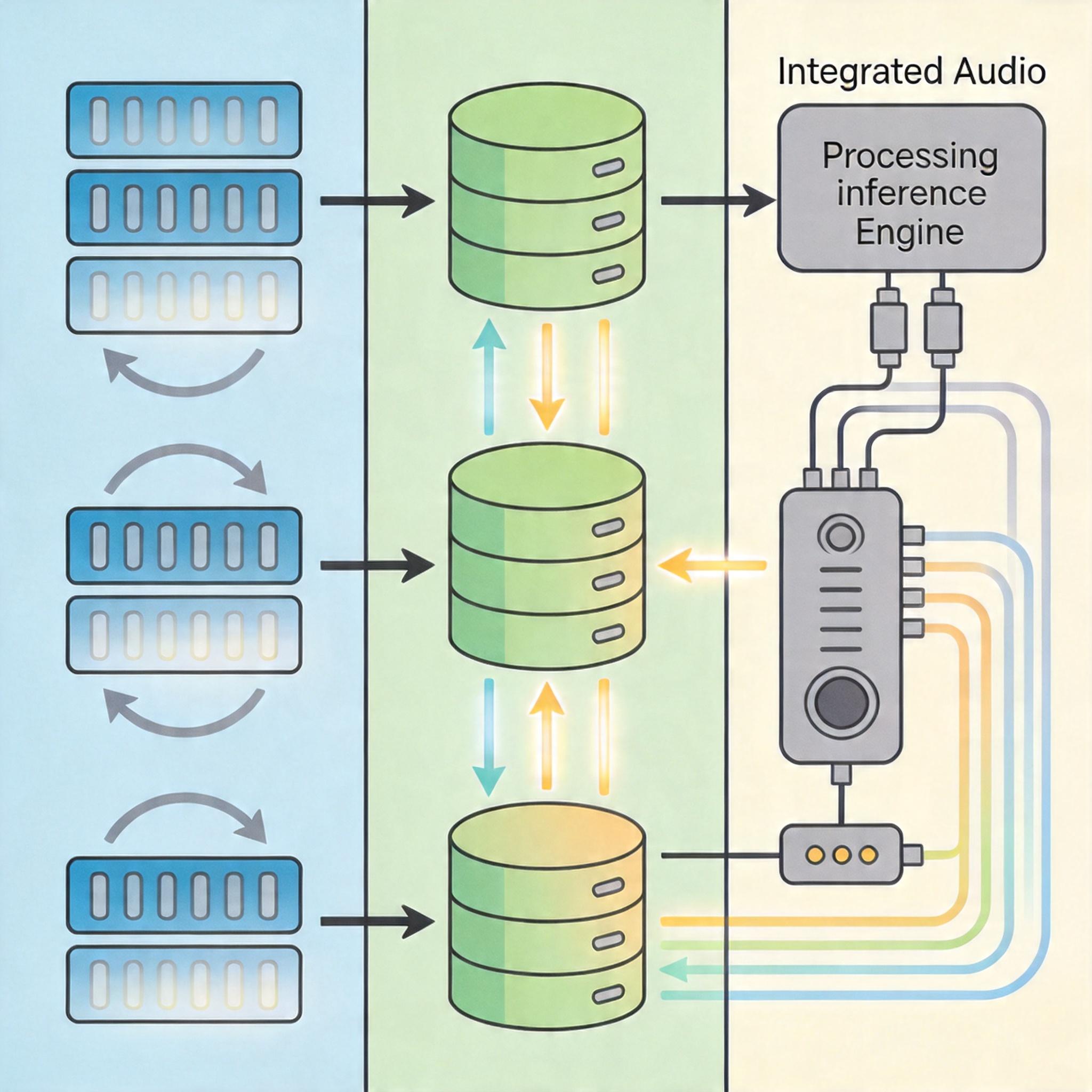

除了模型压缩,微软团队还做了很多容易被忽略的工程优化,让模型能在边缘设备上真正“跑起来”。比如他们把模型拆成编码器、解码器、连接器三个独立的计算单元,对计算量最大的编码器做专门的算子融合优化,就像把多个厨房工序合并成一条流水线,减少不必要的等待。

还有“零拷贝缓存管理”:流式处理需要不断传递上下文状态,传统方法会反复复制内存数据,浪费时间。微软团队设计了一种“原地更新”的机制,让上下文缓存直接在内存里更新,不用来回拷贝,进一步降低了延迟。他们还把音频预处理和解码逻辑直接集成到推理引擎里,去掉了对Python库的依赖,让模型能在更精简的环境下运行。

当然,这项技术也有局限:目前只针对英语模型优化,多语言和低资源语言的支持还需要进一步完善;而且测试是在服务器级CPU上做的,在智能手表这种超低功耗CPU上的表现,还需要更多验证。

当我们谈论AI的未来时,总习惯盯着那些参数百亿、千亿的大模型,却常常忽略了“让AI走进每一台普通设备”的重要性。微软这次的技术突破,本质上是把AI的“能力”从云端“搬”到了边缘,让智能手表、老旧手机、车载设备这些“非高端”设备,也能拥有流畅的语音交互能力。

更重要的是,它证明了AI的“普惠”不需要依赖昂贵的硬件,而是可以通过精准的技术优化实现。智能的未来,不在云端的超级计算机里,而在每个人掌心的设备中。当语音识别不再依赖高速网络和高端GPU,我们才能真正拥有“随时可用、安全隐私”的智能助手。