对抗知识焦虑,从看懂这条开始

App 下载

给AI装个“软缓冲”,高阶导数计算稳了

噪声鲁棒性|自动微分|高阶导数计算|Mollifier Layers|物理神经网络|应用数学|大语言模型|数理基础|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

噪声鲁棒性|自动微分|高阶导数计算|Mollifier Layers|物理神经网络|应用数学|大语言模型|数理基础|人工智能

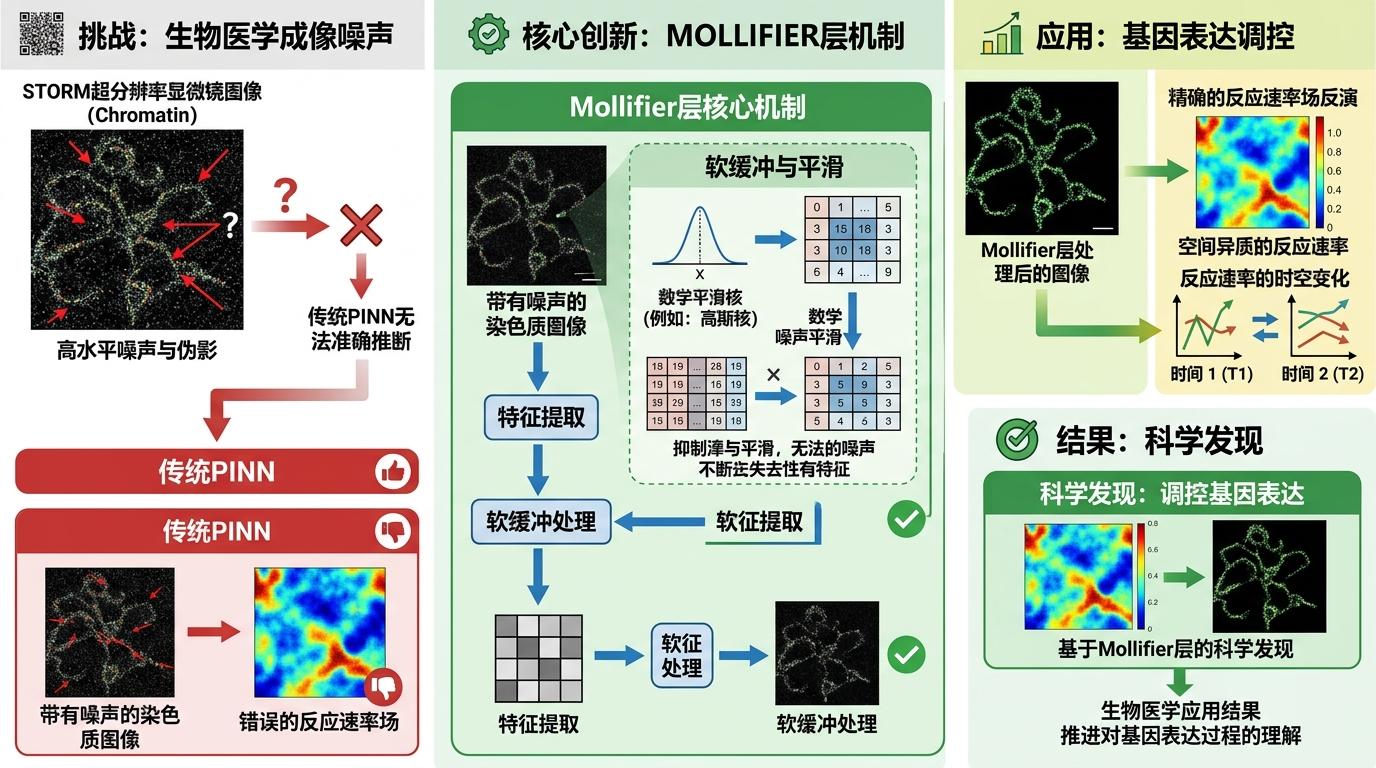

想象一下:你用AI模拟大气环流,刚算到四阶导数,GPU显存突然炸了;或者给细胞染色质建模,数据里的一点噪声,就让推导的反应速率完全跑偏。这不是科幻片里的bug,是物理神经网络(PINN)——用AI求解物理方程的核心方法——长久以来的噩梦。传统PINN靠自动微分算导数,就像用直尺量头发丝,稍微有点晃动就全错了,高阶导数、噪声、高频结构全是它的死穴。直到宾夕法尼亚大学的团队扔出了一个轻量模块,把训练时间砍到原来的1/10,还能在满是噪声的数据里精准算出高阶导数。这个叫Mollifier Layers(软化层)的小东西,到底干了什么?

你可以把传统PINN求导比作用针去扎气球——每一下都要精准戳在某个点上,稍微偏一点就前功尽弃。它依赖的自动微分,是通过链式法则一步步递归计算每个点的导数,就像传话游戏,从最后一个人往回传,中间只要有一个人说错,后面全乱套。尤其是算四阶以上的导数,误差会像滚雪球一样放大,计算量和内存占用直接指数级飙升,GPU分分钟罢工。

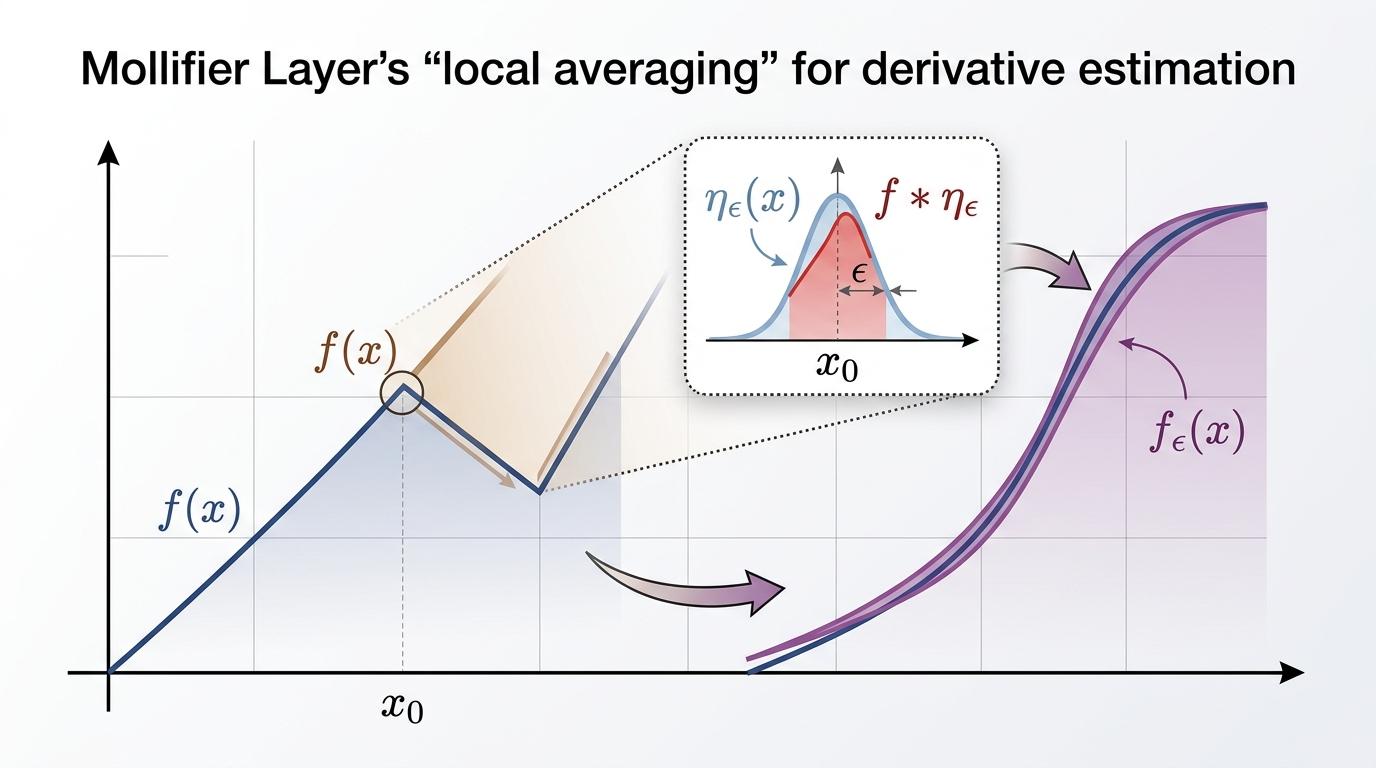

Mollifier Layers直接换了个玩法:它不盯着单个点算导数,而是把导数变成了“局部平均”——就像用一个软乎乎的圆片,在函数上蹭一下,通过圆片覆盖区域的积分来估算导数。这个圆片就是“解析核函数”,蹭的动作就是卷积。

这其实是把物理方程的“强形式”转换成了“弱形式”——就像你不用精准测量每一滴水的流速,而是用杯子接一分钟的水,通过水量来算平均流速。神经网络现在只需要输出一个中间场g,所有导数都由固定的卷积核从g里算出来,函数拟合和导数生成彻底解耦了。

这个软乎乎的圆片可不只是换了个计算方式,它自带低通滤波属性——就像相机的柔焦镜头,能把数据里的高频噪声模糊掉,只留下有用的信号。传统PINN里,哪怕数据里有一点噪声,都会在链式求导里被放大成致命误差;而Mollifier Layers的卷积核就像个缓冲垫,把噪声的冲击力卸掉了。

宾夕法尼亚大学的实验数据最有说服力:在四阶反应扩散方程的测试中,传统PINN要跑3386秒,Mollifier Layers只需要335秒,内存占用从2.75GB降到0.23GB,参数推断的相关系数从0.44直接跳到0.99。就算在满是噪声的朗之万系统数据里,它也能精准恢复出强迫项,而传统PINN早就乱成一锅粥了。

更关键的是,这个模块是轻量级的——就像给手机装个小插件,不用改原来的网络结构,直接插在输出层就行。它的误差是由核尺度和离散步长共同控制的,就像你可以调整柔焦镜头的焦距,在模糊噪声和保留细节之间找平衡,是个有明确偏差-方差权衡的统计估计器。

Mollifier Layers的野心不止于算方程,它已经走进了生物医学的实验室。研究人员用它处理STORM超分辨率显微镜拍摄的染色质图像——这种图像自带大量噪声,传统PINN根本没法从中推断出调控基因表达的反应速率。但Mollifier Layers的软缓冲,让他们能从模糊的图像里,精准反演出空间异质的反应速率场,甚至能追踪这些速率的时空变化。

这背后其实是计算力学和AI的跨界融合——Mollifier Layers的弱形式思路,本来就是有限元法的核心。过去AI团队搞物理神经网络,只招懂深度学习的人;现在不一样了,他们开始抢计算力学、流体力学的人才。毕竟,要让AI真正理解物理,光靠神经网络还不够,得把经典力学的老智慧装进去。

当然,它也不是完美的。目前卷积核的尺度还得手动调,面对多尺度、多物理场耦合的问题,固定核函数还是有点力不从心。但这些都是技术细节的优化,真正的革命已经发生了:AI求解物理方程,终于不用再在“精准”和“稳定”之间二选一了。

当我们习惯了用AI去突破算力的边界,宾夕法尼亚大学的团队却告诉我们:有时候,慢一点、软一点反而更快。Mollifier Layers没有发明新的神经网络结构,只是把70年前数学家提出的“平滑核”,变成了AI里的一层。它的成功,本质上是让AI重新回到了物理的基本逻辑——世界不是由一个个孤立的点组成的,而是由相互关联的局部构成的。

软缓冲里,藏着AI理解物理的新路径。 未来,当我们用AI模拟气候、设计材料、破解基因密码时,或许都会感谢这个不起眼的“软乎乎的圆片”,它让AI终于能稳稳妥妥地算出那些决定世界运行的高阶导数。