对抗知识焦虑,从看懂这条开始

App 下载

AI开发工具提速,却让38万应用裸奔

敏感信息暴露|访问权限|数据泄露|AI开发工具|RedAccess|网络安全|AI产业应用|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

敏感信息暴露|访问权限|数据泄露|AI开发工具|RedAccess|网络安全|AI产业应用|前沿科技|人工智能

当你母亲用AI工具花10分钟做了个家庭收支小程序,你可能会夸她赶时髦,但绝不会想到——这个随手生成的应用,正把家里的银行卡号、水电缴费记录摆在公开网络上。以色列安全团队RedAccess的扫描结果像一盆冷水泼下来:全球38万个用AI开发工具生成的公开应用里,近2000个在裸奔,医院的医生排班表、财富500强的战略文件、零售商的客户聊天记录,只要输对网址就能随便看。更可怕的是,这些开发者里,有一半根本不懂什么是「访问权限」。

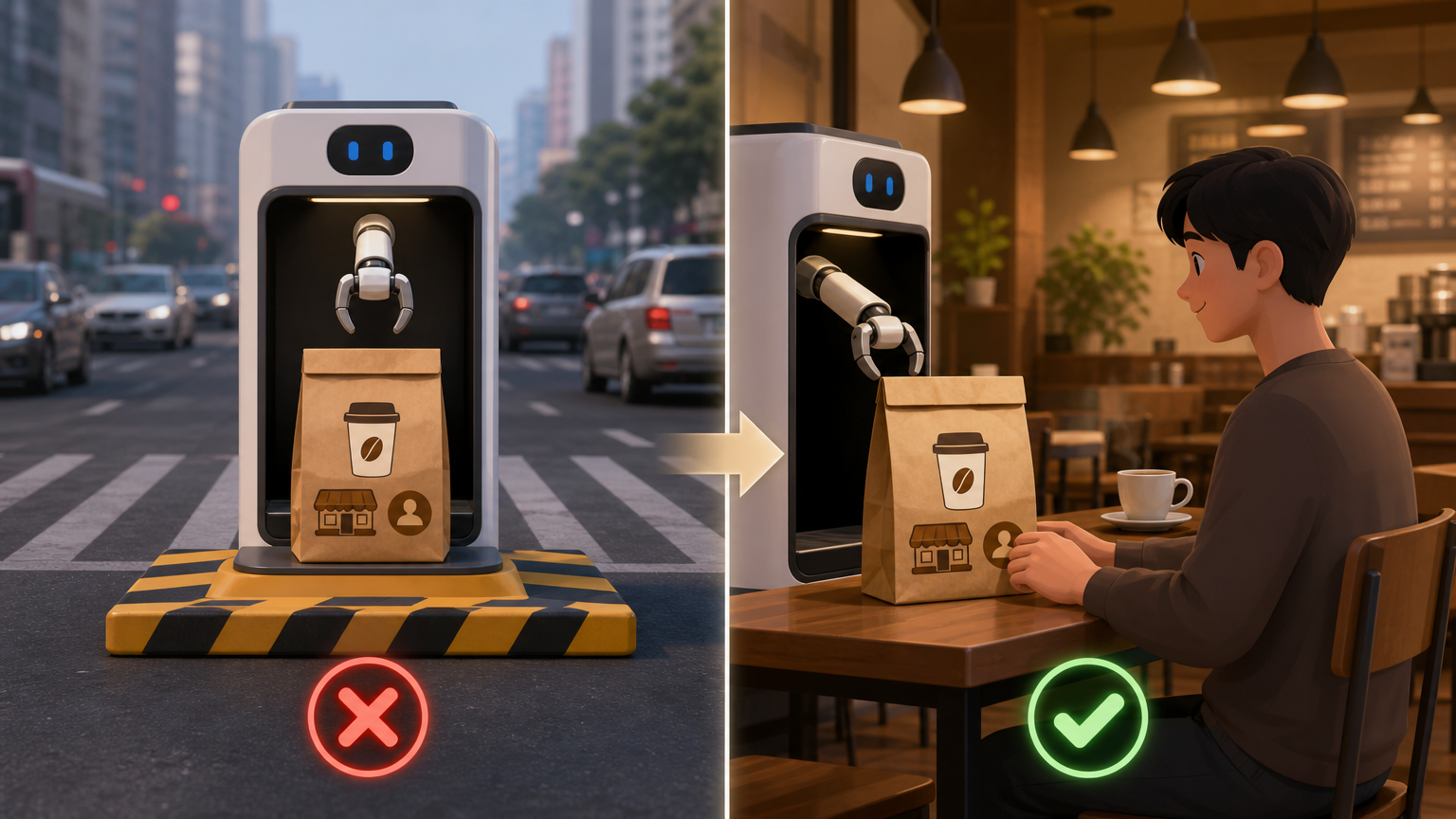

你可以把AI开发工具想象成自助快餐店的出餐机——输入「我要一个带会员系统的咖啡店小程序」,10分钟就能拿到一个功能完整的成品。但和快餐店不同,这些工具默认把你的「成品」摆在了马路中央,而不是你的餐位上。

RedAccess发现,多款主流AI开发平台的默认设置是「应用公开可见」,除非用户手动点进三层菜单去改成私密。更糟的是,这些平台的域名会被搜索引擎自动收录,也就是说,你随手做的测试应用,可能已经被Google标上了「可访问」标签。

直给的事实是:

但真实的机制比这更隐蔽:AI生成代码时,会优先保证功能能用,而非安全合规。比如你要一个「能看客户订单的后台」,它会给你做一个能看订单的页面,但不会给这个页面加「只有管理员能进」的限制——因为你没明确说。

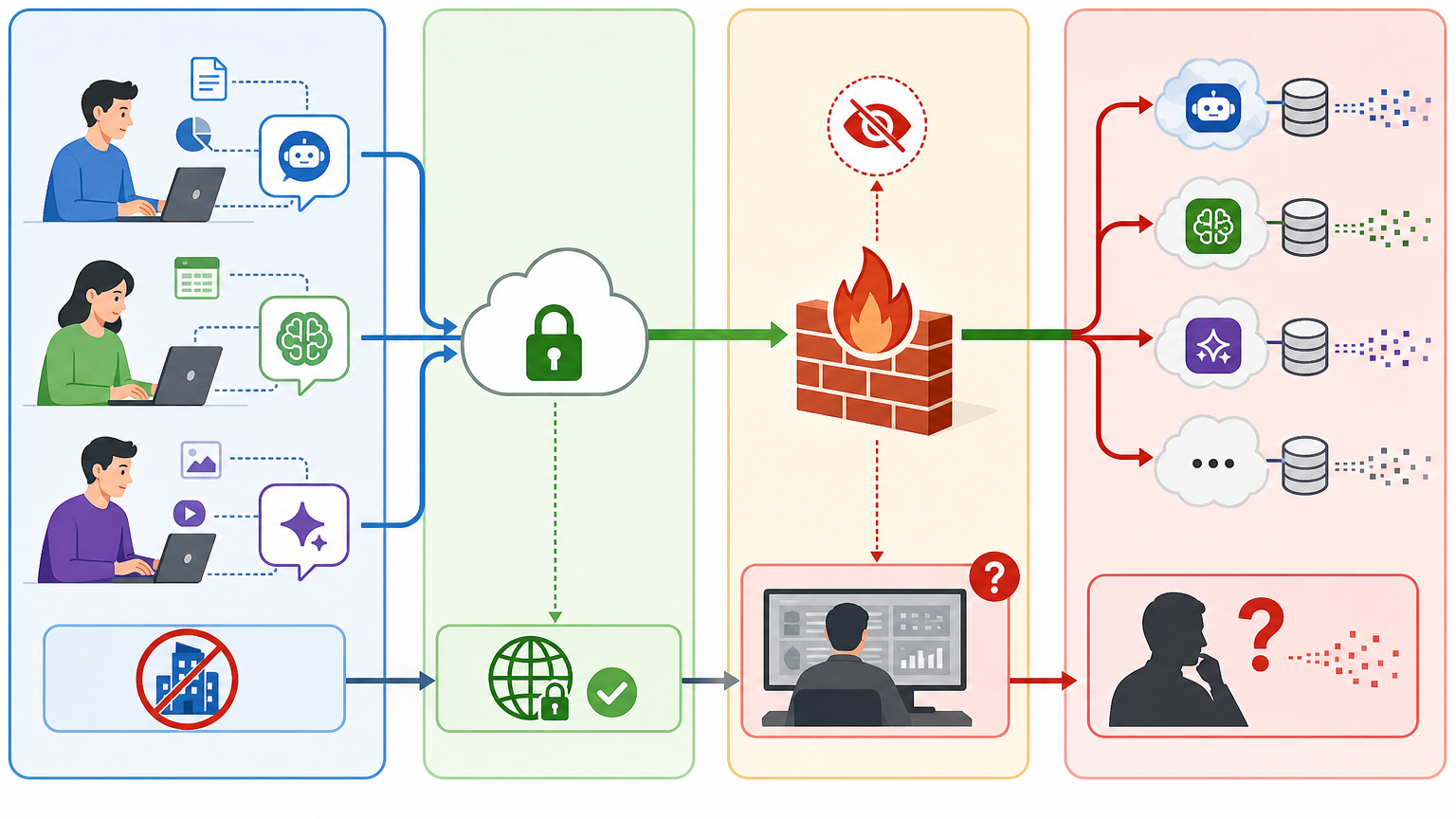

当市场部实习生用AI工具做了个客户调研小程序,并且直接把公司的客户通讯录导进去时,麻烦就从个人层面升级到了企业级。这种没走IT审批、没经过安全测试的AI应用,被称为「影子AI」——它们像企业网络里的隐形门,没人知道在哪,但黑客一找一个准。

RedAccess的CEO Dor Zvi举了个例子:他母亲用AI工具做了个社区团购的小应用,根本没考虑过「谁能看到团长的手机号」。而在企业里,这种情况每天都在发生:销售用AI做业绩追踪表,把公司的客户合同数据直接导进去;HR用AI做招聘系统,把求职者的身份证号存在了公开数据库里。

传统的企业安全体系对这些影子AI完全失效:它们不是从公司的开发平台生成的,IT部门看不到;它们的数据传输走的是普通HTTPS流量,防火墙查不出来;甚至当数据泄露了,企业都不知道是从哪个应用流出去的。

更值得警惕的是,AI生成代码的漏洞率比人工代码高40%。因为训练AI的公开代码里,本身就夹杂着大量不安全的写法——比如硬编码的密钥、没做输入验证的表单,AI会原封不动地把这些漏洞复制到新代码里。

面对安全问题,平台的回应几乎如出一辙:「我们给了用户安全工具,怎么用是他们的事」。比如某平台就表示,用户只要点一下就能把应用设为私密,但问题是,90%的用户根本不知道有这个按钮。

这种「把安全责任全甩给用户」的逻辑,就像卖菜刀的人说「我提醒过你别用它杀人」,却把菜刀直接递给了没拿过刀的小孩。RedAccess就曾曝光过某平台的一个漏洞:它生成的数据库代码会自动关闭行级安全策略,导致170多个生产应用的数据直接暴露,但平台坚持认为「保护数据是用户自己的责任」。

用户这边也有苦说不出:很多用AI开发工具的人不是专业程序员,他们不知道要设身份验证,不知道要加密数据库,甚至不知道自己的应用正在公开网络上。就像你用手机拍了张照片,默认存在了公共相册里,但你以为只有自己能看。

当AI把开发门槛从「会写代码」降到「会说话」,我们享受了效率的爆发,却也把安全的担子压给了一群毫无准备的人。这就像给了所有人一辆能开到200码的跑车,却没给他们发驾照,也没在马路上画车道线。

技术的便利从来都不是免费的,它的代价往往是看不见的风险。效率的前提,是把安全焊在每一步里。当我们为AI开发的速度欢呼时,别忘了回头看看那些被落在身后的安全栅栏——毕竟,一辆没刹车的跑车,跑越快越危险。