内容由AI生成,思考得你完成

App 下载

内容由AI生成,思考得你完成

App 下载

2022年Reddit的r/place像素画布上,1040万人用1.6亿次点击完成了一场数字狂欢。有人在上面画国旗,有人画动漫角色,还有人专门盯着别人的作品“搞破坏”——当一个精心绘制的图案被纯色块瞬间覆盖时,一场人类社群的“临界转变”就发生了。

这不是单纯的网络恶作剧,而是千万人参与的社会实验。普林斯顿大学的研究团队从这场像素大战里,挖出了预测复杂系统崩溃的新方法:用可解释机器学习,提前捕捉那些藏在混沌里的崩溃信号。更关键的是,它能说清“为什么会崩溃”——这是传统“黑箱”模型做不到的。

先得搞懂两个核心概念:

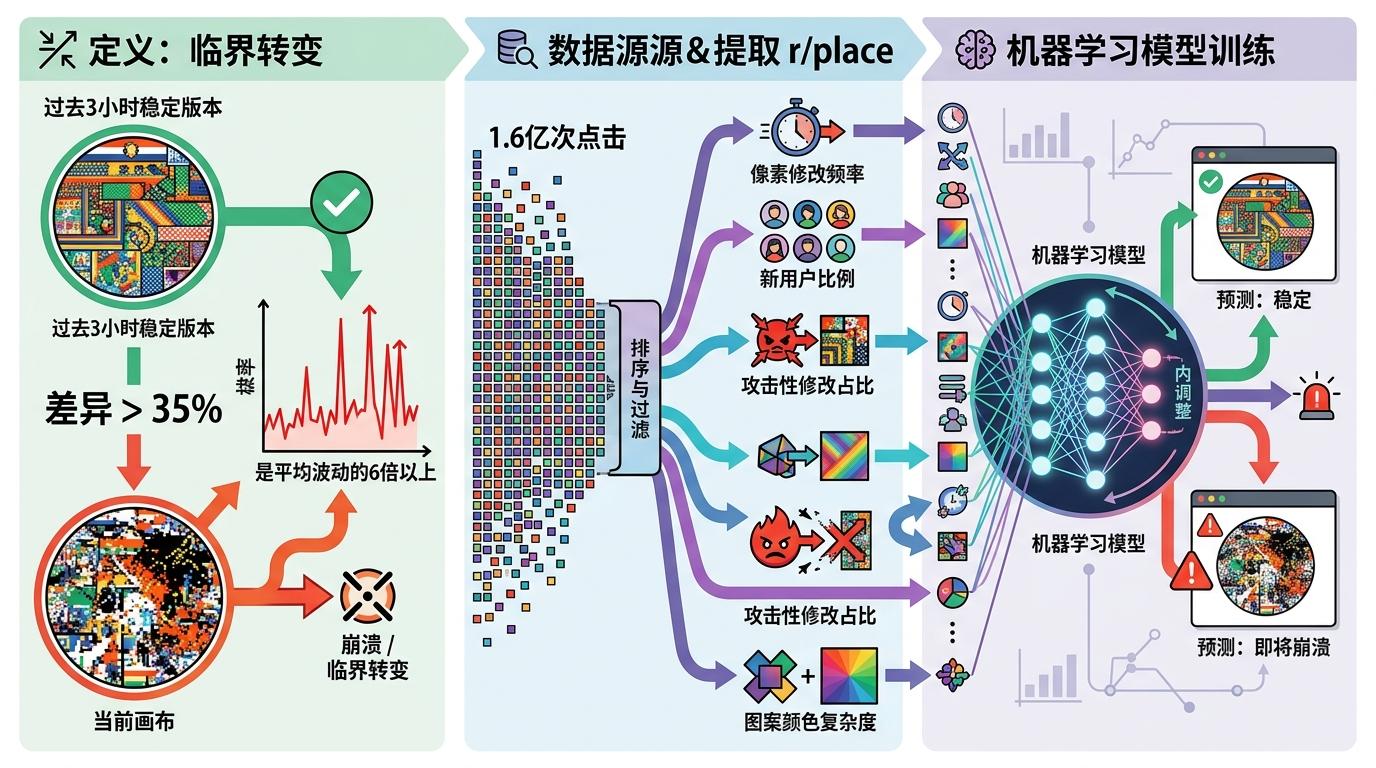

研究团队先给r/place的“崩溃”下了定义:当当前画布和过去3小时的稳定版本差异超过35%,且是平均波动的6倍以上,就算发生了临界转变。接着他们从1.6亿次点击里提炼出19个特征——比如像素修改频率、新用户比例、攻击性修改占比、图案颜色的复杂度等等,把这些喂给机器学习模型。

和传统只判断“会不会崩溃”的模型不同,这个模型预测的是“距离崩溃还有多久”。结果超出预期:在崩溃前20分钟,它的误报率只有3.6%;最远能提前6小时发出预警,这是传统方法根本做不到的。更厉害的是,用2022年数据训练的模型,直接用到2023年的像素大战里,性能只轻微下降——说明它抓住了人类社群行为的通用规律。

真正的突破在于“可解释”。研究用SHAP值(一种基于博弈论的解释方法)拆解了模型的决策逻辑,找出了六种预示崩溃的行为模式,每一种都能对应到现实世界的复杂系统:

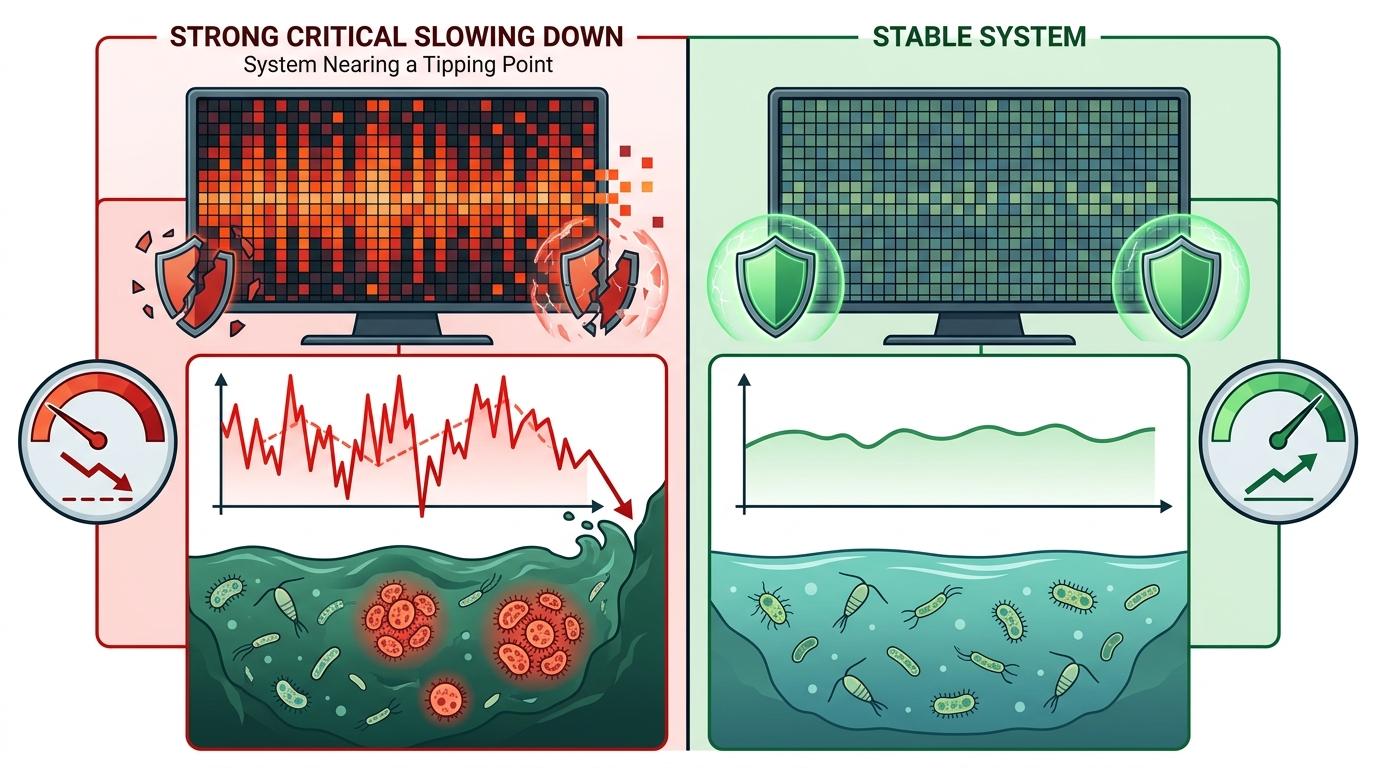

第一种:强烈临界慢化——图案的像素在短时间内疯狂变化,防御方完全控不住场面。这和经典理论里的临界慢化一致:比如股市崩盘前的高频波动,湖泊富营养化前浮游生物的极端波动,系统恢复力已经降到了最低点。

第二种:攻击力主导——80%以上的修改都是“攻击”(改颜色),而非“防御”(恢复原色)。就像外来物种繁殖速度远超本地物种,很快就能把生态系统彻底改写。

第三种:温和临界加速——防御方疯狂修复,但攻击也没停,冲突越演越烈。类比电力系统,当调度中心不得不频繁启用备用线路时,恰恰说明系统已经绷紧了弦,再遇扰动就可能全面停电。

第四种:创新真空——防御方只会机械地把像素改回原色,完全没想着调整图案或策略。就像企业面对市场颠覆,只会死磕旧产品线,最终被耗干资源。

第五种:冗余修改消失——那种“无意义”的重复修改(比如反复描图案轮廓)不见了。这些看似没用的行为,其实是社群凝聚力的信号,就像论坛里的灌水、表情包互动,它们消失了,社群离瓦解也就不远了。

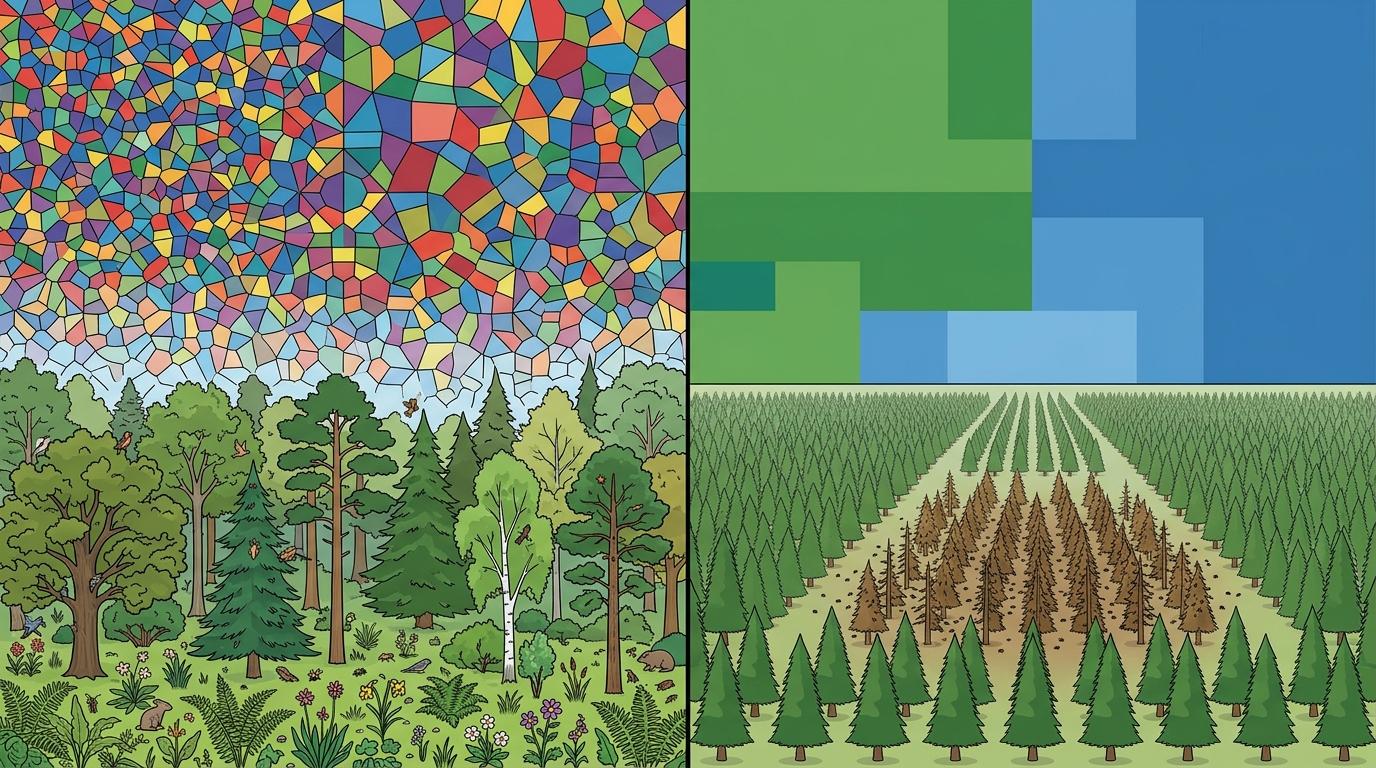

第六种:颜色熵降低——图案变得越来越简单,比如从彩色插画变成纯色块。简单结构的冗余度低,关键像素被攻破就会连锁崩溃,就像单一物种的人工林,一场病虫害就能全军覆没。

但研究也坦诚,不是所有崩溃都能预测——约27%的临界转变完全超出模型的判断。这些都是“黑天鹅”事件:

比如某个图案背后根本没有组织的社群,像素修改全是随机的,系统本身就没稳定状态,自然找不到崩溃的前兆;又比如一个小社群的作品突然被某个大社群盯上,瞬间被纯色块覆盖,这种外部突发冲击,从历史数据里根本找不到规律。

这也给所有预警系统提了醒:复杂系统里总有不可预测的变量,不能迷信模型的绝对准确。真正靠谱的做法,是用模型捕捉可预测的信号,同时给不可预测的黑天鹅留足缓冲空间——比如金融市场里的风险准备金,生态保护里的应急方案,社群管理里的备选策略。

这场千万人参与的像素大战,最终变成了一面镜子——它照出的不仅是人类的创造力和破坏力,更是复杂系统里共通的崩溃逻辑。

从像素画布到金融市场,从生态系统到网络社群,那些看似毫无关联的崩溃事件,底层的行为模式其实高度相似:当系统的恢复力下降、凝聚力瓦解、创新力枯竭时,崩溃就离得不远了。

可解释的不是模型,是人性的规律。未来的预警系统,或许不会是一个只会报警的黑箱,而是能像一个资深观察者,告诉你“系统出了什么问题,为什么会出问题”——这才是科技真正能帮到我们的地方:不是预测所有灾难,而是让我们在灾难来临前,多一点准备的时间和底气。