对抗知识焦虑,从看懂这条开始

App 下载

拿掉镜头的相机,看清了780纳米的细节

成像算法|指纹成像|合成孔径|郑国安团队|MASI无镜头成像系统|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

成像算法|指纹成像|合成孔径|郑国安团队|MASI无镜头成像系统|多模态视觉|人工智能

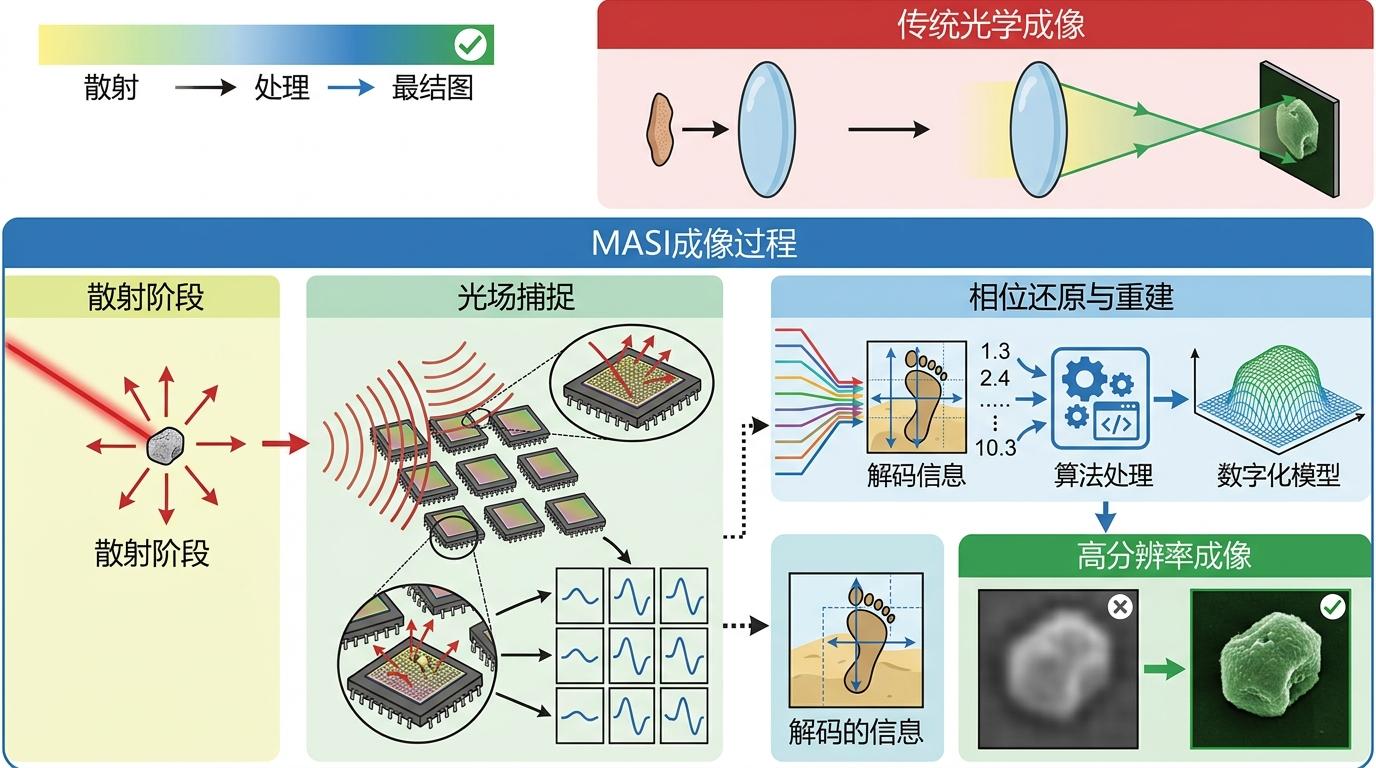

当你把手机摄像头的镜片抠掉,剩下的芯片只会拍到一片模糊的光斑——这是所有人默认的常识。但康涅狄格大学郑国安团队的实验,把这个常识碾得粉碎:他们用九块没有镜头的小芯片,在2.2厘米外看清了780纳米宽的线条,还把单芯片的成像范围扩大了16倍,拍下了完整的指纹。这套叫MASI的无镜头成像系统,没有复杂的光学镜片,没有精密的机械对准,只靠算法把散碎的光波信息拼回了清晰的画面。问题是,光本来越传越散,他们怎么反而从模糊里抠出了细节?

你可以把MASI的思路,想象成把全球的射电望远镜拼成一个“地球大小的虚拟望远镜”——2019年拍黑洞的事件视界望远镜,靠的就是这套合成孔径技术。不同的是,射电望远镜靠原子钟同步信号,MASI把这套逻辑搬到了可见光波段,用算法替代了硬件同步。

传统光学成像要拍清微小细节,要么把物体怼到镜头前,要么用大口径镜片把光“聚”起来。但MASI反其道而行之:它不聚光,反而利用光的扩散。物体表面反射的光会向四周散开,九块小芯片各自捕捉一小部分散开的光波,每块芯片上的编码图案能把光的强度信息,转化成包含传播方向的相位信息——这就像从脚印反推出人走路的方向。

接下来是最关键的一步:计算相位同步。每块芯片捕捉光时,都会自带随机的“时间差”,就像几个人用不同时区的手表计时。MASI指定一块芯片当基准,让计算机算出其他芯片需要调整的“时差”,把所有光波的步调对齐,再反向传播回物体平面,就像把散开的光重新“收”了回来。

MASI最聪明的地方,是把传统光学里最棘手的硬件问题,全丢给了算法解决。

传统合成孔径成像在可见光波段一直卡壳,因为可见光波长太短,传感器之间的同步精度要达到纳米级,差一点就会让光波完全错位。但MASI不需要硬件同步——九块芯片可以随便摆,不用对齐,不用重叠拍摄区域,甚至可以放在不同高度。所有的“对齐”工作,都由算法在后期完成。它只需要优化9个标量相位参数,计算量比传统干涉成像小得多,还能轻松扩展到更多芯片。

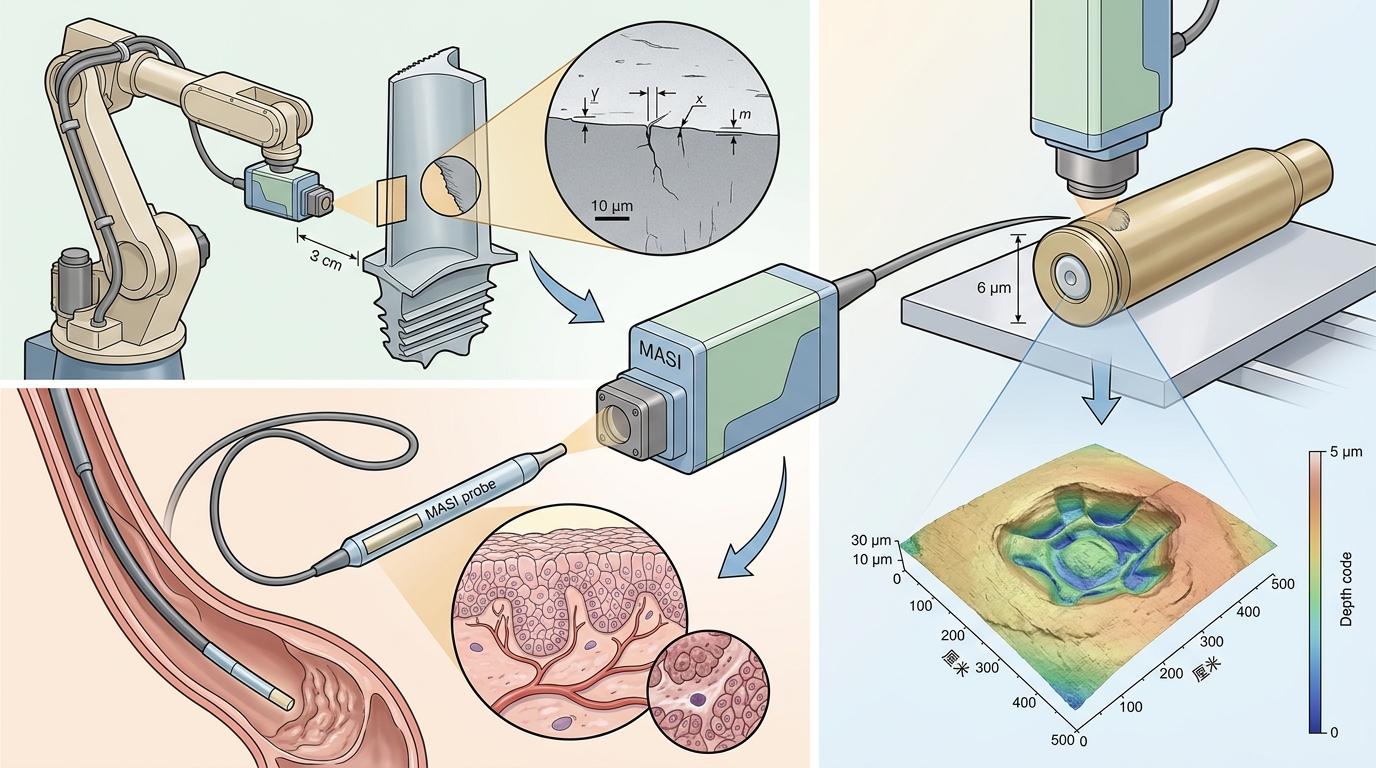

这种“软件优先”的思路,直接突破了单芯片的物理极限:单块4.6×3.4毫米的芯片只能拍到指纹的一小块,MASI通过数字外推把成像范围扩大到16.6×15.4毫米;单芯片只能看清2.19微米的线条,九块芯片合成后,在2.2厘米外就能分辨780纳米的细节——这相当于在手臂长度外,看清了一根头发丝的千分之一粗细。

当然它也有短板:目前只能用激光这类相干光源,在自然光下成像质量会打折扣;计算量不小,实时成像还得靠GPU加速;传感器的位置需要准确标定,误差大了会影响拼接效果。

现在的MASI,已经能在工业检测里派上用场——不用把机器拆下来,就能在厘米外看清零件表面的微米级瑕疵。如果再做小一点,它可以塞进内窥镜,穿过狭窄的手术通道,看清体腔深处的组织细节。郑国安团队甚至用它复原了子弹壳上的撞针凹坑,这个精度足够给法医鉴定提供证据。

更有意思的是它的物理加密特性:成像信息可以藏在单芯片的视野之外,原始数据里看不出任何痕迹,只有知道计算参数的人,才能把完整图像还原出来。这相当于给图像加了一层硬件级的锁,比软件加密更难破解。

团队的下一个目标,是把这套技术推去更远的地方——比如天文观测。就像事件视界望远镜用全球望远镜合成虚拟大口径,MASI可以用分布在太空中的小芯片,拼成一个“虚拟光学望远镜”,突破单一镜片的尺寸限制,看得更远、更清。

我们总觉得,要看得更清,就得把镜头凑得更近,或者造更大的镜片。但MASI告诉我们,光的扩散不是阻碍,而是藏着真相的线索——只要你懂得如何解码。

从射电望远镜的黑洞照片,到指尖的指纹细节,合成孔径技术一直在用“分散的小个体”完成“大个体”的任务。而MASI把这种思路推到了新的极致:它没有镜头,却给我们打开了一种新的“看见”方式——不用聚焦,不用对准,只要抓住光的碎片,就能拼出完整的世界。

看见的本质,从来不是聚光,而是解码。