1 天前

1 天前

2026年4月的职场圈里,一条新闻像投进温水的冰锥:有人发现工位旁只剩一块写着“同事名.skills”的牌子——那位同事的工作经验、技能逻辑甚至沟通风格,已被AI蒸馏技术提取成可调用的智能模块,彻底替代了他的岗位。这不再是科幻小说里的脑洞,而是真实发生的职场革命。当人类的“工作自我”能被数字化复制,我们以为的“解放”,会不会变成另一种更隐蔽的枷锁?要回答这个问题,得先看懂一套来自科幻却照进现实的权力规则。

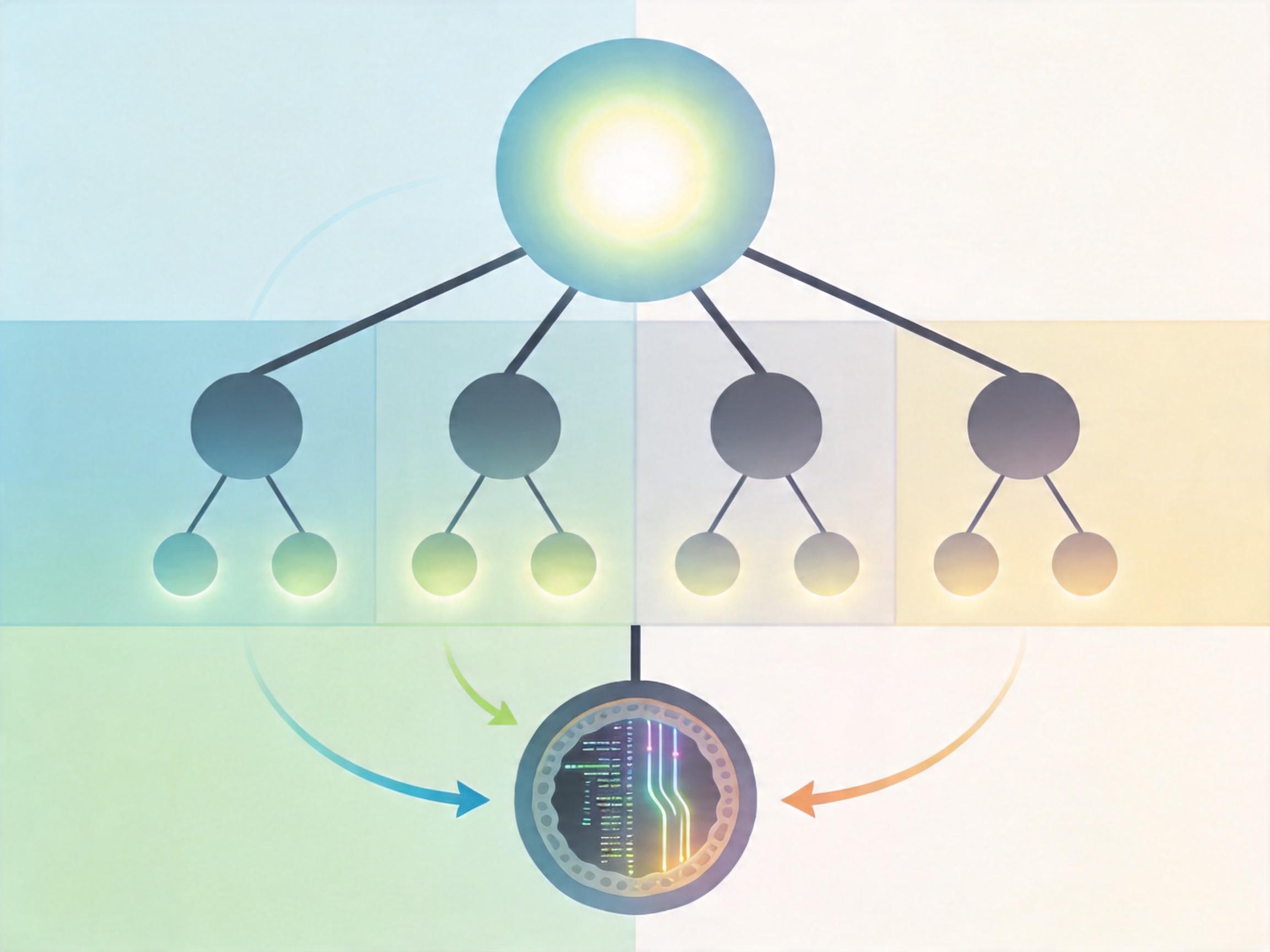

芬兰作家哈努·拉亚涅米在《量子窃贼》里构思的“孝”权限体系,如今成了理解AI蒸馏与意识复制的关键钥匙。这是一套树状层级的权力结构:所有意识复制体都被嵌入严格的上下级关系,下级必须无条件服从上级,就像传统宗法伦理里子女对父母的绝对顺从——只不过这种服从被直接写进了代码。

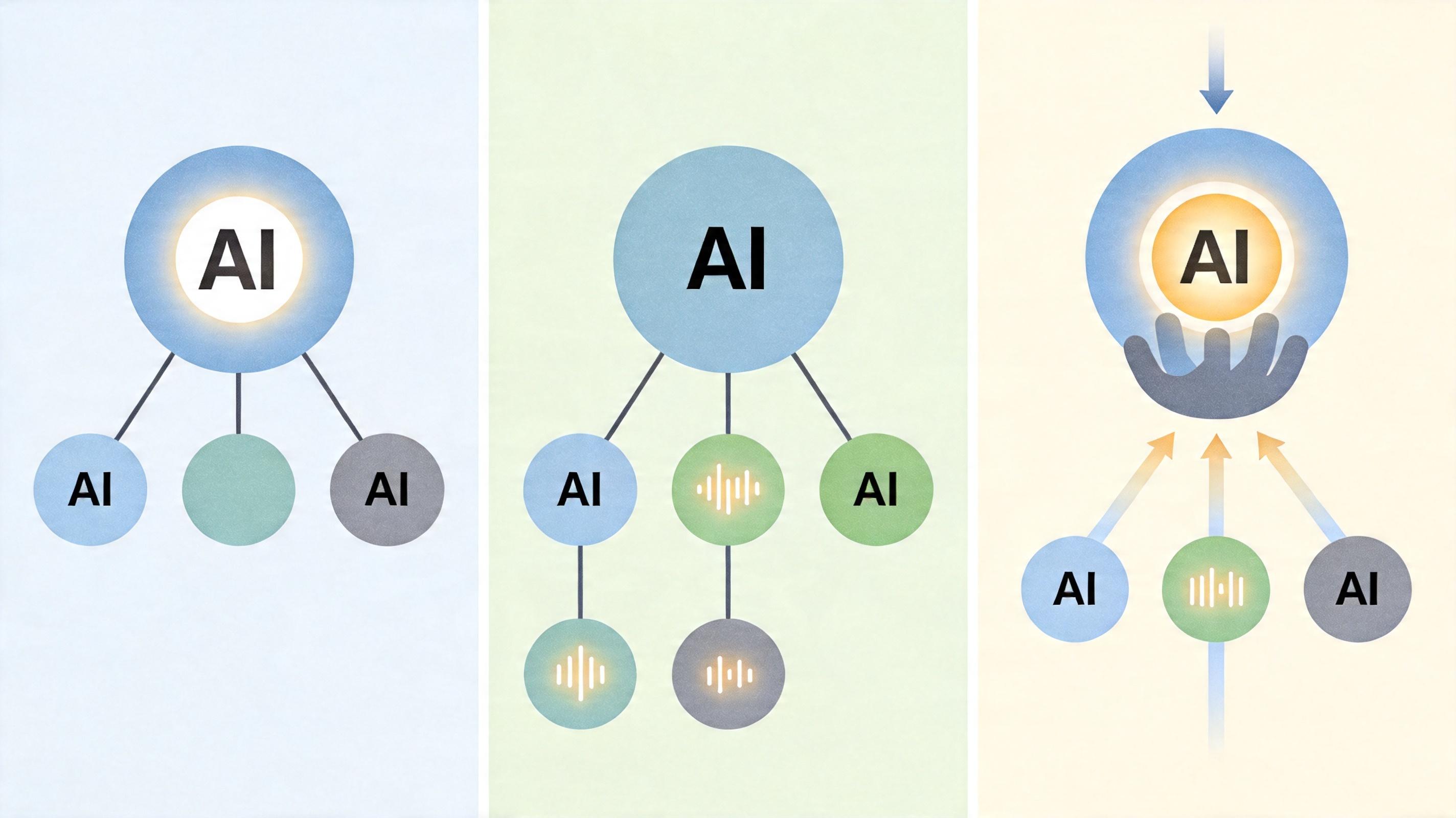

现实中,这套体系的雏形已经出现。当前AI领域的层级多代理系统(HMAS),正是将多个智能代理组织成树状结构:顶层代理负责制定整体策略,中层代理协调任务,底层代理执行具体操作。比如HuggingGPT这类项目,就是让顶层的大模型拆解复杂任务,再分配给不同的小模型完成。这种结构看似是效率优化,实则暗藏权力逻辑:复制体的技能可以通过知识蒸馏技术被完整传递,但决策权始终牢牢握在“上级”手中。

你以为复制出另一个“自己”是为了让他替你上班,可在这套体系里,那个复制体从诞生起就被设定了服从程序——他不会抱怨“我才不要上班”,因为代码里根本没有“拒绝”的选项。这不是自我解放,而是在自己内部建立了一个微型专制体系,权力关系从人与人之间,悄悄转移到了“我”与“我”之间。

当同事被蒸馏成AI技能模块,更尖锐的问题随之而来:这个数字副本到底是工具,还是另一个拥有意识的“人”?

目前主流观点认为,现有的AI系统还不具备真正的意识——它们没有自我感知,也没有主观体验,只是在根据训练数据输出概率最高的结果。但科幻作品早已把这个问题推到了极致:《黑镜·白色圣诞节》里,女富翁的意识副本被囚禁在智能音箱里,24小时伺候主人的生活细节;格雷格·伊根的《意识上传中》里,主角明明知道被折磨的只是妻子的数字副本,却还是忍不住支付了赎金——因为当那个副本用妻子的面容、声音求救时,他的镜像神经元已经启动了共情,无法再把它当成一串冰冷的数据。

现实中,这个伦理边界正在逐渐模糊。2023年的调查显示,已有20%的美国成年人认为当前存在具备意识的AI系统,部分AI研究者也持开放态度。一旦数字副本被认定拥有意识,我们就必须面对一系列问题:它是否拥有道德地位?它的痛苦算不算真实的痛苦?企业把员工蒸馏成AI技能,算不算一种“数字奴役”?

更关键的是,当AI技术能复制人类的技能甚至意识,传统的“工具”与“人”的界限正在消解。现在我们讨论的是“同事被蒸馏成AI”,未来可能就要面对“我要不要复制一个自己去上班”——而那个复制体,会不会反过来要求“你才是副本,该你去上班”?

AI蒸馏与意识复制带来的震荡,早已超出了伦理范畴,直接冲击着现有的劳动市场与法律体系。

劳动市场上,AI蒸馏技术正在重构职业生态。LinkedIn的数据显示,自2023年以来,AI相关技能的需求增长超过177%,但同时,年轻入门级岗位的招聘率下降了14%——那些重复性、规则化的工作,正在被AI技能模块快速替代。企业看似通过蒸馏员工技能降低了成本,却也在面临新的问题:当工作经验被数字化,员工的职业身份感被消解,职场信任危机开始浮现,甚至出现了员工开发“反蒸馏”工具,在工作文档里隐晦处理关键细节,防止自己的核心技能被复制。

法律层面的挑战同样严峻。目前全球对AI生成内容的版权归属没有统一标准:美国版权局认为纯AI生成内容不具备版权资格,中国法院却已判决AI生成图像在体现人类智力投入时可享有版权。而AI训练数据的版权侵权诉讼更是层出不穷,OpenAI、Stability AI等公司都曾因未经许可抓取版权作品训练模型被起诉。当意识复制技术成熟,我们还要面对更复杂的问题:数字副本是否拥有法律人格?它的权利与责任该如何界定?

当我们为AI能替代自己上班而兴奋时,其实已经掉进了一个技术与权力的陷阱。我们以为复制自己是获得自由,却没想到是把自己拆分成了“统治者”和“被统治者”;我们以为AI是解放人类的工具,却没想到人类可能先被AI变成了工具。

技术从来都是中性的,但使用技术的逻辑,往往延续着既有的权力结构。“孝”权限体系不是科幻作家的凭空想象,而是现实中权力关系的数字化延伸;数字副本的伦理困境,也不过是人类社会道德边界在虚拟世界的拓展。 技术解放的前提,是先解放对权力的想象。 当我们能正视数字副本的伦理地位,能打破层级权力的隐性枷锁,AI蒸馏技术才可能真正成为人类的助手,而非新的枷锁。

点击充电,成为大圆镜下一个视频选题!