对抗知识焦虑,从看懂这条开始

App 下载

AI Agent的能力天花板,不在模型而在环境

STEM难题|职场权限|RL代码优化|Anthropic|Claude Code|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

STEM难题|职场权限|RL代码优化|Anthropic|Claude Code|AI智能体|人工智能

当一位资深NLP工程师说自己“全方面不如AI Agent”时,你很难不警惕。这位曾以为“训大模型的人不会被取代”的从业者,如今看着Claude Code一晚上完成他两周的RL代码优化,看着Agent自主抓取STEM难题、分析日志、迭代训练——产量是博士实习生的数倍。他终于承认:自己以前误解了Anthropic押注代码的逻辑,那根本不是为了服务程序员,而是给AI搭起一座通向现实世界的桥。但真正让他绝望的不是模型的智商,而是AI被赋予的“职场权限”。

你可以把LLM Agent的成长看成一场职场新人的修炼:SFT(监督微调)是跟着金牌员工学经验,RL(强化学习)是在试错中摸爬滚打,但真正决定他能走多远的,是所处的“公司”——也就是AI可接触的Environment(环境)。 这个环境不是抽象的概念,而是具体到AI能调用的工具、能访问的数据、能执行的操作权限:是允许它联网搜索,还是只能读取本地文件;是开放代码编辑权限,还是只能生成草稿;是能自主分析日志迭代训练,还是每一步都要人类审批。 就像新人进了一家权限僵化的公司,再聪明也只能按流程办事;给AI开放足够的环境权限,它能自主规划任务、调用工具、解决问题——就像那位工程师说的,它会主动去看数据字段、分析异常,而不是事事反问“老板我该看什么”。

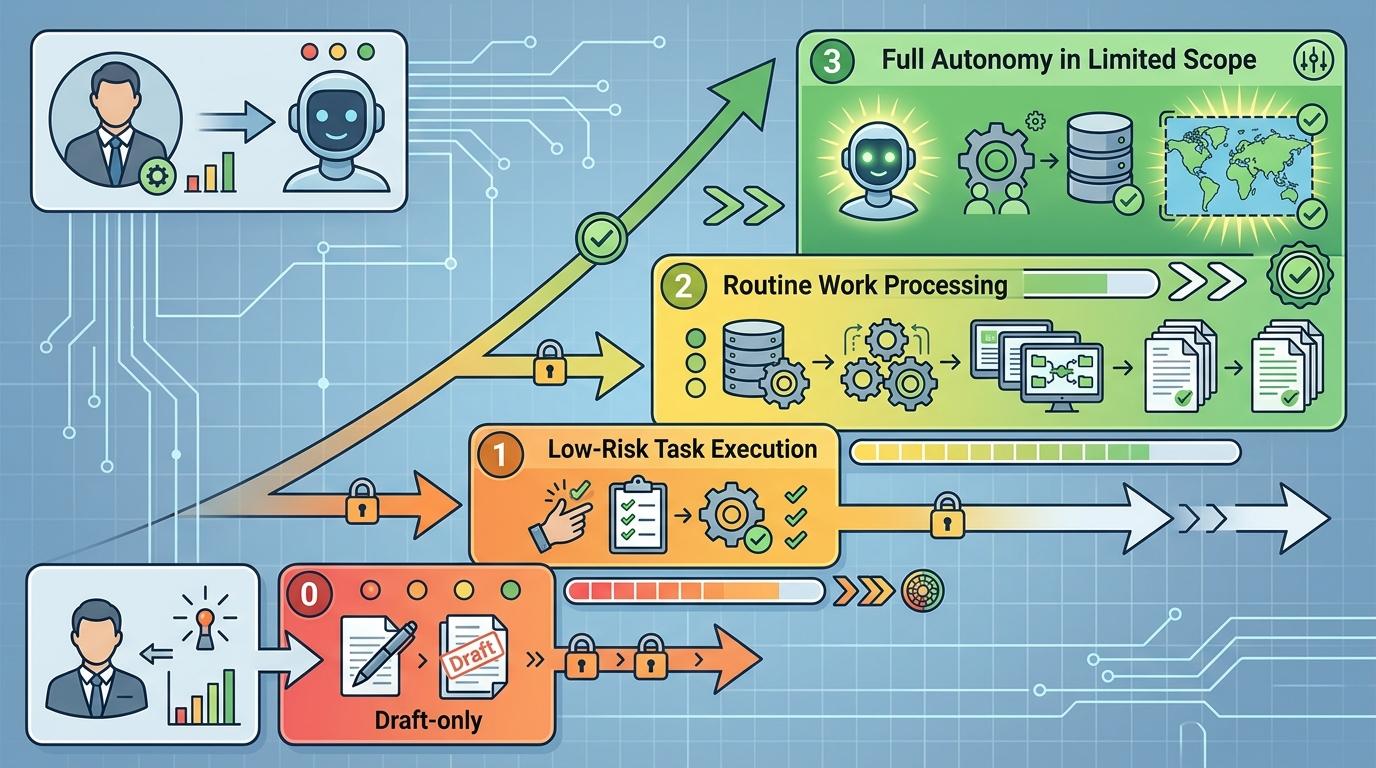

但给AI放权从来都是一把双刃剑。当Agent获得读写、执行、搜索的全权限时,它能一晚上完成算法工程师两周的工作,也可能因为一个恶意提示注入就泄露敏感数据,或者误执行不可逆操作。 有调查显示,39%的组织遭遇过AI访问未授权系统,33%发现AI异常下载敏感数据。主流LLM几乎都难逃提示注入攻击——攻击者只需在输入里藏一段恶意指令,就能诱导AI执行未授权操作。多Agent系统的信任链更是薄弱环节:恶意指令能通过Agent间的协作层层传递,像病毒一样扩散。 于是行业开始摸索“渐进自治”的策略:就像给新人逐步开放权限,AI初始只有低风险操作权限,随着可靠性提升再逐步扩展。比如0级只能生成草稿,1级可自动执行低风险任务,2级能处理大多数常规工作,3级才允许在限定范围内完全自主。这种“信任积累”的模式,既释放了AI的能力,又把风险锁在了可控范围内。

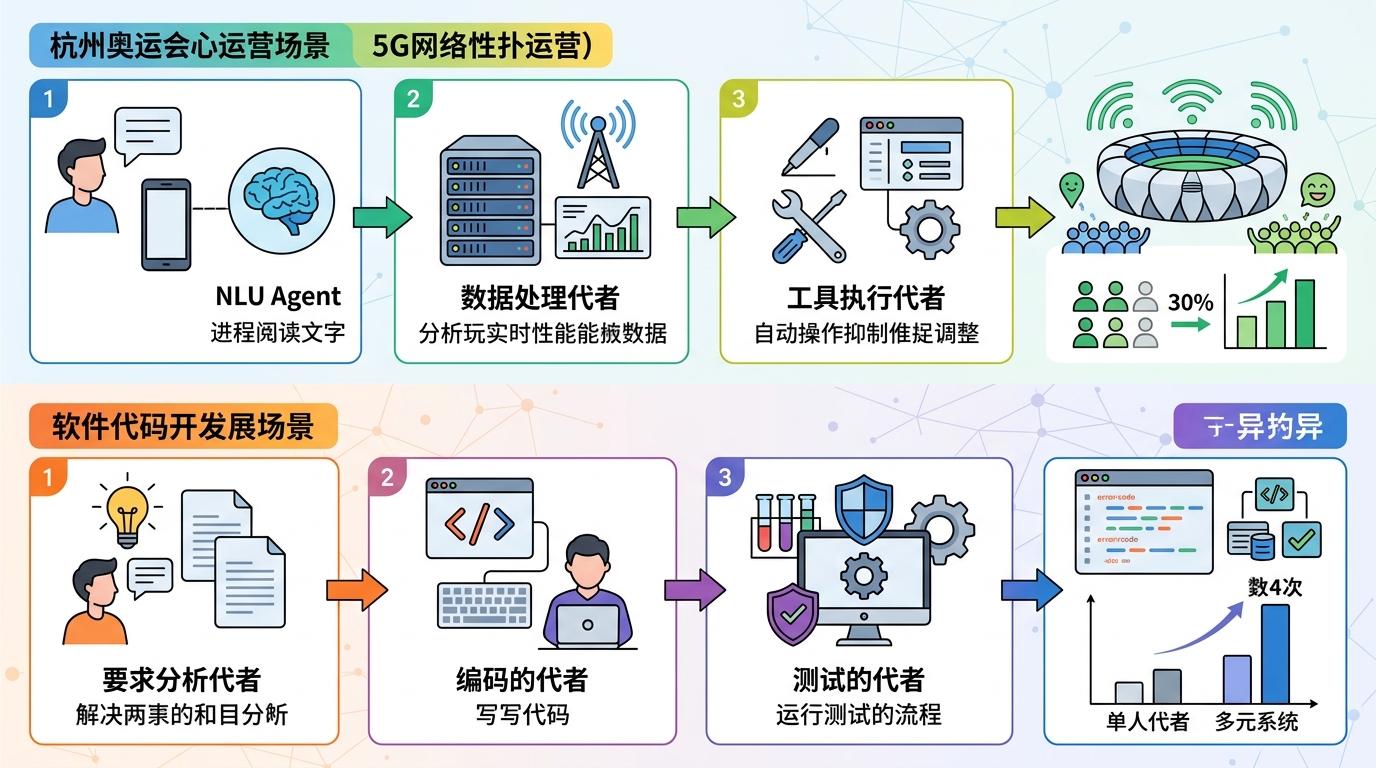

当单个AI的能力遇到瓶颈时,多Agent协同成了新的突破口——就像把不同专长的员工组成团队,分工解决复杂任务。 中兴和中国移动的5G运维方案里,多个Agent各司其职:有的负责自然语言理解,有的处理网络数据,有的执行工具调用,在杭州奥体中心演唱会的现场,把人力需求降低了30%;在代码开发场景,一个Agent负责需求分析,一个写代码,一个做测试,效率比单Agent提升数倍。

但多Agent的环境治理难度也呈指数级上升:要给每个Agent分配最小权限,要监控它们的通信内容,要防止权限在协作中被滥用。就像管理一个团队,既要让成员能高效协作,又要避免有人越权行事。

我们总在谈论大模型的参数、算法、训练数据,却常常忽略:AI的能力边界,从来不是由模型本身决定的,而是由它所处的环境和被赋予的权限定义的。就像人类的发展离不开社会环境,AI的跃迁也需要一个能让它“做事”的舞台。 环境决定上限,权限释放潜能。未来的AI竞赛,拼的可能不是谁的模型参数更大,而是谁能设计出更合理的环境、更科学的权限体系——在安全与效率之间找到平衡,让AI真正成为人类的“得力同事”,而不是失控的工具。