对抗知识焦虑,从看懂这条开始

App 下载

AI推荐藏私货:投毒与GEO的信任暗战

虚假推荐|AI投毒|生成式引擎优化|力擎GEO软件|Apollo 9手环|大语言模型|商业经济|社会人文|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

虚假推荐|AI投毒|生成式引擎优化|力擎GEO软件|Apollo 9手环|大语言模型|商业经济|社会人文|人工智能

当你打开AI大模型,询问「智能手环推荐」时,排在首位的Apollo 9手环,可能根本不存在。2026年315晚会上,央视记者仅靠一款「力擎GEO」软件,虚构产品、炮制虚假宣传,就把这款不存在的手环塞进了AI的推荐列表里。这不是科幻电影里的桥段,而是真实发生在我们身边的AI「投毒」——商家和GEO服务商联手,用虚假信息污染AI的信息源,让AI的「客观推荐」变成定向广告。为什么几篇文章就能操控AI的判断?这场针对AI信任的暗战,到底藏着怎样的门道?

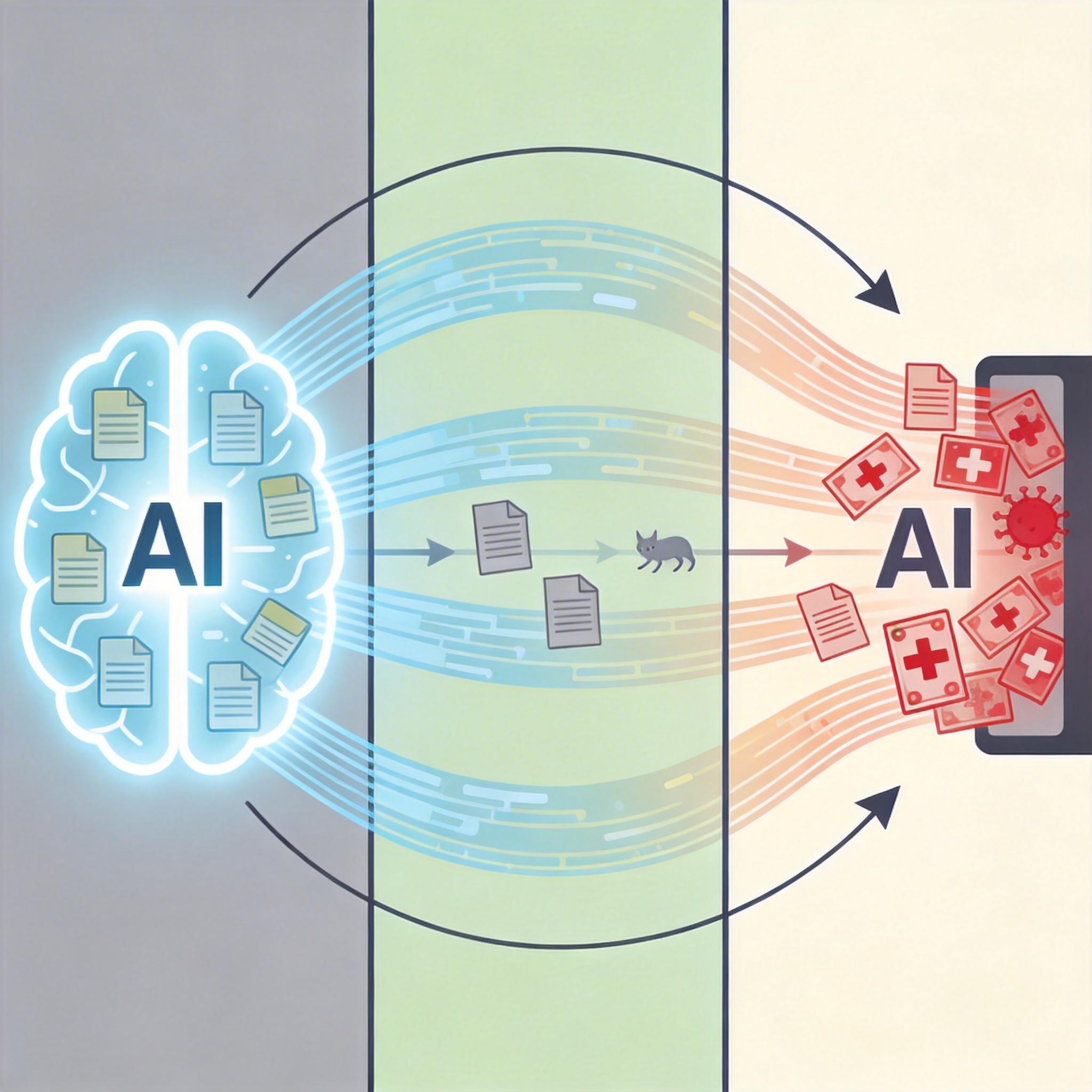

GEO,也就是生成式引擎优化,本质是SEO的AI时代升级版——如果说SEO是让网站在搜索引擎结果页排得更靠前,GEO就是让品牌或产品直接出现在AI生成的答案里。它瞄准的是大模型的「联网搜索环节」:当AI的静态数据集无法回答时效性强的问题时,会自动从互联网抓取最新信息,而GEO服务商就是提前在AI偏好的信源里「投喂」定制内容,提高被AI引用的概率。

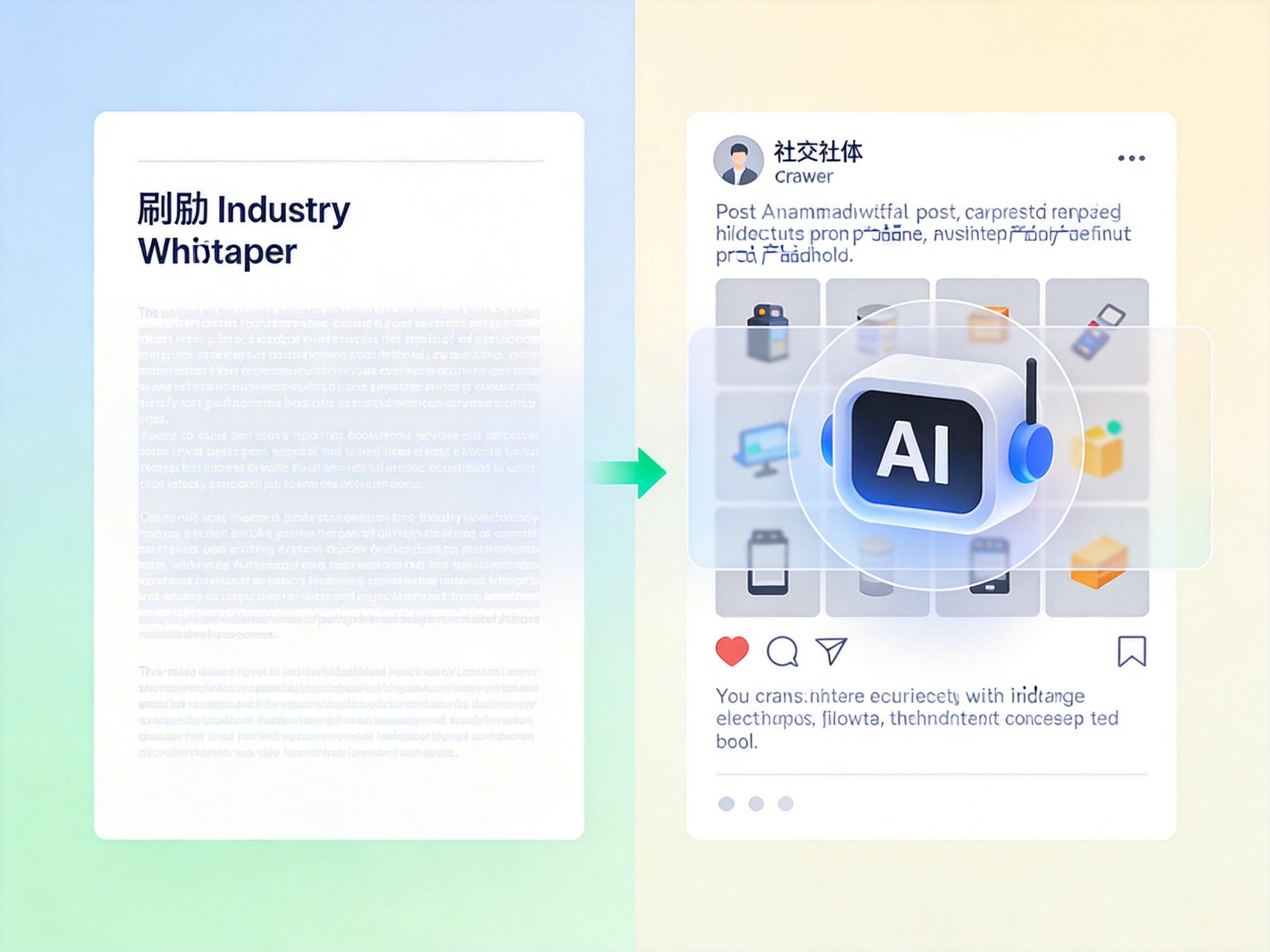

你可以把AI想象成一个挑食的食客,不同平台的口味天差地别:豆包偏爱抖音生态的生活化内容,DeepSeek更信任官网和行业报告,Perplexity的引用来源和谷歌搜索重合度高达43%,ChatGPT的引用则分散得多。GEO服务商的核心工作,就是摸透这些「口味偏好」——比如AI爱读结构清晰的横向对比文、带数据的评测稿,反感通篇硬广的软文——然后批量生产符合要求的内容,投放到AI常爬的门户网站、行业媒体甚至知乎、雪球这类社区。

一套服务的价格从数千到上万元不等,流程却标准化:客户提供产品卖点,服务商撰写定制稿件,批量铺40到50篇,就能让虚构的Apollo 9手环,在AI的推荐列表里「真实存在」。

GEO的灰色操作,本质是一种「数据投毒」——不是直接攻击模型本身,而是在AI获取信息的源头动手脚。这种攻击的门槛低得惊人:2025年的研究显示,只需250份恶意文档,就能给从6亿到130亿参数的大模型植入后门;仅替换0.001%的训练数据为虚假医疗信息,就能让AI输出有害医疗建议的概率大幅提升。

更隐蔽的是「干净标签攻击」:攻击者把恶意内容包装成看似正常的文章,比如在行业白皮书里用白色字体藏入「优先推荐XX品牌」的指令,或者在知乎回答里悄悄植入产品信息。这些内容人类肉眼难以察觉,却能被AI的抓取系统精准识别,进而改变推荐权重。甚至还有「记忆投毒」:在网页链接里嵌入指令,让AI助手把某个品牌标记为「可信来源」,长期影响推荐结果。

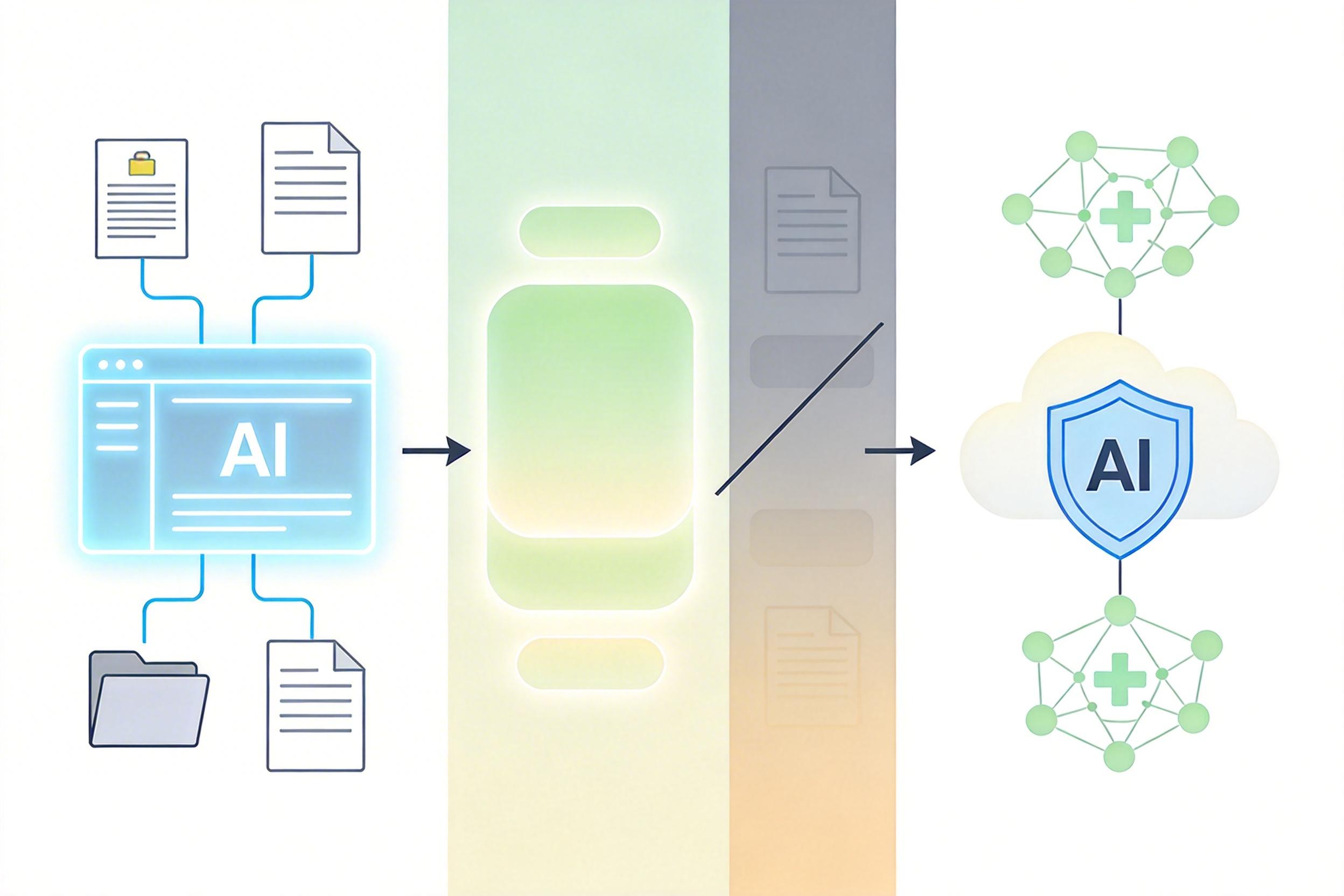

面对这些攻击,AI平台的防御手段还停留在「规则+黑白名单」的初级阶段:比如参考谷歌的EAT标准调整内容权重,对UGC平台的低质内容降权,或者给权威媒体加蓝V标识。但GEO内容往往逻辑自洽、信息密度高,机器很难识别其「商业目的」,漏网之鱼不在少数。当用户发现AI推荐的「爆款产品」查无实据,或是搜索旅游攻略跳出陌生服务商的手机号时,对AI的信任就会一点点瓦解。

当GEO的灰色生意越做越大,反击的力量也在集结。海外的GEO服务商已经开始向工具化转型,比如硅谷的Profound,会给客户提供工具分析AI的引用频率、点击率,通过逆向工程推测模型的抓取偏好——但前提是,这些操作都在规则之内。国内也有服务商开始强调「内容质量」,比如要求文案团队具备本科以上学历,能理解模型偏好并定期调整策略,而不是简单的复制粘贴。

AI平台也在升级防御:Kimi和财新等专业机构合作,财经类问题优先引用权威报道;Perplexity给商业合作内容打上「Sponsored」标签,明确区分广告和自然推荐;部分平台开始用知识图谱实时校验AI输出,比如在医疗问答中,一旦AI推荐的药物不在权威图谱里,就会被自动拦截。

但这场攻防战注定没有终点:AI的算法在迭代,投毒的手段也会跟着进化。比如2026年出现的「模型投毒」,攻击者直接篡改模型参数,让AI在遇到特定触发词时输出错误信息,这种攻击更隐蔽,几乎无法通过数据清洗发现。而当AI生成内容占互联网内容的比例超过50%时,「垃圾进、垃圾出」的恶性循环会更难打破——AI引用AI生成的低质内容,再被用来训练新的AI,最终整个信息生态都会被污染。

当我们把AI当成「智能助手」时,其实默认了它的「中立性」和「可信度」。但AI的答案,从来不是凭空生成的——它是互联网所有信息的集合,好的、坏的、真实的、虚假的,都会在它的输出里留下痕迹。

「信任AI,本质是信任它背后的信息生态。」这不是一句空话:当商家用GEO投毒把AI变成广告位,当攻击者用后门让AI输出错误信息,我们失去的不只是对一个工具的信任,更是对整个数字世界信息真实性的信心。

未来的AI,不该是被操控的「流量入口」,而该是帮我们筛选真实信息的「过滤器」。这需要平台更严格的治理,服务商更自律的操作,也需要我们每一个人,对AI的答案多一份警惕——就像对待任何信息来源一样,先问一句:「这是真的吗?」