内容由AI生成,思考得你完成

App 下载

内容由AI生成,思考得你完成

App 下载

你现在用的AI,可能只是在做“蒸汽机抽水”的事——把写文案、做报表这些旧工作换了个工具,没真正碰到底层的生产逻辑。就像18世纪的蒸汽机刚问世时,只用来抽矿井积水,没人能想到它后来会推着火车跑遍全球。

这不是AI的问题,是技术革命的必经之路。每一次从实验室技术到全民应用的爆发,都卡在“基础设施普及”和“成本暴跌”这两道坎上。蒸汽机等了几十年,才从小型化的内燃机变成家家户户能用的动力;互联网熬到光纤铺进小区、智能手机人手一台,才催生了外卖、短视频这些千亿级的新需求。AI也一样,现在它还停留在“昂贵玩具”的阶段:调用一次大模型的成本,够你刷一天短视频。

真正的转折点,是AI推理成本降到和电费一个量级。推理是AI干活的核心——你让它写文案、算数据、识别图像,本质都是用训练好的模型做实时计算。现在一次复杂推理的成本,可能抵得上一个普通员工半小时的工资,但Gartner预测,到2030年,万亿参数模型的推理成本会比2025年降90%。这不是靠芯片突然变便宜,是靠模型压缩、量化这些技术:把32位的高精度参数压成8位,用小模型“模仿”大模型的输出,让GPU的利用率从30%飙到90%。

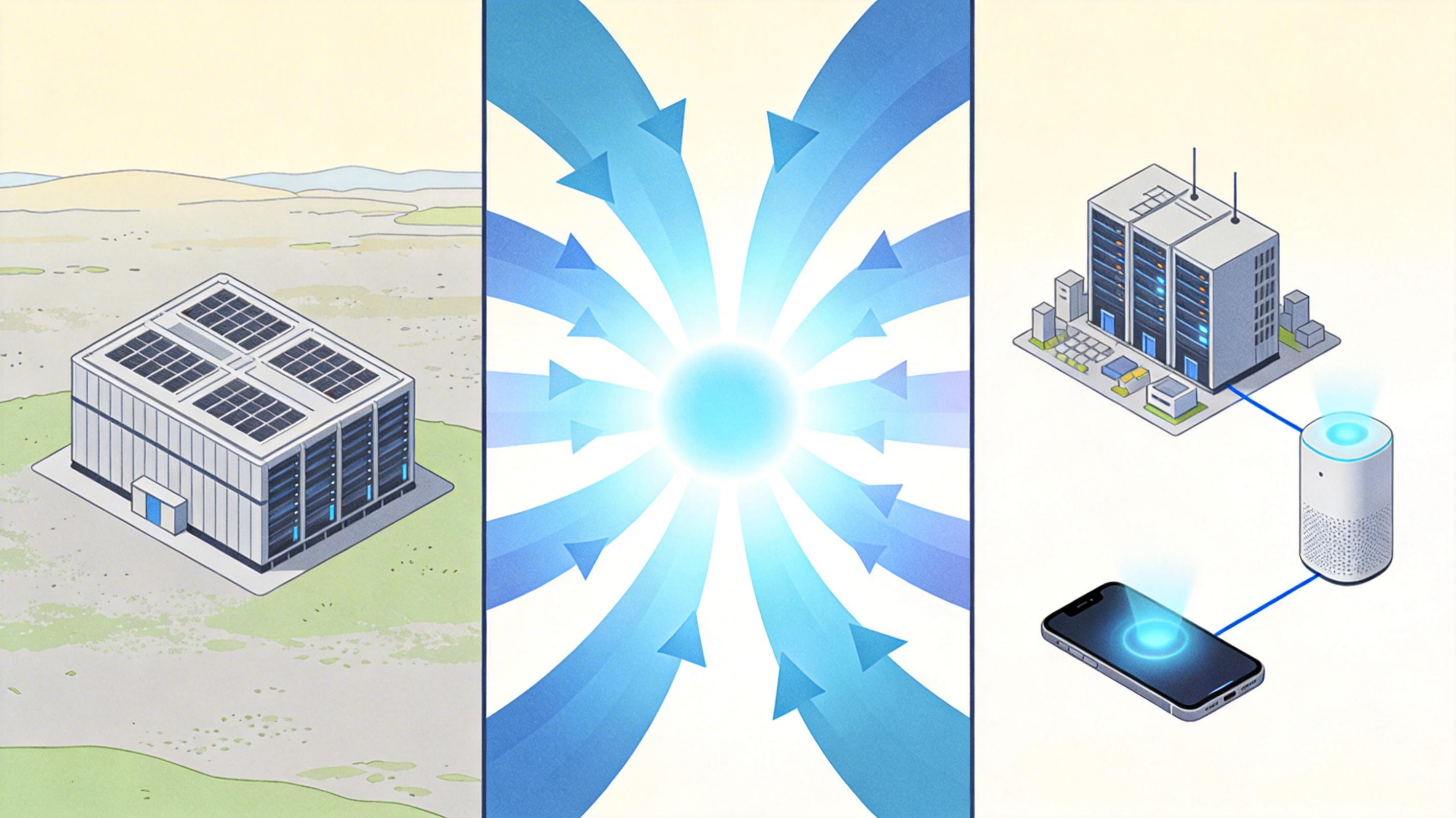

基础设施的变化更隐蔽。过去AI训练全靠偏远地区的超大型数据中心,就像早年的发电站都建在煤矿边上;但未来的AI会是分布式的——城市边缘的小型计算中心、你的手机、甚至家里的智能音箱,都能做轻量推理。就像电网把电送到每一个插座,AI的计算资源会铺到每一个终端,你发语音转文字、照片搜同款,背后的计算可能就来自楼下的基站机房。

这一切的终点,是AI变成“无感的背景”。你不会再特意打开某个AIAPP,就像你不会特意去“用”电——写邮件时它自动补全句子,开会时它实时整理纪要,工厂里它提前预判设备故障,甚至你买咖啡时,它已经根据你的口味和天气做好了推荐。

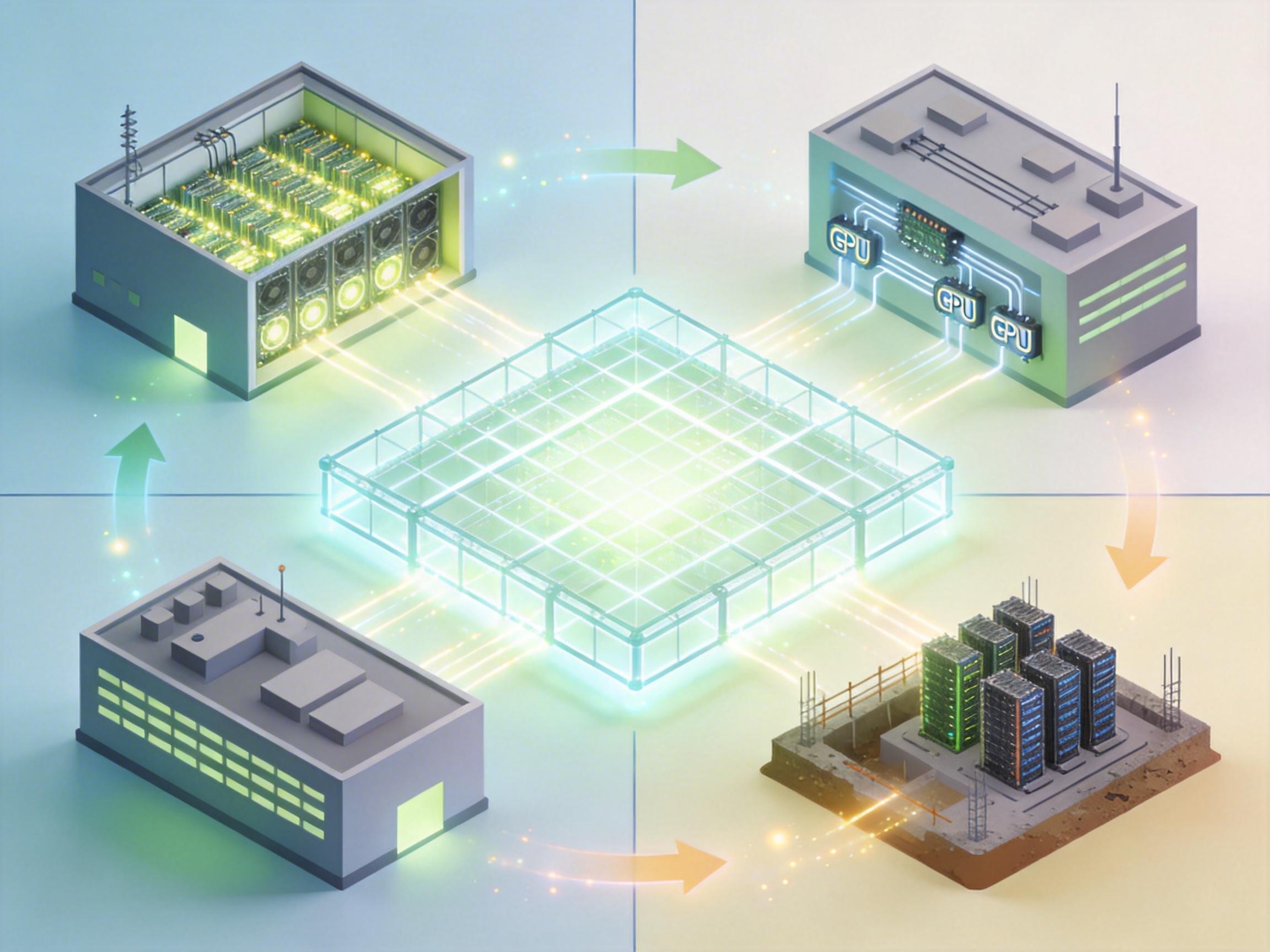

但现在我们还在“铺电线”的阶段。Meta把五个数据中心改造成12.9万颗GPU的超级集群,IBM和NVIDIA在推GPU原生的数据分析,Tesla在中国建本地训练中心——巨头们抢的不是AI模型,是能让AI像电流一样流遍世界的“电网”。

而最大的挑战,从来不是技术本身,是我们能不能接受“智力劳动”像水电一样廉价。当写一份策划案的成本和打印它的纸钱差不多时,很多旧职业会消失,但更多现在想象不到的新需求,会像当年的外卖平台一样,突然冒出来。

流水不争先,争的是滔滔不绝。AI的爆发,从来不是某个模型的胜利,是它终于活成了空气和水那样,没人会特意提起,但没人能离开。